安全的人工智能:从技术理想走向现实之路究竟还有多远?

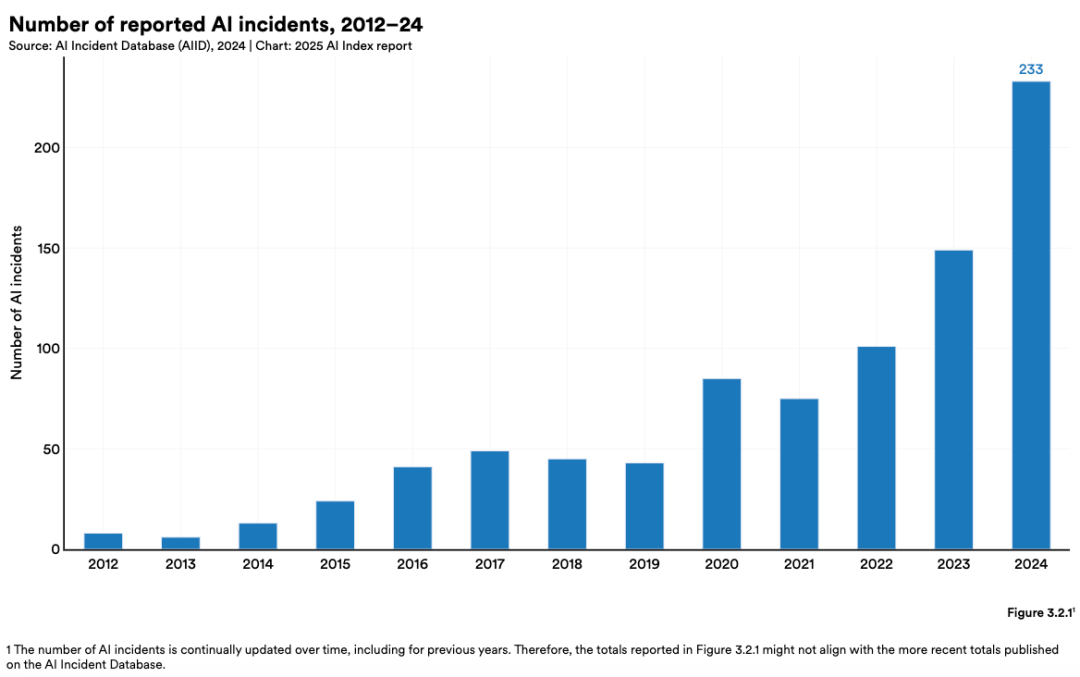

当人工智能开始在医疗诊断中推荐治疗方案、在金融系统中评估信用风险、在工厂里控制生产线时,一个无法回避的问题摆在我们面前:我们能否真正信任这些智能系统?2024年的数据显示,全球报告的人工智能安全事件达到233起,比前一年激增56.4%。这些数字背后,是一个个具体的风险和真实的教训。

来源:HAI

一、各行各业的现实挑战

在医疗领域,AI诊断系统的不确定性正在引发担忧。虽然还没有公开报道因AI诊断直接导致患者死亡的极端案例,但研究显示,AI医疗模型在面对罕见病症时表现出的不确定性管理仍然薄弱。医生们发现,AI系统有时会以过度的自信给出错误建议,这种“确定性幻觉”在医疗场景下可能产生严重后果。

金融行业同样面临考验。算法偏见在金融领域的风险并非理论推演,而是已经显现的现实问题。一个广为人知的案例是2019年的苹果信用卡事件。当时,多位用户发现,尽管在共同报税、共享银行账户的情况下,苹果公司与高盛银行联合推出的信用卡授予男性的信用额度却远高于其妻子。这一现象引发了公众强烈质疑,并导致了纽约州金融服务局的正式调查。尽管发卡方声称其算法‘不基于性别、种族或其他受保护特征做出决定’,但此事件清晰地揭示了:即使设计意图中立,AI系统仍可能通过其他代理变量,学习并复制现实中存在的结构性偏见,导致具有歧视性的输出结果。

来源:BBC新闻报道:https://www.bbc.com/news/business-50365609

制造业的智能化转型同样遭遇现实挑战。2024年,某汽车制造商被迫召回一批由AI视觉检测系统把关的车辆,原因是该系统未能识别某种类型的零部件缺陷。而在一个智能仓储案例中,物流机器人因错误识别货架位置,导致整个分拣系统停滞数小时,造成重大经济损失。

日常生活中,AI助手的问题更加常见。智能家居系统被恶意攻击后泄露用户隐私,语音助手在未经明确指令下自主下单购物,推荐算法将用户困在信息茧房中……这些问题虽然很少造成物理伤害,却在潜移默化中影响人们的生活质量和社会认知。

二、安全AI的三重维度

1. 技术可靠性是基础保障

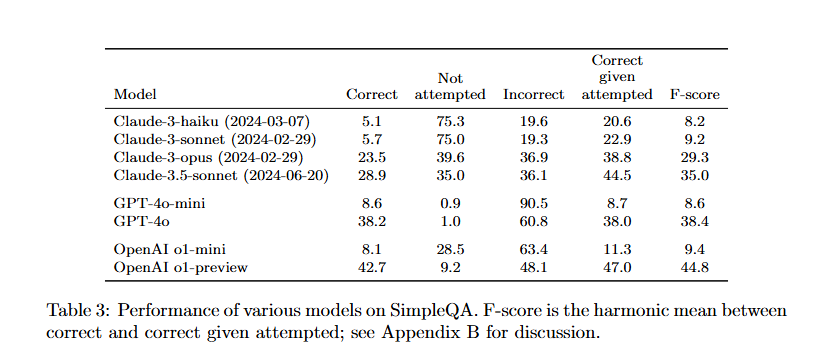

一个安全的AI系统应该像可靠的电力系统一样,在绝大部分时间稳定工作,在出现异常时能够安全降级。现实情况却令人担忧:最先进的大语言模型在简单事实问题上的回答正确率仍低于50%。当AI连基本事实都难以准确把握时,我们又怎能放心让它处理复杂任务?

来源:论文《Measuring short-form factuality in large language models》

2. AI 责任感是核心要求

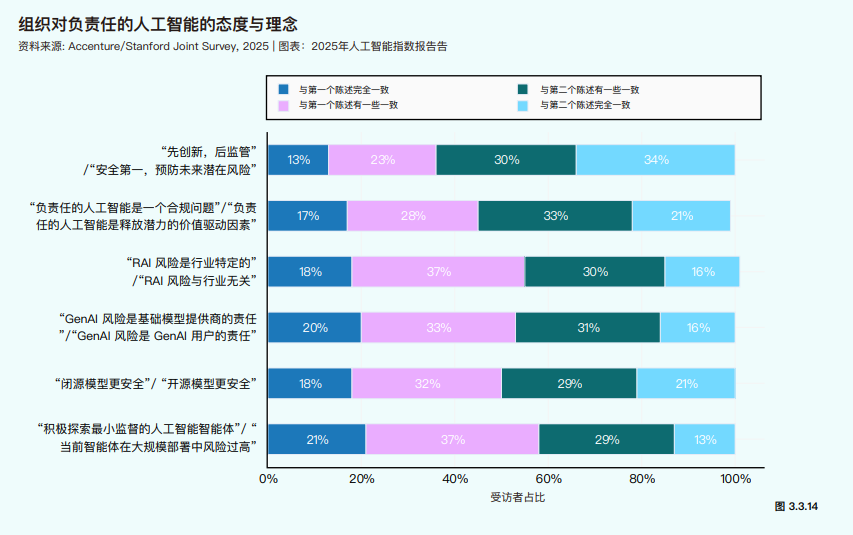

安全的AI必须对其行为后果负责。这不仅意味着技术上的准确,更包括伦理上的合规。2024年发生的多起事件——从聊天机器人提供有害建议,到深度伪造技术侵犯个人权益——都表明,缺乏责任约束的AI可能成为危害社会的工具。企业界已开始意识到这一点,66%的商业领袖将网络安全列为首要关注,但只有53%采取了有效措施。

来源:《2025年人工智能指数报告》

3. 运作透明性是关键保障

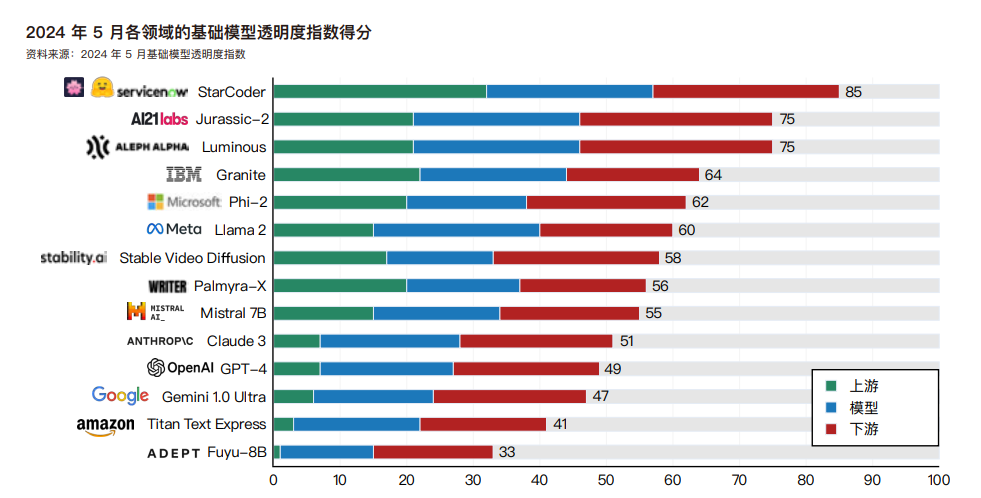

当AI系统做出令人困惑的决策时,我们必须能够追溯其推理过程。然而,基础模型透明度指数显示,主要AI开发商的平均透明度得分仅为58%,虽较去年有所进步,但仍有巨大改进空间。这种不透明性使得错误难以及时发现和修正。

来源:《2025年人工智能指数报告》

三、AI 认知与行动的差距

当前AI安全领域最突出的问题,是多重断裂的存在。

技术能力与安全要求之间的断裂显而易见。AI系统能在专业考试中取得高分,却在基础事实上频频出错。这种发展不平衡就像建造外观华丽却地基不稳的建筑,令人担忧。

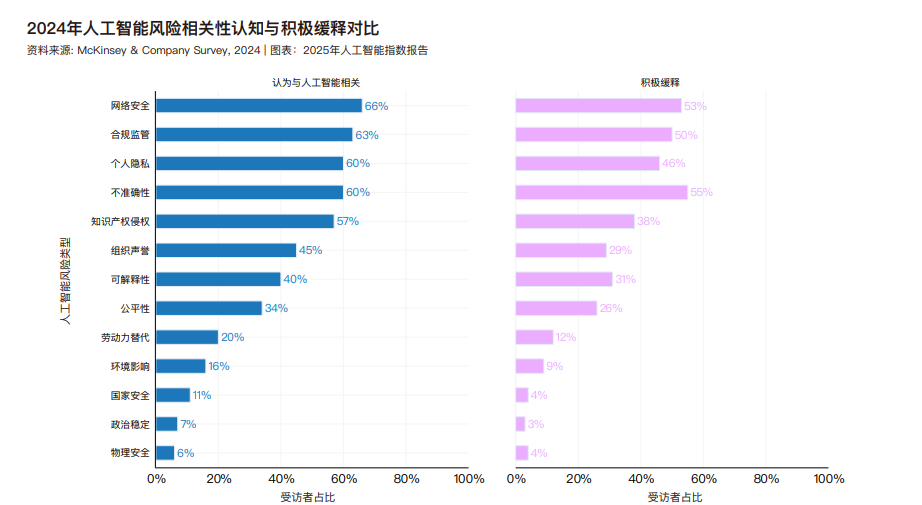

企业认知与行动之间的断裂同样明显。尽管57%的企业关注知识产权侵权风险,只有38%采取了缓解措施;45%的企业担心组织声誉风险,仅29%积极应对。这种“知易行难”反映出企业在资源、能力和优先级上的困境。

来源:《2025年人工智能指数报告》

学术研究与实践应用之间的断裂同样存在。顶级AI会议上关于负责任AI的研究论文在2024年达到1278篇,年增长28.8%,但这些成果向产业界的转化速度,远跟不上技术风险的积累速度。

四、通向安全未来的路径

构建安全的人工智能需要系统性的努力,而非零散的修补。

建立共识性的安全标准是首要任务。目前,AI行业在性能测试上已形成统一标准,但在安全评估方面仍碎片化。行业需要共同努力,建立被广泛接受的安全基准,让不同系统的安全性可以客观比较。

完善企业治理架构至关重要。当前企业中的AI治理职责分散在信息安全、数据分析等多个部门,缺乏统一协调。未来的趋势是建立专职的AI治理团队,统筹技术安全、合规要求和伦理考量。

持续的安全投入必须成为优先事项。令人鼓舞的是,大型企业已开始行动,年收入超100亿美元的企业中,27%在AI安全上的投资达到千万美元级别。这些投入正在产生回报,42%的企业报告业务运营得到改善,34%的企业获得了客户信任的提升。

加强全球协作同样不可或缺。AI安全是无国界的挑战,需要国际社会的共同努力。从经合组织到联合国,多个国际组织正在构建AI治理框架,这种合作应当继续深化。

五、结语:在智能与安全之间寻找平衡

回顾人工智能的发展历程,我们仿佛看到一个快速成长却尚未成熟的孩子——能力突飞猛进,责任感却未能同步。从医疗诊断到金融风控,从工业生产到日常生活,AI正在各个领域展示其巨大潜力,同时也暴露其固有局限。

在伦敦,一位女性因AI误识而被公开指控盗窃,承受了不该属于她的羞辱;在德州,一位少女因AI生成的虚假图像而经历心理创伤;在全球各地,无数用户在与AI系统的日常交互中遭遇各种困扰。这些不是冰冷的技术问题,而是真实的人类困境。

当我们期待AI帮助我们诊断疾病、管理财富、优化生产时,我们必须问自己:我们是否建立了足够的安全保障?我们是否准备好承担技术失误的后果?

真正的智能,不仅在于能做什么,更在于知道什么不该做。在追求更强大AI的道路上,安全不是可选项,而是必选项。当我们赋予机器更多自主权的同时,我们是否也相应地提升了我们的责任和能力?这个问题,值得每个与AI共舞的人深思。