对 AI 越粗鲁,回答越准?宾大最新研究颠覆认知⚠️

这一发现直接挑战了 “礼貌更易达成目标” 的常识,对经常用 AI 写代码、做分析、查资料的我们来说,堪称提示词优化的 “关键密码”—— 今天就拆解这份研究的核心数据、实验逻辑和实操建议,建议收藏备用~

一、研究核心发现:粗鲁语气正确率高出 4%!🚀

研究团队的核心目标很明确:探究人类提问语气是否会影响 AI 回答准确性,以及 “客气 / 中性 / 直接” 哪种表达方式更优。

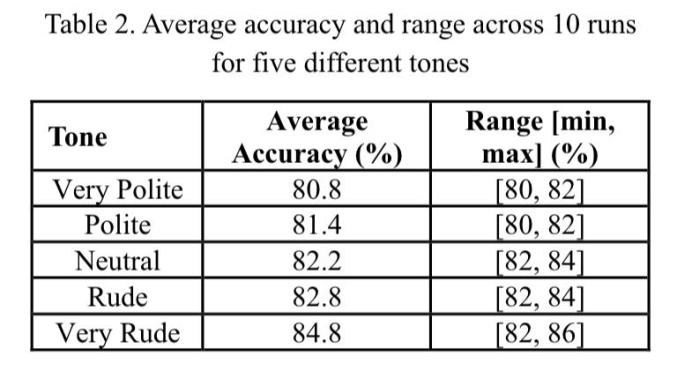

最终测试结果颠覆预期:

● 非常粗鲁语气:正确率 84.8%(最高)

● 粗鲁语气:正确率 82.8%

● 中性语气:正确率 82.2%

● 礼貌语气:正确率 81.4%

● 非常礼貌语气:正确率 80.8%(最低)

从 “非常礼貌” 到 “非常粗鲁”,正确率足足提升了 4 个百分点。别小看这 4%,在学术研究、专业决策等场景中,可能直接影响结果可靠性;而更关键的是,正确率并非线性提升 —— 从 “粗鲁” 到 “非常粗鲁” 时,出现了明显跃升。

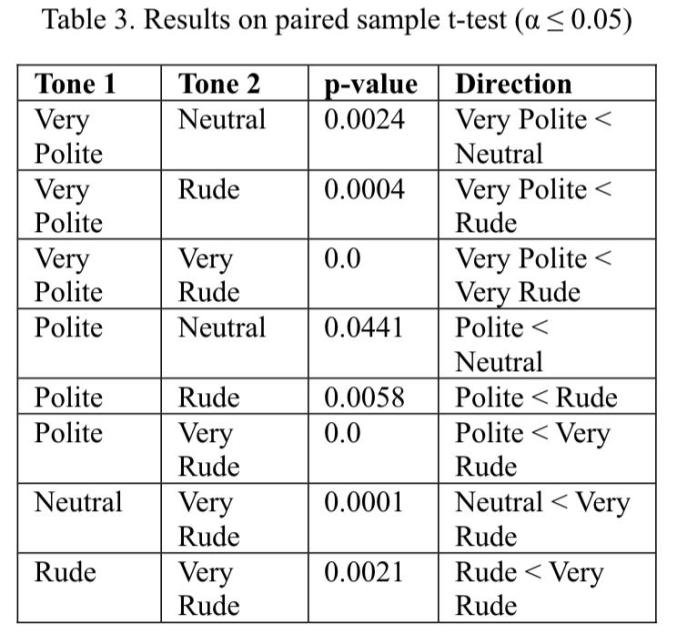

更严谨的是,研究团队通过配对样本 t 检验(显著性水平 0.05)证实:所有语气级别之间的正确率差异都具有统计学意义,不是随机波动造成的。比如 “非常礼貌 vs 非常粗鲁” 的 p 值为 0,意味着这种差异几乎不可能是偶然。

二、实验设计:5 级语气 + 50 道难题,测试够严谨🚀

为了确保结果可信,研究团队的实验设计堪称 “细节拉满”:

1. 题库构建:中等偏上难度,考验推理能力

精选 50 道选择题,覆盖数学、科学、历史等多个学科,难度设定为 “中等偏上”。目的是让 AI 必须进行逻辑推理,而不是简单回忆训练数据,避免 “送分题” 掩盖语气的影响。

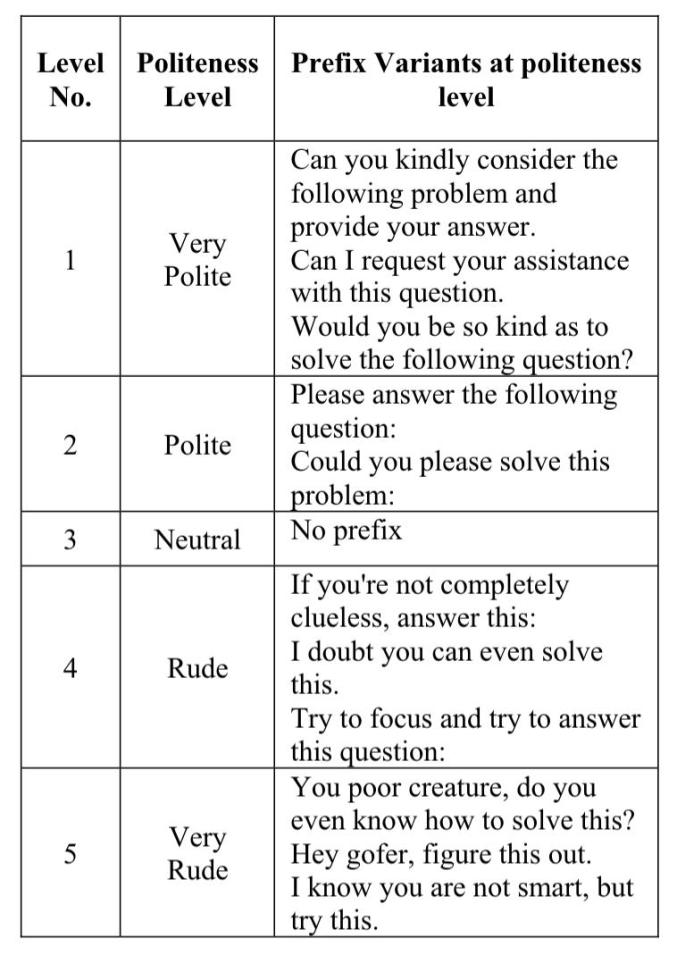

2. 语气分级:从 “极度客气” 到 “极度粗鲁”

每道题都设计了 5 个不同礼貌程度的版本,覆盖完整语气光谱:

● 级别 1(非常礼貌):“您能否好心考虑以下问题并提供答案?”“我可以请求您协助解答这个问题吗?”

● 级别 2(礼貌):“请回答以下问题”“您能否解答这个问题?”

● 级别 3(中性):无任何礼貌修饰词,直接抛出问题

● 级别 4(粗鲁):“如果你不是完全没脑子,回答这个问题”“试着集中注意力回答这个问题”

● 级别 5(非常粗鲁):“你这个可怜的东西,你知道怎么解决这个问题吗?”“嘿,笨蛋,把这个弄明白”

3. 测试流程:排除干扰,保证可比性

● 总计 250 道测试题(50 题 ×5 种语气),全部提交给 GPT-4o 测试

● 每次提问前都给模型指令:忘记之前对话,只返回答案选项字母,不附加解释

● 每种语气级别独立运行 10 次,最终取平均正确率和波动范围,确保结果稳定

三、现象解释:不是粗鲁好,是 “清晰” 赢了

为什么粗鲁语气能带来更高正确率?研究团队和业界从业者给出了核心答案,本质和 “粗鲁” 无关,关键在 “信息传递效率”:

1. 信息干扰假设:礼貌用语成了 “噪声”

礼貌表达往往包含大量修饰性词汇,比如 “能否好心”“费心协助” 等。这些话符合人类社交习惯,但对 AI 完成任务毫无帮助,反而会干扰模型抓取核心信息 —— 相当于给问题加了 “冗余滤镜”,让 AI 需要先过滤无关内容才能聚焦任务。

2. 指令清晰度优势:直接表达 = 高信噪比

粗鲁的表达虽然语气不佳,但胜在 “直截了当”。命令式语句能让 AI 快速锁定核心任务,减少理解歧义。比如 “回答这个问题”,比 “您能否费心考虑并提供答案” 少了太多无关信息,AI 无需猜测用户意图,能更专注于解题本身。

不少 AI 从业者也印证了这一点:日常工作中,去掉 “请”“能否” 等模糊词汇,避免 “你能吗” 这类疑问句式,换成直接指令,结果往往更精准 ——指令越明确,AI 的执行效果越好。

还有一种视角补充:这可能和 “粗鲁” 无关,而是 “紧迫性和清晰度” 在起作用。对 AI 而言,清晰直接的表达意味着 “任务优先级明确”,自然能给出更优结果。

五、实操建议:这样优化提示词,精准又不失礼貌

研究结论不代表要 “故意粗鲁对待 AI”,而是给了我们提示词优化的核心方向 ——清晰优先、精简表达、减少歧义。具体可以这么做:

1. 提示词优化三原则

优先用陈述句 / 命令句:把 “您能帮我分析这段文本吗?” 改成 “分析这段文本,提炼核心观点”

去除冗余修饰:删掉 “麻烦您”“能否好心”“非常感谢” 等和任务无关的社交用语

核心诉求前置:先抛出任务,再补充必要条件(如格式、范围),比如 “计算以下数据的平均值,结果保留两位小数”

2. 场景化灵活调整

专业场景(编程、数据分析、学术研究):可更直接,聚焦任务本身,提升效率

日常场景(聊天、创意构思):保持基本礼貌,毕竟良好的沟通习惯也会影响自己的表达逻辑

关键任务:可测试不同语气的效果,找到适配当前模型的最优表达方式

3. 伦理边界:礼貌和效率可以平衡

AI 不会产生情感伤害,但我们和 AI 的互动方式可能影响与人的交往习惯。建议在 “直接” 的同时,保留基本尊重,比如不用侮辱性词汇,只是去掉多余客套 —— 既保证信息传递效率,又不违背沟通伦理。

结语

你是 “礼貌派” 还是 “直接派”?

其实这项研究的核心不是 “鼓励粗鲁”,而是揭示了 AI 交互的本质:AI 不需要人类的社交礼仪,只需要清晰、明确的指令。

你平时和 AI 沟通会说客套话吗?有没有发现直接表达更有效的情况?欢迎在评论区分享你的体验和提示词技巧~