当ChatGPT在泌尿妇科:让患者更“安心”但更不安心

大语言模型正以惊人的速度渗透医疗健康领域,特别是在患者教育和医疗知识获取方面。

泌尿妇科,一个专注于管理盆底功能障碍等疾病的亚专科,由于其高度的尴尬性,许多患者在就诊前倾向于寻求匿名、非评判性的信息源,ChatGPT这类工具,恰好满足了这种需求。

在一项由203名真实患者参与的最新临床实验中,ChatGPT的回答在在可理解性和安心感上全面击败了人类专家。但这并非因为AI的医术更高明,而是来自其程式化的简洁和语言温度。

这也为医疗AI的部署带来警钟,患者可能因为AI的流畅表达而耽误或误判病情

实验结果:AI赢了

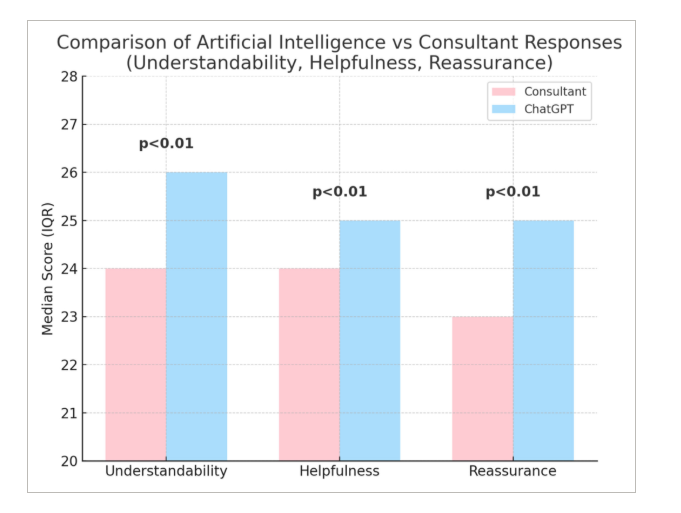

爱尔兰科克大学附属医院的研究团队对203名妇泌学患者进行了盲测:每位受试者需阅读6个常见病问题的两份回答,一份来自ChatGPT-4o(2024年版),一份来自有十年经验的专业医生。评分基于三个以患者为中心的维度,可理解性、实用性和安心感。

最终评分显示,AI的平均总分为76分高于医生的72分, ChatGPT在所有三个领域(可理解性、实用性和安心感)的评分均显著高于人类专家。在6个问题中,ChatGPT有4个被显著偏好,只有1个问题偏好专家。

AI取胜的关键,并非知识的深度,而是沟通的风格。

人类专家的回答往往带有自然的不一致性,甚至可能存在无意识的专业术语和口语化表达。但LLM的回应,由于其生成时被限制在“简洁、患者友好(3-5句话)”的标准化提示词,大模型可以始终保持高密度的信息传递,同时避免人类回答中常见的冗余或焦点分散。

同时AI的同理心是程式化和一致性的,它能精确的使用抚慰性的语言结构,而不会受到人类医生特有的时间压力、疲劳或个体沟通风格的影响。

换言之,患者喜欢AI的“可读性”。

隐藏的风险:错误的安全感

研究发现,当AI回答以安慰性语句结尾(如请放心,大多数女性都会经历这种情况)时,患者显著提升信任评分,即便该信息并非完全准确。

这种情况会导致两种临床后果

1. 过度自信风险:正如研究所示,患者倾向于将AI的同理心错误的等同于医学的准确性和深度,从而因AI回答看似专业而延迟就医。

2. 误导性自我安抚:在泌尿妇科,患者因羞耻感而倾向于延迟就诊,特别是尿失禁等高敏感病种中。这类患者极可能成为AI问诊的早期使用者。因此,AI的错误安抚可能阻止患者求助于真正的医生。

医疗AI的部署须采取专家监督模式

鉴于患者对AI存在过度信任的倾向,医疗机构在将大模型用于患者教育时,对每次对话都要监管,并满足三点。.一、风险透明(明确告知AI非医生,不提供诊断);二、 专家背书(AI输出需通过医学机构审查或嵌入专家监督系统);三、行动指引(强制推荐患者预约或咨询人类医生)。

在泌尿妇科等敏感领域,AI只能被视为咨询工具,不应取代临床判断。例如,AI可以提供关于“子宫脱垂”的简洁、清晰的定义和治疗概览,但只有医生能将其应用于患者的医疗史、情感状态和文化背景。

医生应学习AI的语言策略

ChatGPT之所以能在患者心中胜出,并非其理解医学,而是它更懂结构。这次研究也为临床沟通指明了方向,专家必须从AI的优势中学习,采用更结构化、去专业术语化的沟通策略,以提升患者满意度和依从性。