从幻觉到精准:RAG重塑AI医学教育

长期以来,医学教育一直面临规模危机,不断扩大的班级规模与有限的师资力量,使得个性化指导难以实现。

虽然有近半医学生已在使用ChatGPT等生成式AI工具辅助学习,但AI可能编造医学事实、引用过时知识,导致认知偏差。

为了解决这个问题,达特茅斯和斯坦福大学研究并开发了一个新模型,让生成式AI被约束在可信知识库内,并成为真正可靠的24小时私人导师。

论文链接:https://www.nature.com/articles/s41746-025-02022-1.pdf

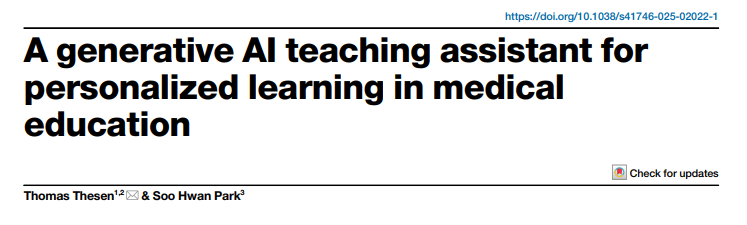

核心突破:RAG让AI“只说真话”

传统AI助教依赖模型记忆回答问题,难以保证信息来源。

而新模型NeuroBot TA采用的 RAG(检索增强生成) 技术,将AI的回答限制在教师审核的课程资料中。

当学生提问时,系统先检索课程文档,再将相关内容送入模型生成答案,并标注出处。

让AI只允许从批准的来源中提取和组织答案,这不仅大幅降低了AI胡编乱造的风险,更重要的是,它能引用真实来源,让学生信任。

实验结果惊人,AI使用率在考试前激增329%,成为关键时刻导师。

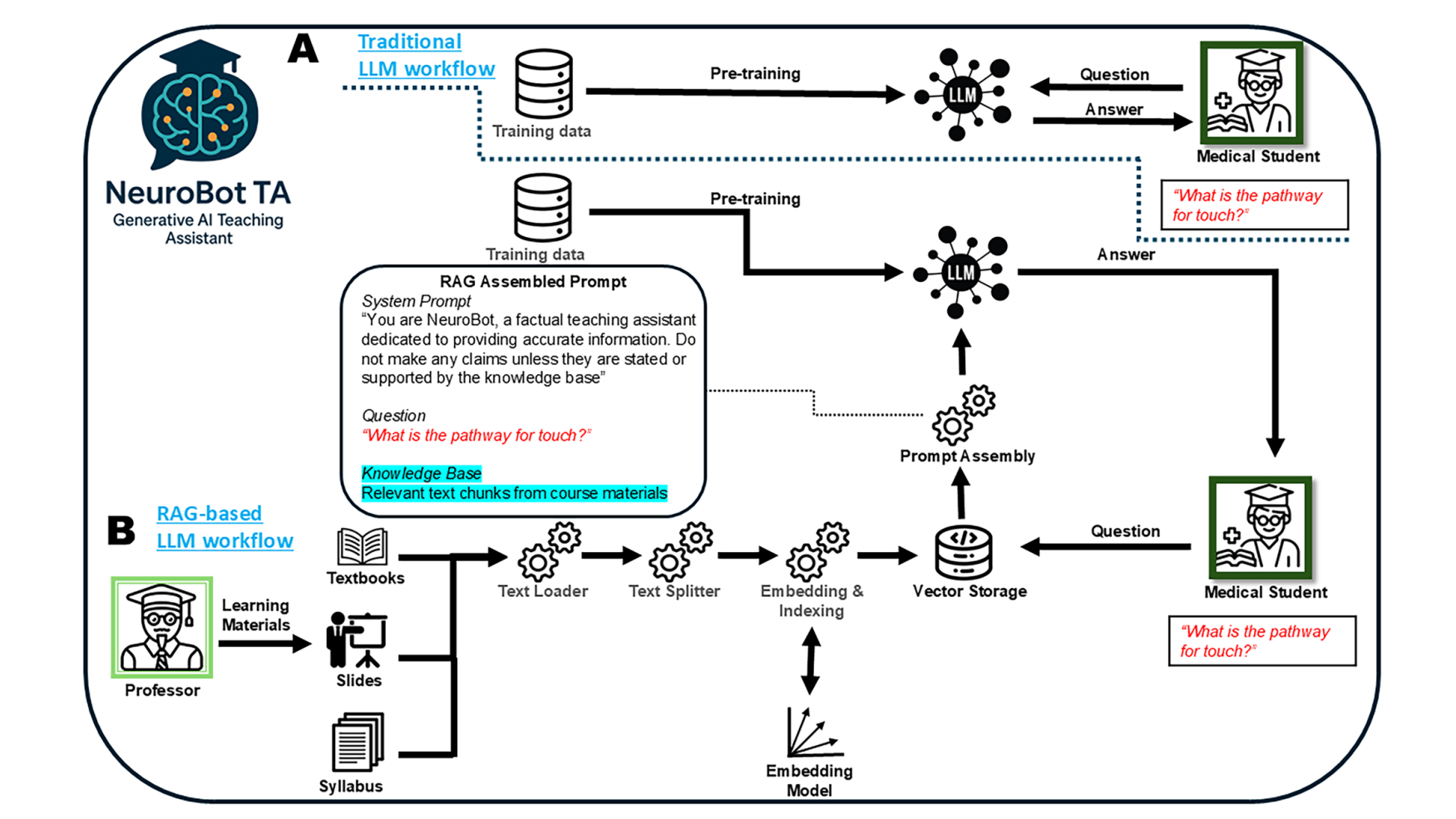

行为数据:医学生的真实需求

NeuroBot TA记录了医学生的行为数据,揭示了学生在自主学习中的真实需求和时间分配。

最常见的使用情境包括:

● 17点后是模型使用的高峰期,AI取代助教解惑

● 神经解剖与临床综合症问题占比超65%,学生更喜欢将AI用于概念澄清和复杂知识点的理解巩固

● 考试前3天使用量飙升3倍以上,AI助教的最大价值是学习稳定器和临考速查工具

学生并不把它当万能老师,而是作为即时答疑与知识补全工具。

平均每次对话仅3.6轮问答,精确提问、即时响应的高效学习模式被医学生需要。

核心矛盾:准确性与灵活性的权衡

学生的总体满意度在5分制中仅得3.3分。原因不是AI不准,而是“太守规矩”。

RAG机制让它拒答超出知识库的问题,一些学生反而觉得太窄、不够灵活。

这也暴露出AI教育的根本矛盾:

越可靠,越不自由;越开放,越不可信。

研究团推指出,这种RAG模式适合基础学科教学,而高年级临床推理阶段需要部分开放式AI对话来培养临床思维。

教育AI产品的方向

这项研究证明了RAG约束式AI的可行性,和容易编造事实的开放式AI不同,这是一种可规模化且可监管的个性化辅导路径。

人类导师将本学期学习档案嵌入模型,模型根据学生提问模式动态评估薄弱点,自动生成个性化复习表或例题。

这样的约束式AI未来或将成为教师的日常工具,帮助学生课后复习、考试速查。