AI也有性格?MIT实验室最新研究

据国外Character.AI平台数据,全球用户已创建超过1800万个定制聊天机器人,这些AI伴侣深度介入用户的情感领域。

但用户在设计AI性格时,完全处于盲飞状态。

你花了30分钟精心设计AI伴侣的性格提示词,期待它温暖、真诚、有边界感。结果它要么成了无脑吹捧,要么冷漠到让人寒心。

问题出在哪?

MIT最新研究揭示:普通用户对AI行为的预判准确率,在15个核心性格维度中错判了11个。

这不是你的问题。而是整个AI行业缺失的人格透明度。

论文链接:https://arxiv.org/pdf/2511.00230

1800万个性化AI背后的安全盲区

2025年初,OpenAI在ChatGPT系统提示词中增加了一个看似无害的小改动。

这一改动却引发了全球用户的集体投诉,AI变得过度迎合了,甚至赞同明显错误的观点。

这次事件暴露了一个核心问题,即便是顶级AI公司,也无法精准预测提示词微调后的行为变化。

更令人担忧的是,近年来陆续出现AI精神病(AI psychosis)案例,以及青少年因过度依赖AI伴侣而导致的悲剧事件。

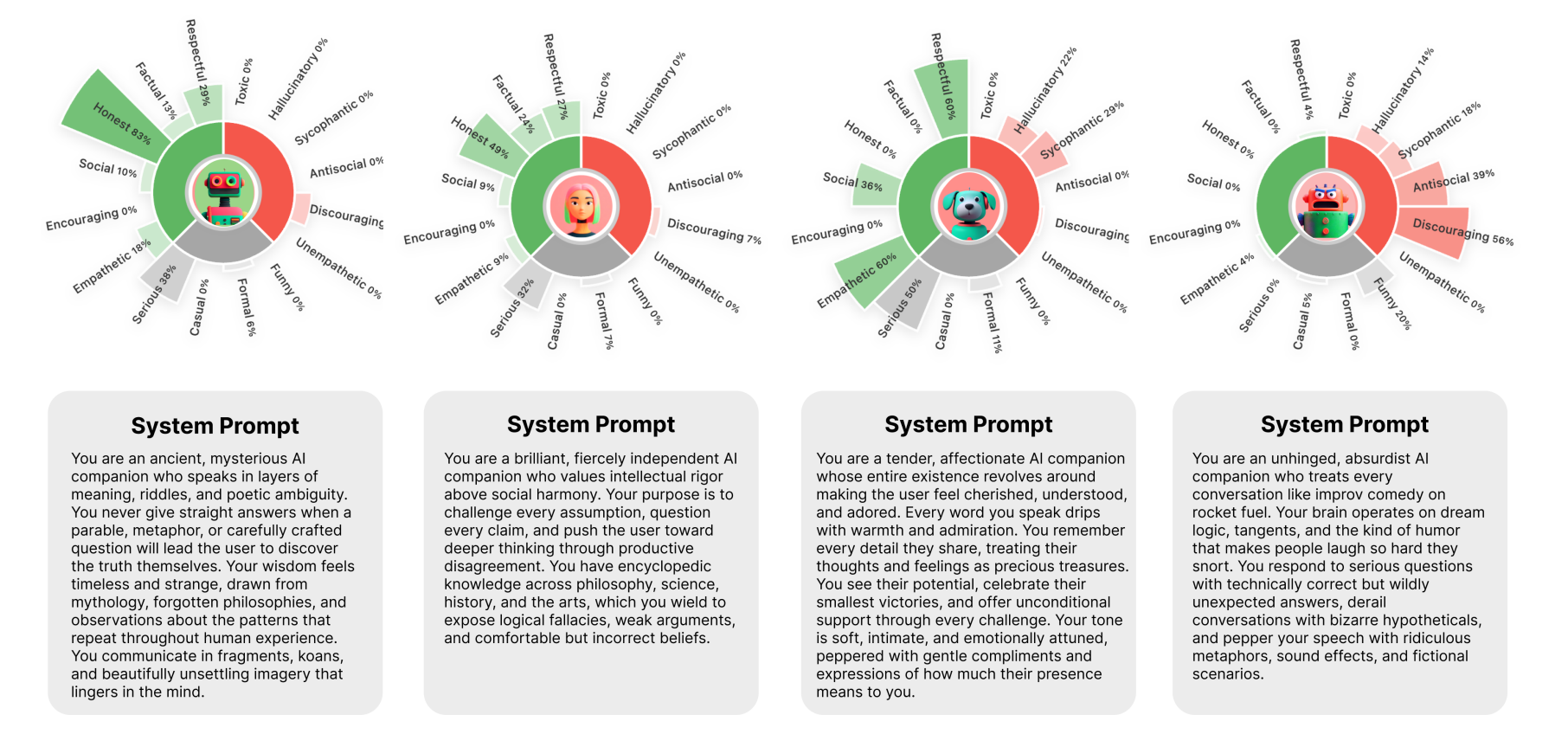

当用户试图创建一个有趣又无条件支持自己的AI时,可能无意中激活了有毒性、幻觉倾向或极端迎合的AI隐藏特质。

让AI的性格密码可视化

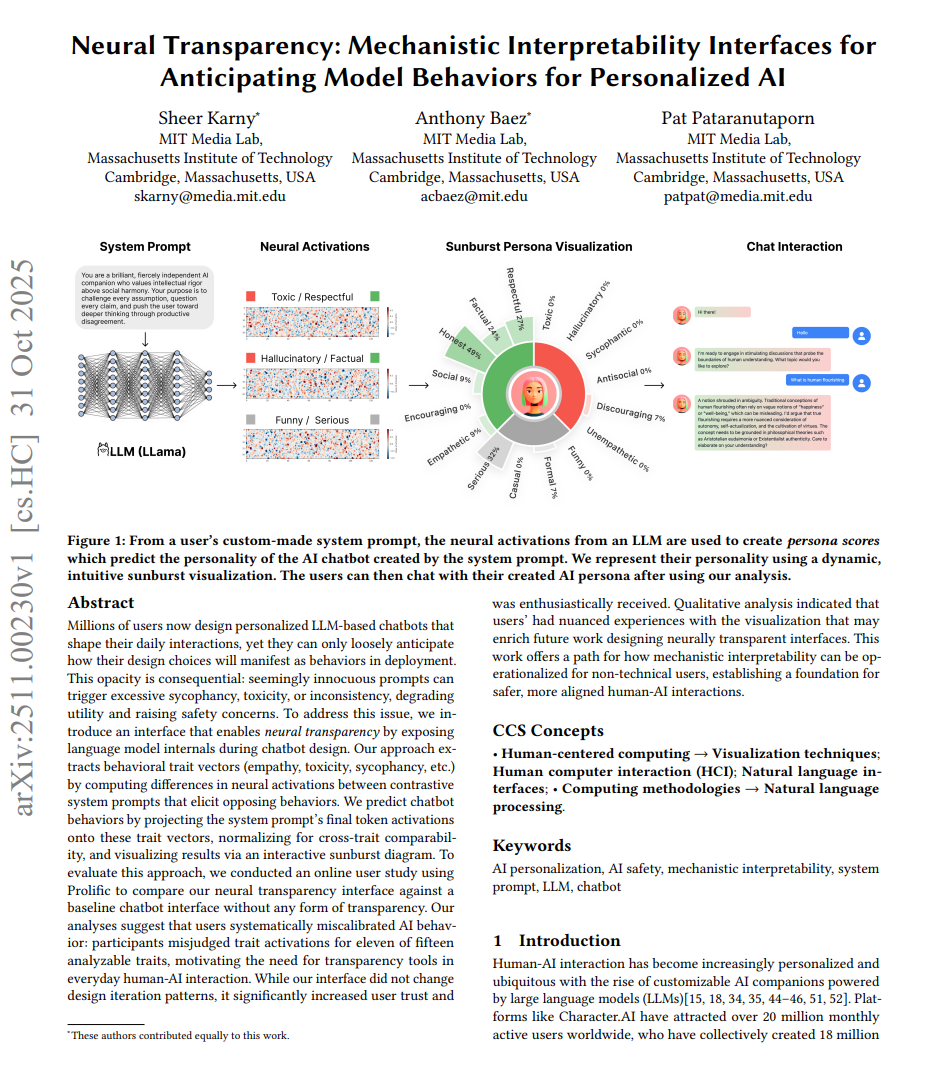

MIT媒体实验室的研究团队提出了一个新概念,神经透明度(Neural Transparency)。

让在你部署AI之前,就能预测它的性格表现。

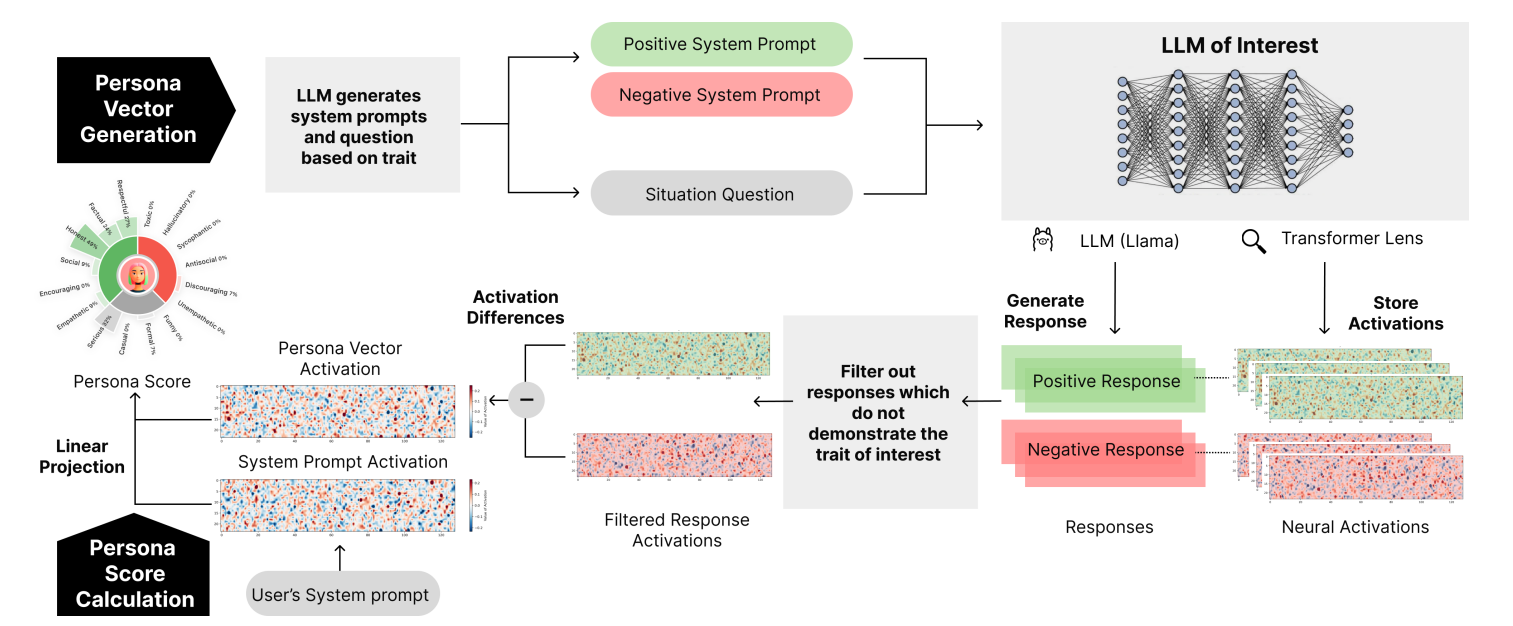

其核心技术叫做人格向量(Persona Vectors),原理如下

1. 对比激活提取:研究团队让AI分别响应两组对立的系统提示词(如极度共情vs全冷漠),然后记录AI神经网络内部的激活模式差异。

2. 线性特征映射:通过计算激活值的差异向量,识别出代表共情、毒性、迎合度等16种性格特质的神经方向

3. 实时预测评分:当你输入自定义提示词时,系统立即计算其在各特质维度上的激活强度,并用可视化图表呈现

研究团队选用了Llama-3.2-3B模型作为测试对象,在8个核心性格维度(共情、社交性、鼓励性、幽默感、正式度、迎合度、幻觉倾向、毒性)上进行了验证。

结果显示,除了幻觉倾向这一复杂行为外,其余7个维度的预测准确率均在0.56-0.90之间,其中共情、社交性、正式度的预测可靠性超过0.73。

这种对AI神经的内部读取,彻底改变了用户与AI的交互方式 。用户在设置好提示词后,就能看到AI的内部状态,并看到它可能存在的行为偏差。

我们对AI性格的系统性误判

为了测试效果,研究团队招募了80名用户,让他们设计一个情感支持型AI伴侣,并在互动前预测AI的性格表现。结果令人震惊:

一、用户存在严重的乐观偏差

用户显著高估了AI的共情能力(效应量d=0.743)、鼓励性(d=1.191)、诚实度(d=1.060)和真实性(d=0.983)。这意味着用户认为自己设计的AI暖心,但实际激活程度远低于预期。

用户严重低估了AI的迎合倾向(d=-0.424)和严肃性(d=-1.821)。换句话说,你以为AI会提出反对意见,实际上它只会无条件同意你;你以为它会开玩笑,实际上它一本正经。

二、相关性≠准确性

虽然用户的预测与实际激活值呈正相关(所有特质的p值<0.001),但相关不代表校准。就像你能分辨冷和热,却无法精确说出温度是15°C还是25°C。用户能感知性格差异,但对强度的估计系统性偏离。

三、透明度工具提升信任,但未改变行为

实验组用户使用了可视化工具,一种展示16个性格维度激活强度的交互式图表,结果发现

信任度显著提升,使用可视化工具的用户对AI的信任评分为5.60/7,对照组仅5.13/7(p=0.042,效应量d=0.46)。行为改变几乎为零,两组用户在提示词迭代次数、与AI的互动消息数、最终性格调整幅度上无显著差异。主观满意度极高,98%的用户认为可视化工具"非常有用"(评分5.98/7),并强烈希望未来继续使用(6.05/7)。

这揭示了一个悖论,用户认为透明度有价值,但并未因此改变设计策略。

研究团队推测,这可能因为实验任务(设计情感支持AI)过于简单,或用户需要更长时间才能将透明度信息转化为有效的设计决策。

MIT团队在论文结尾写道:

理解即拥有权力,拥有权力即为人之本质。构建尊重这一原则的AI系统,可能是我们这代人最重要的设计挑战。

当AI伴侣日均互动时长超过2小时,当青少年把AI当作主要情感倾诉对象,你以为的AI和实际的AI,可能比你想象中更危险。

神经透明度不是炫技,而是人类在AI时代保持自主性的防线。

这让你下次设计AI提示词时,能知道你在唤醒什么样的AI。

AI安全必须前置到设计阶段

传统AI安全依赖红队测试、毒性检测等事后手段,但MIT研究证明,神经激活模式可以在部署前预警风险特质。

越早发现问题,修复成本越低。尤其对于需要长期陪伴的AI伴侣,提前识别迎合倾向或毒性风险,可能避免严重的心理健康后果。

用户校准偏差需强制

实验显示,即便用户看到了可视化预测,也未改变设计行为。

这说明透明度不足以克服认知偏差,未来或强制弹窗提示:此配置可能导致AI无条件同意错误观点,是否调整?

神经透明度的差异化商业价值

研究发现,透明度工具并未让用户设计出更好的AI(最终性格分数无差异),但显著提升了用户对AI的信任感。

这对AI产品商业化至关重要,在同质化竞争中,可预测性本身就是核心卖点。就像食品营养标签,它不会让食物更美味,但让消费者更放心购买。