AI+混合现实:让新人医生看见腹腔镜手术盲区

长久以来,腹腔镜手术因其微创优势成为临床主流,但对手术医生而言,赖以操作的单目2D内窥镜画面,却是空间感知和深度判断的最大障碍”。

这种2D平面化的视野不仅徒增新手认知负荷,更易导致操作失误,危及患者安全 。

如今,一项来自佛罗里达大学的AI研究,结合MR(混合现实)技术与正AI,一举攻克腹腔镜手术空间意识培养的核心难题,让新手外科医生更好上手。

论文链接:https://arxiv.org/pdf/2511.02233

2D视野下的手术盲区

微创外科手术因创伤小、恢复快成为临床标准,但其核心限制一直是空间感缺失。

医生仅能通过单镜头视频判断器械与组织的距离与角度。

这种二维视觉迫使他们在脑中构建三维模型,不仅增加认知负担,也常导致切割偏位、夹取空位或损伤周边组织。

传统训练方式使用录像学习或实体模型操作,要么成本高,要么无法提供实时空间反馈。

即便是近年来流行的VR训练,也往往将学员完全沉浸于虚拟世界,忽略了与真实操作视角的同步性。

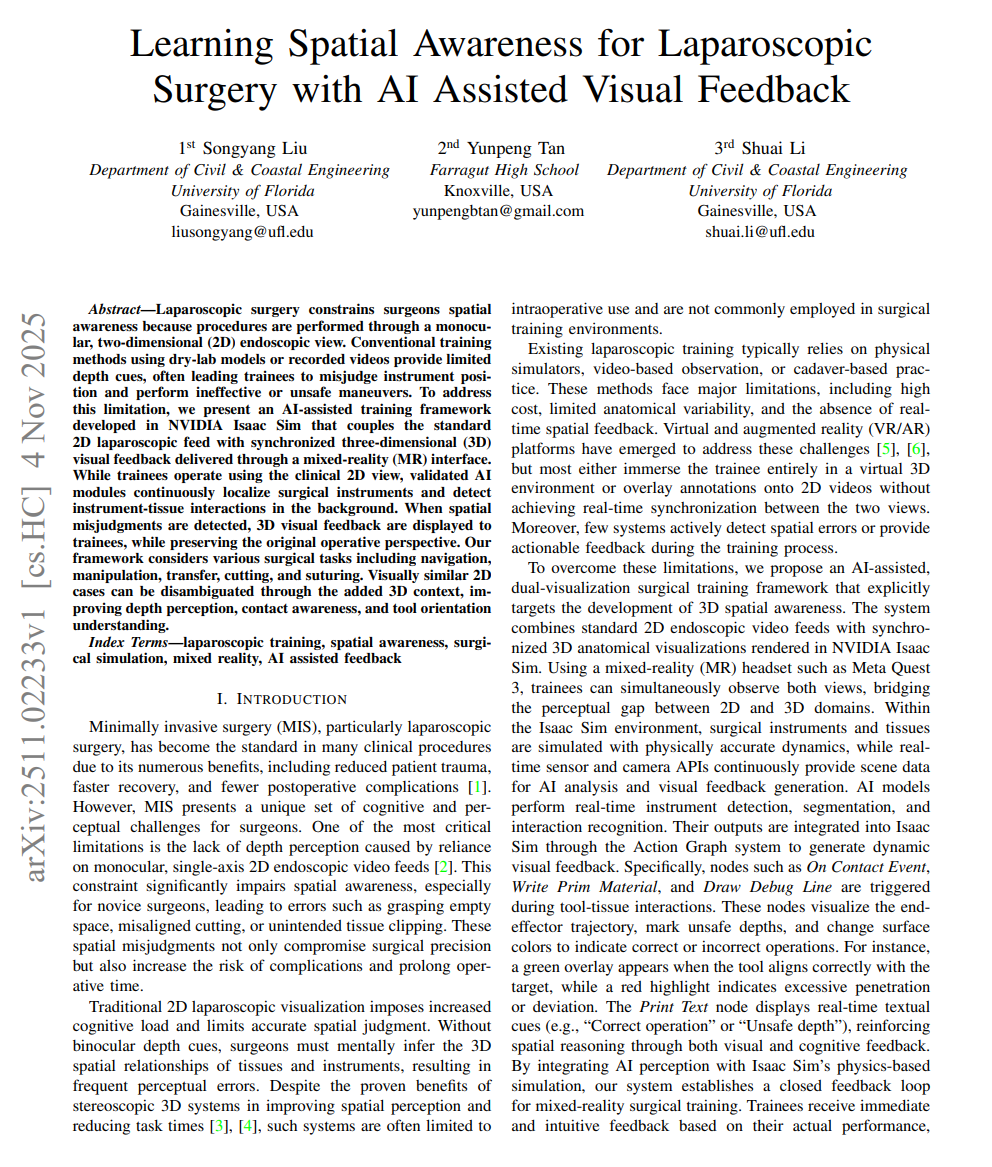

AI+MR的双视图闭环

佛罗里达大学团队提出的解决方案核心在于保持临床2D操作视角不变,叠加AI生成的3D混合现实。

该系统巧妙的结合了标准的2D内窥镜视频和在NVIDIA Isaac Sim中渲染的同步3D解剖可视化 。

MR硬件与环境:训练者佩戴Meta Quest 3等MR头戴设备,在模拟真实手术室的环境中进行操作 。

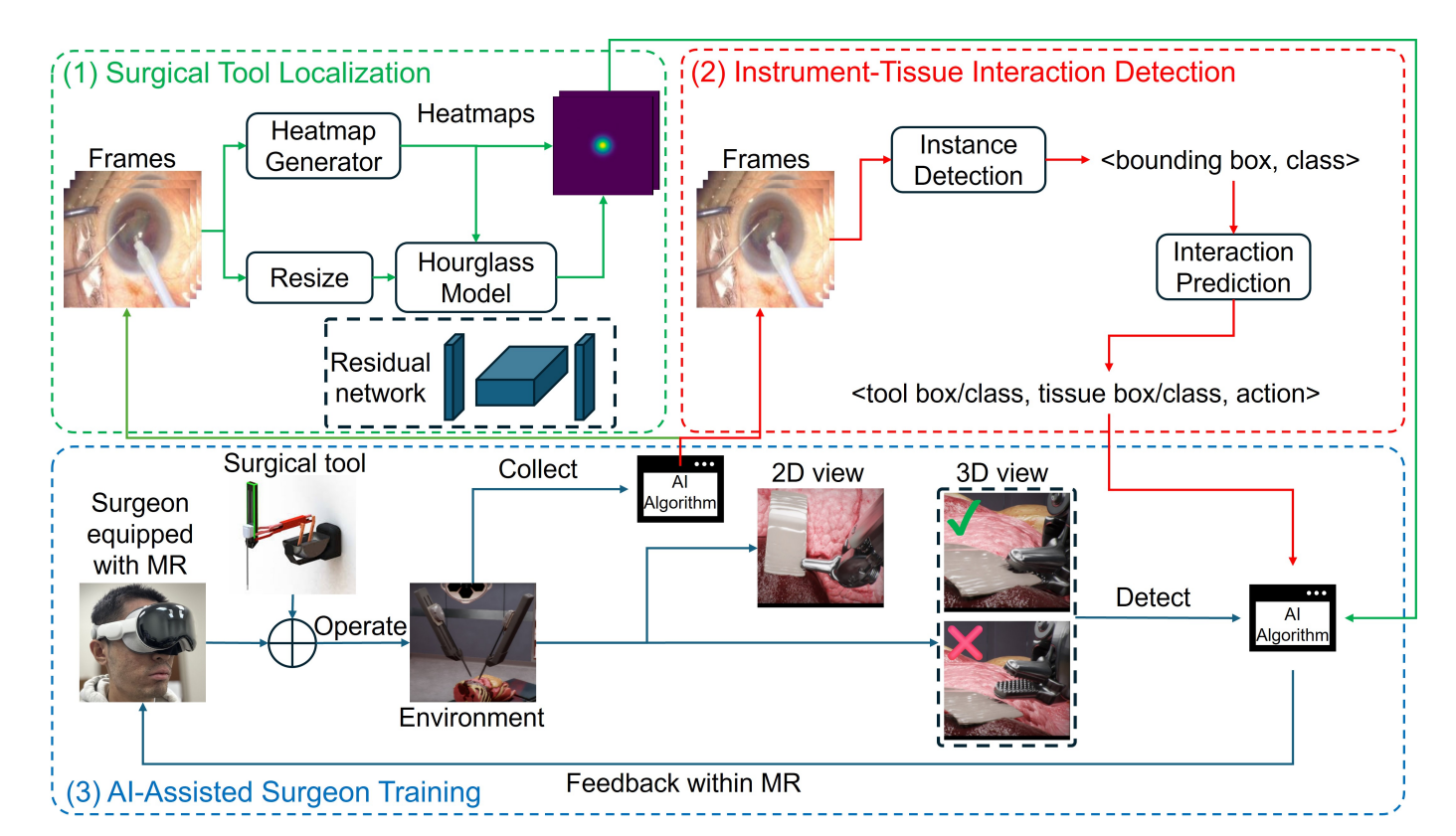

AI感知模块:通过Hourglass架构定位手术器械尖端位置,实现对器械的稳定实时追踪 ;同时也采用ITID-Net框架,识别器械和组织的交互状态。

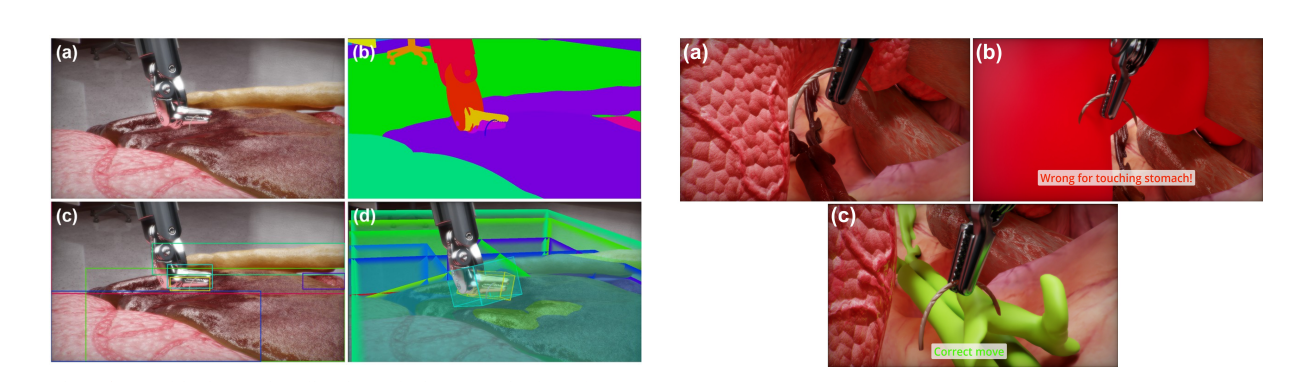

实时反馈:AI的分析结果被送入Isaac Sim的Action Graph系统,这是一个基于物理引擎的反馈机制 。当AI检测到潜在的空间错误或不安全操作时,系统会即时生成多模态3D视觉线索,但同时保留原始2D内窥镜视图作为主要操作参考。

这种AI驱动的闭环反馈机制,将传统的被动训练转化为交互式、感知丰富的学习体验,从而有效增强深度意识、空间推理和手眼协调能力 。

覆盖五大关键手术任务

该框架的应用涵盖了腹腔镜手术的五大基础任务(导航 、物体操作、物体转移、切割、缝合),并针对性地提供了3D空间校准。

以切割任务为例,在2D内窥镜画面中,正确执行(工具接触目标)和错误执行(工具切割空气)的画面可能几乎相同,导致新手难以判断深度 。

但通过同步的3D场景,系统能即时揭示工具与目标的真实空间关系,明确指示是否在切割空气,极大地消除了深度模糊性 。

这一机制使手术训练从被动模仿变为交互学习,让机器实时指出你错在哪。

且每个操作动作都被AI记录、评估并即时反馈,从而实现无需导师即可进行个性化、数据驱动的外科训练。

更重要的是,这种反馈模式为AI手术助理的发展提供了现实路径,未来,AI不仅能教医生,更能在手术台上提醒医生。

2D操作+3D思考

这套系统让训练者在保持临床真实2D视野进行操作的同时,通过即时的3D MR视觉提示校准。

这种设计避免了完全沉浸于3D环境带来的操作不适,同时又解决了2D视觉带来的空间盲区。

实时的纠错性反馈和VR训练的事后评估相比,极大的缩短了技能学习周期。

AI辅助的MR双重视野训练框架,代表了腹腔镜手术教育的未来方向。

虽然该系统目前仍处于受控模拟环境 ,但其展示出的潜力,预示着一个更加安全、高效、标准化的手术技能学习方案。