读心术?AI已能将脑电波转化为句子

想象一下,有一天你不再需要说话,只要需要“想”,屏幕上就能自动生成一句完整的文字描述你脑中的画面。

这不是科幻情节。

过去几年,研究人员利用大脑活动预测人们看到或听到的内容已取得进展 。

而现在,研究人员已成功创造出一种名为思维字幕(Mind-captioning)的AI技术,它突破了以往只能识别关键词的局限。

它能以前所未有的细节,将大脑活动(精准解码成具有完整语境和描述性的句子 ,复现人所看到或想象的场景。

思维字幕技术:AI听懂了你的脑海

过去十年,脑机接口领域不断突破,但几乎所有模型都停留在关键词层面,它们能识别猫、跳等标签,却无法理解事件语义。

而这项来自多个实验室的联合研究,首次让AI实现了质变,能从脑电信号中生成完整、连贯、有语法结构的句子。

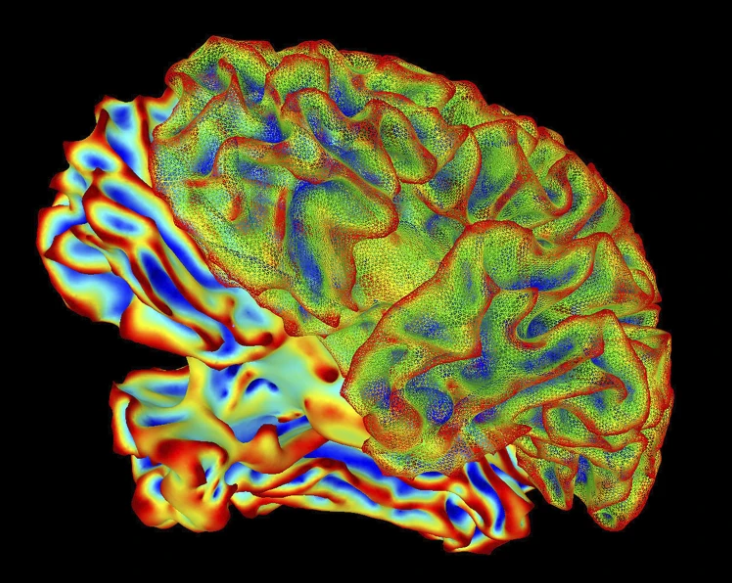

思维字幕技术利用了语言模型和功能性磁共振成像(fMRI)。

1. 首先,研究团队收集了2000多段视频及其文字描述,并用大型语言模型将每段文字转化为独特的语义向量;

2. 同时,他们通过功能性磁共振成像记录了6名志愿者在观看视频时的脑活动信号;

3. 之后,让AI学习两者的对应关系,大脑哪个区域激活,意味着哪种语义模式;

4. 最后,当被试再次观看或回忆视频时,AI可直接从脑活动中预测语义向量,再由文本生成模型将其翻译为自然语言。

举例来说,当受试者观看一段有人从瀑布上跳下的视频时,A能I从脑信号中逐步推断出:

spring flow → above rapid falling water fall → a person jumps over a deep water fall on a mountain ridge

这意味着AI不仅识别图像,更理解语境,它能知道“谁在做什么”,而非仅仅看到水、跳跃这样的关键词。

大脑语义被揭示:看与想其实是同一语言系统

更令人震惊的是,当受试者仅回忆视频内容时,AI依然能够生成相似的描述。

也就是说,大脑在观看与想象时激活的语义网络几乎相同。

这意味着人脑在语言形成之前,就已经以语义向量的方式编码世界。

研究团队认为,这种语义层级的脑信号可能是未来无声沟通的关键,即直接将大脑意图翻译为语言,而无需经过发声、书写等外部环节。

但同时这一技术也存在伦理问题。

当前模型虽然无法读取私人想法,但它证明了思维可译这一科学命题是成立的。

当AI具备读取语义层面的能力后,心理隐私也将成为下一个全球监管议题。

正如伯克利大学计算神经科学家Alex Huth所言:

我们离能读懂人的内心还有距离,但我们已确知——那是一条可以被技术抵达的路。

这一成功为未来的植入式BCI系统指明了技术路线

当前主流的BCI研究大多关注植入式电极以获取高带宽信号,但其风险和成本极高。

该研究表明,利用非侵入式的功能性磁共振成像结合AI进行语言解码,同样能实现高精度的描述性文本输出。

这一技术最直接的应用,是帮助那些失语或中风患者重新沟通。

这意味着他们无需承受手术风险,就能在未来重获复杂、完整的沟通能力。

此外,这些技术虽然不能辨别和翻译私人思想或情感 ,但定义了一个新的“感知-认知”研究范式。

通过将大脑活动直接与语言模型的关联,科学家可以获得关于大脑在将概念转化为语言之前的表征方式的线索 。

这不仅能帮助神经科学家理解人类感知和想象的运作机制 ,还能以数字化的方式量化和比较不同个体对同一事件的心智表征差异,从而推动心理学、认知科学和神经语言学的交叉研究进入一个数据驱动的新阶段。