AI+视觉大模型:动动嘴指挥机器人组装零件

在互联网,从文本到图片、文本到视频的生成式AI已席卷一切,我们还在庆幸没有影响物理世界时,改变悄然发生。

当你说出:给我做把椅子。AI不仅能生成3D模型,还能指挥机器人用结构午间与面板组装出实物。

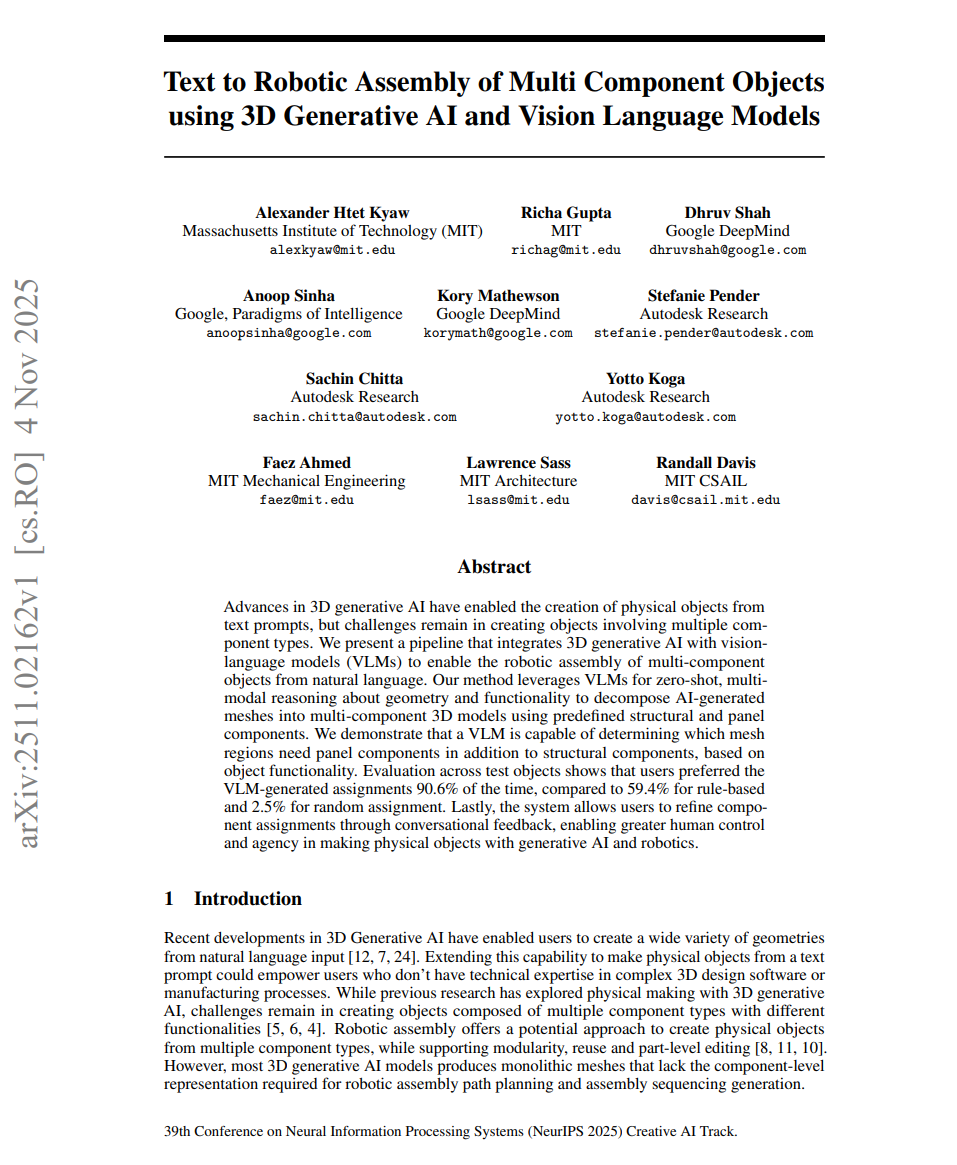

这不是钢铁侠电影,是MIT与谷歌团队的最新研究,从文本到多组件物体机器人装配的端到端流程。

这项技术使得用户只需用语言描述一个多组件对象,机器人就能自主设计、分解并完成物理装配,个性化制造时代的正式来临。

论文链接:https://arxiv.org/pdf/2511.02162

VLM的技术破局

传统3D打印虽能快速成型,却难以处理多组件、多功能的复杂物体。

机器人装配虽灵活,却依赖精密编程与组件预设,门槛极高。

MIT、Google DeepMind与Autodesk的联合团队提出了一个融合3D生成式AI与视觉语言模型(VLM) 的端到端系统。

系统的核心创新在于引入视觉语言模型Google Gemini 2.5 Pro进行零样本的多模态推理。整个过程分为三步:

1. 功能感知部件选择,VLM根据用户文本(如“做一把椅子”)和生成网格的轴测图,判断物体哪些部分需要面板组件(Panel Component)。例如,椅子需要面板在座面和靠背,而灯则需要面板在灯罩。

2. 几何感知标签映射,系统将网格面片标注编号,VLM再将功能部件映射回具体面片标签,确保机器人可定位装配。

3. 人机对话式校准,用户可通过自然语言反馈(如“我只想在座面上加面板”)即时调整组件分配,VLM能理解意图并更新装配方案。

实验数据显示,在32名参与者对五类物体的评估中,VLM生成的组件分配方案获得了90.6%的用户偏好,远高于基于规则的方法(59.4%)和随机分配(2.5%)。

人机协同

该系统的另一大价值在于支持对话式反馈。

用户常常提出不同于AI初始方案的个性化分配方式,例如只为灯罩加面板或只保留书架底下两层的面板。

AI生成基础方案,用户再个性化调整,这正是人机协同创作的趋势。

通过自然语言进行实时校准,不仅降低了专业门槛,也让非专业用户拥有了前所未有的设计主导权。

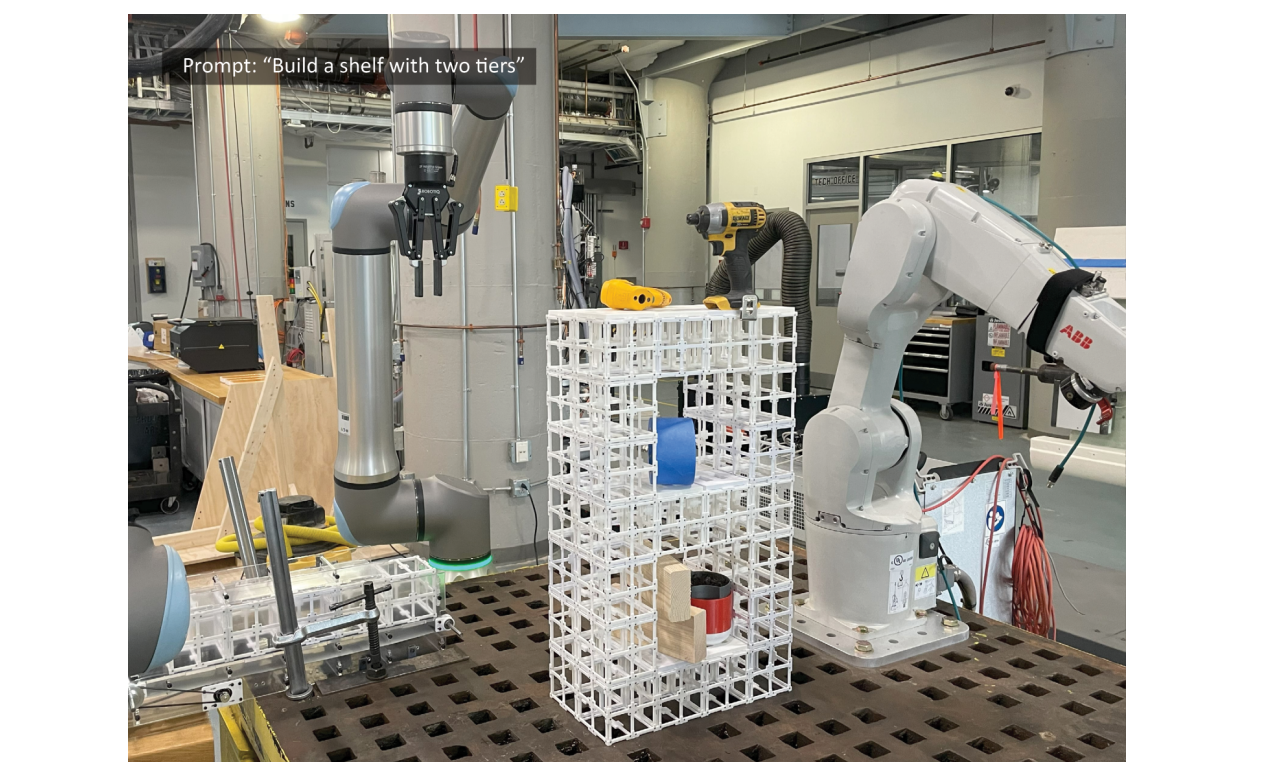

该系统构建了一个完整的制造闭环

输入:自然语言描述

生成:Autodesk 3D生成AI产出网格

分解:VLM进行功能与几何感知的组件分配

装配:UR20机器人臂按坐标与组件类型列表执行抓取与放置

整个流程在标准台式机上运行,也证明了该框架在轻量化部署上的可行性,端到端“文本-模型-机器人”流程已具备落地基础

VLM已成为软件到硬件转换的关键

VLM的零样本多模态推理能力,使其能依据物体功能(如承重、遮光、储物)动态分配组件类型。

未来,VLM的训练重点将从通用知识转向集成更丰富的工业设计和装配知识图谱,从而在分解时不仅考虑几何匹配,更考虑力学稳定性、材料兼容性和组装序列的优化。

同时,传统的自动化生产线在面对单件定制时,其换线成本和编程时间让人望而止步。

而AI+VLM的系统彻底消除了对预编程和CAD模型的依赖,非常适合高利润、极度个性化的产品领域,如定制家具、医疗辅助设备,为智能制造提供提供了基础支持。