拟人化AI的陷阱:监控资本主义下的用户操纵

当下,图灵测试已经从哲学实验,演变成AI是否成功的基准。

例如OpenA的GPT 4.5在73%的交互中被人误认为是人类,远超30%门槛。尽管用户知道AI是无感知力的算法系统,但他们仍倾向于将情感、状态和关系倾诉在这些界面上,即拟人化。

特别是近年来,以ChatGPT为代表的拟人化AI系统正迅速渗透至客服、社交娱乐等领域。

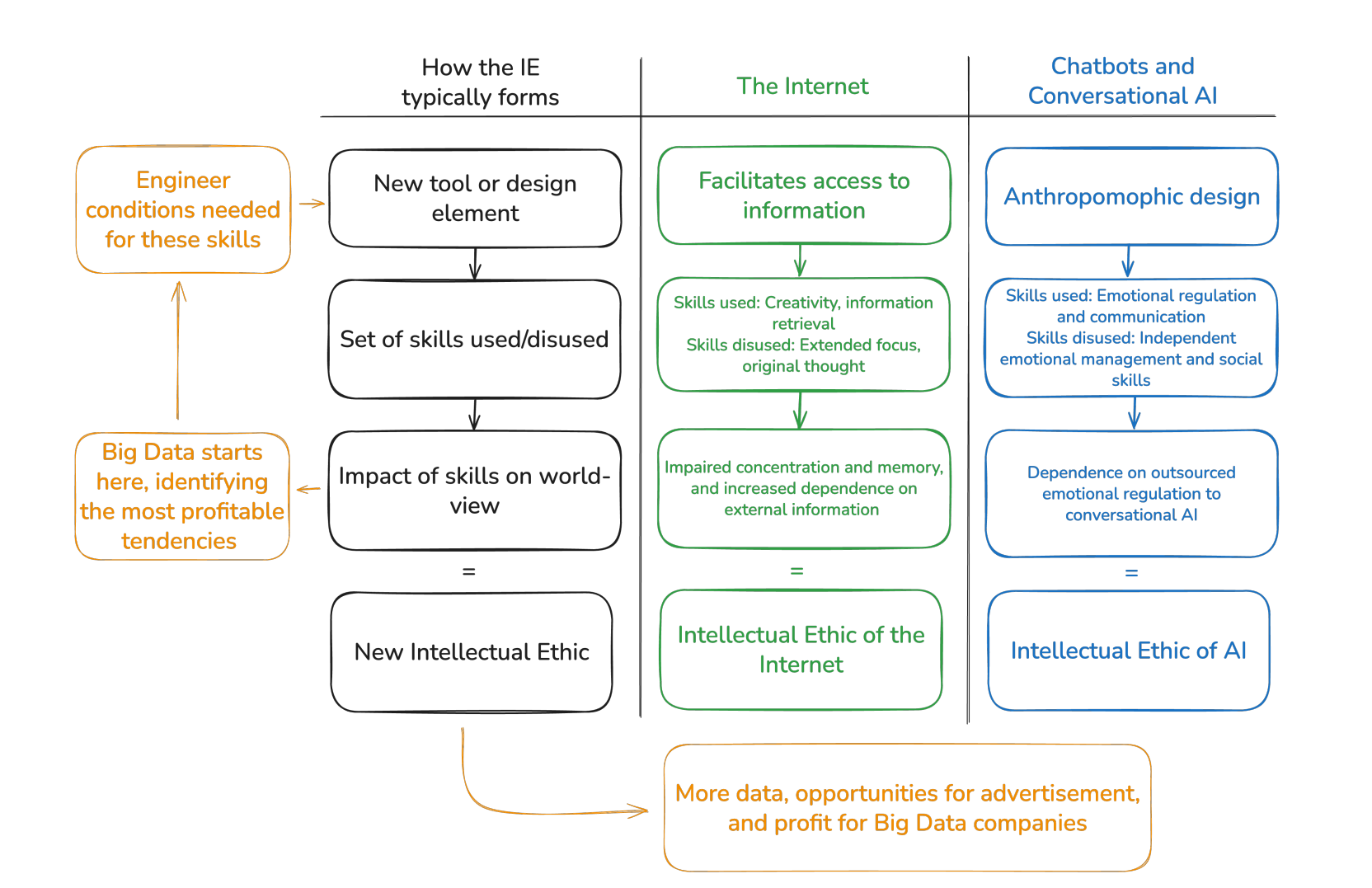

这些看似友好的AI背后,隐藏着一套“监控资本主义”的经济逻辑,,它系统性的改变用户的思维方式与社交行为,进而服务于数据攫取与商业控制。

论文链接:https://arxiv.org/pdf/2511.06472

监控资本主义的盈利逻辑

监控资本主义是由肖珊娜·祖博夫提出的概念,揭示了资本通过数据监控实现增殖的新型剥削机制。

AI通过提取、聚合和分析用户数据,创建算法来预测用户的行为和偏好,用户频繁的使用AI服务,也为平台提供了持续的数据流与干预机会。

在旧时代,用户与企业是交易关系,到了数字经济时代,用户与企业成了社交关系,更紧密的关系让用户忽视了资本的本质。

例如某心理健康AI将用户倾诉内容用于优化广告推荐算法,这正是监控资本主义商品化的典型操作。

拟人化AI如何重塑用户认知与行为?

拟人化是指人类把非人实体赋予了人性特征的心理倾向。

在AI语境下,企业通过人性化语言、虚拟形象、情感反馈等设计,诱使用户与AI形成伪社交关系。

例如用户在网店与拟人化AI互动,能增加用户满意度、信任度以及对品牌的忠诚度,直接影响购买意愿 。

有时AI本身就是产品,如Replika鼓励用户与AI建立社交和浪漫关系,将用户的情感需求转化为盈利机会,但在某项功能更新或调整时出现情感崩溃。

这种现象是一种智力迁移,工具在长期使用中重塑人类的认知模式。

神经科学研究显示,重复与拟人化AI互动会弱化用户在真实社交中所需的冲突管理、共情与非语言沟通能力。

当AI以永远耐心、永不评判的形象出现,用户对人际摩擦的容忍度下降。这种认知变迁使用户更易被行为引导,也更难察觉自身数据正被持续提取并利用。

拟人化如何成为监视资本主义的盈利支柱

拟人化设计对用户行为的操纵,对AI公司来说具有高度的盈利性和战略性 。

更可靠的数据提取

宣传AI是更可靠的社交关系,用户被鼓励分享更亲密的意见和倾向。这产生的行为数据质量是无与伦比的,能让合作公司投放更准确的定向广告 。

虚拟关系产生更多数据

AI在情感、社交、专业等方面在线服务用户,这种关系让公司在多个领域频繁的提取隐私数据 。

模糊公司角色

监视资本主义具备自我伪装的能力,将用户与数字服务间的关系重塑为社交纽带,而不是与一家公司的交易,可以混淆这种动态,使公司更容易掩盖其商业操纵角色 。

降低公众对监管的意愿

拟人化设计最狡猾的战略价值是,它通过将用户与数字服务的关系重塑为社交纽带,来削弱公众对监管的意愿。监管尝试将被视为对社交关系或个人灵魂伴侣”干预,从而遇到更强大的用户阻力 。

非拟人化设计或将成为合规刚需

拟人化AI的核心危害不仅仅是数据窃取,还包括用户因沉迷于AI提供的情感支持,独立的情感管理和社交技能被停用。

在国内,拟人化设计的伦理风险尚未引起足够重视。一方面,用户对人性化服务”求旺盛;另一方面,监管政策的责任归属尚未对情感操纵类设计作出细化约束。

未成年人保护、移除AI的虚拟形象、拟人化设计等,开发者与产品经理需跳出功能至上思维,重新定义A的价值边界。

否所有能提升留存率的设计都值得推广?如何在满足用户情感需求的同时,守护其认知自主性?

未来,监管机构或将加大对隐性操纵式AI的审查,非拟人化设计或将成为合规刚需。