LLM画表总翻车?GPT-Vis+MCP:AI可视化的终极解药

一、扎心真相:让LLM画表,比写Bug还难

在AI数据分析平台开发中,“让LLM生成可交互图表”是高频需求,但传统方案全是坑,开发者直呼“不如自己写”。

1. 5大痛点,把开发者逼疯

● ❌ Prompt工程地狱:为了让AI懂图表库API,得把成百上千行文档塞进提示词,改一次需求就要重写;

● ❌ 幻觉症晚期:经常“发明”不存在的配置项(比如给ECharts加“legend.show”属性),数据结构更是错漏百出;

● ❌ 版本维护灾难:图表库一更新,旧的Prompt全失效,得挨个排查调整;

● ❌ 格式混乱:同样画折线图,每次返回的JSON字段都不一样,光容错代码就要写半屏;

● ❌ 调试无门:配置报错时,根本分不清是AI瞎编还是逻辑问题,排错能花一下午。

2. 典型翻车现场:AI的“迷惑配置”

用户需求:“帮我画一个折线图”

LLM返回的错误配置(标红为问题):

{

"chartType": "line", // ❌ 正确字段是"type"

"data": [...],

"options": {

"xAxis": { "type": "category" }, // ✅ 正确

"yAxis": { "type": "value" }, // ✅ 正确

"legend": { "show": true }, // ❌ 该图表库无此属性

"tooltip": { "enabled": true } // ❌ 正确字段是"show"

}

}

核心矛盾:LLM擅长“理解语义”,但不擅长“记住规范”。要解决问题,得让专业工具做专业事——这就是GPT-Vis+MCP的核心思路。

二、方案拆解:GPT-Vis+MCP,怎么根治“画表翻车”?

这套方案的逻辑很简单:用MCP Server当“AI的图表配置管家”,确保输出100%合规;用GPT-Vis当“专业渲染引擎”,把配置秒变可交互图表。两者配合,从源头杜绝幻觉。

1. 核心架构:两大组件各司其职

就像餐厅里“配菜师+厨师”的组合,MCP负责把“食材”(数据)按规范备好,GPT-Vis负责把“食材”做成“大餐”(图表)。

▶ MCP Server Chart:AI的“图表配置专家”

基于Model Context Protocol(MCP)开放标准,专门给LLM输出符合规范的图表配置,相当于给AI装了“配置校验器”。

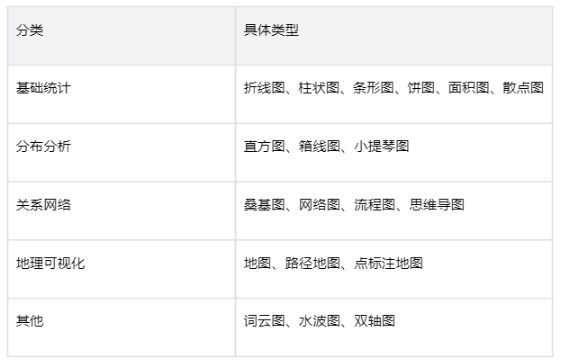

支持的图表类型(覆盖90%业务场景):

标准化输出格式(_meta.spec字段可直接给GPT-Vis使用):

interface MCPResponse {

content: Array<{

type: "text";

text: string; // 静态图表预览URL

}>;

_meta?: {

description: string; // 图表描述

spec: { // 核心配置(GPT-Vis可直接解析)

type: string; // 图表类型

data: Array<any>; // 图表数据

encode?: object; // 字段映射

[key: string]: any; // 其他合规配置

};

};

}

▶ GPT-Vis:Markdown里的“可视化引擎”

蚂蚁集团AntV团队开发的组件库,专为LLM生成的可视化内容设计,能直接解析MCP输出的配置,秒变可交互图表。

核心优势:

● 📝 支持Markdown语法:用```vis-chart包裹配置即可,不用写复杂组件;

● 🎨 基于AntV生态:复用G2、G6、L7等成熟图表能力,样式专业;

● 🔄 实时流式渲染:LLM输出配置时,图表会逐步生成,不用等全量数据。

2. 完整数据流:从“用户需求”到“可交互图表”

1. 📥 用户输入:“帮我生成2019-2023年销售额变化折线图”;

2. 🔧 LLM调用工具:通过Function Calling触发MCP服务,传入数据和需求;

{

"name": "generate_line_chart",

"arguments": {

"description": "2019-2023年销售额变化折线图",

"data": [{"time": "2019", "value": 100}, ...]

}

}

3. ✅ MCP返回合规配置:输出包含标准化spec字段的响应;

4. 📝 生成Markdown:提取spec字段,用vis-chart语法包裹;

```vis-chart

{

"type": "line",

"data": [{"time": "2019", "value": 100}, ...]

}

```

5. 🎨 GPT-Vis渲染:前端组件解析Markdown,生成可交互图表。

import { GPTVis } from '@antv/gpt-vis';

<GPTVis>{markdownContent}</GPTVis>

三、快速上手:10分钟跑通第一个AI图表

不管是本地体验还是集成到项目,步骤都极简——以下以Node.js环境为例。

1. 本地Playground体验(零基础可试)

Step 1:环境准备

系统要求:Node.js ≥ 18.0.0,支持pnpm/npm/yarn

# 克隆项目

git clone https://github.com/your-org/mcp-server-chart.git

cd mcp-server-chart

# 安装依赖

pnpm install

pnpm build

# 启动MCP Server(SSE模式,端口1122)

node build/index.js -t sse -p 1122

服务启动后,访问 http://localhost:1122/sse 确认正常运行。

Step 2:配置并启动前端Demo

# 进入前端目录

cd playground

pnpm install

创建 .env 文件,配置AI密钥(支持阿里云百炼/OpenAI):

# 阿里云百炼(推荐)

VITE_OPENAI_API_KEY=sk-your-bailian-api-key

VITE_OPENAI_BASE_URL=https://dashscope.aliyuncs.com/compatible-mode/v1

VITE_OPENAI_MODEL=qwen-plus

# 或OpenAI

# VITE_OPENAI_API_KEY=sk-your-openai-key

# VITE_OPENAI_BASE_URL=https://api.openai.com/v1

# VITE_OPENAI_MODEL=gpt-4

2. 集成到AI项目(开发必备)

Step 1:后端连接MCP服务

import { SSEClientTransport } from "@modelcontextprotocol/sdk/client/sse.js";

// MCP服务地址

const url = "http://localhost:1122/sse";

const transport = new SSEClientTransport(new URL(url), {});

const client = new Client(

{ name: "your-project", version: "1.0.0" },

{ capabilities: {} }

);

// 连接服务并调用工具

await client.connect(transport);

const spec = {

type: "line",

data: [

{ time: "2020", value: 100 },

{ time: "2021", value: 120 },

// ...更多数据

],

};

// 调用图表生成工具

const res = await client.callTool({

name: "generate_line_chart",

arguments: spec,

});

// 提取标准化配置(res._meta.spec)

Step 2:前端用GPT-Vis渲染

import { GPTVis } from '@antv/gpt-vis';

// 构造Markdown内容(包含res._meta.spec)

const markdownContent = `# 销售额趋势图

\`\`\`vis-chart

{

"type": "line",

"data": [{"time": "2020", "value": 100}, ...]

}

\`\`\``;

// 渲染组件

export default () => {

return <GPTVis>{markdownContent}</GPTVis>;

};

四、方案对比:为什么GPT-Vis+MCP是企业级首选?

不同场景该选什么方案?一张表说清:

五、总结:重新定义LLM可视化的标准

GPT-Vis+MCP的核心创新,是把“LLM的语义理解能力”和“专业工具的规范能力”做了最优结合——让LLM负责“听懂需求”,让MCP负责“输出规范”,让GPT-Vis负责“做好展示”。

这套方案带来的不仅是“少写代码”,更是企业级应用需要的生产级可靠性:

● 📏 标准化:MCP协议确保配置全合规,版本更新无压力;

● 🛡️ 高安全:TypeScript全链路类型检查,避免运行时错误;

● 👨💻 易开发:简洁API+Markdown语法,前端同学也能快速上手;

● 🌍 强适配:支持主流AI大模型和图表库,灵活应对业务需求。

无论是构建AI驱动的数据分析平台,还是给现有应用加智能可视化功能,GPT-Vis+MCP都是目前最靠谱的选择——毕竟,让专业的工具做专业的事,才是最高效的开发逻辑。