一键运行:ModelScope让Llamafile模型开箱即用

在AI技术快速迭代的今天,部署和运行大型语言模型往往需要复杂的环境配置,这让不少开发者望而却步。最近,Mozilla开源的Llamafile项目提供了一种创新解决方案——将大型语言模型及其运行环境完整封装在单个可执行文件中。而更令人惊喜的是,ModelScope(https://www.modelscope.cn/)平台现已集成了这一特性,让开发者能够真正实现“一键运行”大模型。

一、环境准备

与传统方法不同,使用ModelScope运行Llamafile模型无需提前安装CUDA、PyTorch或其他依赖项。只需要执行一个简单的pip命令,就能完成所有准备工作:

这个命令会安装或更新ModelScope库到最新版本,为后续的模型运行打下基础。值得注意的是,这个过程在不同操作系统(Windows、Linux、macOS)上都是一致的,真正实现了跨平台的兼容性。

二、模型选择

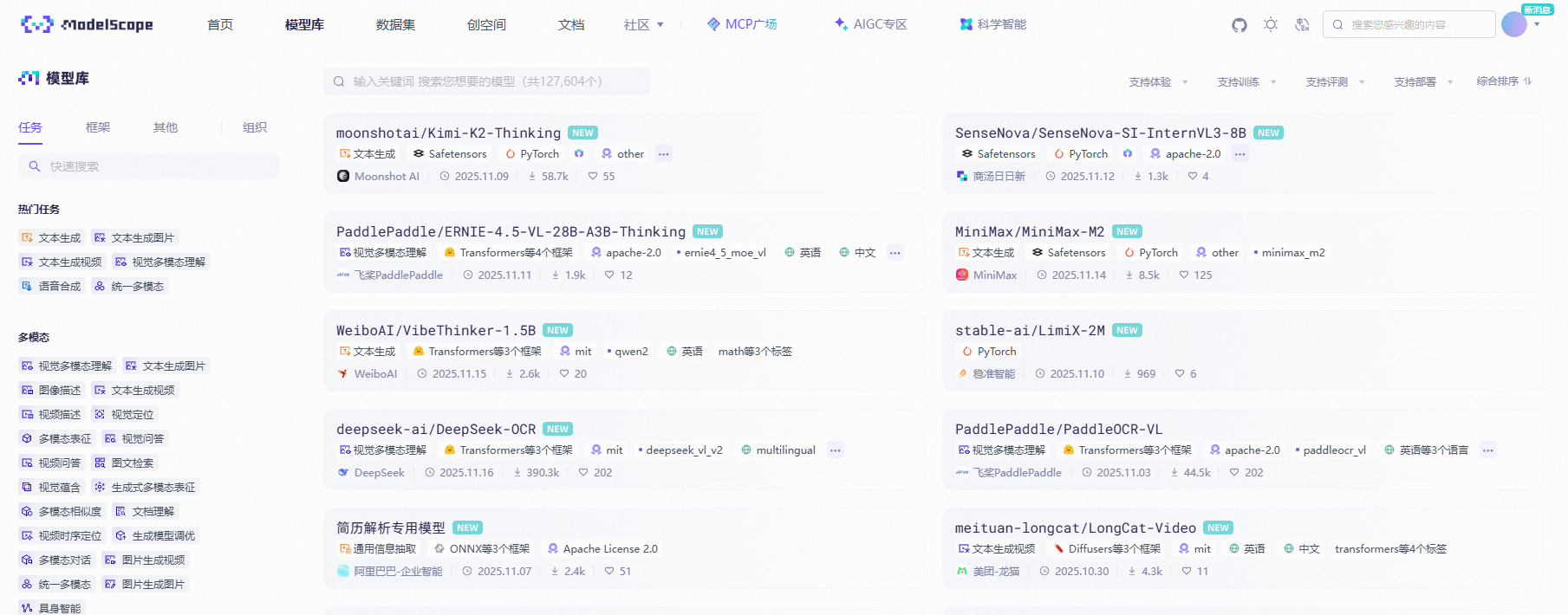

ModelScope平台目前提供了数百个Llamafile格式的大模型,覆盖了当前主流的各类模型架构。要找到这些资源,用户可以通过平台左侧的筛选功能,在“框架”选项中勾选“Llamafile”,即可快速过滤出所有可用模型。

魔塔社区模型库

对于想要直接浏览的用户,也可以通过特定链接直达Llamafile模型专页。从参数量较小的7B模型到规模更大的千亿级模型,平台都提供了对应的Llamafile版本,满足不同场景的需求。

三、实战演练

让我们以Qwen2.5-3B模型为例,演示具体的运行过程。在安装好ModelScope后,只需要在命令行中执行:

这个命令会自动完成模型的下载和启动过程。在Linux系统上,你会看到终端中显示模型加载的进度信息;在Mac笔记本上,整个过程同样流畅无阻。第一次运行时需要下载模型文件,可能会花费一些时间,但后续再次使用时就无需重复下载了。

四、可视化交互

当模型成功启动后,最令人欣喜的功能莫过于内建的WebUI界面。Llamafile底层基于成熟的llama.cpp构建,在模型运行的同时,会自动启动一个本地Web服务器。

用户只需在浏览器中访问 http://127.0.0.1:8080/ ,就能打开一个直观的聊天界面。这个界面设计简洁,支持对话历史记录,让开发者能够像使用ChatGPT一样与本地部署的模型进行交互。对于需要集成到其他应用中的场景,这个Web服务也提供了标准的API接口。

五、进阶技巧

除了基本用法,ModelScope的llamafile命令还支持多种参数配置,满足不同使用需求。例如,对于资源受限的环境,可以通过指定精度来平衡性能与资源消耗:

这种量化处理能显著降低内存占用,让大模型在消费级硬件上也能流畅运行。另外,如果模型仓库中包含多个llamafile文件,用户还可以通过--file参数直接指定要使用的文件名,实现更精细的控制。

六、应用前景

这种开箱即用的模式为AI应用开发带来了革命性的变化。对于教育领域,学生不再需要花费大量时间配置环境,可以专注于模型原理和应用的学习;对于企业部署,这种方案大大降低了运维复杂度,加速了AI能力的落地进程。

随着ModelScope平台上Llamafile模型生态的不断丰富,开发者将有更多机会体验到最新的大模型技术,而无需担心技术栈的兼容性问题。这种低门槛的使用方式,无疑将推动AI技术更快速的普及和创新。

从环境配置到一键运行,从命令行交互到可视化界面,ModelScope与Llamafile的结合为AI开发者提供了一条更加平坦的技术路径。无论你是想要快速验证模型效果,还是需要部署可靠的本地AI服务,这个方案都值得尝试。