🍋1. 引言

在机器学习中,分类问题是最常见的一类问题。无论是二分类还是多分类,解决这些问题的算法有很多,其中逻辑回归、Softmax回归和集成学习方法在实际应用中被广泛使用。但在实际数据中,类别不平衡问题可能会影响模型的效果,如何有效地解决这一问题也是一个亟待解决的难题。

🍋2. 逻辑回归

概述:逻辑回归(Logistic Regression)是一种用于二分类问题的经典线性分类器,目标是通过训练数据集的特征来预测某一类别的概率。

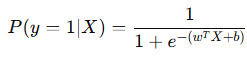

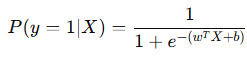

模型原理: 逻辑回归的核心是使用sigmoid函数将线性组合的输出映射到[0,1]区间,用于二分类问题:

其中,𝑤是权重,𝑏是偏置,𝑋是输入特征。

🍋代码实现

from sklearn.linear_model import LogisticRegression

from sklearn.datasets import make_classification

from sklearn.model_selection import train_test_split

from sklearn.metrics import classification_report

X, y = make_classification(n_samples=1000, n_features=20, n_informative=10, random_state=42)

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.3, random_state=42)

model = LogisticRegression()

model.fit(X_train, y_train)

y_pred = model.predict(X_test)

print(classification_report(y_test, y_pred))

优缺点:

- 优点:模型简单,计算开销小,容易解释。

- 缺点:对于非线性问题效果差,容易受到异常值影响。

🍋3. Softmax回归

概述:Softmax回归(Softmax Regression)是逻辑回归的扩展,处理多分类问题。它将输入的线性组合映射到多个类别的概率值。

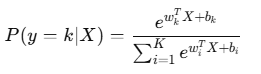

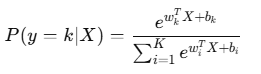

模型原理: Softmax函数是对逻辑回归的扩展,公式为:

🍋代码实现

from sklearn.linear_model import LogisticRegression

model = LogisticRegression(multi_class='multinomial', solver='lbfgs')

model.fit(X_train, y_train)

y_pred = model.predict(X_test)

print(classification_report(y_test, y_pred))

优缺点:

- 优点:可以处理多分类问题,适用于线性可分问题。

- 缺点:当类别数量很多时,计算复杂度较高。

🍋4. 集成学习

概述:集成学习是一种通过结合多个弱学习器来提高模型性能的方法。常见的集成学习方法有Bagging、Boosting和Stacking。

from sklearn.ensemble import RandomForestClassifier

rf = RandomForestClassifier(n_estimators=100)

rf.fit(X_train, y_train)

y_pred = rf.predict(X_test)

print(classification_report(y_test, y_pred))

🍋5. 类别不平衡问题

概述:在现实世界中,很多分类任务会面临类别不平衡的问题,即某一类别的样本数量远远少于其他类别。这会导致模型倾向于预测样本较多的类别,降低模型的整体性能。

解决方法:

- 重采样:通过增加少数类样本或减少多数类样本来平衡数据集。

- 加权损失函数:对模型在少数类样本上的误差给予更大的惩罚。

- 集成方法:例如SMOTE与Boosting结合来提高少数类的预测能力。

🍋代码示例(重采样)

from imblearn.over_sampling import SMOTE

smote = SMOTE()

X_res, y_res = smote.fit_resample(X_train, y_train)

model = LogisticRegression()

model.fit(X_res, y_res)

y_pred = model.predict(X_test)

print(classification_report(y_test, y_pred))

🍋6. 逻辑回归案例(Iris数据集)

我们将通过以下步骤进行分析:

- 加载数据:选择Iris数据集。

- 数据预处理:包括数据分割与标准化。

- 训练模型:使用逻辑回归训练模型。

- 评估模型:通过混淆矩阵、准确率等评估模型效果。

>Iris数据集包含150个样本,分别来自3个不同种类的鸢尾花(Setosa、Versicolor、Virginica)。每个样本有4个特征:萼片长度、萼片宽度、花瓣长度和花瓣宽度。目标是根据这些特征来预测鸢尾花的种类。arn.datasets import load_iris

from sklearn.model_selection import train_test_split

from sklearn.preprocessing import StandardScaler

from sklearn.linear_model import LogisticRegression

from sklearn.metrics import classification_report, confusion_matrix

import seaborn as sns

import matplotlib.pyplot as plt

iris = load_iris()

X = iris.data

y = iris.target

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

scaler = StandardScaler()

X_train = scaler.fit_transform(X_train)

X_test = scaler.transform(X_test)

logreg = LogisticRegression(max_iter=200)

logreg.fit(X_train, y_train)

y_pred = logreg.predict(X_test)

print("分类报告:")

print(classification_report(y_test, y_pred))

cm = confusion_matrix(y_test, y_pred)

print("混淆矩阵:")

print(cm)

sns.heatmap(cm, annot=True, fmt="d", cmap="Blues", xticklabels=iris.target_names, yticklabels=iris.target_names)

plt.xlabel('Predicted')

plt.ylabel('True')

plt.title('Confusion Matrix')

plt.show()

代码分析

1. 加载Iris数据集:

- 使用sklearn.datasets.load_iris()加载Iris数据集,数据集已经包含了4个特征和相应的类别标签。

2. 数据分割:

- 使用train_test_split将数据分割为训练集和测试集,80%的数据用于训练,20%的数据用于测试。

3. 数据标准化:

- 逻辑回归对输入特征的尺度非常敏感,因此我们对数据进行标准化(均值为0,方差为1),使用StandardScaler完成这一操作。

4. 训练逻辑回归模型:

- 使用LogisticRegression()创建一个逻辑回归模型,并在训练集上进行训练。max_iter=200指定最大迭代次数,以确保算法收敛。

5. 预测与评估:

- 使用训练好的模型对测试集进行预测,并通过classification_report显示分类的准确性、精确度、召回率和F1-score等评估指标。

使用confusion_matrix计算混淆矩阵,进一步分析模型的分类效果。

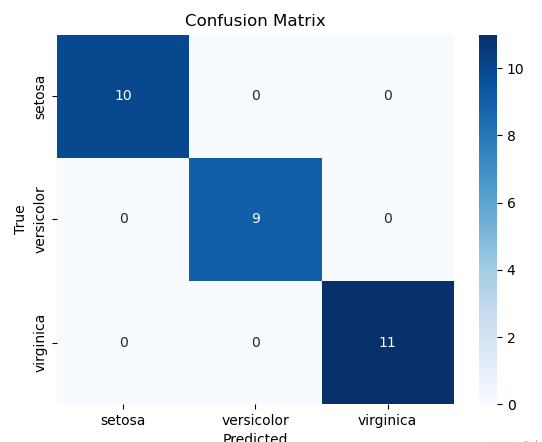

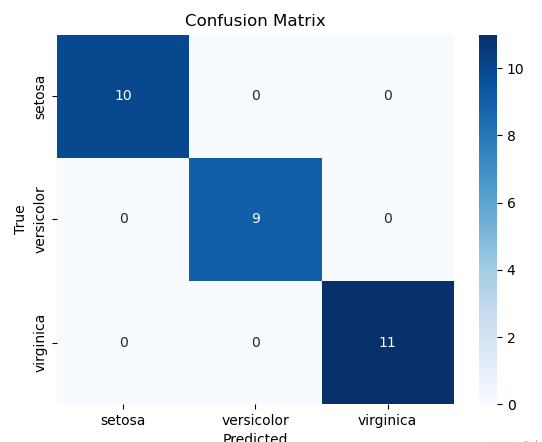

6. 混淆矩阵可视化:

- 使用Seaborn的heatmap函数将混淆矩阵可视化,更直观地展示分类效果。

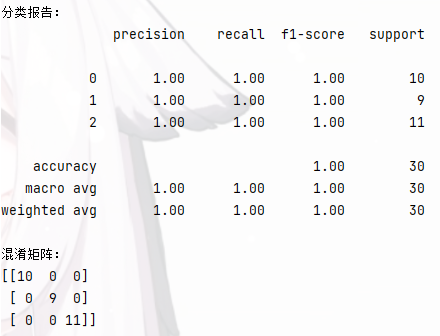

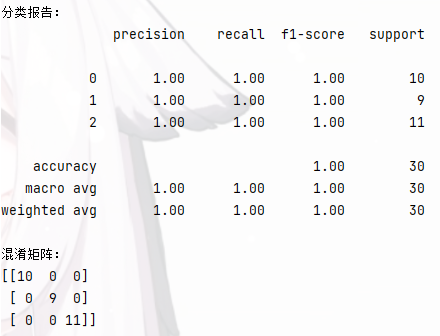

🍋评估结果

分类报告如下:

混淆矩阵如下:

根据分类报告和混淆矩阵的结果,我们可以得出以下结论:

- 完美的分类结果:模型的精确度、召回率和F1分数都为1.00,说明模型在每个类别上都没有错误预测,完美地分辨了三个不同种类的鸢尾花。

- 没有误分类:混淆矩阵显示每个类别的所有样本都被正确分类,没有出现任何误分类的情况。

- 数据集的简单性:由于Iris数据集是一个相对简单且清晰的分类问题,尤其是在特征与类别之间的边界非常明确时,逻辑回归能够非常好地进行分类。

🍋结论

本文对逻辑回归、Softmax回归、集成学习方法进行了详细分析,并讨论了类别不平衡问题及其解决方法。通过实验验证,选择合适的分类算法和解决方案能够显著提高模型在实际任务中的性能。