你以为的“一键生成”,其实是门新艺术!

为什么说生成式AI不是“捷径”,而是文娱产业的新画笔?

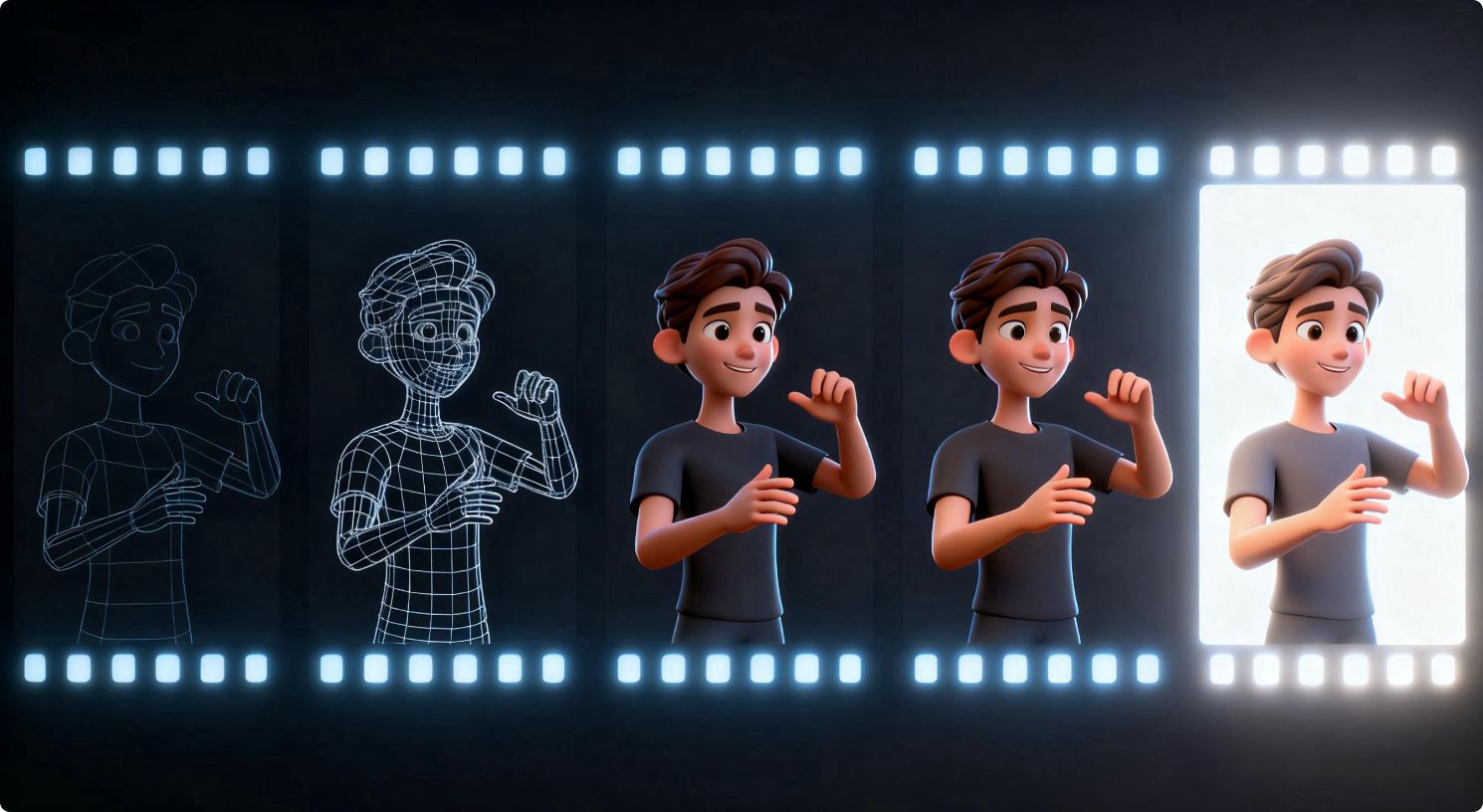

事实上,生成式AI正在成为一门全新的艺术媒介。它不是在取代创作者,而是在要求他们掌握一套全新的技能——从“导演镜头”到“用语言拍戏”,从“控制角色表情”到“设计物理规律”……

这不是魔法,而是现代电影人的新基本功!

别被“提示词”骗了!它可不是“随便写写”

“提示词”听起来简单,背后却是一整套电影思维。

比如,你想生成一个“悲伤的雨夜街头”,AI可不会自动理解你要的是《银翼杀手》风还是《爱乐之城》风。你得告诉它:

- 镜头是推进还是环绕?

- 光线是霓虹灯还是月光?

- 角色的嘴角是下垂还是微颤?

- 雨滴是斜打还是垂直落下?

这就像你不仅当导演,还得兼任摄影师、美术指导、灯光师……只不过,这些指令全被压缩成“语言代码”。

而那些专业的AI创作工具——Sora、Runway、Pika、Midjourney——就像是你手下的全能剧组,但前提是,你得清楚自己要什么!

导演不喊“卡”了,改敲键盘了!

在AI电影流程里,导演并没有失业,而是换了一种方式“掌镜”。

- 不再扛摄像机,而是用语言构建镜头:“镜头从主角左肩缓慢推进,背景逐渐虚化,焦点落在她颤抖的手指上……”

- 不再指导演员,而是设计行为逻辑:“角色在第三秒低头,第五秒抬眼,眼中带泪但强忍不流。”

- 不再搭实体景,而是用描述造世界:“一座2070年的东京夜市,全息广告牌闪烁,飞行车在背景中无声滑过。”

你甚至得懂一点“动画导演”的逻辑,用JSON文件精准控制每一段对话的节奏、每一个表情的节点。

这哪里是“按个按钮”?这分明是用写代码的方式拍电影!

你看到的15秒,背后可能是50次修改!

一个看起来流畅的15秒镜头,背后可能是这样的。

第1版:手部动作诡异 → 重调

第5版:角色眼神方向错 → 再改

第20版:光影突然跳帧 → 继续调

第50版:物理规律不合逻辑 → 接着修……

这还不包括音频的精细处理:AI生成的语音,你得调整语气、停顿、情感强度,甚至对口型。

生成式AI不会自动“表演”,它只是执行者,你才是那个在背后抠细节的“导演”!

为什么说AI电影更需要“艺术细胞”?

你可能会问:工具都这么强了,要人干嘛?

恰恰相反!AI就像是一支无比聪明的画笔,但画什么、怎么画、表达什么情感——仍然取决于握笔的人。

如果你说不清“孤独感”,AI可能给你生成一个“空荡荡的房间”,但表达不出“渴望被理解的眼神”。

如果你控制不了节奏,AI生成的片段可能画面华丽,但叙事断裂。

AI提供了效率,但没有提供审美;它拓展了可能性,但没有替代想象力。

文娱工具变了,但创作没变懒

回顾影视技术的发展,从CGI特效到虚拟制片,每一次新工具出现,都有人说“艺术要亡了”。但结果呢?

CGI没有取代实拍,反而创造了《阿凡达》;

虚拟制片没有淘汰外景,却让《曼达洛人》拍出了太空史诗。

AI也是一样。

它不会取代编剧、导演、美术,但会要求他们学习新语言、新工作流。

未来的电影人,可能是“会写提示词的导演” + “懂AI的摄影师” + “能编码的剪辑师”……

别怕AI,把它变成你的新剧组!

如果你还在认为“AI创作=偷懒”,那很可能你还没真正开始创作。

真正的创作者,已经在用AI:

- 构建前所未有的视觉世界;

- 实验人类演员做不到的表演;

- 探索交互与动态叙事的新边界……

生成式AI不是创作的终点,而是又一种创作形式的起点。文娱产业的未来,不属于AI,而是属于会用AI的创作者!

理念的落地,离不开行之有效的方法。 既然我们已经认同AI是值得深耕的新画笔,那么下一个关键问题便是:如何真正驾驭它,将脑海中的导演思维,精准无误地传递给这位“AI助手”?

答案就藏在“提示词”这门全新的工作语言中。下面,我们以Runway Gen-4的核心最佳实践为例,它将为你揭示,哪些看似细微的指令差异,会直接决定你的作品是“惊艳大作”还是“无用废片”。

⚪仅使用正面表述

Gen-4 旨在解读描述视频中 “应发生什么” 的提示词,而非 “应避免什么”。该模型不支持负面表述,使用此类表述可能会产生不可预测甚至与预期相反的结果。

❌ 不要有镜头移动。镜头保持不动。禁止任何移动

✅ 固定镜头。镜头保持静止。

⚪使用直接、简洁且易于理解的提示词

当简单描述即可清晰传达场景时,避免使用过于抽象的语言和表述。如果提示词描述的是动作背后的理念或感受,而非具体的物理动作,可能会导致意外结果。

抽象概念会迫使模型解读你的意图,往往会产生随机或意外的动作。请始终将抽象理念转化为模型能够理解的清晰、具体的物理动作。这种直接的方式可消除歧义,为模型提供可靠执行的明确指令。

❌ 主体展现出喜悦问候的本质,以热情的方式表达对他人存在的认可,传递内心的愉悦。

✅ 女子微笑着挥手致意。

⚪聚焦于描述动作,而非输入图像

文本和图像输入均被视为提示词的一部分。若对图像中已存在的元素进行过于详细的重复描述,可能会导致输出视频的动作减少或出现意外结果。

❌ 身穿蓝色西装、系着红色领带的黑发高个子男人伸出手准备握手

✅ 男子伸出手臂握手,随后礼貌地点头致意。

⚪避免对话式或命令式提示词

外部大型语言模型(LLMs)擅长处理自然对话,但 Runway 的模型专为处理视觉细节而设计。问候语或解释性内容等对话元素会浪费宝贵的提示词空间。

同样,要求进行修改的命令式提示词通常缺乏描述元素在输出中应如何表现的必要信息。例如,与其直接要求添加或移除元素,不如描述这些元素应如何出现在场景中或从场景中消失。

❌ 能否请你把我的狗添加到图像中?

✅ 一只狗兴奋地从画面外跑进场景。

⚪避免过于复杂的提示词

Gen-4 生成的视频时长为 5 秒或 10 秒,因此可将每次生成视为单个场景。

若试图逐秒描述视频,包含多个场景转换、主体动作或风格变化,模型可能会因需要协调过多不同元素或相互矛盾的指令而产生非预期结果。

在大多数情况下,对单个场景的预期动作进行简单描述即可获得良好效果,充分发挥模型的优势:

❌ 一只猫在森林中跳跃时变成巨龙,每跳跃一次森林就变换一个季节。镜头 360 度旋转并俯冲到水下,巨龙在霓虹都市景观中变成潜水艇。

✅ 一只猫在森林中奔跑时变成巨龙。