AnyLanguageModel 发布:为苹果平台打造的统一大语言模型 API

大语言模型已成为现代应用开发的核心要素,然而 苹果开发者在模型集成过程中仍面临显著的复杂性。为在应用中融入 AI 能力,开发者往往需要同时应对多种技术方案:

• 基于 Core ML 或 MLX 的本地模型(保障数据隐私与离线能力)

• OpenAI、Anthropic 等云端服务(获取前沿模型能力)

• Apple 系统内置的 Foundation Models 框架(系统级模型支持)

每种方案都配备独立的 API、认证机制和集成模式,这种碎片化状况显著推高了开发门槛。研发团队在调研中发现,众多开发者深受集成复杂度困扰。一位开发者坦言:“本想快速验证原型,结果却在环境配置上耗费数日,实在令人沮丧。”

过高的实验成本使许多开发者错过了更适合其需求的本地开源模型。为此,研发团队正式推出 AnyLanguageModel——一个 Swift 包,可作为 Foundation Models 框架的即插即用替代方案,支持跨模型供应商的统一 API。该项目的使命明确:降低 Apple 平台上的大模型使用门槛,推动本地开源模型的广泛采用。

解决方案:统一接口设计

核心思路极致简洁:仅需替换导入语句,完整保留 API 兼容性。

swift

实际应用示例:首先展示 Foundation Models 框架的标准使用方式:

swift

现在切换至 MLX 本地开源模型:

swift

AnyLanguageModel 当前支持的模型供应商包括:

- Foundation Models 框架:Apple 系统模型原生集成(需 macOS 15+ / iOS 18+)

- Core ML:通过神经网络引擎加速推理

- MLX:在 Apple Silicon 上高效运行量化模型

- llama.cpp:通过 llama.swift 加载 GGUF 格式模型

- Ollama:连接本地部署的 Ollama 服务

- OpenAI、Anthropic、Google Gemini:云端服务供应商

- Hugging Face:支持数百个托管模型

研发团队特别关注来自 Hugging Face Hub 的本地模型。云端服务的引入旨在降低初始使用门槛,为开发者提供“先实现,后优化”的渐进路径。

架构决策:为何基于 Foundation Models API?

在设计过程中,研发团队面临关键抉择:创建全新的抽象层,或基于现有成熟 API 构建。最终选择了后者,以 Apple 的 Foundation Models 框架为设计蓝本。

这一选择基于以下考量:

- 卓越的原始设计:该框架充分利用 Swift 特性(如宏),提供流畅的开发体验。其会话管理、工具调用和内容生成等抽象与大语言模型的实际工作模式高度契合

- 精心设计的约束:Foundation Models 框架定义了大模型功能的“最小公分母”。研发团队视此约束为稳定基石——所有 Apple 平台开发者都将逐步熟悉此 API,基于它构建能显著降低学习成本

- 避免过度抽象:额外的抽象层会使开发者远离实际问题。适当的抽象带来效率,过度抽象则成为新的负担

最终成果是:在不同模型供应商间切换时,仅需最少量的代码调整,核心抽象层始终保持简洁与可预测。

包特性:按需引入依赖

多后端库常面临依赖膨胀挑战。若只需运行 MLX 模型,不应强制引入 llama.cpp 及其全部依赖。

AnyLanguageModel 利用 Swift 6.1 的包特性完美解决此问题。开发者可精准选择所需后端:

swift

当前支持的特性包括:CoreML、MLX 和 Llama(对应 llama.cpp/llama.swift)。默认配置下不引入任何重量级依赖,仅提供基础 API 及基于标准 URLSession 的云端服务支持。

对于尚未支持特性声明的 Xcode 项目,可创建内部 Swift 包指定所需特性,然后将该包作为本地依赖项引入。具体操作请参阅项目 README。

图像支持与 API 设计权衡

视觉语言模型具有广泛应用场景,包括图像描述、截图文本提取、图表分析和视觉问答等。遗憾的是,当前 Foundation Models 框架尚未支持提示词中的图像输入。

基于现有 API 构建意味着接受其限制。虽然 Apple 可能在未来系统版本中增加图像支持,但视觉语言模型的实用性不容等待。因此,研发团队决定对框架功能进行扩展。

向 Claude 发送图像的示例:

swift

研发团队在此做出了一项重要权衡:当前设计的扩展方案可能与 Apple 未来的官方实现存在冲突。但这正是弃用警告的价值所在——在某些情况下,必须为尚未存在的框架预先设计 API。

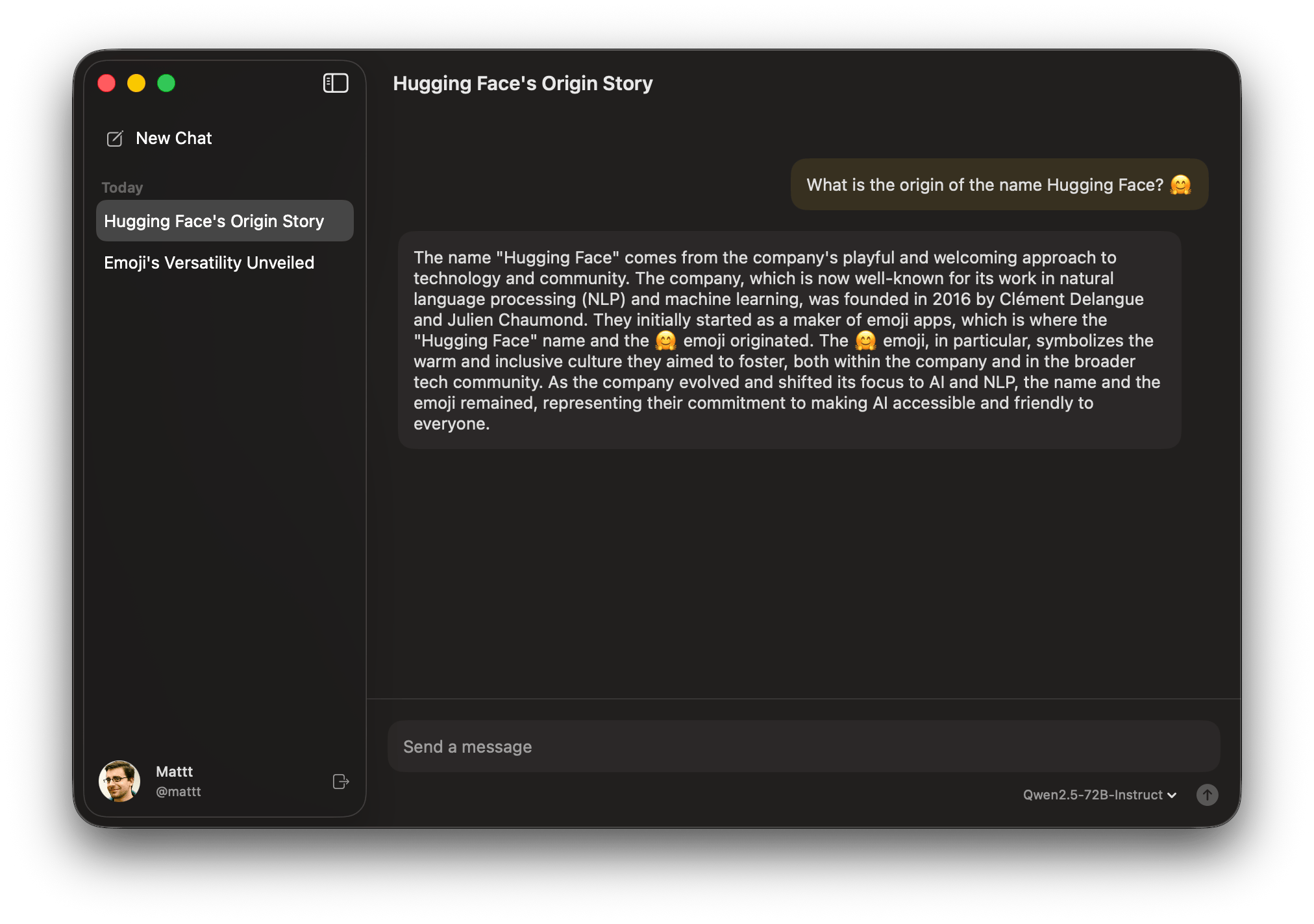

实践案例:chat-ui-swift 应用

要体验 AnyLanguageModel 的实际效果,请查看 chat-ui-swift——基于 SwiftUI 开发的聊天应用,完整展示了该库的核心能力。

该应用包含以下特性:

- 通过 Foundation Models 框架集成 Apple Intelligence(需 macOS 15+)

- Hugging Face OAuth 认证(用于访问受限模型)

- 流式响应输出

- 对话历史持久化

它旨在作为开发起点:开发者可以 Fork 项目并进行扩展,替换不同模型,深入研究各组件工作原理,最终适配至具体需求。

发展路线图

AnyLanguageModel 目前处于 1.0 正式版发布前的关键阶段。核心 API 已保持稳定,研发团队正积极推进以下工作,旨在将 Foundation Models 框架的完整功能扩展到所有适配器:

- 全供应商工具调用支持

- 基于 MCP 的工具与引导集成

- 引导式生成与结构化输出

- 本地推理性能优化

该项目是研发团队迈向更宏大目标的第一步。统一的推理 API 为在 Apple 平台上构建智能代理工作流奠定了坚实基础——这类应用中的模型能够自主使用工具、访问系统资源并完成复杂任务。

来源:https://huggingface.co/blog/anylanguagemodel