这个“AI剪刀手”,能把枯燥舞台变电影大片!

经常看话剧、脱口秀或者综艺录像的朋友,大概都有过这种想吐槽的时刻:“这机位也太单调了吧!”

受限于场地、预算,很多精彩的现场演出只能无奈地架一台固定摄像机拍个全景。结果就是,观众看得昏昏欲睡,演员精彩的微表情、互动细节全被那个“一览无余”的大远景给吞没了。没了特写,这录像也就没了灵魂。

以前要解决这个问题,得雇一个摄影师团队长枪短炮地围着拍,后期还得有专业剪辑师费劲地挑素材。但现在,AI似乎准备来帮这个忙了。

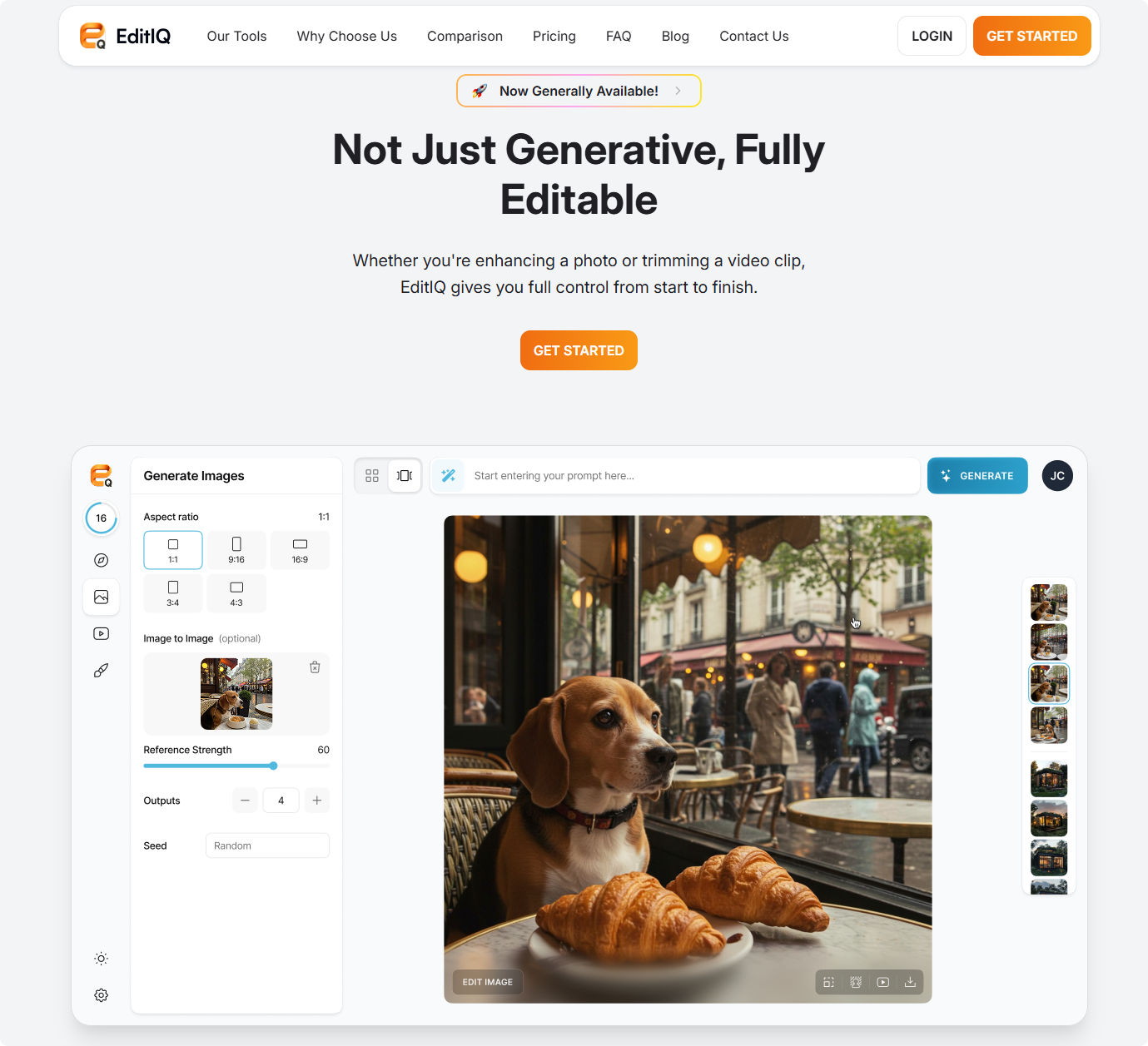

最近,印度国际信息技术学院海德拉巴分校与澳大利亚堪培拉大学的研究团队,在2025年智能用户界面国际会议(IUI ’25)上发布了EditIQ——一个全自动“电影化”剪辑系统。

它的突破在于只需输入一段固定机位拍摄的高清广角视频,EditIQ就能像经验丰富的导播和剪辑师一样,自动生成包含远景、中景、特写,且叙事流畅、情感饱满的“大片”!

这听起来有点科幻,它是怎么做到的?AI真能读懂人类的戏?今天就带大家扒一扒这篇硬核论文背后的故事,看看这位AI剪辑师到底有几把刷子。

论文地址:http://ar5iv.labs.arxiv.org/html/2502.02172

AI如何无中生有变出“多机位”?

想象一下,你正在用一台昂贵的高分辨率摄像机录制一场话剧。因为场地限制,摄像机只能架在观众席最后排,一动不动地拍着整个舞台。这种视频素材,行话叫“主镜头”。虽然记录完整,但实在没法拿来当电影看,因为它太平了。

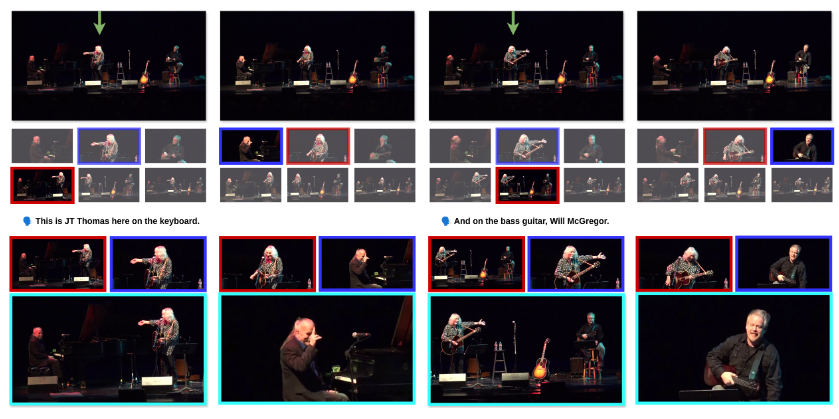

EditIQ要做的第一步工作,就是得先有素材可剪。它不需要真的有多台摄像机,而是通过“虚拟计算”来创造素材。

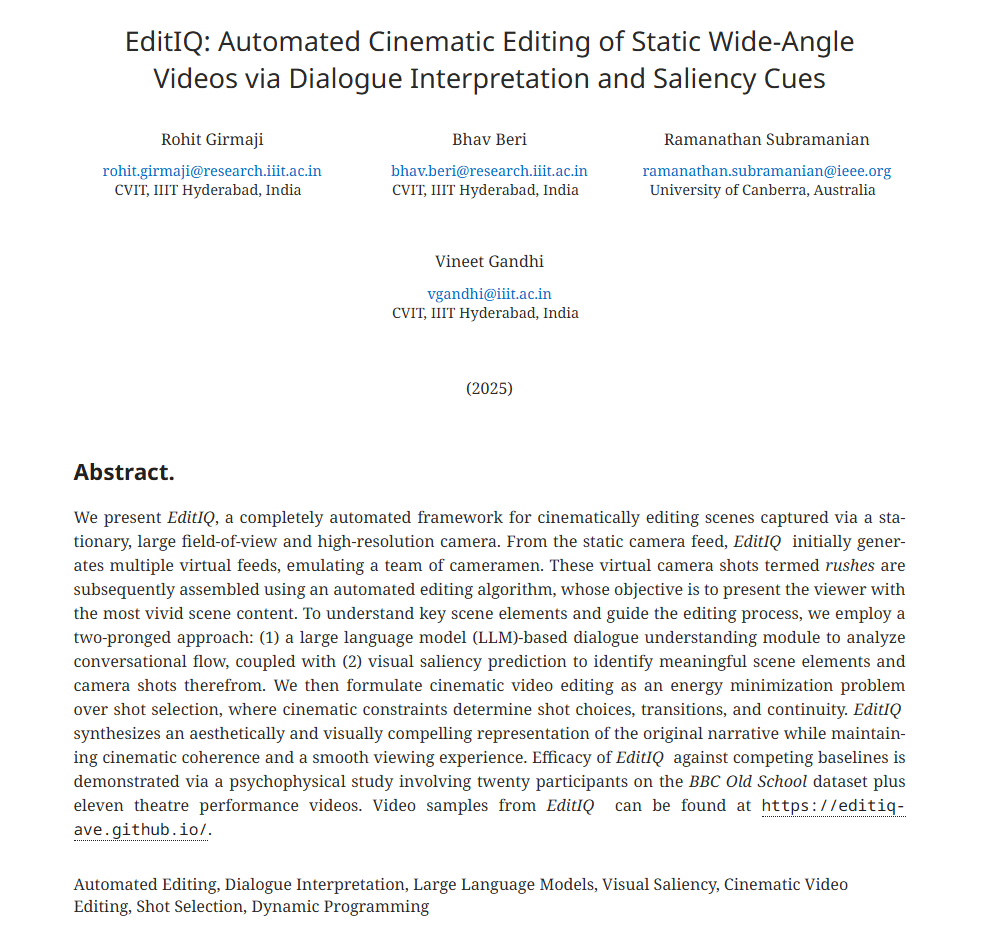

研究人员借鉴了之前的技术路线,利用原始视频超高分辨率的特性,在画面里进行数字裁剪和变焦。例如,舞台上有5个演员,AI就会利用人体姿态估计技术,自动识别出这5个人都在哪儿,姿势是怎样的。

然后,它就开始“变魔术”了,生成一系列“虚拟摄像机”的视角。例如,给A演员来个半身中景,给B和C来个双人镜头,给D、E、A来个三人全景…… 就这样,EditIQ瞬间就从一个死板的全景视频里,变出了几十个不同角度、不同景别的虚拟素材片段。

有了素材库,接下来才是最难的一步:在每一秒钟,AI怎么知道该切给谁的镜头?

何为AI剪辑师的“左右脑”?

专业的剪辑师在工作时,绝不是随机切镜头的。他们要理解剧情,捕捉情绪,引导观众的注意力。为了让AI学会这一手,研究团队给EditIQ装上了两个极其强大的“大脑”。

1. 左脑:懂剧情的“语言大师”(基于LLM的对话理解)

以前的一些自动剪辑系统比较笨,通常是“谁说话镜头就切给谁”。这听起来合理,但实际上很呆板。

举个例子,舞台上乐队主唱正在介绍成员:“键盘手是JT·托马斯。” 这时候如果是笨AI,镜头还会死死盯着正在说话的主唱。但人类剪辑师知道,这时候观众最想看的,是被点名的键盘手JT,以及他可能会有的致意动作。

EditIQ利用了当下最火的大型语言模型(LLM)来解决这个问题。它不仅仅是听写出台词,更是去深度理解对话的上下文含义。

研究人员会把带有说话人信息的台词脚本丢给LLM,然后给它下达指令:“你现在是个专业剪辑师,根据这段对话,告诉我在每个时间点,观众最应该看谁,或者看哪几个人。”

LLM凭借强大的理解能力,能精准地分析出剧情走向。它知道什么时候该看说话的人,什么时候该看被提到的人,什么时候该看听众的反应。它甚至能精确到在哪个词说完之后进行切换,这就是EditIQ理解叙事逻辑的关键,研究人员称之为“上下文势项”。

2. 右脑:捕捉焦点的“视觉侦探”(视觉显著性预测)

光听对话还不够,很多精彩瞬间是无声的。比如,两个演员在角落里一个意味深长的对视,或者某个演员突然做了一个夸张的肢体动作,这些对话脚本里没有的东西,LLM是不知道的。

这时候就需要“右脑”出马了——视觉显著性预测模块。研究团队训练了一个AI模型,让它去模拟人类的视觉注意力机制。简单来说,就是预测“如果人眼看这个画面,目光最容易被哪里吸引”。

这个模型会分析视频每一帧的动作、变化,识别出哪里是视觉上的焦点区域。即使没有对话,如果某个演员突然做了一个大幅度的动作,视觉显著性模块就会捕捉到,并告诉系统:“嘿,这里有情况,这可能是个好镜头!”

这样一来,EditIQ就兼顾了语言逻辑和视觉焦点,既不会跟丢剧情,也不会错过精彩瞬间。

AI如何像老法师一样遵守“行规”?

有了两个“大脑”提供的候选镜头建议,EditIQ是不是就可以直接输出了?还不行。如果只是机械地根据建议切换,剪出来的视频可能会让人看着头晕眼花。

因为电影剪辑有一套百年积累下来的“行规”,用来保证观看的舒适度和流畅性。EditIQ的最后一步,就是把剪辑过程变成了一道复杂的数学题——“能量最小化问题”,并在解题过程中加上了严格的“电影化约束”。

● 拒绝跳切(Jump Cuts): 前后两个镜头不能太像,否则画面会突兀地“跳”一下,非常难受。AI会计算镜头间的重叠率,强制避开这种低级错误。

● 节奏把控: 镜头不能切得太碎太快(除非是动作片),也不能一个镜头定那一分钟不动。AI设定了最小和最大镜头时长,保证节奏张弛有度。

● 构图规矩: 切出来的特写不能把旁边人的半个肩膀或者半张脸卡在画面边缘,这叫“取景不当”。AI会对这种坏构图进行严厉的“惩罚”。

通过动态规划算法,EditIQ会在所有可能的镜头组合中,找到一条既符合左右脑建议,又违反最少电影行规的“最优路径”,最终生成流畅的成片。

AI剪辑VS人类专家,结果如何?

说了这么多理论,EditIQ到底好不好用?研究团队可没光说不练,他们搞了一场硬碰硬的对比测试。

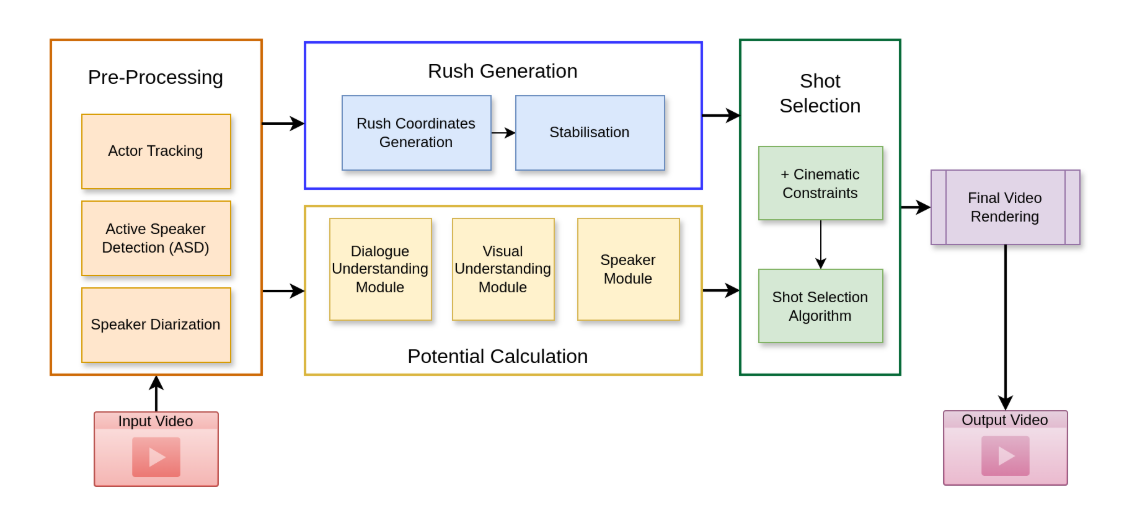

他们找来了专业的BBC素材库,里面包含了游戏竞赛节目的原始素材,以及BBC专业剪辑师剪好的版本。为了增加难度,还特意找了11段高分辨率的戏剧表演视频,这些视频里的动作和走位更复杂,并请了20位观众进行盲测打分。

评测结果令人惊喜,在“叙事效果”“动作捕捉”“情感表达”和“整体观看体验”这四个维度上,EditIQ全面碾压了随机剪辑、广角基准和说话者基准。观众普遍反馈,EditIQ剪出来的视频明显更“懂戏”,能抓拍到关键的反应和动作,看着更像是一个有思想的人剪出来的,而不是冷冰冰的机器。

最刺激的是与人类专家的对比, 虽然在总分上人类专家依然保持领先,但EditIQ的表现已经非常接近了。尤其是在叙事连贯性上,AI已经展现出了极高的专业素养。考虑到它完全是自动化运行,不需要人工干预,在普通电脑显卡上几分钟就能剪完一段视频,这个成绩已经相当惊人了。

结语

EditIQ代表的不仅是技术进步,更是一场创作民主化的革命。它让每个有故事的人,即使没有专业团队和昂贵设备,也能用最朴素的方式记录并呈现出动人的作品。

技术的本质从来不是替代,而是解放。正如摄影没有取代绘画,反而催生了新的艺术形式,AI剪辑也不会让人类剪辑师失业,而是将他们从重复劳动中解脱出来,专注于真正的创意决策。

未来,最好的作品很可能来自人类与AI的共创——人类负责注入灵魂,AI负责精准执行。当技术门槛被降低,真正决定作品高度的,将永远是创作者的眼光与情感。

这不是工具的终结,而是新创作时代的开始。