怎样用AI把抽象的剧本概念,变成投资人能秒懂的动态大片?

在影视行业的名利场里,最遥远的距离不是从北京到好莱坞,而是编剧脑海中波澜壮阔的史诗画面,到投资人PPT上那几行干瘪文字之间的距离。

每一位导演或制片人都经历过这种“想象力时差”的痛苦:你手舞足蹈地描述着一个“赛博朋克风格的、带有东方禅意的、雨夜追逐戏”,对面的资方却一脸茫然,最后礼貌地问你:“有没有对标影片?”

长期以来,为了填平这个沟壑,行业进化出了一套昂贵且漫长的“前期可视化(以下简称Previz)”流程。从最初的简笔画分镜墙,到后来动辄几十万一分钟的3D动态预演,一直在试图让抽象的文字“站立”起来。但“太慢,太贵,且修改成本极高”的痛点依然存在。

然而,过去一年,AIGC(生成式人工智能)的爆炸式发展,尤其是文生视频和图生视频技术的迭代,正在剧烈冲击着传统的成本与效率体系。我们正站在一个新时代的门槛上,利用AI赋能“创意可视化”,将抽象的剧本概念快速转化为可供决策的动态预览。

从“文字理解”到“视觉直觉”的跃迁

在传统的语境下,Previz往往被视为视觉特效部门的前置工作,主要是为了解决复杂的摄影机运动和特效定位。AI介入后,“可视化”的定义被极大地拓宽了。现在的AI Previz,更像是一种“情绪与氛围的快速原型设计”。

传统模式: 剧本→概念图艺术家绘制(数天)→3D建模/动画师制作粗模动态(数周)→导演反馈修改(又数周)。

AI模式: 剧本→ 提炼关键词→ AI生成静态风格图(数分钟)→ AI基于图生成动态视频(数分钟)→导演即时反馈调整。

这种效率的提升是颠覆性的,它不再要求你一开始就精确到摄影机的焦段,而是允许你先“撒一把米”,看看能长出什么庄稼,更像是一个拥有无限素材库、且随叫随到的美术指导兼概念设计师,不知疲倦地为你提供几十种可能。

从“抽象概念”到“动态预览”的降维

将AI融入前期工作流,核心在于理解“提示词工程”,并学会组合使用不同的AI工具。我们可以将这个过程拆解为三步走的“降维打击”:

第一步:剧本的结构化拆解(让AI读懂故事)

AI不懂什么是“悲伤”,但它理解“雨夜、低垂的头、冷色调灯光、缓慢的推镜头”这些具体的视觉元素。

在这一步,我们可以借助如ChatGPT或Claude这类大语言模型,扮演“AI剧本分析员”的角色。具体方法是:将一场戏的剧本输入给AI,并向它发出明确的指令,例如:

“请你作为一名资深摄影指导,将以下剧本段落拆解为一系列视觉提示词。我希望营造一种压抑中暗含希望的氛围,请提供具体的镜头语言建议、光影描述以及关键动作指示。”

AI随即能够将抽象的文学描述,快速转化为一份具象的视觉“配方列表”。这一过程,极大地节省了传统拉片和人工拆解剧本所需的时间。

第二步:确立美术风格(从文字到定帧)

我们可以先通过“文生图”来确立视觉风格,再借助“图生视频”技术让静态画面运动起来。

使用 Midjourney v6 或 Stable Diffusion XL 等工具,输入第一步中得到的视觉提示词,即可快速生成高质量的概念设计图或关键帧。在此阶段,导演和美术指导能够高效进行风格尝试与快速迭代。例如,若提出“想要《银翼杀手2049》的视觉质感,但色彩要更贴近王家卫的风格”,只需调整提示词,AI 便能在几分钟内生成数十张不同方向的效果图。

团队可以持续调整、比对,直至所有人指向屏幕达成共识:“对,就是这个感觉!”

第三步:让静止的瞬间“活”过来(动态预览)

这是最激动人心的时刻。拿到满意的关键帧后,接力棒交给了Runway Gen-2/Gen-3、Pika Art、Sora等视频生成模型。

利用图生视频功能,上传关键帧,并辅以动作提示词(如“镜头缓慢前推,人物转头,背景车辆移动”),AI就能生成一段动态视频。

通过连接这些短片,我们就能拼凑出一个粗糙但极具氛围感的动态故事板。

从“降本增效”到“沟通重塑”的进阶

如果只把AI看作省钱的工具,那就太低估它了。AI Previz在前期工作流中的核心价值,在于解决沟通的“信息熵减”问题。

在片场呆过的人都知道,文字在传递过程中损耗是巨大的。编剧写的是A,导演脑子里想的是B,摄影师理解成了C,美术做出来是D。

提案阶段的“杀手锏”

带着几十页密麻的文字剧本去提案,投资人难免兴致寥寥。但如果在会议中直接播出一段由AI生成、配好参考音乐的2分钟动态概念片,其带来的视觉冲击与沉浸感,是任何PPT都无法比拟的。它传递的不仅是故事,更是团队的执行力、专业度与对项目的清晰愿景。

主创团队的“对齐工具”

开机前,导演、摄影指导、美术指导围坐一起,不再需要陷入空泛的形容词争论。取而代之的,是现场调用AI快速生成图像或片段:

“你说的那种光,是不是这种感觉?”

“不对,再硬朗一些,对比度可以更高。”

(两分钟后)

“那现在这样呢?”

“对了!就锁定这个影调。”

这种高效、直观的协同对齐,能提前化解大量潜在创作分歧,避免将问题带到实拍现场——而那里的每一分钟,燃烧的都是真金白银。好莱坞导演兼特效专家 Gareth Edwards 在拍摄《造物主》时,便大量实践了类似理念。尽管当时尚未出现如今的生成式AI,但他所倡导的“先构建视觉基础,再推进拍摄”的逆向工作流,正是当前AI技术能够极大加速的方向。

影视行业的历史,就是一部技术驱动艺术变革的历史。从无声到有声,从黑白到彩色,从胶片到数字,每一次技术浪潮来袭,都会引发恐慌,但最终都推动了行业的繁荣。

AI赋能的“创意可视化”,正在推倒创作的围墙。它让年轻导演有机会用极低的成本展示宏大的愿景,让资深团队能以更高效的方式对齐创作目标。

别让你的好剧本在硬盘里沉睡了。在这个算力爆炸的时代,学会驾驭AI,让你的想象力在开机前就先“跑”起来,或许就是下一部爆款诞生的起点。

【附录:影视前期AI工具箱推荐】

Sora 2:追求叙事长度与一致性的标杆。专注于基于单句提示生成多镜头、长时长、角色一致且具备叙事连贯性的视频。

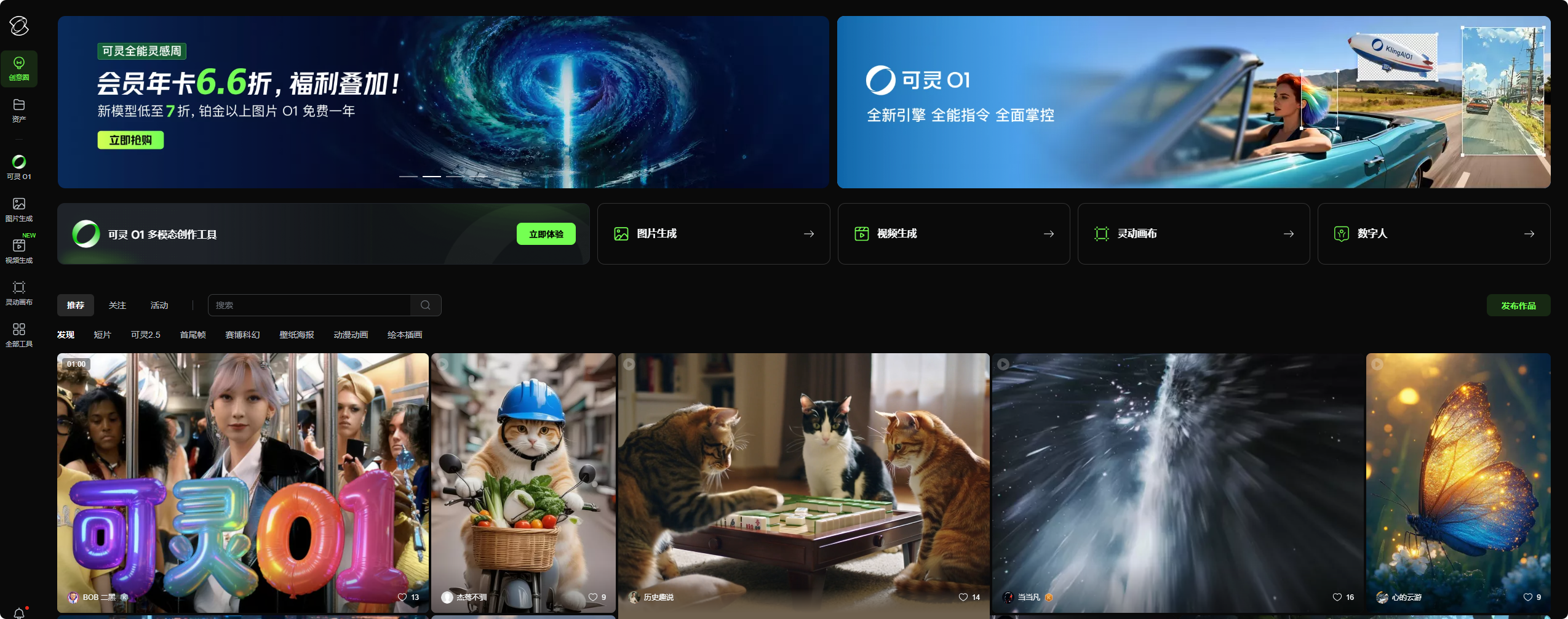

可灵:“大一统”全能型选手。能将文生视频、图生视频、视频编辑、主体替换等多种任务融合在一个引擎中,擅长保持角色与场景的极高一致性。

Google Veo 3:导演级原生音画生成。以原生集成高质量音效(对话、环境音、配乐)和精确唇形同步为标志,生成影片的叙事性和完成度高。

PixVerse V5.5:一键生成“成片”级叙事段落。核心是多镜头与音画同步生成,可根据简单提示自动生成包含运镜、景别切换、对白和音乐的完整叙事片段,接近直出成片。

Runway Gen-3:成熟的多面手与创意实验室。平台功能全面(生成、擦除、运动控制等),生态成熟,是进行快速视觉实验和创意原型设计的可靠选择。