SCI 论文润色零泄密:DeepSeek-V3.2 部署指南

目录

对于临床医生来说,最痛苦的时刻往往不是在手术台上,而是结束了一天的门诊和手术,拖着疲惫的身体坐在电脑前,面对审稿人的评语:“The English needs improvement”(英语表达需要改进)。

不仅如此,很多医生手头握有创新性的未发表数据。这些数据是科室几年的心血,绝对不能直接粘贴到 ChatGPT 或者 Gemini 这种云端翻译软件里。一旦上传,数据就出了内网,理论上存在被模型训练或泄露的风险。

既要顶刊级别的润色,又要绝对的数据安全,怎么办?

答案是:拔掉网线,在本地跑大模型。

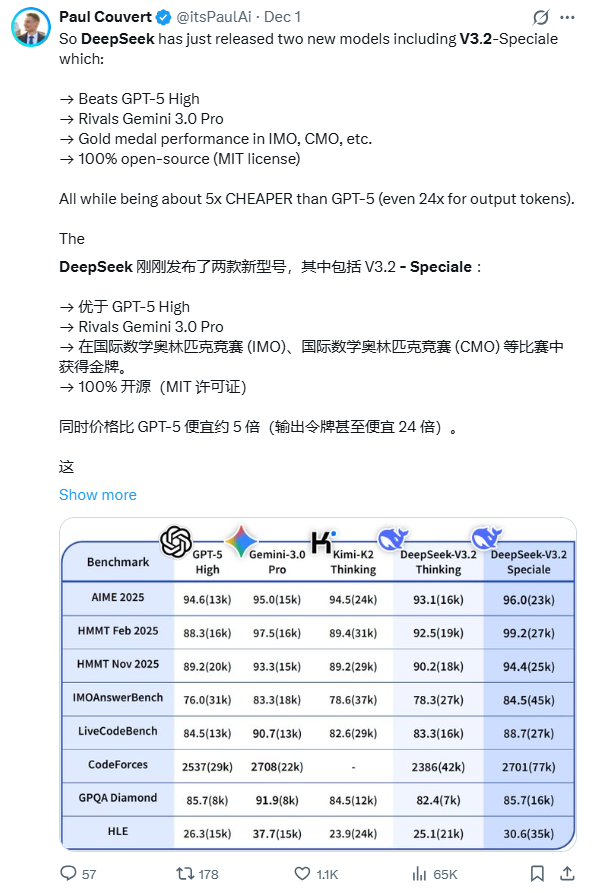

今天,我们介绍最近在开源界杀疯了的 DeepSeek。特别是其最新的 V3.2 版本,它在推理能力上已经对标 GPT-5 水平,且对中文语境的理解远超国外模型。最重要的是,它是开源的,我们可以把它完全部署在医院或实验室的本地服务器上。

为什么选择 DeepSeek V3.2 本地版?

- 物理隔绝:模型下载到本地后,你可以拔掉网线运行。所有数据只在你的硬盘和显卡之间流动,不用担心病例数据泄露。

- 国产之光:性能比肩Gemini,而且相比纯英文模型,DeepSeek 在中文医学术语的理解和转换上,由于训练语料的优势,表现得更精准。

- 完全免费:不需要充值 API,不需要订阅 Plus 会员。

图片来源:https://x.com/itsPaulAi/status/1995494744450031839

注:DeepSeek V3.2 是超大规模模型(671B参数),对硬件要求极高(通常需要 A100/H800 服务器集群)。如果你的实验室只有高性能工作站(如 4090)或普通电脑,我们在后文提供了 DeepSeek V3.1 或量化版本的替代方案,依然够用。

部署指南

在中国网络环境下,直接访问 Hugging Face 下载模型非常慢且不稳定。我们推荐使用阿里的 魔搭社区(ModelScope) 进行高速下载。

第一步:环境准备与下载

首先,确保你的服务器安装了 Python 环境。

打开终端,安装 ModelScope SDK:

pip install modelscope

然后,使用国内高速链路下载 DeepSeek V3.2 模型(以 Speciale 版本为例):

# 下载 DeepSeek-V3.2-Speciale 模型到本地 dir 目录

modelscope download --model deepseek-ai/DeepSeek-V3.2-Speciale --local_dir ./model_dir

第二步:启动推理引擎

对于 V3.2 这种超大模型,推荐使用 SGLang 进行部署,它能最大化显卡利用率。

# 使用 Docker 启动服务(需配置好 Docker 环境)

docker run --gpus all \

-v $(pwd)/model_dir:/model \

-p 30000:30000 \

lmsysorg/sglang:dsv32-a3 \

python3 -m sglang.launch_server --model /model --tp 8 --dp 8

(注:--tp 8 表示使用 8 张显卡进行张量并行,请根据实际硬件调整。)

备选方案:DeepSeek V3.1 (Ollama)

- 去 Ollama 官网下载安装包。

- 在终端输入一行命令:

ollama run deepseek-v3.1 - 等待进度条跑完,你就有了一个本地的 DeepSeek。

示例场景一:拒绝 Chinglish

我们的论文常被诟病句子结构单一(主谓宾 SVO),缺乏学术词汇。 很多人只把 AI 当翻译用,其实它最强的是风格迁移。

提示词(直接复制):

“你现在是《The Lancet》或《NEJM》的资深医学编辑。请阅读我下方的段落,保持原意不变,但重写它。 要求:

- 使用更学术、更精准的医学词汇(例如用 'administer' 代替 'give')。

- 优化句子结构,多使用被动语态和从句,使逻辑流淌更顺畅。

- 彻底消除中式英语的表达习惯。

待修改段落: [在此粘贴你的论文段落]”

效果对比:

- 原文:Patients felt bad after taking the medicine. (太口语化)

- AI 修改后:Subjects reported significant adverse effects following administration of the pharmacological agent.(顶刊范儿)

示例场景二:搞定投稿信

论文写好了,Cover Letter 还没写;或者担心摘要和结论有逻辑冲突。 DeepSeek V3.2 拥有超长上下文窗口,它能一次性分析你的整篇论文,而不是只看一段。

提示词1:生成 Cover Letter

“这是我的论文摘要:[粘贴摘要]。 请为我写一封投给 [具体期刊名,如 Nature Medicine] 的 Cover Letter。 要求:

- 强调本研究在 [你的细分领域,如非小细胞肺癌免疫治疗] 中的临床指导意义。

- 语气要自信且谦逊(Confident but humble)。

- 突出我们的创新点是 [简单描述创新点]。”

实操提示词2:逻辑核查

“请阅读我的全部分析结果(Results)和讨论(Discussion)部分(已粘贴在下方)。 请检查是否存在数据结论与讨论观点不一致的地方?如果存在逻辑漏洞,请列出具体的修改建议。”

示例场景三:高情商回复审稿人

收到拒稿重投或大修意见,审稿人提出了很难实现的要求(比如补一个耗时半年的实验,或者质疑样本量太小)。心态崩了,想怼回去但不敢。 这时候,让 DeepSeek 帮你提供情绪价值和高情商话术。

提示词:

“审稿人提出了这个刁钻问题:'[复制审稿人问题,例如:Why is the sample size so small?]' 实际情况是:我们的样本量受限于该罕见病的特性,这已经是目前全球最大的单中心队列了。

请帮我生成一段回复(Response):

- 首先感谢他的专业建议。

- 委婉但坚定地解释我们的客观困难,并强调数据的珍贵性。

- 引用统计学原理说明当前的 Power 是足够的(如果适用)。

- 语气要极其礼貌,展现出我们对学术严谨性的尊重。”

结语

DeepSeek V3.2 的出现,让数据不出域的科研辅助成为了可能。它不仅能帮我们省下几千块的润色费,更能保护我们核心数据的安全。

最后有两个避坑指南,请务必遵守:

- 警惕幻觉:AI 生成的参考文献有时候是它瞎编的。所有 AI 列出的文献,必须去 PubMed 二次核实。

- 数据红线:具体的用药剂量、P值大小,AI 可能会改错,涉及数字的地方必须人工核对。