提到大模型应用开发,很多人会误以为是在浏览器中与 AI 闲聊 —— 但事实远非如此。真正的开发核心,是通过调用大模型暴露的 API 接口,实现程序化、定制化的交互。要迈出这一步,企业首先需要解决 “模型可访问” 的问题,而这通常有三种主流路径可供选择,每种路径都各有优劣,需结合业务需求权衡。

一、三大模型部署方案:取舍之间见真章

大模型的部署本质是 “算力与数据的平衡”,不同部署方式在成本、安全性、维护难度上差异显著,以下是详细解析:

直接使用开放大模型 API

这是最便捷的入门方案,无需关注底层部署,直接调用第三方平台提供的接口即可。

- 核心优势:零部署成本、零维护压力,按实际调用量付费,前期投入极低;新用户通常能获得百万 token 的免费额度,足够初期测试与小规模开发。

- 潜在短板:过度依赖平台稳定性,若服务商出现故障会直接影响业务;长期高频调用后成本累积较高;数据需传输至第三方服务器,存在隐私泄露风险,不适合处理敏感信息。

云平台部署私有大模型

在阿里云、腾讯云等主流云平台上搭建专属模型,兼顾便捷性与一定的私密性。

- 核心优势:前期投入可控,云厂商提供成熟的部署工具与运维支持,上手快;依托云服务器的网络资源,调用延迟较低,响应更流畅。

- 潜在短板:数据仍存储在云厂商服务器中,隐私安全依赖平台保障;长期使用需支付服务器租金与算力费用,总成本随规模增长而上升。

本地服务器部署私有大模型

将模型部署在企业自有服务器上,是安全性最高的方案(注:此处 “本地” 特指公司专属服务器,而非个人电脑)。

- 核心优势:数据完全自主掌控,从根源上规避隐私泄露风险;不依赖外部网络与平台,业务稳定性更强;虽初期硬件投入大,但长期无持续付费成本,规模越大越划算。

- 潜在短板:初期需购置高性能服务器(大模型对算力要求极高),部署门槛高;需配备专业运维团队维护服务器与模型,技术成本较高。

重要提醒:个人电脑不适合部署实用级大模型!大模型所需算力远超普通电脑承载范围,个人电脑部署的多为阉割蒸馏版,推理能力大幅衰减;且目前市面上有大量免费的满血版模型服务可供调用,完全无需自行折腾。仅当需要进行模型微调或技术测试时,才考虑在个人电脑上临时部署。

二、实战演示:两种核心部署方式操作指南(Java 专属)

了解部署方案后,我们通过具体案例,手把手教你实现 “开放 API 调用” 与 “本地手动部署”,并提供完整 Java 代码示例,快速打通大模型应用开发的第一步。

(一)开放大模型服务:阿里云百炼 Java API 调用完整教程

国内主流云厂商均提供 Java SDK 或 RESTful API,以下以阿里云百炼为例,提供从环境配置到代码运行的全流程教程,包含非流式、流式两种调用方式(最常用场景)。

前置准备(已完成可跳过)

- 注册阿里云账号并开通百炼服务

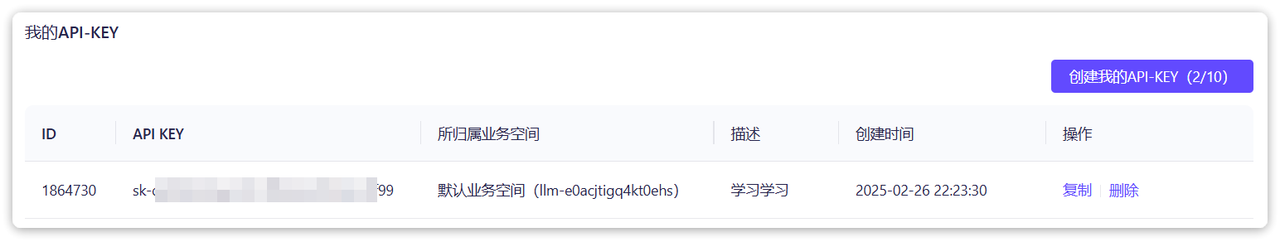

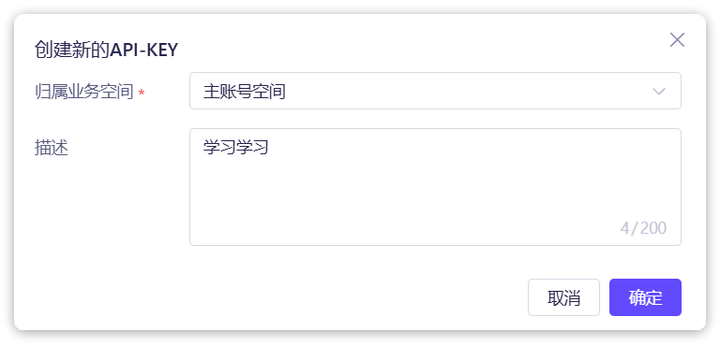

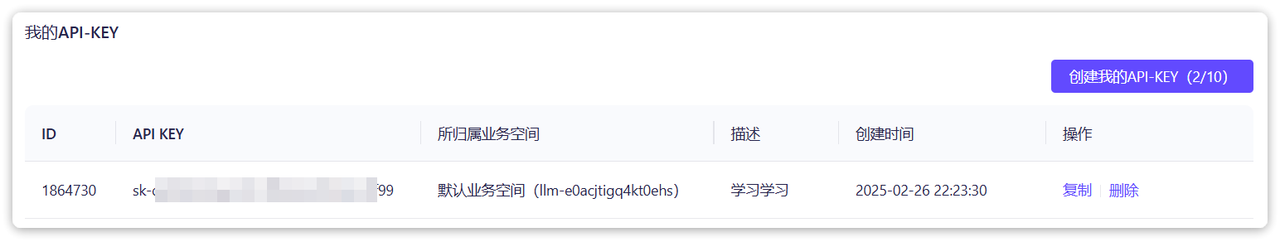

- 申请 API-KEY(AccessKey ID + AccessKey Secret):百炼平台右上角→用户图标→API-KEY→创建,保存好这两个密钥(后续代码需用到)

- 确认账号有可用 token 额度(新用户默认赠送百万 token)

Java 环境配置(Maven)

在项目的pom.xml中添加阿里云 SDK 依赖(推荐使用官方 SDK,简化签名流程):

<!-- 阿里云核心SDK(用于签名) -->

<dependency>

<groupId>com.aliyun</groupId>

<artifactId>aliyun-java-sdk-core</artifactId>

<version>4.6.0</version> <!-- 推荐使用最新版本 -->

</dependency>

<!-- 百炼大模型SDK(专门用于调用大模型接口) -->

<dependency>

<groupId>com.aliyun</groupId>

<artifactId>aliyun-java-sdk-bailian</artifactId>

<version>1.0.0</version> <!-- 若找不到可直接用RESTful方式,下文两种都提供 -->

</dependency>

<!-- HTTP客户端(用于RESTful调用备选) -->

<dependency>

<groupId>org.apache.httpcomponents</groupId>

<artifactId>httpclient</artifactId>

<version>4.5.13</version>

</dependency>

<!-- JSON解析(FastJSON) -->

<dependency>

<groupId>com.alibaba</groupId>

<artifactId>fastjson</artifactId>

<version>2.0.32</version>

</dependency>

Java 代码实现(两种调用方式)

方式一:使用官方 SDK 调用(推荐,无需手动签名)

适用于追求简洁、稳定的场景,SDK 已封装签名、请求格式等细节:

import com.aliyuncs.DefaultAcsClient;

import com.aliyuncs.IAcsClient;

import com.aliyuncs.exceptions.ClientException;

import com.aliyuncs.exceptions.ServerException;

import com.aliyuncs.profile.DefaultProfile;

import com.aliyuncs.bailian.model.v20240228.ChatRequest;

import com.aliyuncs.bailian.model.v20240228.ChatResponse;

import com.google.gson.Gson;

public class BailianSdkDemo {

private static final String ACCESS_KEY_ID = "你的AccessKey ID";

private static final String ACCESS_KEY_SECRET = "你的AccessKey Secret";

private static final String ENDPOINT = "bailian.aliyuncs.com";

private static final String MODEL_NAME = "qwen-turbo";

public static void main(String[] args) {

DefaultProfile profile = DefaultProfile.getProfile(

"cn-hangzhou",

ACCESS_KEY_ID,

ACCESS_KEY_SECRET

);

IAcsClient client = new DefaultAcsClient(profile);

ChatRequest request = new ChatRequest();

request.setEndpoint(ENDPOINT);

request.setMethod("POST");

ChatRequest.Message message = new ChatRequest.Message();

message.setRole("user");

message.setContent("用Java写一个单例模式的示例代码");

ChatRequest.Message systemMsg = new ChatRequest.Message();

systemMsg.setRole("system");

systemMsg.setContent("你是一个Java技术专家,回答简洁准确,只给代码和必要注释");

request.setMessages(java.util.Arrays.asList(systemMsg, message));

request.setModel(MODEL_NAME);

request.setTemperature(0.7);

try {

ChatResponse response = client.getAcsResponse(request);

String result = response.getOutput().getChoices().get(0).getMessage().getContent();

System.out.println("模型响应:\n" + result);

} catch (ServerException e) {

e.printStackTrace();

System.err.println("服务端错误:" + e.getErrCode() + " - " + e.getErrMsg());

} catch (ClientException e) {

e.printStackTrace();

System.err.println("客户端错误:" + e.getErrCode() + " - " + e.getErrMsg());

}

}

}

方式二:RESTful API 调用(无 SDK 场景,手动签名)

若官方 SDK 不可用,可直接调用 HTTP 接口,需手动实现阿里云签名逻辑(关键步骤):

import org.apache.http.HttpEntity;

import org.apache.http.client.methods.CloseableHttpResponse;

import org.apache.http.client.methods.HttpPost;

import org.apache.http.entity.StringEntity;

import org.apache.http.impl.client.CloseableHttpClient;

import org.apache.http.impl.client.HttpClients;

import org.apache.http.util.EntityUtils;

import com.alibaba.fastjson.JSONObject;

import javax.crypto.Mac;

import javax.crypto.spec.SecretKeySpec;

import java.nio.charset.StandardCharsets;

import java.util.Base64;

import java.util.Date;

import java.util.HashMap;

import java.util.Map;

public class BailianRestDemo {

private static final String ACCESS_KEY_ID = "你的AccessKey ID";

private static final String ACCESS_KEY_SECRET = "你的AccessKey Secret";

private static final String API_URL = "https://bailian.aliyuncs.com/api/v1/chat/completions";

public static void main(String[] args) {

try (CloseableHttpClient httpClient = HttpClients.createDefault()) {

JSONObject requestBody = new JSONObject();

requestBody.put("model", "qwen-turbo");

requestBody.put("temperature", 0.7);

JSONObject systemMsg = new JSONObject();

systemMsg.put("role", "system");

systemMsg.put("content", "Java技术专家,只给代码");

JSONObject userMsg = new JSONObject();

userMsg.put("role", "user");

userMsg.put("content", "写一个Java线程池示例");

requestBody.put("messages", new JSONObject[]{systemMsg, userMsg});

String timestamp = String.valueOf(new Date().getTime());

String nonce = String.valueOf(System.currentTimeMillis());

String signature = generateSignature(ACCESS_KEY_SECRET, timestamp, nonce, requestBody.toString());

HttpPost httpPost = new HttpPost(API_URL);

httpPost.setHeader("Content-Type", "application/json; charset=utf-8");

httpPost.setHeader("X-ALIBABA-CLOUD-ACCESS-KEY-ID", ACCESS_KEY_ID);

httpPost.setHeader("X-ALIBABA-CLOUD-TIMESTAMP", timestamp);

httpPost.setHeader("X-ALIBABA-CLOUD-NONCE", nonce);

httpPost.setHeader("X-ALIBABA-CLOUD-SIGNATURE", signature);

httpPost.setHeader("X-ALIBABA-CLOUD-SIGNATURE-METHOD", "HMAC-SHA256");

httpPost.setEntity(new StringEntity(requestBody.toString(), StandardCharsets.UTF_8));

try (CloseableHttpResponse response = httpClient.execute(httpPost)) {

HttpEntity entity = response.getEntity();

if (entity != null) {

String result = EntityUtils.toString(entity, StandardCharsets.UTF_8);

JSONObject jsonResult = JSONObject.parseObject(result);

String content = jsonResult.getJSONArray("choices").getJSONObject(0)

.getJSONObject("message").getString("content");

System.out.println("模型响应:\n" + content);

}

}

} catch (Exception e) {

e.printStackTrace();

}

}

private static String generateSignature(String secret, String timestamp, String nonce, String body) throws Exception {

String signStr = body + "\n" + timestamp + "\n" + nonce;

Mac mac = Mac.getInstance("HmacSHA256");

SecretKeySpec secretKeySpec = new SecretKeySpec(secret.getBytes(StandardCharsets.UTF_8), "HmacSHA256");

mac.init(secretKeySpec);

byte[] signBytes = mac.doFinal(signStr.getBytes(StandardCharsets.UTF_8));

return Base64.getEncoder().encodeToString(signBytes);

}

}

方式三:流式调用(实时返回结果,类似 ChatGPT 对话体验)

适用于需要实时展示响应的场景(如聊天界面),Java 中通过读取流实现:

import org.apache.http.client.methods.HttpPost;

import org.apache.http.entity.StringEntity;

import org.apache.http.impl.client.CloseableHttpClient;

import org.apache.http.impl.client.HttpClients;

import com.alibaba.fastjson.JSONObject;

import java.io.BufferedReader;

import java.io.InputStreamReader;

import java.nio.charset.StandardCharsets;

public class BailianStreamDemo {

private static final String ACCESS_KEY_ID = "你的AccessKey ID";

private static final String ACCESS_KEY_SECRET = "你的AccessKey Secret";

private static final String API_URL = "https://bailian.aliyuncs.com/api/v1/chat/completions";

public static void main(String[] args) {

try (CloseableHttpClient httpClient = HttpClients.createDefault()) {

JSONObject requestBody = new JSONObject();

requestBody.put("model", "qwen-turbo");

requestBody.put("temperature", 0.7);

requestBody.put("stream", true);

JSONObject userMsg = new JSONObject();

userMsg.put("role", "user");

userMsg.put("content", "解释Java中的异常处理机制,分点说明");

requestBody.put("messages", new JSONObject[]{userMsg});

String timestamp = String.valueOf(new Date().getTime());

String nonce = String.valueOf(System.currentTimeMillis());

String signature = generateSignature(ACCESS_KEY_SECRET, timestamp, nonce, requestBody.toString());

HttpPost httpPost = new HttpPost(API_URL);

httpPost.setHeader("Content-Type", "application/json; charset=utf-8");

httpPost.setHeader("X-ALIBABA-CLOUD-ACCESS-KEY-ID", ACCESS_KEY_ID);

httpPost.setHeader("X-ALIBABA-CLOUD-TIMESTAMP", timestamp);

httpPost.setHeader("X-ALIBABA-CLOUD-NONCE", nonce);

httpPost.setHeader("X-ALIBABA-CLOUD-SIGNATURE", signature);

httpPost.setEntity(new StringEntity(requestBody.toString(), StandardCharsets.UTF_8));

CloseableHttpResponse response = httpClient.execute(httpPost);

BufferedReader reader = new BufferedReader(

new InputStreamReader(response.getEntity().getContent(), StandardCharsets.UTF_8)

);

String line;

System.out.println("流式响应(实时输出):");

while ((line = reader.readLine()) != null) {

if (line.startsWith("data: ")) {

String data = line.substring(6);

if ("[DONE]".equals(data)) {

break;

}

JSONObject json = JSONObject.parseObject(data);

String content = json.getJSONArray("choices").getJSONObject(0)

.getJSONObject("delta").getString("content");

if (content != null) {

System.out.print(content);

}

}

}

reader.close();

response.close();

} catch (Exception e) {

e.printStackTrace();

}

}

private static String generateSignature(String secret, String timestamp, String nonce, String body) throws Exception {

String signStr = body + "\n" + timestamp + "\n" + nonce;

Mac mac = Mac.getInstance("HmacSHA256");

SecretKeySpec secretKeySpec = new SecretKeySpec(secret.getBytes(StandardCharsets.UTF_8), "HmacSHA256");

mac.init(secretKeySpec);

byte[] signBytes = mac.doFinal(signStr.getBytes(StandardCharsets.UTF_8));

return Base64.getEncoder().encodeToString(signBytes);

}

}

代码运行注意事项

- 替换ACCESS_KEY_ID和ACCESS_KEY_SECRET为你的实际密钥,切勿泄露到代码仓库

- 模型名需在百炼平台模型广场存在(如 qwen-turbo、deepseek-r1、llama3 等)

- 若出现 “签名错误”,检查generateSignature方法的拼接字符串是否正确(百炼 API 的签名规则需包含请求体)

- 免费 token 耗尽后会提示 “额度不足”,需前往阿里云控制台充值

(二)本地手动部署:Ollama + Java 接口调用教程

Ollama 部署本地模型后,会提供 HTTP 接口,Java 可通过调用该接口实现与本地模型的交互,无需依赖第三方平台。

Ollama 部署前置步骤(详细补充)

1.1 下载安装 Ollama(自定义路径 + 环境变量)

- 官网下载 OllamaSetup.exe

注意:

Ollama默认安装目录是C盘的用户目录,如果不希望安装在C盘的话(其实C盘如果足够大放C盘也没事),就不能直接双击安装了。需要通过命令行安装。

- 自定义安装路径(避免 C 盘占用):

- 打开 cmd,进入 OllamaSetup.exe 所在目录

- 执行命令:OllamaSetup.exe /DIR=D:\ProgramFiles\Ollama(替换为你的路径)

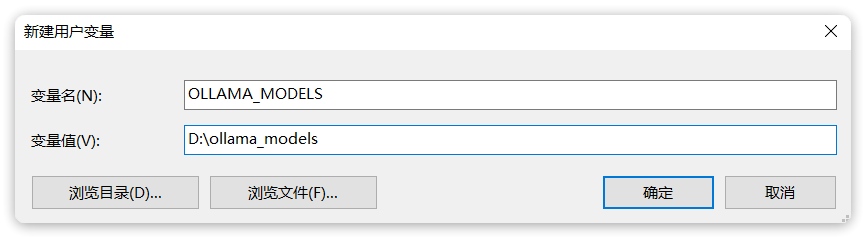

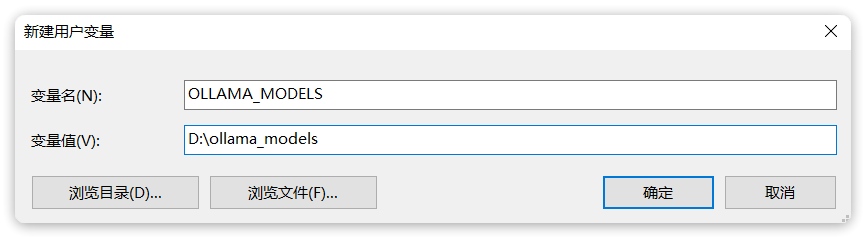

- 配置环境变量(指定模型存储路径):

- 右键 “此电脑”→属性→高级系统设置→环境变量

- 系统变量→新建:变量名OLLAMA_MODELS,变量值D:\Ollama\Models(自定义路径)

- 重启 cmd,执行ollama --version验证安装成功

1.2 下载并运行模型(以 deepseek-r1:7b 为例)

- 打开 cmd,执行命令:ollama run deepseek-r1:7b

- 首次运行会自动下载模型(约 4GB,耗时取决于网络,建议挂加速器)

- 下载完成后自动进入交互界面,测试模型是否正常:输入 “你好”,若有响应则部署成功

注意:

- 首次运行命令需要下载模型,根据模型大小不同下载时长在5分钟~1小时不等,请耐心等待下载完成。

- ollama控制台是一个封装好的AI对话产品,与ChatGPT类似,具备会话记忆功能。

1.3 启动 Ollama HTTP 服务(关键:让 Java 能调用)

- 新打开一个 cmd,执行命令:ollama serve(启动 HTTP 服务,默认端口 11434)

- 验证服务:浏览器访问http://localhost:11434,若显示 “Ollama API is running” 则成功

- Ollama是一个模型管理工具,有点像Docker,而且命令也很像,比如:

ollama serve # Start ollama

ollama create # Create a model from a Modelfile

ollama show # Show information for a model

ollama run # Run a model

ollama stop # Stop a running model

ollama pull # Pull a model from a registry

ollama push # Push a model to a registry

ollama list # List models

ollama ps # List running models

ollama cp # Copy a model

ollama rm # Remove a model

ollama help # Help about any command

Java 调用本地 Ollama 接口(完整代码)

Ollama 的 HTTP 接口简洁,无需签名,直接发送 JSON 请求即可,支持非流式和流式调用:

方式一:非流式调用(等待完整响应)

import org.apache.http.client.methods.HttpPost;

import org.apache.http.entity.StringEntity;

import org.apache.http.impl.client.CloseableHttpClient;

import org.apache.http.impl.client.HttpClients;

import org.apache.http.util.EntityUtils;

import com.alibaba.fastjson.JSONObject;

public class OllamaLocalDemo {

private static final String OLLAMA_URL = "http://localhost:11434/api/chat";

public static void main(String[] args) {

try (CloseableHttpClient httpClient = HttpClients.createDefault()) {

JSONObject requestBody = new JSONObject();

requestBody.put("model", "deepseek-r1:7b");

requestBody.put("stream", false);

JSONObject userMsg = new JSONObject();

userMsg.put("role", "user");

userMsg.put("content", "用Java写一个冒泡排序算法");

JSONObject systemMsg = new JSONObject();

systemMsg.put("role", "system");

systemMsg.put("content", "只输出代码和简要注释,不多余解释");

requestBody.put("messages", new JSONObject[]{systemMsg, userMsg});

requestBody.put("temperature", 0.5);

HttpPost httpPost = new HttpPost(OLLAMA_URL);

httpPost.setHeader("Content-Type", "application/json; charset=utf-8");

httpPost.setEntity(new StringEntity(requestBody.toString(), "UTF-8"));

CloseableHttpResponse response = httpClient.execute(httpPost);

String result = EntityUtils.toString(response.getEntity(), "UTF-8");

JSONObject jsonResult = JSONObject.parseObject(result);

String content = jsonResult.getJSONArray("messages").getJSONObject(0).getString("content");

System.out.println("本地模型响应:\n" + content);

response.close();

} catch (Exception e) {

e.printStackTrace();

System.err.println("调用失败:检查Ollama服务是否启动(ollama serve),模型名是否正确");

}

}

}

方式二:流式调用(本地模型实时响应)

import org.apache.http.client.methods.HttpPost;

import org.apache.http.entity.StringEntity;

import org.apache.http.impl.client.CloseableHttpClient;

import org.apache.http.impl.client.HttpClients;

import com.alibaba.fastjson.JSONObject;

import java.io.BufferedReader;

import java.io.InputStreamReader;

import java.nio.charset.StandardCharsets;

public class OllamaStreamDemo {

private static final String OLLAMA_URL = "http://localhost:11434/api/chat";

public static void main(String[] args) {

try (CloseableHttpClient httpClient = HttpClients.createDefault()) {

JSONObject requestBody = new JSONObject();

requestBody.put("model", "deepseek-r1:7b");

requestBody.put("stream", true);

requestBody.put("temperature", 0.6);

JSONObject userMsg = new JSONObject();

userMsg.put("role", "user");

userMsg.put("content", "解释什么是Java中的泛型,举一个实际应用场景");

requestBody.put("messages", new JSONObject[]{userMsg});

HttpPost httpPost = new HttpPost(OLLAMA_URL);

httpPost.setHeader("Content-Type", "application/json; charset=utf-8");

httpPost.setEntity(new StringEntity(requestBody.toString(), StandardCharsets.UTF_8));

CloseableHttpResponse response = httpClient.execute(httpPost);

BufferedReader reader = new BufferedReader(

new InputStreamReader(response.getEntity().getContent(), StandardCharsets.UTF_8)

);

String line;

System.out.println("本地模型流式响应:");

while ((line = reader.readLine()) != null) {

JSONObject json = JSONObject.parseObject(line);

String content = json.getJSONObject("message").getString("content");

if (content != null) {

System.out.print(content);

}

}

reader.close();

response.close();

} catch (Exception e) {

e.printStackTrace();

System.err.println("流式调用失败:确保Ollama服务已启动,且模型正在运行");

}

}

}

Ollama 部署与 Java 调用避坑指南

- 模型选择:32G 内存 + 6G 显存推荐 deepseek-r1:7b/8b、llama3:8b;16G 内存推荐 phi3:3.8b(轻量化模型)

- 服务启动:必须先执行ollama serve启动 HTTP 服务,否则 Java 无法连接(端口 11434)

- 模型运行:若提示 “显存不足”,关闭其他占用显卡的程序,或选择更小参数的模型

- 网络问题:本地调用无需联网,完全离线运行,数据安全有保障

- 命令行操作:常用 Ollama 命令(部署后管理模型):

- ollama list:查看已下载的模型

- ollama stop deepseek-r1:7b:停止运行中的模型

- ollama rm deepseek-r1:7b:删除不需要的模型(释放磁盘空间)

(三)Java 开发关键补充:token 计算与成本控制

- token 计算逻辑:1 个汉字≈2 个 token,1 个英文单词≈1 个 token,请求 + 响应都会消耗 token

- 成本估算:阿里云百炼百万 token≈1-3 元,小规模应用(日调用 10 万 token)每月成本约 30 元

- Java 中 token 预估:可使用第三方库(如com.knuddels:jtokkit)提前估算 token 数,避免超额:

<!-- token估算依赖 -->

<dependency>

<groupId>com.knuddels</groupId>

<artifactId>jtokkit</artifactId>

<version>0.6.1</version>

</dependency>

代码示例:

import com.knuddels.jtokkit.Encodings;

import com.knuddels.jtokkit.api.Encoding;

import com.knuddels.jtokkit.api.EncodingRegistry;

import com.knuddels.jtokkit.api.ModelType;

public class TokenEstimator {

public static void main(String[] args) {

EncodingRegistry registry = Encodings.newDefaultEncodingRegistry();

Encoding encoding = registry.getEncodingForModel(ModelType.GPT_3_5_TURBO);

String text = "用Java写一个单例模式的示例代码";

int tokenCount = encoding.countTokens(text);

System.out.println("文本token数:" + tokenCount);

}

}

(四)总结:Java 开发者的大模型部署选择建议

- 快速验证需求:优先使用开放 API(阿里云百炼),Java 代码复制即用,无需关注部署

- 敏感数据场景:选择本地部署(Ollama),数据完全离线,Java 调用简单无依赖

- 中长期项目:若调用量较大,本地部署成本更低;若缺乏运维资源,云平台私有部署更稳妥

通过以上 Java 代码示例,你可以快速实现大模型的 API 调用与本地部署交互。实际开发中,可根据业务需求封装工具类(如统一的 HTTP 客户端、签名工具、异常处理),提高代码复用性。如果需要对接其他平台(如百度千帆、腾讯 TI)或实现更复杂的功能(如多轮对话记忆、模型微调),可以随时扩展!