《AI 并不神秘》系列 · 第二篇 没有线性代数,就没有神经网络:AI 的“骨架”到底是什么?

如果说第一篇,我们拆掉的是对 AI 的认知幻想,那么这一篇,我们要回答一个更底层、也更关键的问题:

AI 的能力,究竟是“从哪里长出来的”?

很多人会说是“算法”、是“模型”、是“神经网络”。

但如果继续往下追问,就会触及一个常被忽略的事实:

AI 并不是建立在“灵感”或“类人思维”之上,而是建立在一门极其冷静的数学工具之上——线性代数。

一、先给结论:神经网络不是“神经”,而是“结构化计算系统”

“神经网络”这个名字,非常成功,也非常容易误导人。

它让人联想到:

- 大脑

- 神经元

- 学习与思考

但从严格意义上说,神经网络与生物神经系统几乎没有一一对应关系。它真正对应的,不是大脑,而是函数系统。

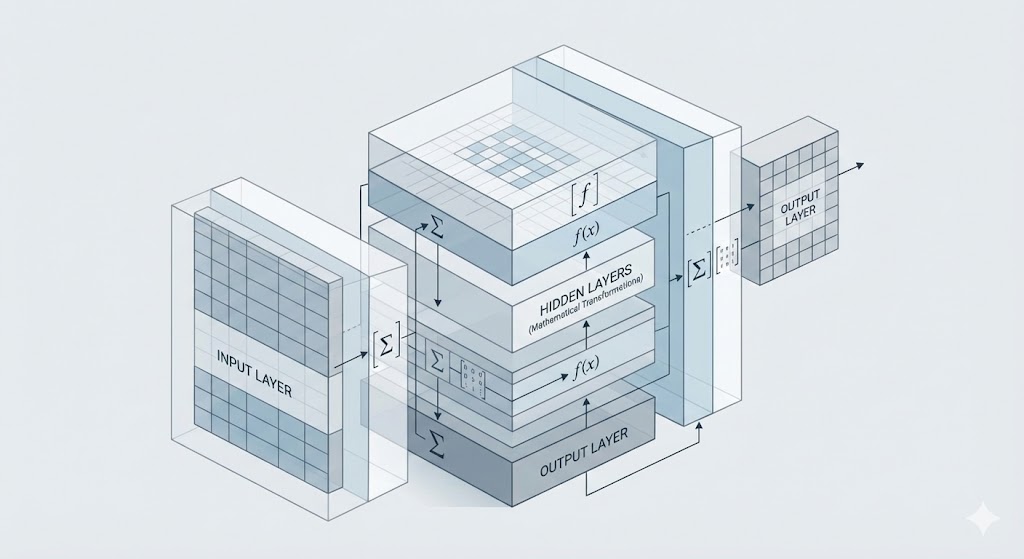

更准确地说:神经网络 = 大量线性变换 + 少量非线性修正的组合结构。

而这整套结构,完全建立在线性代数之上。

二、在 AI 眼里,世界不是“事物”,而是“向量”

要理解线性代数为什么如此重要,必须先接受一个事实:AI 并不直接处理现实世界,它只处理“向量”。

1️⃣ 什么是向量?为什么 AI 离不开它?

在数学中,向量不是“箭头”,而是一种更本质的东西:一组有序的数,用来描述一个对象在多个维度上的位置。

在 AI 系统中:

- 一张图片 → 一个高维向量

- 一句话 → 一个向量序列

- 一个用户 → 一个行为特征向量

换句话说:现实世界,必须先被“压缩”为向量,才能进入 AI 的计算体系。

没有向量,就没有“输入”;没有输入,就不可能有任何“智能表现”。

2️⃣ 向量的真正价值:可比较、可计算、可扩展

一旦一切被表示为向量,就会发生三件极其重要的事情:

- 可以计算“相似度”

- 可以进行“组合与变换”

- 可以在维度上不断扩展

这正是 AI 擅长的事情。

AI 并不理解“猫是什么”,但它可以判断“这张图片与另一张图片有多像”。

而“像不像”,在数学上,就是向量之间的距离或角度。

三、神经网络的每一层,本质上都在做同一件事

无论模型多复杂,神经网络的每一层,本质上都在重复一个极其朴素的操作:线性变换。

1️⃣ 一层神经网络在数学上意味着什么?

从数学角度看,一层神经网络可以被描述为:

- 一个矩阵

- 乘以一个向量

- 再加上一个偏置项

也就是说:每一层网络,本质上都是一次矩阵运算。

所谓“深度学习”,并不是机器学会了更高层次的思考,而是矩阵变换被重复了很多次。

2️⃣ 那“非线性”又是怎么回事?

如果只有线性变换,模型的能力其实非常有限。

真正让神经网络“变得有用”的,是在线性变换之后,引入了:非线性函数。

但即便如此,非线性并不是主角,它更像是对线性结构的“微调装置”。

AI 的主体骨架,依然是线性代数。

四、为什么 AI 一定要“做大”?这是线性代数决定的

很多人会问:为什么模型越做越大?为什么参数动辄上百亿、上万亿?

这个问题,表面看是工程问题,但根源,其实是一个数学问题。

1️⃣ 模型变大,本质是“维度变高”

在数学空间中:

- 维度越低,可表示的结构越有限

- 维度越高,可逼近的模式越复杂

而神经网络“变大”,意味着:向量维度更高,矩阵规模更大,可表示的关系更精细。

这不是贪婪,而是线性代数天然的扩展路径。

2️⃣ 为什么“规模”会带来质变?

当参数规模足够大时,模型可以:

- 同时拟合多种复杂模式

- 在不同任务间共享表示结构

于是,“能力涌现”就出现了。

但需要强调的是:这不是意识的涌现,而是表示能力的涌现。

五、小结|AI 的骨架,是数学,而不是类人思维

如果用一句话总结这一篇:AI 的强大,不来自“像人”,而来自“数学足够稳定、足够可扩展”。

- 世界 → 向量

- 认知 → 矩阵变换

- 学习 → 参数调整

这一切,都牢牢地建立在线性代数之上。

📌 没有线性代数,就不会有神经网络;没有神经网络,也就不会有今天的 AI。

💬 你如何理解“模型越大越强”?

- 你觉得这是工程堆砌,还是数学必然?

- 在你看来,AI 的能力边界,更可能来自哪里:

- 🅰 数学表示

- 🅱 算力限制

- 🅲 数据质量

欢迎在评论区分享你的判断 👇

下一篇,我们将继续向下追问一个更根本的问题:

➡️ 《AI 为什么只能“更可能”,而无法保证“正确”?——概率论如何塑造 AI 的判断方式》