《AI 并不神秘》系列 · 第四篇 数学早就有了,为什么 AI 却直到今天才真正出现?

当人们回顾 AI 的发展史时,常常会产生一种错觉:是不是最近几年,数学或算法突然有了重大突破?

但如果你仔细梳理就会发现一个反直觉的事实:

- 线性代数:19 世纪

- 概率论:18 世纪

- 梯度下降:19 世纪末

- 神经元模型:20 世纪中叶

支撑 AI 的核心数学工具,早在几十甚至上百年前就已经存在。

那问题就变成了:如果“原理早就有了”,为什么 AI 却直到今天才真正改变世界?

一、先给结论:AI 不是“理论突破”,而是“条件成熟”

与很多人想象的不同,AI 并不是一次类似相对论那样的理论革命。AI 的出现,更像是一种“工程条件终于满足”的结果。

换句话说:

- 数学并没有突然变新

- 算法并没有突然变聪明

- 世界只是终于“允许它们跑起来了”

二、第一道真正的门槛:算力

如果只从原理看,AI 早在上世纪就已经“可行”。但在现实中,它长期停留在实验室阶段,原因只有一个:算不动。

1️⃣ 神经网络一直存在,但“跑不起”

早期的神经网络模型并不比今天少多少想法,问题在于:

- 参数规模稍大

- 训练时间就以“年”为单位

这使得很多算法在理论上成立,在现实中不可用。

2️⃣ GPU 的意义,不是“更快”,而是“刚好适配”

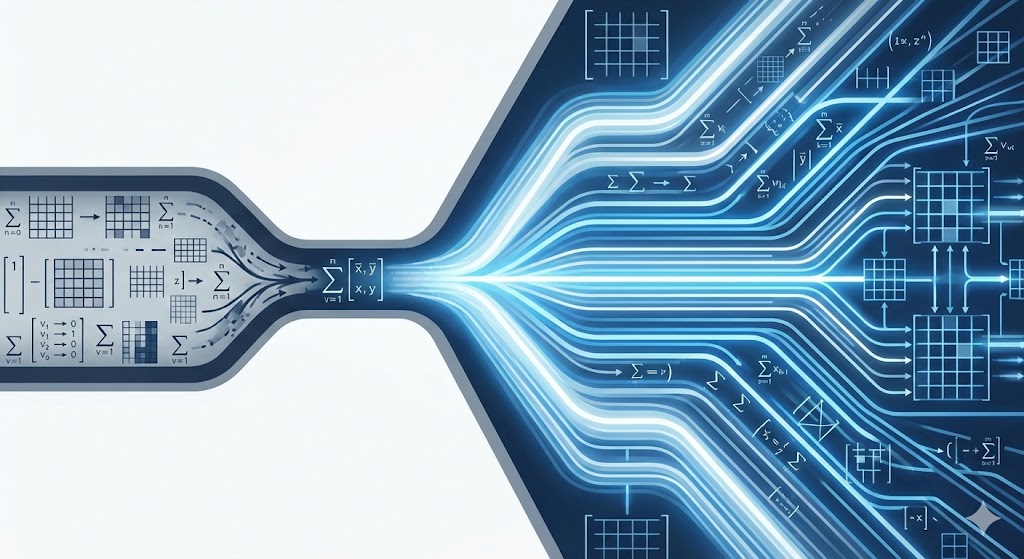

AI 的核心计算任务是什么?矩阵运算。

而 GPU 的天赋恰恰在于:

- 并行计算

- 大规模数值运算

- 高吞吐而非低延迟

这并不是 AI 为 GPU 而生,而是 GPU 意外地成为了 AI 最合适的“发动机”。

三、第二道门槛:数据

即使算力足够,如果没有数据,AI 依然什么都学不到。

1️⃣ 过去的问题:世界还不“可统计”

在很长一段时间里:

- 人类行为没有被系统记录

- 文本、图像、声音难以规模化收集

- 数据高度零散、不可用

AI 想“学习世界”,但世界本身还没被数字化。

2️⃣ 互联网做了一件决定性的事

互联网并不是直接创造了 AI,但它完成了一件关键任务:把世界变成了可被统计的数据。

搜索、社交、内容平台、传感器……人类第一次在整体层面上,被转化为数据流。AI 不再面对“样本稀缺”,而是第一次被真正“喂饱”。

四、第三个条件:工程化,而不是灵感

很多人仍然以为,AI 的进步来自“某个天才想法”。

但现实更接近于:把一个并不新颖的思路,反复做到极致。

1️⃣ 深度学习的成功,并不浪漫

它依赖的是:

- 更大的模型

- 更多的数据

- 更长时间的训练

- 更复杂的工程系统

这是一个极端工程化、极度不浪漫的过程。

2️⃣ 为什么突破看起来像“突然发生”?

因为当三个条件同时满足时:

- 算力足够

- 数据足够

- 工程系统稳定

误差曲线会在某个阶段迅速下降,能力看起来像是“突然出现”。但那并不是灵光一现,而是长期积累后的临界点。

五、为什么是 2010 年之后?

如果必须选一个时间段,那大多数 AI 的关键转折点,确实发生在:2010 年之后。

原因很简单:

- GPU 成熟并普及

- 深度学习框架工程化

- 数据规模进入指数级增长

这不是偶然,而是多条技术路径的自然交汇。

六、小结|AI 的出现,并不是奇迹

如果用一句话总结这一篇:AI 并不是突然出现的智能,而是数学在算力、数据和工程条件成熟后的一次集中释放。

这也意味着:

- AI 的能力来自现实条件

- 它的边界,同样受现实条件约束

理解这一点,有助于我们既不过度神化 AI,也不会低估它真正的潜力。

💬 你认为 AI 爆发的“决定性因素”是什么?

- 算力?

- 数据?

- 工程能力?

- 还是它们缺一不可?

欢迎在评论区分享你的判断 👇

下一篇,我们将进入这个系列的最后一部分:

➡️ 《AI 会削弱数学的重要性吗?——为什么 AI 时代,数学反而更关键了》