CANN内存管理机制:从分配策略到性能优化 昇腾CANN训练营简介 :华为昇腾CANN训练营为开发者提供高质量AI学习课程、开发环境和免费算力,助力开发者从0基础学习到AI技术落地。参与训练营可获得昇腾算力体验券、技术认证证书、实战项目经验等丰富资源。

立即报名 :昇腾CANN训练营官方报名链接

1. CANN内存管理架构概述 1.1 内存管理在异构计算中的重要性 在AI计算场景中,内存管理是影响系统性能的关键因素。昇腾AI处理器作为专用的AI加速芯片,其内存管理与传统CPU、GPU存在显著差异。CANN(Compute Architecture for Neural Networks)作为华为针对AI场景推出的异构计算架构,提供了一套完整的内存管理解决方案,能够充分发挥昇腾硬件的并行计算能力。

内存管理的核心挑战包括:

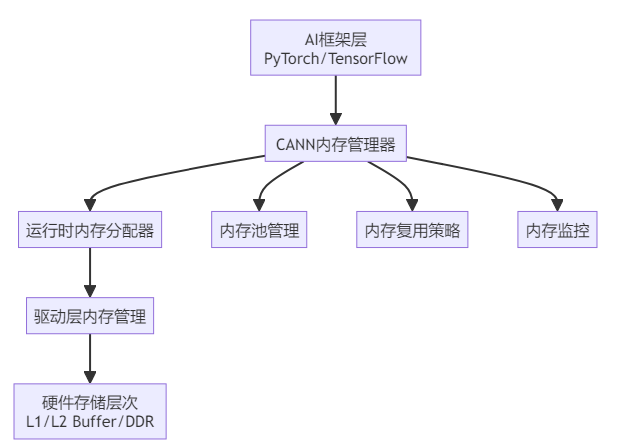

带宽限制 :内存访问带宽成为AI计算的主要瓶颈延迟敏感 :大规模矩阵运算对内存延迟极其敏感容量约束 :大模型训练推理需要巨大的内存空间异构特性 :不同类型计算单元需要不同的内存访问模式1.2 CANN内存管理架构层次 CANN内存管理采用分层设计,从上到下包括:

这种分层架构确保了内存管理的高效性和灵活性,每一层都有明确的职责和优化策略。

2. AI Core存储层次结构深度剖析 2.1 存储层次架构设计 昇腾AI处理器的AI Core采用多级存储架构,主要包括:

L1 Buffer(一级缓存)

L2 Buffer(二级缓存)

DDR内存(主存储)

2.2 存储访问特性分析 不同存储层次的访问特性对比如下:

这种存储层次设计要求CANN必须智能地管理数据在不同层级之间的流动,以最大化利用硬件性能。

3. CANN运行时内存管理机制 3.1 内存分配器设计原理 CANN运行时内存分配器采用分段式管理策略,核心组件包括:

内存池管理器

Plain Bash C++ C# CSS Diff HTML/XML Java Javascript Markdown PHP Python Ruby SQL

class MemoryPool {

private :

void * base_addr;

size_t total_size;

std::list<MemBlock> free_blocks;

std::unordered_map<void *, MemBlock> used_blocks;

public :

void* allocate(size_t size, size_t alignment = 64) ;

void deallocate(void* ptr) ;

void defragment() ;

};

策略说明 :

预分配策略 :应用启动时预分配大块内存,减少运行时分配开销对齐优化 :按硬件要求对齐内存地址(通常64字节对齐)碎片整理 :定期整理内存碎片,提高内存利用率3.2 内存分配算法 CANN采用改进的伙伴系统(Buddy System)算法进行内存分配:

Plain Bash C++ C# CSS Diff HTML/XML Java Javascript Markdown PHP Python Ruby SQL

void* BuddyAllocator::allocate(size_t size) {

size_t block_size = round_up_to_pow2 (size);

int order = get_order (block_size);

if (free_list[order].empty ()) {

split_block (order + 1 );

}

MemBlock* block = free_list[order].front ();

free_list[order].pop_front ();

mark_used (block);

return block->addr;

}

算法优势 :

4. 内存复用与优化策略 4.1 内存复用技术 内存复用是CANN优化的核心技术之一,主要包括:

时间复用 :在不同时间点复用同一块内存

Plain Bash C++ C# CSS Diff HTML/XML Java Javascript Markdown PHP Python Ruby SQL

class MemoryReuse {

struct MemorySlice {

void * addr;

size_t size;

int start_step;

int end_step;

};

std::vector<MemorySlice> schedule_memory_usage(

const std::vector<Operator>& ops) {

auto lifetimes = analyze_memory_lifetimes (ops);

return schedule_with_reuse (lifetimes);

}

};

空间复用 :在内存块内部划分多个区域供不同数据使用

4.2 内存优化策略 策略1:显存剪枝(Memory Pruning)

Plain Bash C++ C# CSS Diff HTML/XML Java Javascript Markdown PHP Python Ruby SQL

def optimize_memory_usage (model ):

memory_map = analyze_memory_requirements(model)

optimized_graph = apply_memory_pruning(

model,

pruning_threshold=0.7

)

return optimized_graph

original_memory = 8.5

optimized_memory = 4.2

reduction = (original_memory - optimized_memory) / original_memory

print (f"内存优化率: {reduction:.1%}" )

策略2:梯度累积

Plain Bash C++ C# CSS Diff HTML/XML Java Javascript Markdown PHP Python Ruby SQL

class GradientAccumulation {

private :

size_t accumulation_steps;

std::vector<Tensor> accumulated_gradients;

public :

void accumulate_gradients(const Tensor& grad, int step) {

int slot = step % accumulation_steps;

accumulated_gradients[slot] += grad;

if (step % accumulation_steps == 0 ) {

update_parameters (accumulated_gradients[slot]);

accumulated_gradients[slot].zero_ ();

}

}

};

5. 大模型场景下的内存优化实践 5.1 大模型内存挑战 大模型(如GPT系列、BERT等)训练和推理面临严峻的内存挑战:

参数存储 :175B参数的GPT-3需要约700GB内存存储FP32参数

中间激活 :深度网络产生大量中间激活值

梯度存储 :训练时需要存储所有参数的梯度

5.2 CANN大模型优化方案 方案1:混合精度训练

Plain Bash C++ C# CSS Diff HTML/XML Java Javascript Markdown PHP Python Ruby SQL

class MixedPrecisionTraining {

public :

void train_step(const Model& model, const DataLoader& data) {

auto activations = forward_fp16(model, data);

auto gradients = backward_fp16 (activations);

update_parameters_fp32 (gradients);

scale_gradients (gradients, loss_scale);

}

private :

float loss_scale = 1024.0f ;

};

混合精度效果 :

方案2:模型并行

Plain Bash C++ C# CSS Diff HTML/XML Java Javascript Markdown PHP Python Ruby SQL

def distribute_model_layers (model, num_devices ):

total_layers = len (model.layers)

layers_per_device = total_layers // num_devices

device_assignments = {}

memory_footprints = {}

for i, layer in enumerate (model.layers):

device_id = i // layers_per_device

device_assignments[i] = device_id

layer_memory = calculate_layer_memory(layer)

memory_footprints[device_id] = memory_footprints.get(

device_id, 0 ) + layer_memory

return device_assignments, memory_footprints

assignments, footprints = distribute_model_layers(gpt_model, 4 )

print (f"各设备内存占用: {footprints}" )

5.3 性能优化案例 案例:Transformer模型优化

Plain Bash C++ C# CSS Diff HTML/XML Java Javascript Markdown PHP Python Ruby SQL

class OptimizedAttention {

public :

Tensor forward(const Tensor& query, const Tensor& key,

const Tensor& value) {

int chunk_size = calculate_optimal_chunk_size (

query.size (), available_memory);

Tensor output;

for (int i = 0 ; i < query.size (0 ); i += chunk_size) {

auto chunk = query.slice (i, i + chunk_size);

auto chunk_output = flash_attention (

chunk, key, value, chunk_size);

output = torch.cat ({output, chunk_output}, dim=0 );

release_temp_memory ();

}

return output;

}

};

优化效果对比 :

6. 内存监控与调试工具 6.1 内存监控API CANN提供丰富的内存监控接口:

Plain Bash C++ C# CSS Diff HTML/XML Java Javascript Markdown PHP Python Ruby SQL

void monitor_memory_usage() {

auto total_mem = aclrtGetMemInfo (ACL_HBM_MEM);

printf ("总内存: %zu MB\n" , total_mem.free >> 20 );

aclError ret = aclmdlSetDatasetDescMemAttr (

dataset, ACL_MEM_MALLOC_HUGE_FIRST);

MemoryTracker tracker;

tracker.start_tracking ();

execute_model (model, input_data);

auto usage_report = tracker.generate_report ();

printf ("峰值内存: %zu MB\n" , usage_report.peak_memory >> 20 );

printf ("内存碎片率: %.1f%%\n" , usage_report.fragmentation_ratio);

}

6.2 内存调试工具 msProf内存分析工具

Plain Bash C++ C# CSS Diff HTML/XML Java Javascript Markdown PHP Python Ruby SQL

export ACL_MEM_DEBUG=1

export MS_PROF_LOG_LEVEL=1

./cann_application

msprof_analyze --memory mem_profile.log

输出示例 :

Plain Bash C++ C# CSS Diff HTML/XML Java Javascript Markdown PHP Python Ruby SQL Memory Analysis Report

=====================

Peak Memory Usage: 4,256 MB

Memory Fragmentation: 12.3%

Allocation Failures: 0

Memory Efficiency: 87.6%

Top Memory Consumers:

1. MatMul Op: 1,856 MB (43.6%)

2. Convolution: 1,234 MB (29.0%)

3. Activation: 567 MB (13.3%)

7. 最佳实践与优化建议 7.1 内存优化最佳实践 实践1:合理的内存预分配

Plain Bash C++ C# CSS Diff HTML/XML Java Javascript Markdown PHP Python Ruby SQL

class OptimizedMemoryManager {

public :

void initialize_model_execution(const Model& model) {

auto memory_plan = analyze_memory_requirements (model);

memory_pool = allocate_memory_pool (

memory_plan.peak_required * 1.2 );

memory_threshold = memory_pool.size () * 0.85 ;

}

void* allocate_with_fallback(size_t size) {

void * ptr = memory_pool.allocate (size);

if (!ptr) {

memory_pool.defragment ();

ptr = memory_pool.allocate (size);

}

if (!ptr) {

return emergency_allocate (size);

}

return ptr;

}

};

实践2:数据流优化

Plain Bash C++ C# CSS Diff HTML/XML Java Javascript Markdown PHP Python Ruby SQL

def create_optimized_dataloader (dataset, batch_size ):

dataloader = DataLoader(

dataset,

batch_size=batch_size,

prefetch_factor=2 ,

num_workers=4

)

if dataset.size() > 10GB:

dataset = MemMappedDataset(dataset)

dataloader = StreamingDataLoader(dataloader)

return dataloader

7.2 性能调优建议 建议1:根据模型特性选择优化策略

CNN模型 :重点优化卷积层的内存访问模式Transformer模型 :重点优化Attention机制和长序列处理大语言模型 :采用模型并行和梯度检查点建议2:平衡内存与计算效率

Plain Bash C++ C# CSS Diff HTML/XML Java Javascript Markdown PHP Python Ruby SQL

class AdaptiveOptimizer {

OptimizationPlan create_plan(const ModelProfile& profile) {

OptimizationPlan plan;

if (profile.memory_pressure > 0.8 ) {

plan.enable_gradient_checkpointing ();

plan.reduce_batch_size (0.5 );

}

if (profile.compute_efficiency < 0.6 ) {

plan.increase_batch_size (1.5 );

plan.disable_gradient_checkpointing ();

}

return plan;

}

};

8. 总结与展望 8.1 技术总结 CANN内存管理机制通过多层次的优化策略,有效解决了AI计算中的内存挑战:

硬件层面 :AI Core多级存储架构提供高带宽、低延迟的数据访问软件层面 :智能内存分配器和复用策略最大化内存利用率优化层面 :针对大模型场景的专门优化技术降低内存需求8.2 未来发展趋势 趋势1:更智能的内存管理

趋势2:硬件-软件协同优化

趋势3:面向超大模型的突破

8.3 讨论问题 通过深入理解CANN内存管理机制,开发者可以更好地优化AI应用的性能,为昇腾AI生态的发展贡献力量。在未来的AI计算中,内存管理将继续扮演关键角色,推动AI技术的不断创新和发展。

参考资源 :

CANN社区版开发文档 昇腾开发者社区 CANN训练营官方页面