从一块号牌开始:自动驾驶,正在进入 “会思考” 的阶段

近日,重庆正式发布了国内首块 L3 级自动驾驶专用正式号牌。很多人第一反应可能是:哦,又是自动驾驶的一次试点。但如果你往前多看一步,会发现这不是一次技术展示,而是一次“责任边界”的松动。而一旦责任开始松动,真正推动它的,不只是传感器和算力,而是——AI,尤其是正在快速进化的 AIGC 能力。

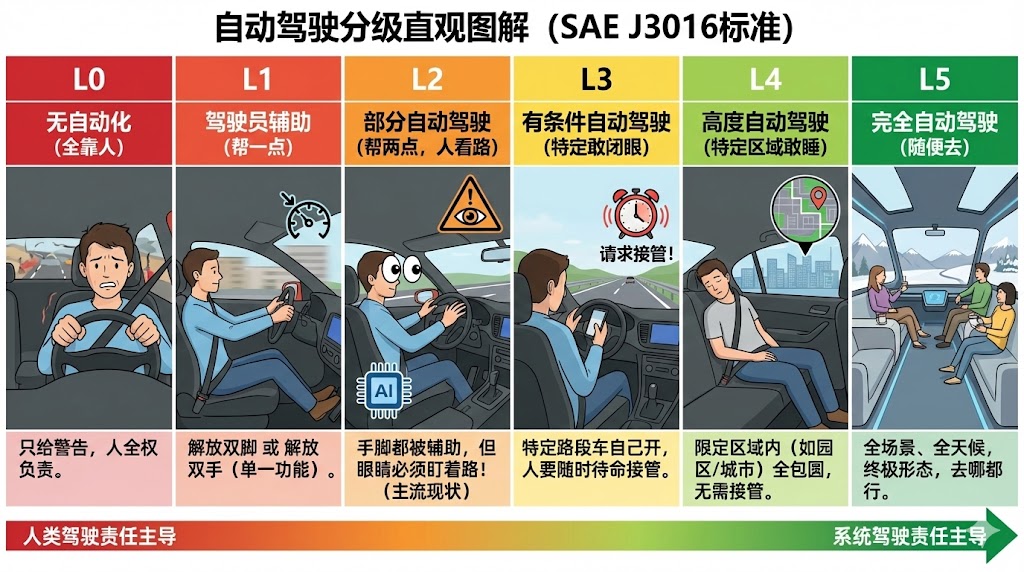

🧩 一、L2 和 L3 到底有什么区别?

我们先把最容易混淆的一点说清楚。

🚦 L2:你在开车,AI 在“打辅助”

- 车道保持

- 自适应巡航

- 自动刹车

🔔 关键点:

👉 人必须全程盯着路

👉 出事,人负责

你可以把 L2 理解为:一个非常聪明、但不能替你做决定的副驾驶。

🟢 L3:AI 在开车,人是“接管备份”

L3 的变化只有一句话,却极其关键:在特定场景下,系统对驾驶行为负责。

也就是说:

- 在系统允许的路段、天气、速度范围内

- 你可以短暂“不盯路”

- 责任首次从人,部分转移给系统

📌 这一步,难度不在“能不能开”,而在于:AI 能不能理解复杂世界,并做出“像人一样合理”的判断。

🤖 二、AIGC 为什么会在这个节点突然重要起来?

很多人一听 AIGC,想到的是:

- 写文章 ✍

- 画图 🎨

- 做 PPT 📊

但在自动驾驶里,AIGC 的作用完全不是“生成内容”,而是——生成理解。

🧠 自动驾驶最难的不是“看见”,而是“看懂”

传统自动驾驶 AI,更像这样:

- 识别这是行人

- 那是红灯

- 前方有车辆

这是感知型 AI。

但 L3 真正难的,是下面这些问题👇:

🟡「这个人站在路边,是在等车,还是准备突然横穿?」

🟡「前方车辆减速,是因为拥堵,还是有人要下车?」

🟡「这条路今天为什么异常安静?」

👉 这些问题,没有标准答案。

✨ AIGC 带来的关键变化:从“规则判断”到“情境理解”

AIGC 背后的大模型,有三个能力,对 L3 极其关键:

🧩 1️⃣ 世界模型(World Model)

AI 不再只识别物体,而是构建一个“正在发生什么”的整体认知。

📌 就像人类开车时,并不是在数:

- 几辆车

- 几个行人

而是在脑中形成一句话:这是一条放学时间的学校路段,可能会有突然跑出来的孩子。

🗣 2️⃣ 语言式推理能力

你可能觉得“语言”跟开车没关系,但事实是:人类的决策,本质上是“内心独白”。

AIGC 能把感知结果转化为类似这样的内部逻辑:前方施工 + 路边有人打手势 + 对向车减速→ 大概率是临时放行→ 减速并准备随时停车

这类“可解释推理”,正是 L3 所需要的。

🔄 3️⃣ 自我反思与修正

L3 系统必须能回答一个问题:刚才这个决策,如果换一个情况,还成立吗?

这正是生成式模型擅长的能力:不是一次性输出,而是持续修正。

🚧 三、重庆为什么有象征意义?

重庆不是“随便选的”。

🟣 山城

🟣 高低落差

🟣 弯道密集

🟣 路况复杂

如果你把自动驾驶想象成“AI 的高考”,那重庆,更像是:

🎓 综合题 + 应用题 + 情景判断题。

👉 在这样的城市发放 L3 专用号牌,本身就意味着:系统已经不再只在“理想环境”里跑。

🌱 四、一个容易被忽视的视角:AIGC 正在重塑「责任逻辑」

❗这里有一个非常重要、但很少被讨论的变化:从“人犯错”到“系统如何解释自己的行为”

未来的自动驾驶事故,不再只问:谁踩了刹车?

而会问:系统当时是如何理解这个场景的?

这意味着:

- AI 必须能复盘自己的决策过程

- 必须能用“人类能理解的方式”解释

📌 这正是 AIGC 的核心优势之一。

🔮 五、L3 不是终点,而是一次“信任实验”

🚘 L3 并不是“完全解放双手”,而是社会第一次对 AI 说:在某些情况下,我愿意相信你。

而 AIGC 的角色,不是让车“更炫”,而是让系统:

✨ 更懂世界

✨ 更像人类思考

✨ 更能解释自己

🧠从“工具 AI”到“判断型 AI”,这是一个时代级的转变。

🚦 重庆这块 L3 号牌,也许只是开始。