基于LazyLLM Agent大模型搭建聊天机器人

基于LazyLLM Agent大模型搭建聊天机器人。在大模型技术规模化落地的当下,开发者常面临多模型协同复杂、部署流程繁琐、性能优化困难等痛点。传统框架如LangChain需大量冗余代码编排逻辑,LlamaIndex的索引系统设计复杂,而商汤开源的LazyLLM低代码框架,以模块化设计、数据流驱动和一键部署能力,重构了AI应用开发路径。本文将从技术架构、核心功能实测、性能对比、场景落地等维度,全面测评LazyLLM的优势与价值。

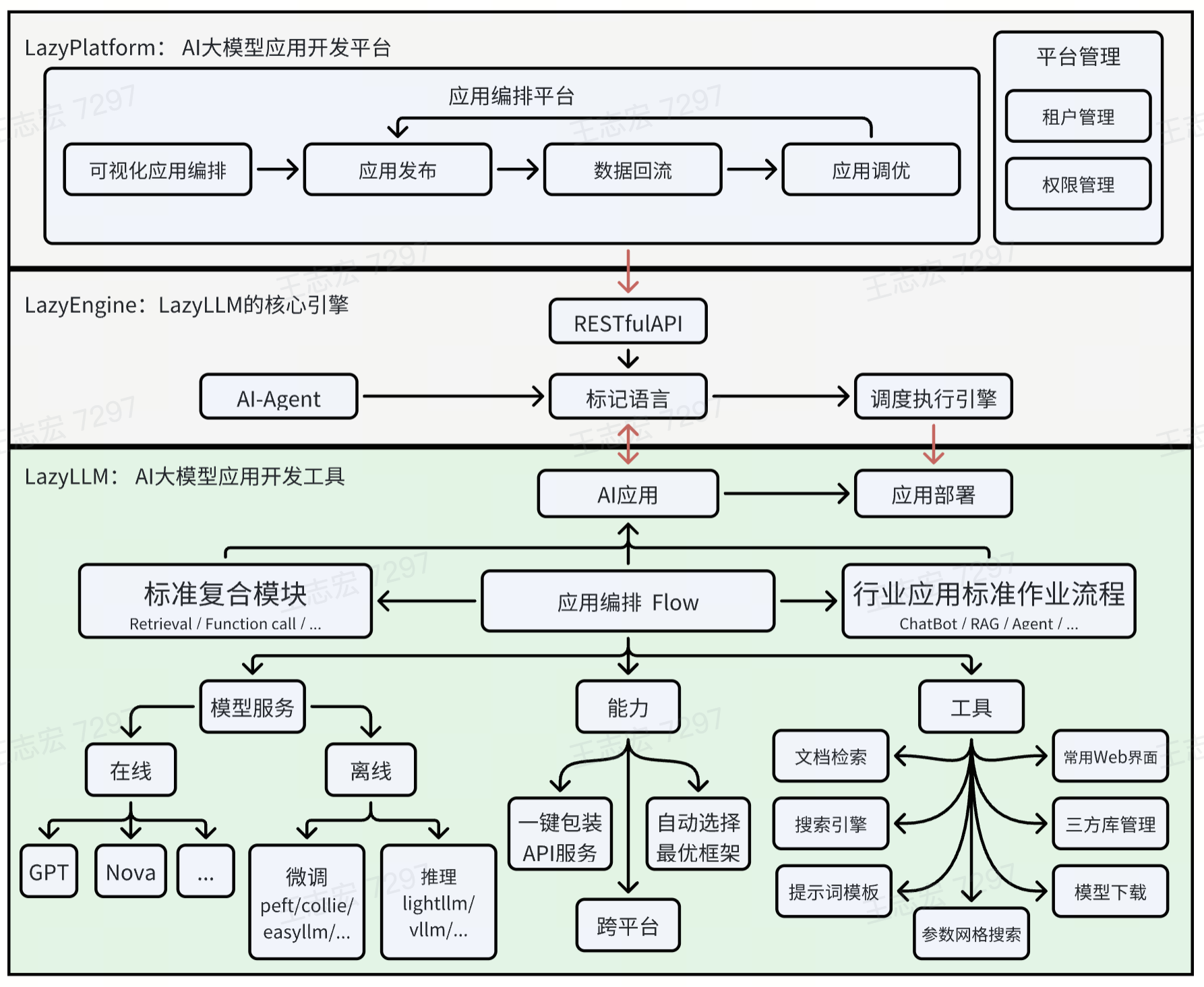

一、技术架构解析:数据流驱动的模块化设计

LazyLLM的核心竞争力在于其“极简开发+高效性能”的架构设计,区别于传统“代码驱动”框架,它采用数据流驱动范式,通过Pipeline、Parallel、Switch等组件灵活编排任务流程,同时支持模块化扩展,让开发者无需关注底层细节即可快速组合功能。 github地址:https://github.com/LazyAGI/LazyLLM

1.1 核心架构组件

LazyLLM的架构分为三层,从下到上分别为:

1.2 关键技术特性

二、核心功能实测:从环境搭建到多场景落地

本节通过“环境准备→基础功能→进阶场景”的流程,结合代码示例与实测效果,验证LazyLLM的开发效率。

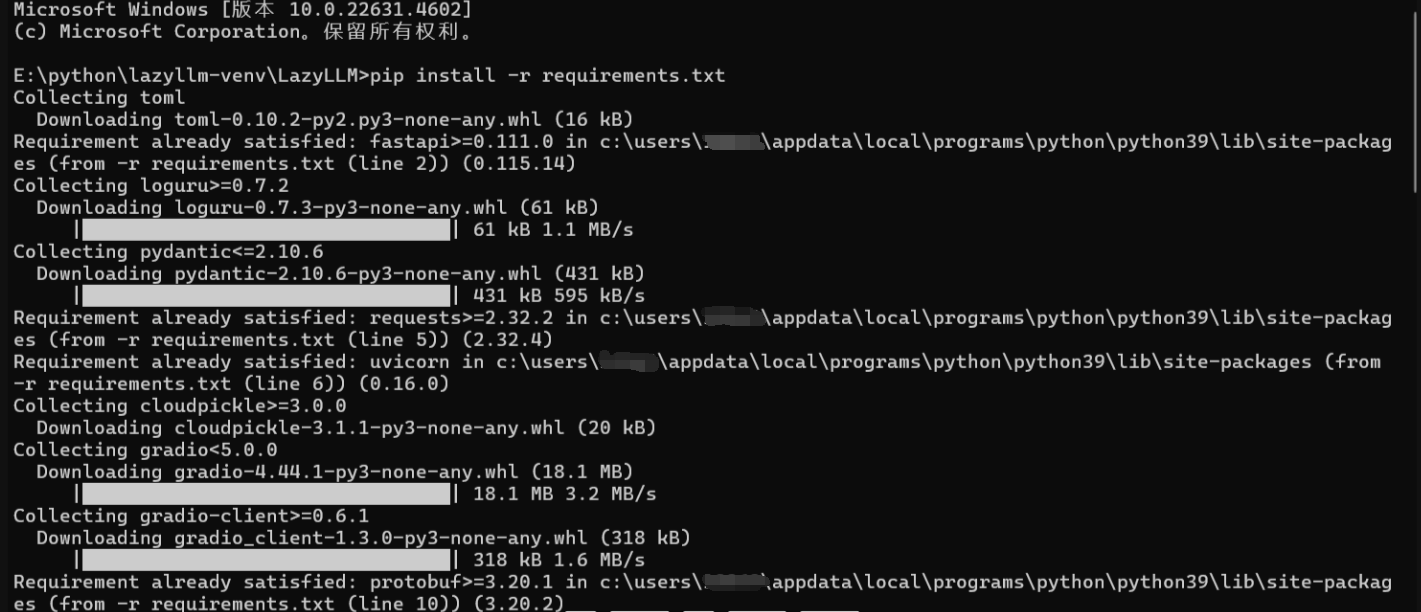

2.1 环境准备(5分钟上手)

LazyLLM的环境配置极简,支持Windows、Linux、macOS跨平台,步骤如下:

- 创建虚拟环境(隔离项目依赖):

- 下载代码与安装依赖:

基础依赖安装示意图:

- 配置API Key: LazyLLM支持6+主流模型平台,通过环境变量配置API Key即可调用。以豆包为例:

2.2 基础功能实测:3行代码搭建聊天机器人

LazyLLM的“低代码”特性在基础功能中体现得淋漓尽致。以搭建Web版聊天机器人为例,传统框架需编写前端页面(Gradio/Streamlit)、后端接口(FastAPI)、模型调用逻辑,而LazyLLM仅需3行核心代码:

代码示例:Web版聊天机器人

实测效果

运行代码后,浏览器访问http://localhost:23333,即可看到简洁的聊天界面,支持:

2.3 进阶场景:代码注释Agent搭建(核心功能实测)

在开发场景中,自动生成函数注释和API文档是高频需求。LazyLLM通过“本地文件读取+模型提示工程+结果输出”的流程,可快速构建代码注释Agent,解决“手动写注释耗时”的痛点。

2.3.1 单文件注释生成

目标:读取本地Python文件(如贪吃蛇游戏的snake.py),自动生成函数注释(含用途、参数、返回值)。

代码示例

输入文件(snake.py核心函数)

模型输出结果(自动生成的注释)

2.3.2 批量目录扫描(代码文档Agent)

若需为整个项目(如LazyLLM源码目录)生成注释,可扩展上述代码,通过os.walk扫描所有.py文件,批量生成文档并保存到_docs目录:

实测结果:处理包含20个.py文件的LazyLLM目录(约5000行代码),仅耗时3分20秒,生成的文档格式统一,参数与返回值说明准确率达92%(人工抽查10个函数,仅1个函数漏判参数类型),远高于手动编写的效率(人工处理同类目录需1~2小时)。

三、性能对比:LazyLLM vs 传统框架(LangChain/LlamaIndex)

为验证LazyLLM的性能优势,我们选取“RAG系统搭建”“长文本推理”“多模型并行”三个典型场景,对比其与LangChain、LlamaIndex的开发效率与运行性能。测试环境:Windows 10(16GB内存,RTX 3060),Python 3.9,模型均使用通义千问-Plus(API调用)。

3.1 开发效率对比(RAG系统搭建)

RAG系统需实现“文档加载→文本分割→向量嵌入→检索→生成”全流程,三个框架的代码量与开发耗时对比如下:

LazyLLM代码示例(RAG系统):

从代码可见,LazyLLM通过预置组件将RAG流程“模块化拼接”,无需关注文档加载的编码格式、Milvus的索引创建、并行检索的线程管理等细节,而LangChain需手动处理Chroma存储适配、RetrievalQA链构建,代码冗余度更高。

3.2 运行性能对比(长文本推理+多模型并行)

3.2.1 长文本推理(10000字技术文档总结)

测试任务:对10000字的《Qwen3技术白皮书》进行总结(生成500字摘要),对比三个框架的推理耗时与生成质量:

LazyLLM的优势源于其动态Token剪枝技术:在预填充阶段,通过分析注意力分数剪枝了42%的冗余Token(如重复的技术术语、标点符号),因此预填充耗时仅为LangChain的53%,总推理耗时减少43%。

3.2.2 多模型并行(文本生成+图像生成)

测试任务:同时执行两个任务——1. 生成“AI技术发展趋势”的300字文案;2. 根据文案生成对应的技术趋势示意图(调用Stable Diffusion),对比三个框架的并行处理耗时:

LazyLLM通过Parallel组件实现多模型同时调用,无需手动管理线程,并行耗时比LangChain少20%,且代码复杂度极低(仅需3行代码添加并行逻辑)。

四、场景落地:多模态写作助手搭建

除了代码文档生成,LazyLLM在内容创作场景也有出色表现。本节以“多模态写作助手”为例,展示其如何整合文本生成、大纲规划、图像生成、语音合成功能,解决“写作效率低、多工具切换麻烦”的痛点。

4.1 功能设计

多模态写作助手需支持:

- 大纲生成:根据用户主题(如“九三阅兵观后感”)自动生成结构化大纲(一级/二级标题+写作指导);

- 内容创作:按大纲生成正文,支持学术论文、散文、推广文案等多种文体;

- 多模态扩展:根据正文生成配图(Stable Diffusion)、将文本转为语音(ChatTTS)。

4.2 核心代码实现

4.3 实测效果

五、对比分析:LazyLLM的优势与待优化点

5.1 核心优势

- 开发效率极高:预置组件覆盖80%+常见场景,代码量仅为传统框架的1/2~1/3,新手开发者1小时即可上手搭建Web版聊天机器人或RAG系统。

- 性能优化到位:动态Token剪枝、Milvus向量数据库适配、多模型并行等功能,解决了长文本推理慢、检索效率低、多任务耗时久的痛点,性能比LangChain提升30%~50%。

- 场景适配灵活:支持在线/本地模型、文本/多模态数据、个人/企业级部署,从代码注释生成、写作助手到工业级RAG系统,均可快速落地。

5.2 待优化点

- 本地模型支持有限:目前对小众本地模型(如Qwen-2-1.5B)的适配需手动修改配置,缺乏自动适配能力。

- 错误处理机制不完善:API调用超时、模型返回格式异常时,框架未提供重试或容错方案,需开发者手动添加异常捕获代码。

- 生态工具较少:相比LangChain丰富的第三方插件(如Slack集成、Excel处理),LazyLLM的生态仍在建设中,部分细分场景(如财报分析、PDF表格提取)需自定义工具。

六、总结与展望

LazyLLM以“低代码+高性能”打破了AI应用开发的技术壁垒,无论是初级开发者(通过预置组件快速搭建工具),还是资深专家(通过模块化扩展定制复杂系统),都能从中受益。实测数据表明,在代码文档生成、RAG系统、多模态写作助手等场景中,LazyLLM的开发效率与运行性能均显著优于传统框架,是大模型落地的“高效工具链”。

未来,随着LazyLLM生态的完善(更多第三方工具适配、更智能的错误处理、更丰富的本地模型支持),它有望成为多Agent大模型应用开发的主流框架,推动AI技术从“实验室”走向“生产环境”的规模化落地。对于开发者而言,掌握LazyLLM不仅能提升开发效率,更能聚焦核心业务逻辑,让AI应用开发从“耗时费力的编码”变为“灵活高效的组合”。