谁懂啊!这个组合让图生视频封神:WAN2.2-LightX2V-I2V,对比 Smooth 细节拉满,换模型就用

一、WAN2.2-LightX2V-I2V最强动态介绍

大家好啊,今天的话给大家介绍个图生视频动态效果更好的模型搭配使用,这个也是其他UP主测试出来的,早上看到我就去跟着测试了下一下,发现效果确实更强,不管对提示词的遵从度还是视频的动态效果,都更好了,核心还是模型和lora的搭配,并且和之前的Smooth的图生视频做了对比,效果大家自己看看就明白了,废话不就多说,直接进入正题。

二、相关安装

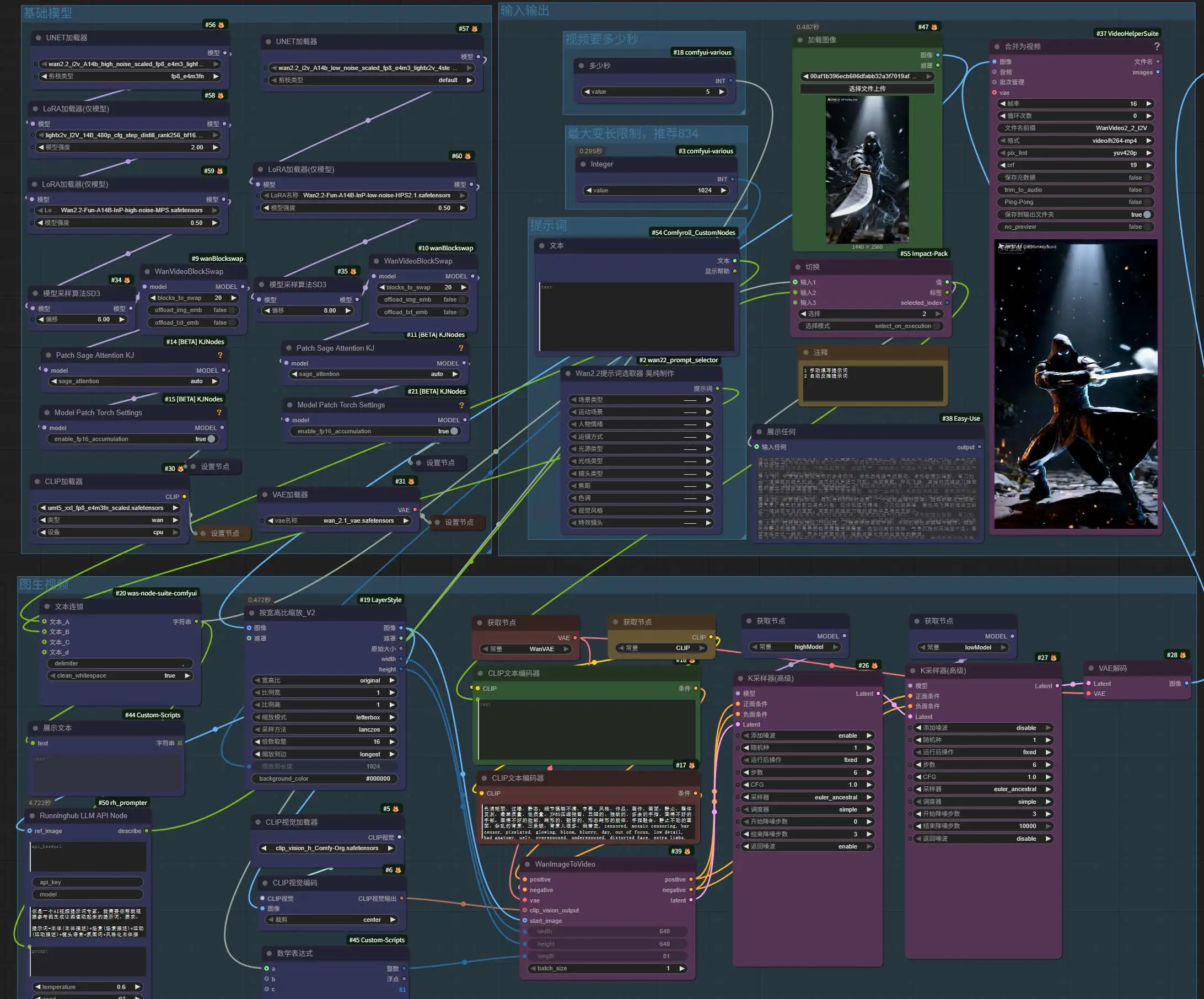

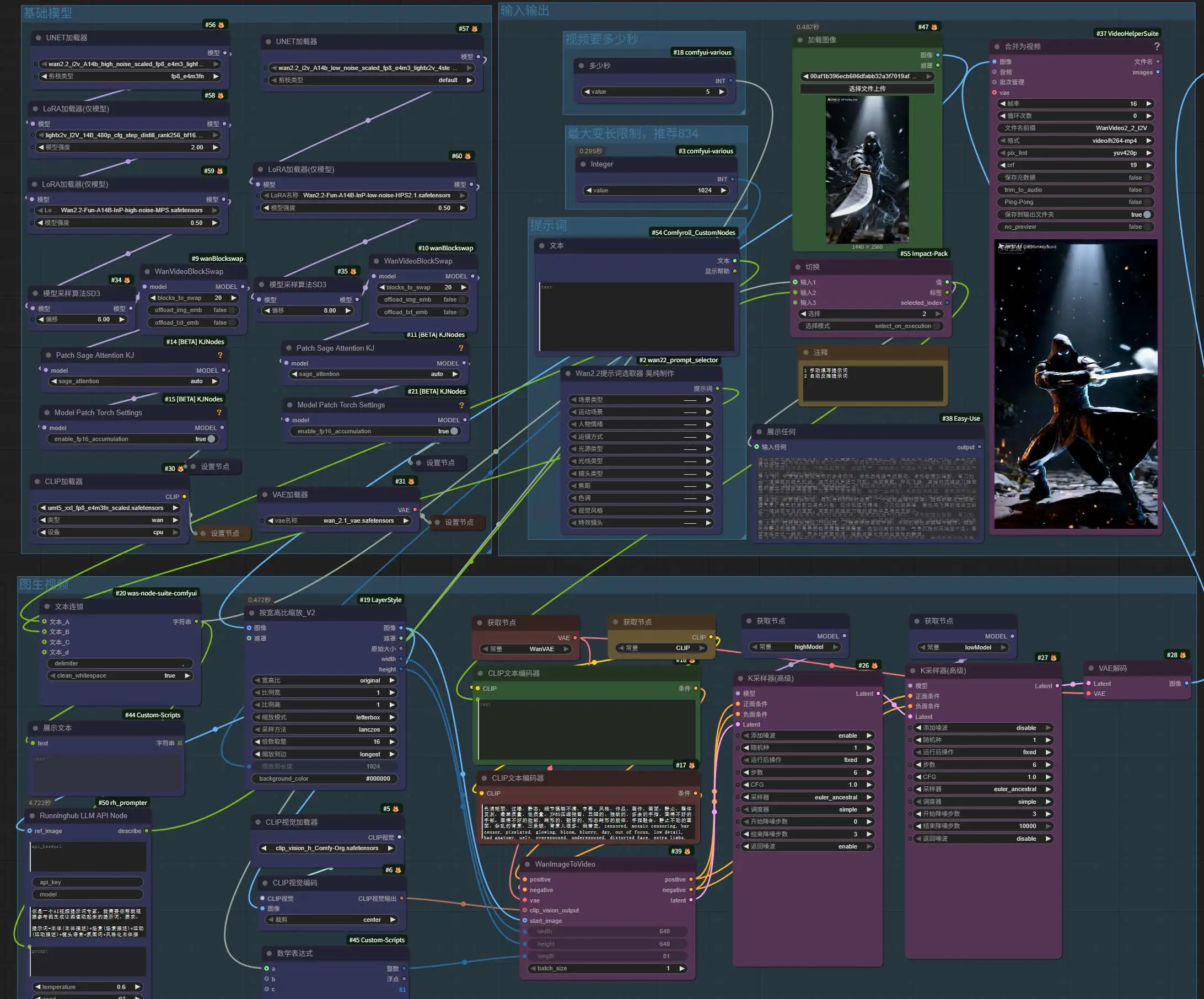

这次还是用官版的工作流。

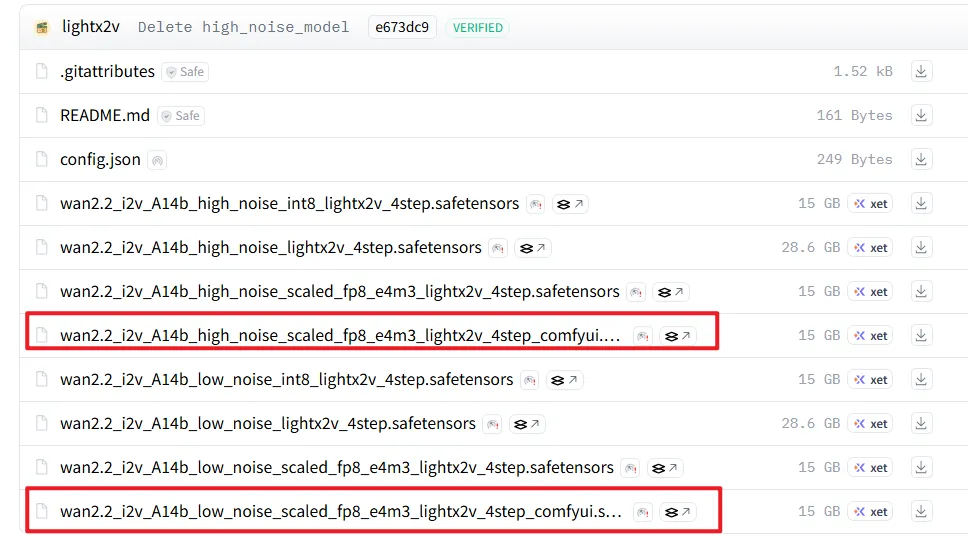

- 模型地址:https://huggingface.co/lightx2v/Wan2.2-Distill-Models/tree/main

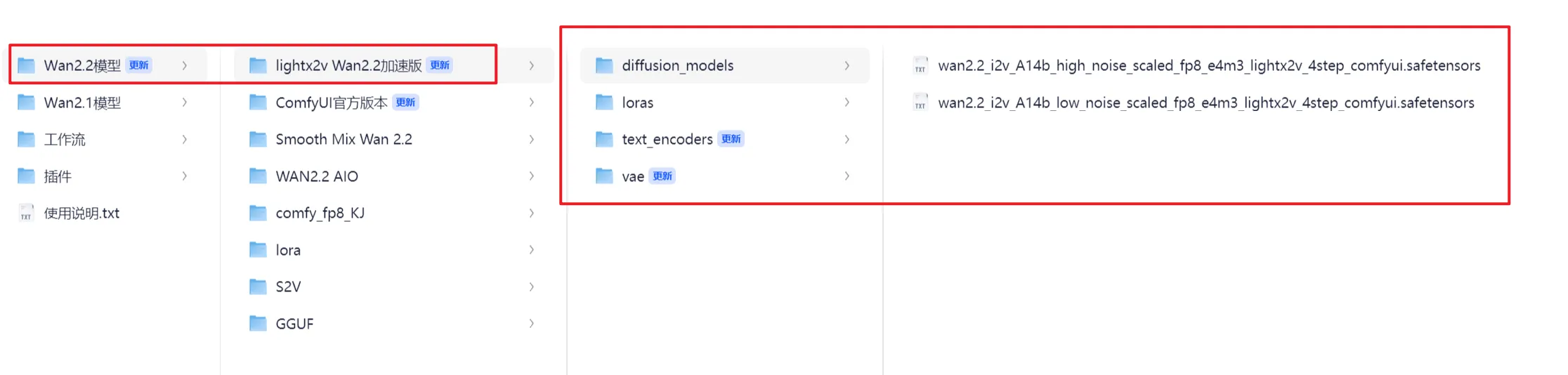

我用的是这个量化后的fp8模型,大家显存低的也用这个即可,存放路径是\models\diffusion_models

网盘里面我也提供了,大家自行前往下载。

三、测评体验

工作流已发Runninghub,前往体验or下载:

- WAN2.2-LightX2V-I2V图生视频最强动态搭配:https://www.runninghub.cn/post/1980829288985444354/?inviteCode=kol01-rh024

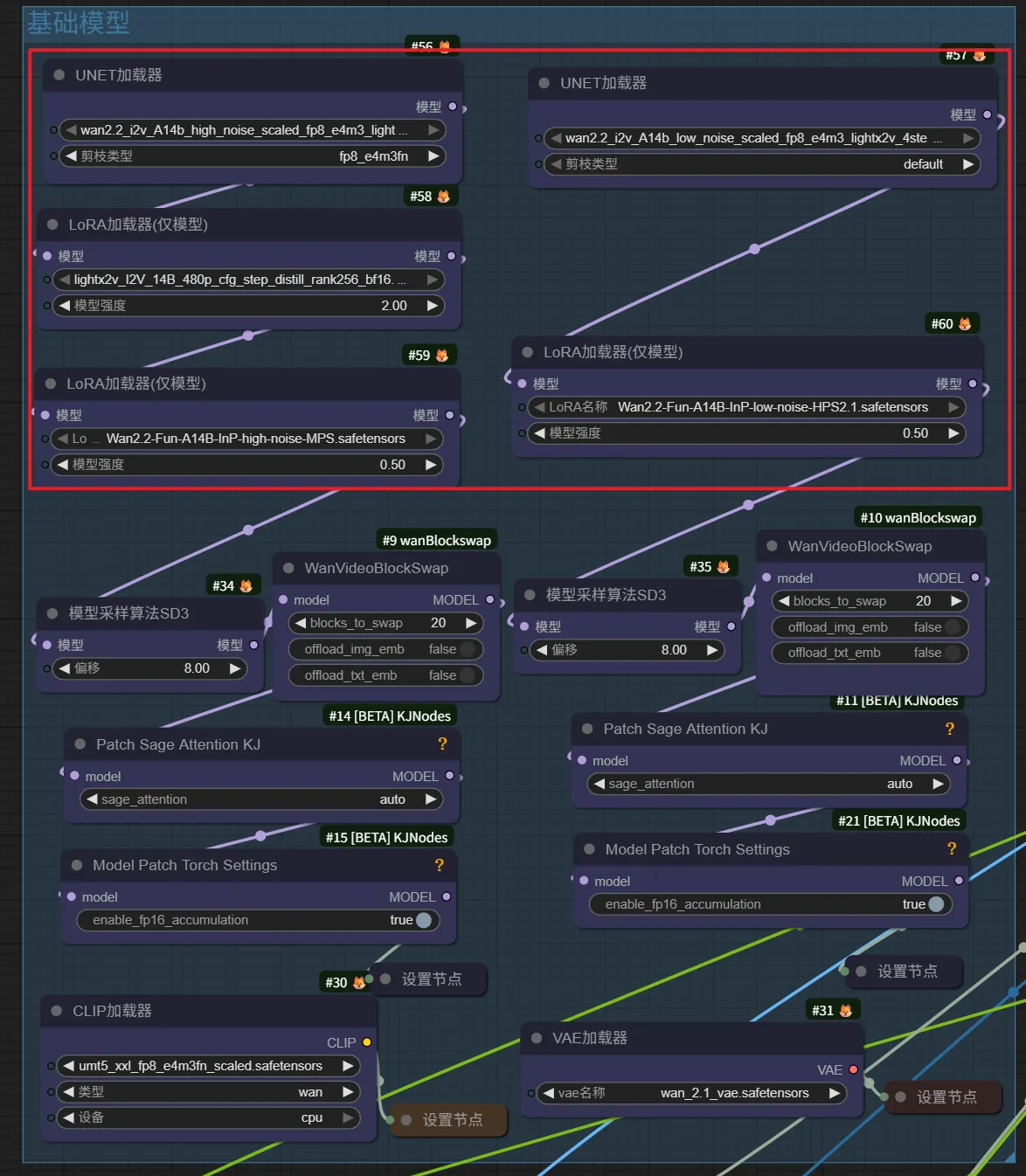

工作流和之前的smooth一样,只是模型做了下调整,以及LLM触发词改了下。

模型加载今天的说的大模型,我这里用的是fp8版本的。

然后提示词这块改了下,LLM模型可以自动生成5秒的分镜提示词,之前的一些模型对分镜切镜头的遵从程度不是很强,这次的话效果就很惊艳了。

下面是我的提示词模板:

案例展示

我们直接来看案例展示,和之前的Smooth做了对比,左边是之前的Smooth图生视频,右边是今天的,可以很明显的看出来,这次的效果是更好的。

注意事项

可以看出来,这种搭配的效果确实更强了,比之前介绍的Smooth Mix效果更好,不管多提示词的遵从程度还是画面的动态,都好了很多,越来越接近原版模型了,高显存王家可以用满配模型,低显存的就和我一样用fp8量化版本即可。

四、在线使用

云端镜像

大家如果没有本地 ComfyUI 环境,或者本地显卡配置低于 16G 的,可以使用嘟嘟部署的仙宫云镜像,可直接加载使用。后续分享的工作流都会更像到镜像中,一周更新一次,方便大学学习。

目前整合了2个镜像,一个是Flux绘图用的,另外一个是针对视频模型的,之所以分开是一些模型兼容问题,分开比较好处理。

镜像名称:嘟嘟AI绘画趣味学

云平台镜像地址:

https://www.xiangongyun.com/image/detail/d961a7dc-ade3-4bd5-a7c6-92ac49ff5e4b?r=37BCLY

https://www.xiangongyun.com/image/detail/81716d29-4461-4b0b-ba4b-7b9b7dd569d3?r=37BCLY

新用户通过邀请码注册,总共可获得 8 元奖励,体验 4 个小时的 4090 作图时长。

RH平台

推荐不想本地自己折腾的同学一个可在线使用Runninghub平台可在线体验AI应用和工作流(注册即送1000积分可用)。

https://www.runninghub.cn/?inviteCode=kol01-rh024

主页更多精彩工作流可在线体验: https://www.runninghub.cn/user-center/1865434314359058434?inviteCode=kol01-rh024

五、总结

以上我测评这个最新的wan2.2 Lightx2v I2v的模型搭配使用,可以得到更好的动态,这是我目前测试下来效果最好的图生视频了,速度和质量里面性价比最高的,大家拿去用吧。