视觉与语言的深度融合:从对比学习到多模态生成范式的技术演进全景报告

1. 范式转移:多模态人工智能的认知觉醒

在人工智能的发展历程中,视觉感知与语言理解长期以来被视为两个独立且平行的研究领域。计算机视觉(CV)致力于解构像素阵列中的物理特征,而自然语言处理(NLP)则专注于解码文本符号中的语义逻辑。然而,人类认知的本质是多模态的——我们通过视觉捕捉环境信息,并通过语言对这些信息进行抽象、推理与交流。

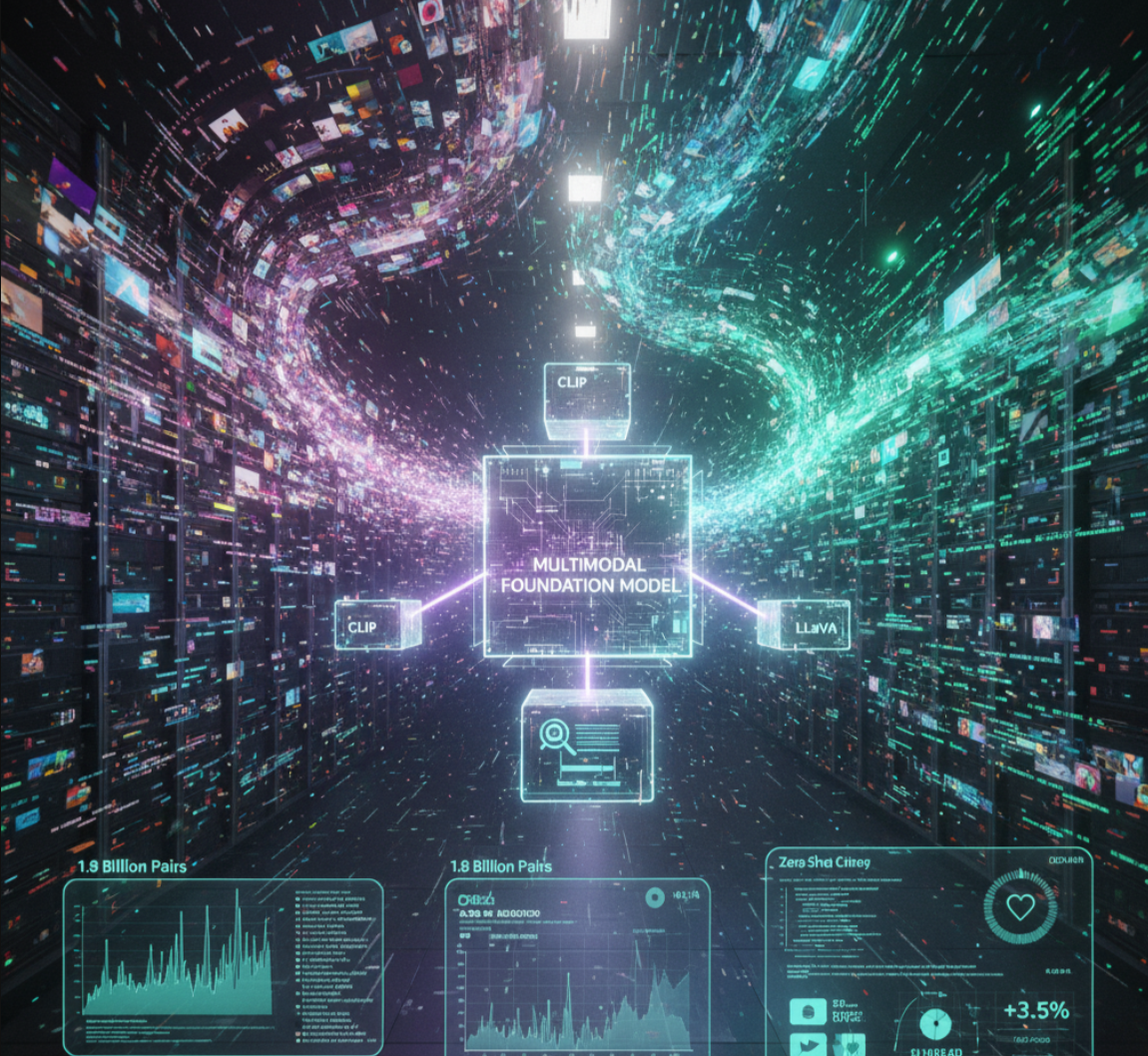

近年来,随着深度学习技术的飞跃,AI领域正在经历一场深刻的范式转移:从各自为政的单模态系统,迈向能够联合理解(Understanding)和生成(Generation)多种数据类型的多模态基础模型(Multimodal Foundation Models)。

这一转变的拐点在于大模型(Large Models)对通用表征能力的探索:

- OpenAI CLIP:通过大规模对比学习,首次在零样本(Zero-Shot)设置下展示了惊人的泛化能力,打破了传统视觉模型对人工标注数据的依赖。

- Salesforce BLIP:进一步解决了视觉理解与生成的统一问题,通过独特的架构设计和数据策略,将视觉感知与大语言模型(LLM)的推理能力无缝连接。

本报告将详尽剖析以CLIP和BLIP为代表的视觉语言模型(VLMs)的技术原理、架构演变、训练目标及数据策略,涵盖ALIGN、CoCa、SigLIP、LLaVA以及DeepSeek-VL等前沿技术。

2. CLIP:构建语义对齐的通用视觉基座

2021年,OpenAI发布的CLIP(Contrastive Language-Image Pre-training)模型不仅是一个技术突破,更是一种方法论的革新。它彻底改变了计算机视觉系统的训练方式,从传统的“在预定义类别上进行监督学习”转向了“从自然语言监督中学习视觉概念”。

2.1 理论基础:对比学习与双编码器架构

CLIP采用简洁高效的**双编码器(Dual-Encoder)**架构:

- 视觉编码器(Image Encoder):负责将高维像素映射为低维特征向量。

- ResNet系列:引入注意力池化(Attention Pooling)机制。

- Vision Transformer (ViT):将图像视为序列Patch输入,在计算效率和全局依赖捕获上表现更优。

- 文本编码器(Text Encoder):负责将文本描述转换为语义向量。

- 使用12层Transformer模型,文本序列被

[SOS]和[EOS]标记包裹,取[EOS]位置特征作为语义表示。

- 使用12层Transformer模型,文本序列被

2.2 训练目标:InfoNCE与温度系数的数学解析

CLIP采用**对比学习(Contrastive Learning)**目标,最大化图像与对应文本在特征空间中的余弦相似度。

在一个包含 $N$ 个(图像,文本)对的Batch中,训练目标通过对称的交叉熵损失函数实现:

$$\mathcal{L} = \frac{1}{2} (\mathcal{L}{I \to T} + \mathcal{L}{T \to I})$$

其中,图像到文本的损失 $\mathcal{L}_{I \to T}$ 定义为:

$$\mathcal{L}{I \to T} = - \frac{1}{N} \sum{i=1}^{N} \log \frac{\exp(\langle v_i, w_i \rangle / \tau)}{\sum_{j=1}^{N} \exp(\langle v_i, w_j \rangle / \tau)}$$

- $\langle v_i, w_i \rangle$:第 $i$ 个图像特征与文本特征的点积。

- 温度系数 $\tau$:CLIP将 $\tau$ 参数化为 $e^{-\tau'}$ 并作为可学习标量,允许模型动态调整logits分布,防止梯度消失或爆炸,确保大规模训练稳定性。

2.3 零样本迁移机制与提示工程

CLIP在预训练阶段见过了4亿对(图像-文本)数据,推理阶段将分类转化为检索问题:

- 提示工程(Prompt Engineering):将标签填入模板(如

"A photo of a {label}")以解决多义性。集成多种模板(Ensembling)可显著提升准确率。 - 分类过程:计算输入图像嵌入与所有候选类别文本嵌入的余弦相似度,通过Softmax得到概率。

2.4 鲁棒性分析与局限性

- 优势:ImageNet零样本准确率达76.2%,且在分布外数据(ImageNet-Rendition等)上表现出极小的鲁棒性差距(Robustness Gap)。

- 局限性:

- 生成缺失:无法生成Caption或回答开放问题。

- 细粒度推理弱:计数、空间关系判断能力差。

- 抽象符号弱:MNIST等符号识别任务表现不如人类。

3. 规模化与优化:ALIGN、SigLIP与CoCa的演进

3.1 ALIGN:从清洗数据到噪声数据的规模暴力

Google Research提出的ALIGN挑战了数据清洗的必要性。

- 数据策略:使用18亿对未经清洗的Raw Alt-text数据。

- 结论:只要规模足够大,简单的双塔架构能从噪声数据中学习到SOTA表征。

3.2 SigLIP:损失函数的计算效率革命

针对Softmax在分布式训练中的通信瓶颈,SigLIP提出了基于Sigmoid的损失函数:

$$\mathcal{L} = - \frac{1}{N} \sum_{i,j} \log \sigma (z_{ij} \cdot (-1)^{t_{ij}})$$

- 优势:消除了全局All-Reduce通信需求,支持极大Batch Size(如32k+),大幅提升训练效率。

3.3 CoCa:理解与生成的统一尝试

Google提出的CoCa(Contrastive Captioners)采用了“解耦解码器”设计:

- 单模态文本层:仅处理文本,用于对比学习(Contrastive Loss)。

- 多模态文本层:通过Cross-Attention接入图像特征,用于生成文本(Captioning Loss)。

- 效果:一次前向传播同时计算两种损失,ImageNet零样本准确率达86.3%。

4. BLIP:引导语言-图像预训练的里程碑

BLIP(Bootstrapping Language-Image Pre-training)致力于解决“理解与生成”的统一,并提出了CapFilt数据清洗方案。

4.1 MED架构:灵活的多任务处理中枢

BLIP的核心是**MED(Multimodal Mixture of Encoder-Decoder)**架构,通过权重共享和Attention Mask控制,使同一模型在三种模式下运行:

- 单模态编码器:独立编码图像/文本,计算ITC(对比损失)。

- 图像引导的文本编码器:使用Cross-Attention注入视觉特征,执行**ITM(图文匹配)**二分类任务。

- 图像引导的文本解码器:使用因果自注意力(Causal Self-Attention),执行**LM(语言建模)**生成任务。

4.2 训练目标的协同效应

- ITC:学习全局检索表征。

- ITM:引入难负样本挖掘(Hard Negative Mining),迫使模型区分细微差别。

- LM:赋予模型自然语言描述能力。

4.3 CapFilt:数据质量的“自举”革命

BLIP利用模型自身清洗网络噪声数据:

- Captioner:为图像生成合成标题。

- Filter:对原始Web文本和合成文本进行评分,过滤噪声。

- 结果:清洗后的1.29亿数据训练出的模型,性能优于1.8亿原始数据模型。

5. BLIP-2:冻结大模型时代的计算美学

BLIP-2的核心思想是:**冻结(Freeze)**预训练好的视觉编码器和LLM,仅训练轻量级中间件。

5.1 Q-Former:瓶颈架构与可学习查询

- 结构:包含Image Transformer和Text Transformer。

- 机制:引入32个可学习查询向量(Learnable Queries)。通过Cross-Attention,迫使Queries从海量视觉特征中提取最核心语义,形成信息瓶颈。

5.2 两阶段预训练策略

- 第一阶段(视觉-语言表征学习):训练Q-Former提取视觉特征(ITC, ITG, ITM损失),尚未连接LLM。

- 第二阶段(视觉到语言的生成学习):将Q-Former输出的Queries通过线性投影转化为LLM可理解的**“软提示”(Soft Prompts)**,引导冻结的LLM生成文本。

5.3 性能与局限

- 突破:参数效率极高,以1/54的参数量在VQAv2上超越了Flamingo。

- 局限:缺乏上下文学习(In-Context Learning)能力。

6. LLaVA与指令微调:迈向多模态助手

LLaVA(Large Language-and-Vision Assistant)将重点转向“对话交互”和“指令跟随”。

6.1 极简架构的哲学

- 视觉编码器:CLIP ViT-L/14(冻结)。

- LLM:Vicuna(基于LLaMA)。

- 连接器:简单的线性投影层(Linear Projection)。

- 洞察:强大的LLM只需要简单的映射即可理解视觉特征。

6.2 视觉指令微调(Visual Instruction Tuning)

- 数据生成:利用纯文本GPT-4,基于COCO的Bounding Box和Caption生成复杂的多轮对话和推理指令。

- 训练:

- 特征对齐:简单图文对训练投影层。

- 端到端微调:使用158k高质量指令数据微调投影层和LLM,赋予模型“助手”能力。

7. 深度技术对比与性能基准

7.1 架构与训练策略横向对比

| 维度 | CLIP | BLIP | BLIP-2 | CoCa | LLaVA |

|---|---|---|---|---|---|

| 核心范式 | 双塔 (Dual-Encoder) | 混合编码解码 (MED) | 冻结LLM + Q-Former | 解耦解码器 | 冻结CLIP + 投影层 |

| 视觉编码器 | ViT/ResNet (全参数) | ViT (全参数) | ViT (冻结) | ViT (全参数) | CLIP ViT (冻结) |

| 文本/语言模块 | Transformer Encoder | BERT + Decoder | Q-Former + FlanT5/OPT | Dual Decoder | LLaMA/Vicuna |

| 关键损失函数 | Contrastive (ITC) | ITC + ITM + LM | ITC + ITM + ITG + LM | Contrastive + Captioning | Next Token Prediction |

| 生成能力 | 无 (仅检索/分类) | 中 (Captioning) | 强 (VQA, 对话) | 中 (Captioning) | 极强 (复杂推理, 对话) |

| 数据策略 | 400M 私有数据 | CapFilt (合成+清洗) | 同BLIP | 1.8B ALIGN + JFT | GPT-4生成指令数据 |

7.2 零样本性能基准 (Zero-Shot Benchmarks)

| 模型 | ImageNet Top-1 | VQAv2 (Visual QA) | COCO R@1 (I2T) | COCO R@1 (T2I) | 备注 |

|---|---|---|---|---|---|

| ResNet-50 | 76.2% | - | - | - | 监督学习基准 |

| CLIP (ViT-L) | 76.2% | - | 58.4% | 37.8% | 检索强,无法QA |

| ALIGN | 85.5% | - | 59.9% | 45.6% | 规模效应显著 |

| CoCa | 86.3% | - | - | - | 结合对比与生成 |

| BLIP (ViT-L) | - | 78.2% (Finetuned) | 82.4% | 65.1% | 生成能力大幅提升 |

| BLIP-2 (ViT-g) | - | 65.0% (Zero-shot) | 85.4% | 68.3% | 零样本QA性能SOTA |

8. 前沿展望:DeepSeek-VL与未来挑战

多模态大模型的演进仍在继续,如DeepSeek-VL正在探索:

- 混合视觉编码器:结合高低分辨率视图,解决细节丢失问题。

- 混合专家模型(MoE):引入稀疏激活机制,降低推理成本。

8.1 存在的挑战与局限

- 幻觉(Hallucination):模型倾向于依据语言先验而非视觉事实生成内容(如“无中生有”的物体)。

- 多图与视频理解:缺乏原生的时序建模,因果关系推理能力弱。

- OCR与多语言:在密集文本和非英语环境中仍不及专用模型。

8.2 结语

从CLIP的“静态对齐”到BLIP的“生成式统一”,再到BLIP-2和LLaVA的“冻结大模型范式”,多模态AI正逐步成为具身智能的大脑。未来的模型将进一步打破感知与推理的界限,通向更通用的通用人工智能(AGI)。