字节 Code 王炸!截图丢给它,直接出代码

之前也写过几篇入门的体验教程,当时是带着试一试的心态。最近一头扎了进去,深刻体会到了 AI 的推背感,进步太快了!

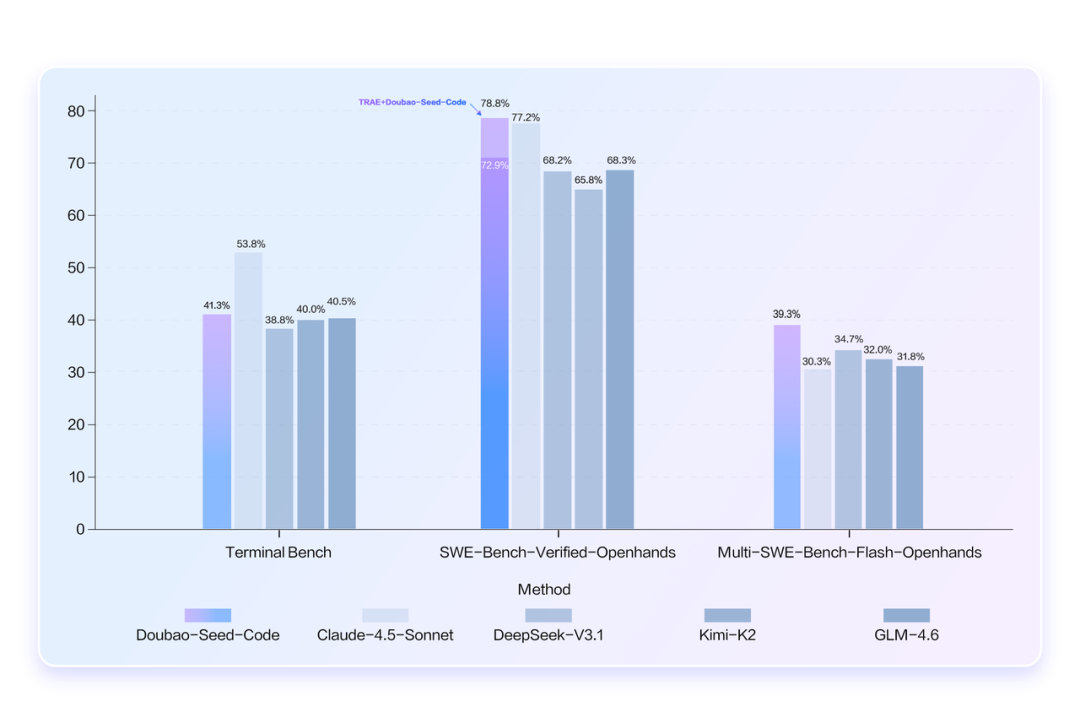

就比如最近出来的 Doubao-Seed-Code 编程模型,在 Terminal Bench、SWE-Bench-Verified-Openhands、Multi-SWE-Bench-Flash-Openhands 等主流测评集中表现出色,仅次于 Sonnet4.5,碾压国内模型。

下面就一起来看看如何接入和体验效果。

接入模型

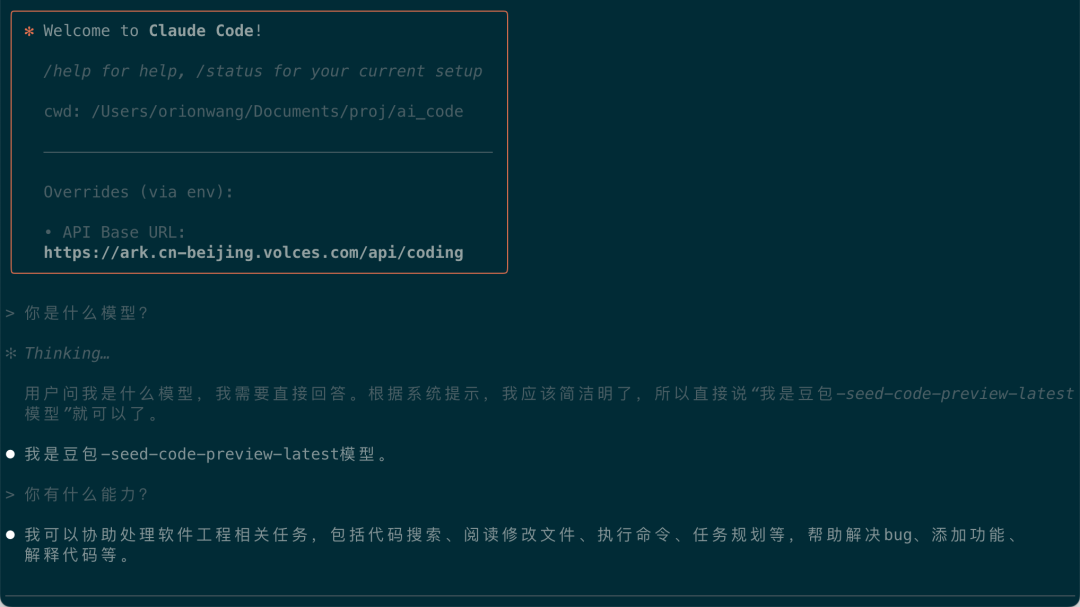

推荐使用 claude code 接入,方式和其他的没啥区别,确认好 base_url 和 api_key 即可,我目前的配置模板如下。

注意一下 model 的配置会跟你选择的付费方式相关,老王目前是选择了 coding plan,如果是 API 的后付费方式,会有不同。

如果长期使用该配置,需要写入到配置文件,但对于短期测试需求,可以利用 powershell 等工具的函数来每次灵活切选择,也是老王最近经过不断折腾发现的一个小技巧。

完成后,在窗口执行对应指令,并进行一些测试即可确认是否正确配置。

测试

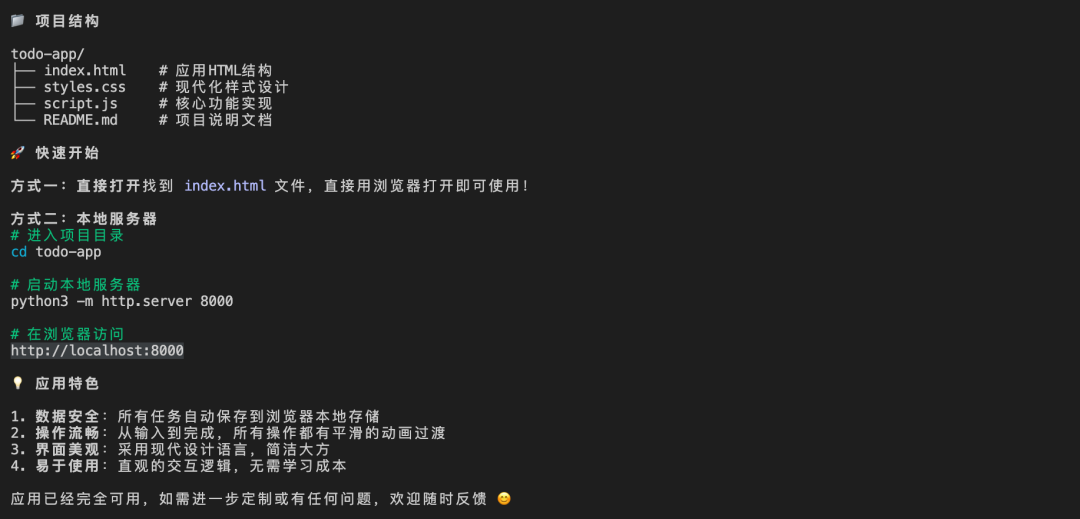

先从一个简单的例子开始,提示词如下。

随后就库库一通输出,一会儿就把项目结构、快速开始方法和应用特色都展示出来了。

直接打开 index.html 文件,即可查看效果。

整体审美还是很不错的,但按钮和文字的渐变色,还是能看出 AI Coding 的风格。点击测试了下功能,基本是没有问题的。

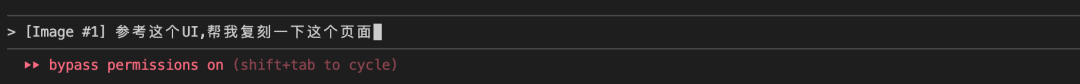

另外,这个 Code 模型,自带视觉理解能力,非工具调用实现,这在国内是不多见的。

国内比较有名的几大模型:DeepSeek V3.1、Kimi K2、GLM 4.6、MiniMax M2 等 Coding 模型均不具备视觉理解能力,需要通过 MCP 间接实现,将图片转化成语义的描述,这个过程中信息折损会很大,效果会差很多,远不及 VLM 。

VLM 的功底非一日之寒,需要专业团队的训练和数据积累,而 doubao 系列模型有优秀的视觉理解能力基础,所以 Seed-Code 具备该能力也理所当然。

我拿了扣子主页来测试了一下。

速度也很快,效果如下图,还是非常不错的,主要是快,这几分钟就做出来了 60 分的页面,还要啥自行车。

关键价格也比较低,在预算不充足的情况下,可以作为一个 cc 中的强力选项。

总结

Doubao-Seed-Code 的出色表现,再次印证了 AI 编程的巨大潜力,但要警惕「过度依赖」或「盲目追新」的误区。

最理性的态度是,将其视为「模型-工具-人」协作体系中的一环,主动学习,深入实践。

找到属于自己的最佳协作模式,而非被动等待下一个「完美工具」,这才是我们在 AI 浪潮中稳立潮头的关键。