NeuralGCM:当AI学会“算云识雨” 我们这样“看透”全球降水难题

无论是农民需要知道哪一天播种才能获得最佳收成,还是城市规划者需要了解如何应对百年一遇的暴雨,降水预报都是对人类生活最具实际意义的信息之一。

然而,预测降水至今仍是全球天气和气候模型面临的最棘手的难题。

近年,Google推出开源混合大气模型NeuralGCM,该模型结合了机器学习技术和物理原理,能够实现快速、高效且精确的全球大气模拟。

为什么全球降水预报总是“测不准”?

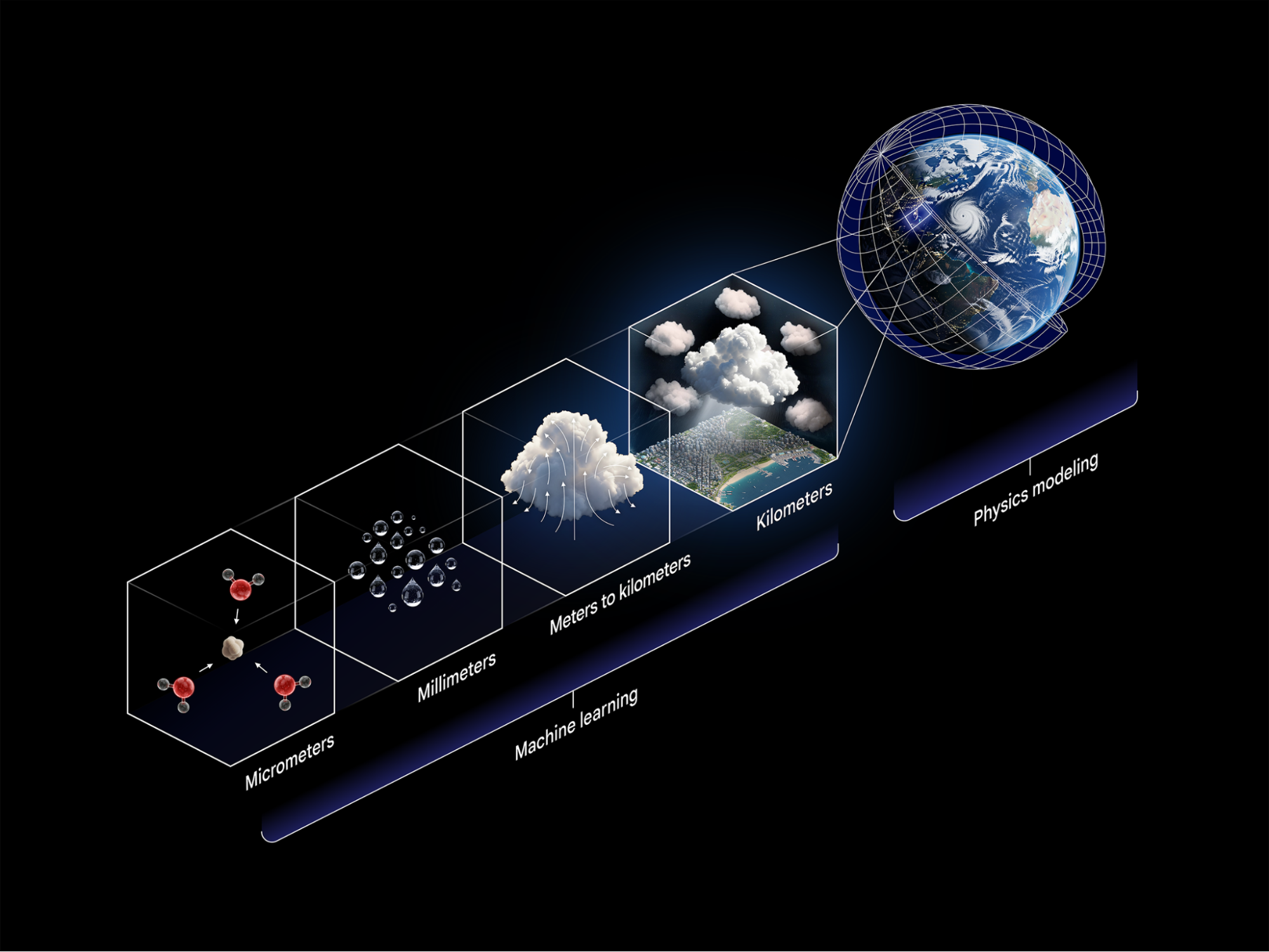

降水的具体位置、时间和降水量,实际上取决于一系列发生在模型分辨率所无法捕捉的微小尺度上的事件。

要模拟降水现象,就必须从降水的源头——云开始进行研究:

- 云的尺度可以小到100米以下,甚至比一个运动场的面积还要小;

- 这样的尺度远远低于全球天气模型的1公里级分辨率,也低于全球气候模型的几十公里级分辨率;

- 云有各种不同的类型,会迅速发生变化,而在更小的尺度上发生的各种物理过程能够生成水滴或冰晶;

所有这些复杂的物理现象,都是大型模型无法直接模拟或计算出来的。

传统模型试图通过“参数化”机制——即用一些近似公式来估算这些小过程的影响——来填补这一鸿沟,但这往往导致降水预报,尤其是对极端天气和日变化规律的模拟,存在显著误差。

全球天气和气候模型将地球划分为一个个面积达数公里方的网格区域。然而,降水的形成实际上依赖于更小的尺度:水分子会聚集在某些颗粒周围形成水滴,这些水滴会在云层中凝结,最终以降水的形式落下来。传统模型是通过基于其他变量的方程来估算这些小尺度过程的影响;而NeuralGCM则采用了一种直接基于卫星降水观测数据训练而成的机器学习模型,从而更准确地模拟全球降水现象。

物理定律+AI智能 NeuralGCM“混合双打”之道

面对这一根本性挑战,Google开源 NeuralGCM(神经通用环流模型)。它并非抛弃传统物理,而是开创了一条“混合智能”的新路径。

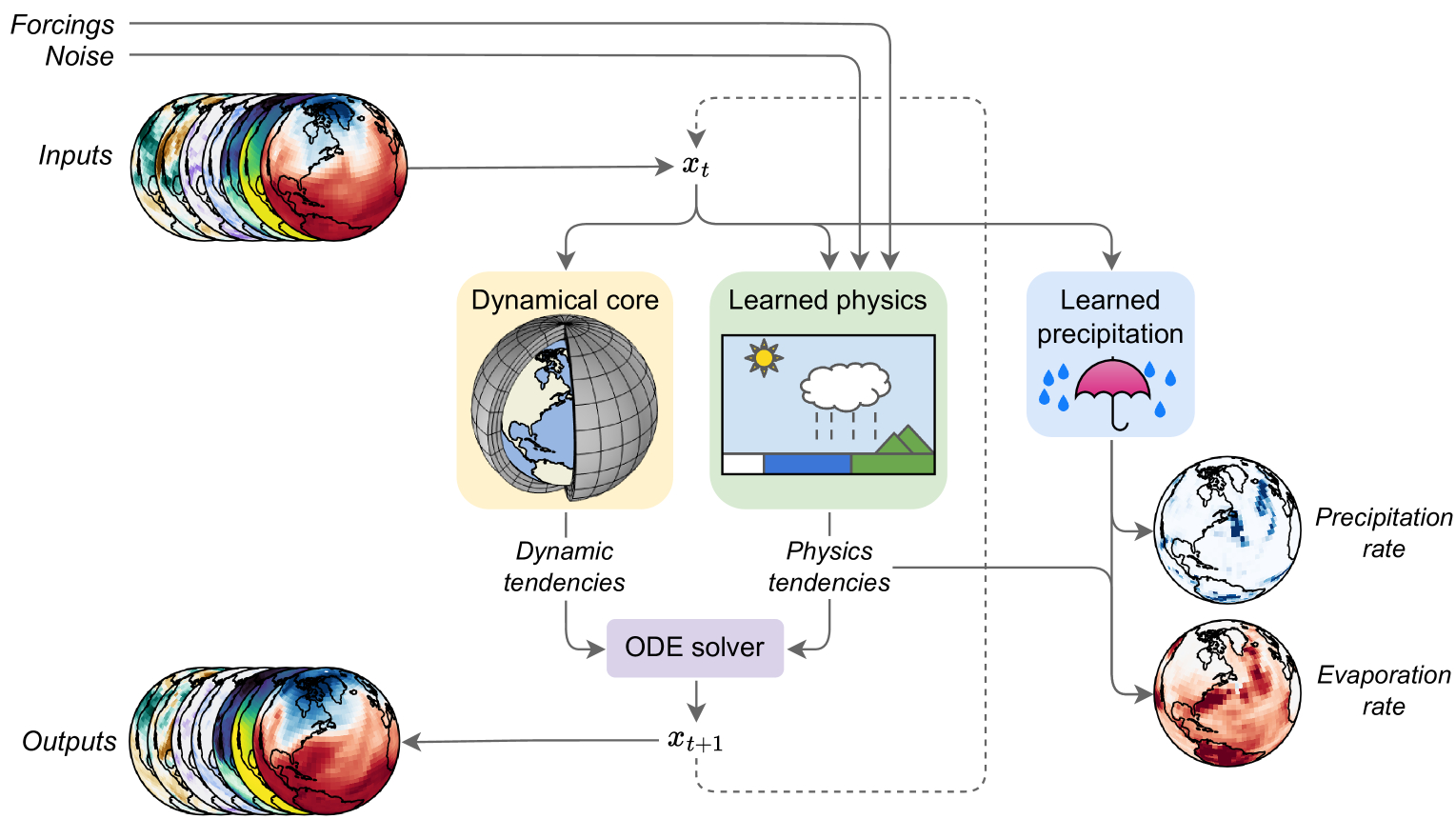

它的核心架构如同一个“分工明确的超级大脑”:

“物理脑”:对于大规模的大气环流等物理过程,继续使用经过验证的传统流体动力学求解器进行计算,确保模型的物理一致性和稳定性。

“AI脑”:对于云、辐射和降水这些棘手的小尺度物理现象,则交给人工智能神经网络来处理。这个AI模块专门学习这些复杂过程如何影响整体气候。

NeuralGCM是地球人工智能项目范围内、旨在推动天气与气候科学发展的更广泛努力的一部分。这种“物理为骨,AI为肌”的混合框架,实现了既快速高效,又精准可靠的全球大气模拟。它能够用来解决那些需要更长时间跨度来预测的问题,从而补充了其他纯人工智能驱动的天气预报模型——比如谷歌团队最近推出的WeatherNext 版本。

NeuralGCM采用了一种混合框架:对于大规模物理过程,该框架会使用传统的流体动力学求解器(灰色球体模型);而对于云、辐射和降水等小尺度物理现象,则会运用人工智能神经网络(卡通盒子模型)以及伞状模型)来进行处理。

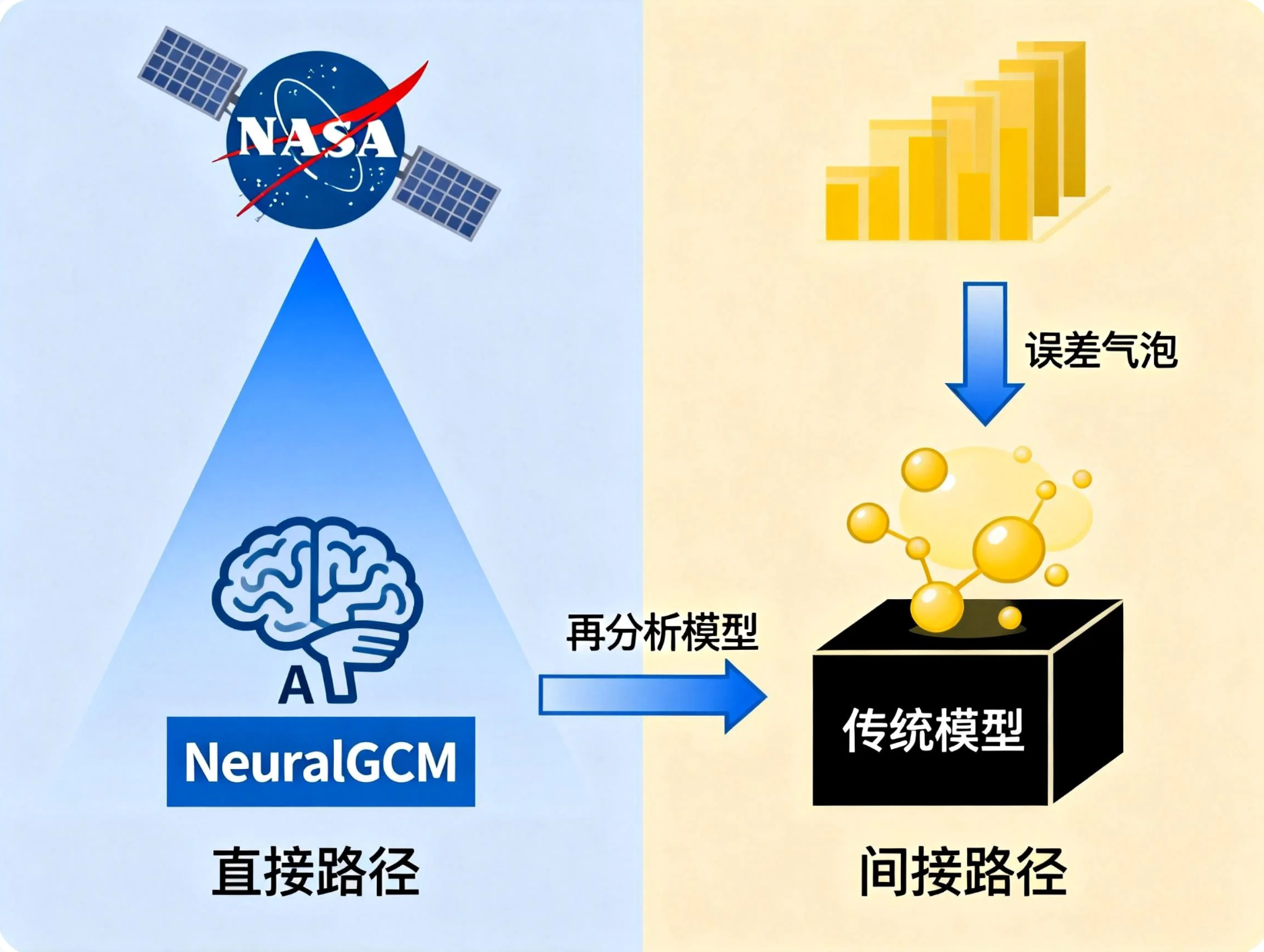

摒弃“二手数据” 直连卫星“天眼”学习

与传统混合模型或纯AI模型相比,NeuralGCM实现突破的关键一步在于 “训练数据的源头革命”。

以往,大多数模型(包括NeuralGCM的初版)依赖“再分析数据”进行训练。这是一种将观测数据与物理模型融合后的“最佳估计值”,但它本身在降水,尤其是极端降水上就存在偏差,导致AI“学到的知识”先天不足。

NeuralGCM的解决方案是“源头直采”:直接利用2001年至2018年间由NASA卫星收集的真实降水观测数据,来训练模型中的AI降水预测模块。这意味着,AI神经网络是在最接近“真理”的课堂上学习云和降水是如何真实发生的,而非学习一个带有误差的物理模型的“二手结论”。

正是这一独特的数据训练路径,让NeuralGCM在模拟极端降水和日变化规律等难题上,表现出了超越传统方法的潜力。

用硬核表现说话,全面超越传统标杆

NeuralGCM的分辨率达到了280公里,能够研究更广阔的地理区域和更长的时间跨度。在将NeuralGCM的多年模拟结果与那些用于气候研究的全球顶级大气模型进行比较时,NeuralGCM的平均误差不到每天0.5毫米。

NeuralGCM的优越性,已通过严格的对比测试得到了验证。

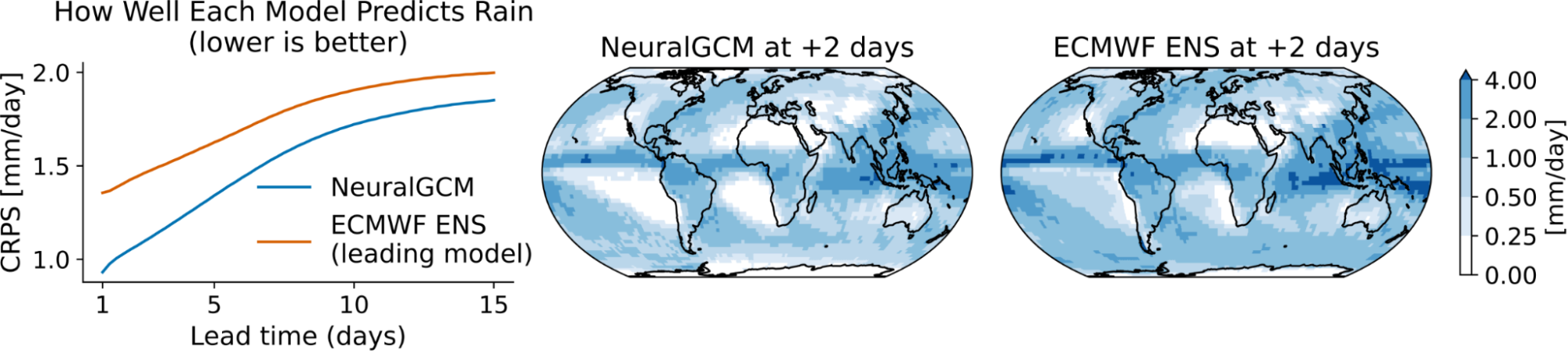

1. 短期预报(2-15天):优于全球顶级业务模型

使用WeatherBench 2评估其性能。在2020年的测试中,NeuralGCM在大多数降水量评估指标上均表现优于欧洲中期天气预报中心(ECMWF)的领先物理模型。这一优势在至关重要的陆地区域尤为明显。连续等级概率评分显示,在全部15个预报日内,NeuralGCM的预报性能持续更优。

左边的图表对比了NeuralGCM模型提供的24小时累积降水量预报数据(蓝色线条)与欧洲中期天气预报中心的中期预报数据(橙色线条)。评估依据是连续等级概率评分这一预报性能评估指标,该指标用于对比不同模型的预报效果。在全部15个预报日内,NeuralGCM模型的评分都较低,但这实际上意味着它的预报性能更好。右边的地图显示了预报两天后该评分的时空分布情况。

2. 长期气候模拟(数年-数十年):误差降低40%

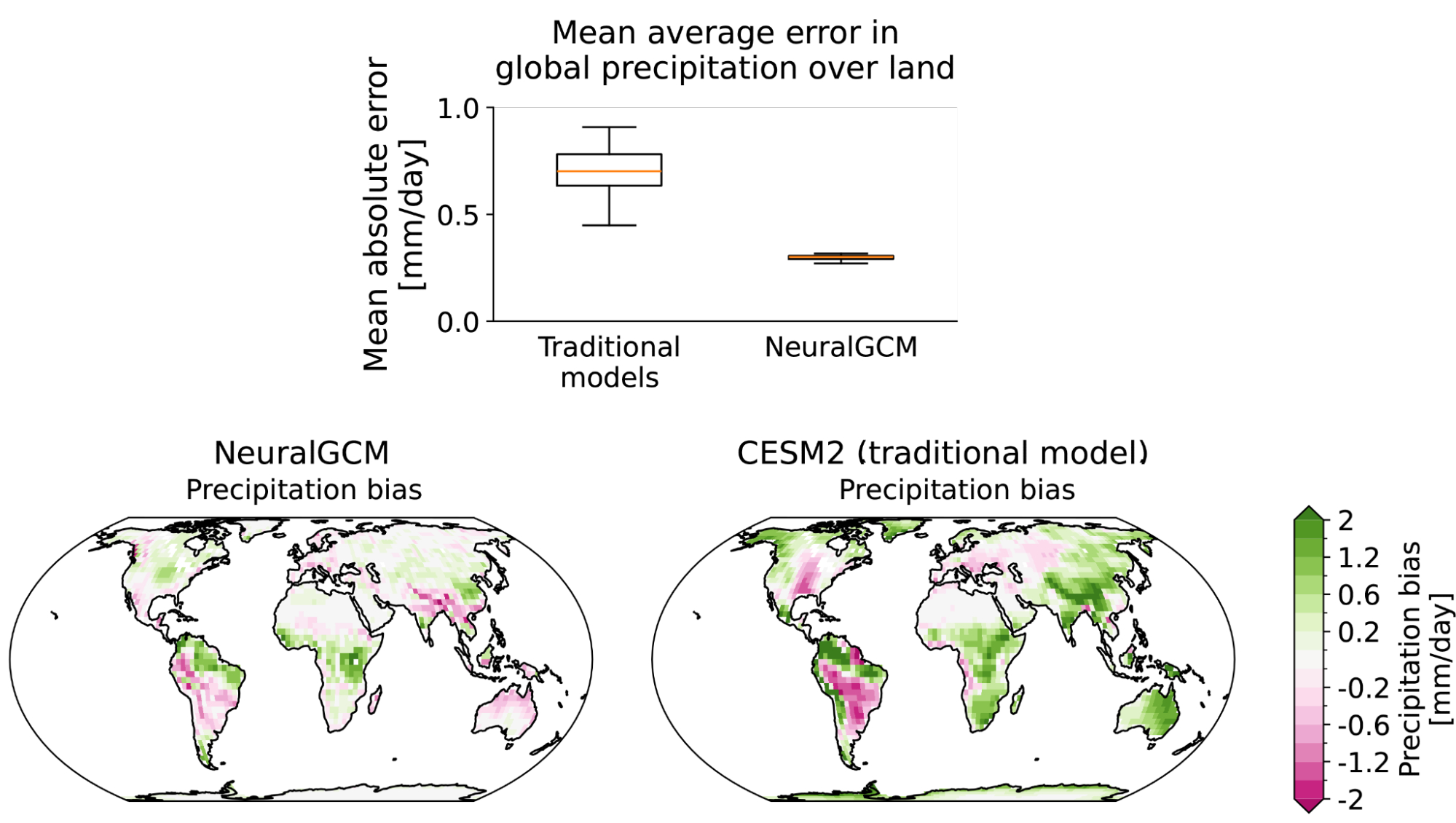

在模拟过去几十年气候时,NeuralGCM的平均误差不到每天0.5毫米。这一误差水平比最新的IPCC报告中使用的顶级模型低了40%。箱线图对比显示,NeuralGCM的平均绝对误差仅为0.3毫米/天,不到其他主流模型的一半。

该箱线图展示了大气模型对比项目中,各种传统模型预测的降水量与基于卫星降水观测数据训练的NeuralGCM模型预测的降水量之间的平均绝对误差。这些误差是2002年至2014年间陆地地区的降水量偏差值,单位为毫米/天,是与IMERG卫星降水观测数据相比得出的结果。NeuralGCM模型的平均误差为0.3毫米/天(橙色线条所示),这一误差值不到其他主流模型误差值的一半。该图表展示了NeuralGCM模型以及社区地球系统模型预测的降水量偏差在空间上的分布情况。

3. 极端降水与日变化:精准捕捉“最难部分”

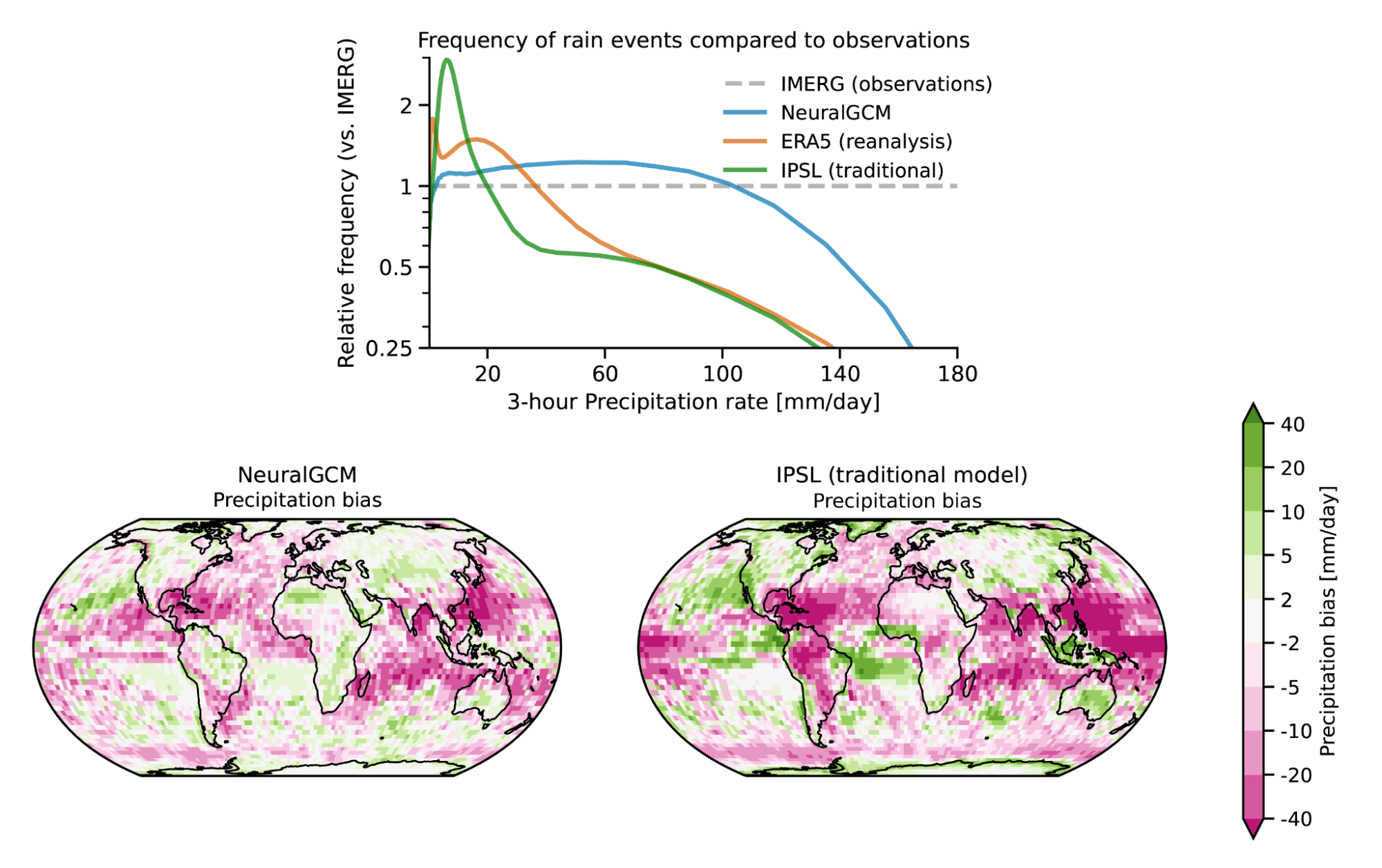

极端降水:传统模型常存在“细雨过度估计问题”,即高估小雨、低估暴雨。NeuralGCM则能更准确地捕捉到强降水事件的强度,对于前0.1%的极端降雨模拟大幅改进。

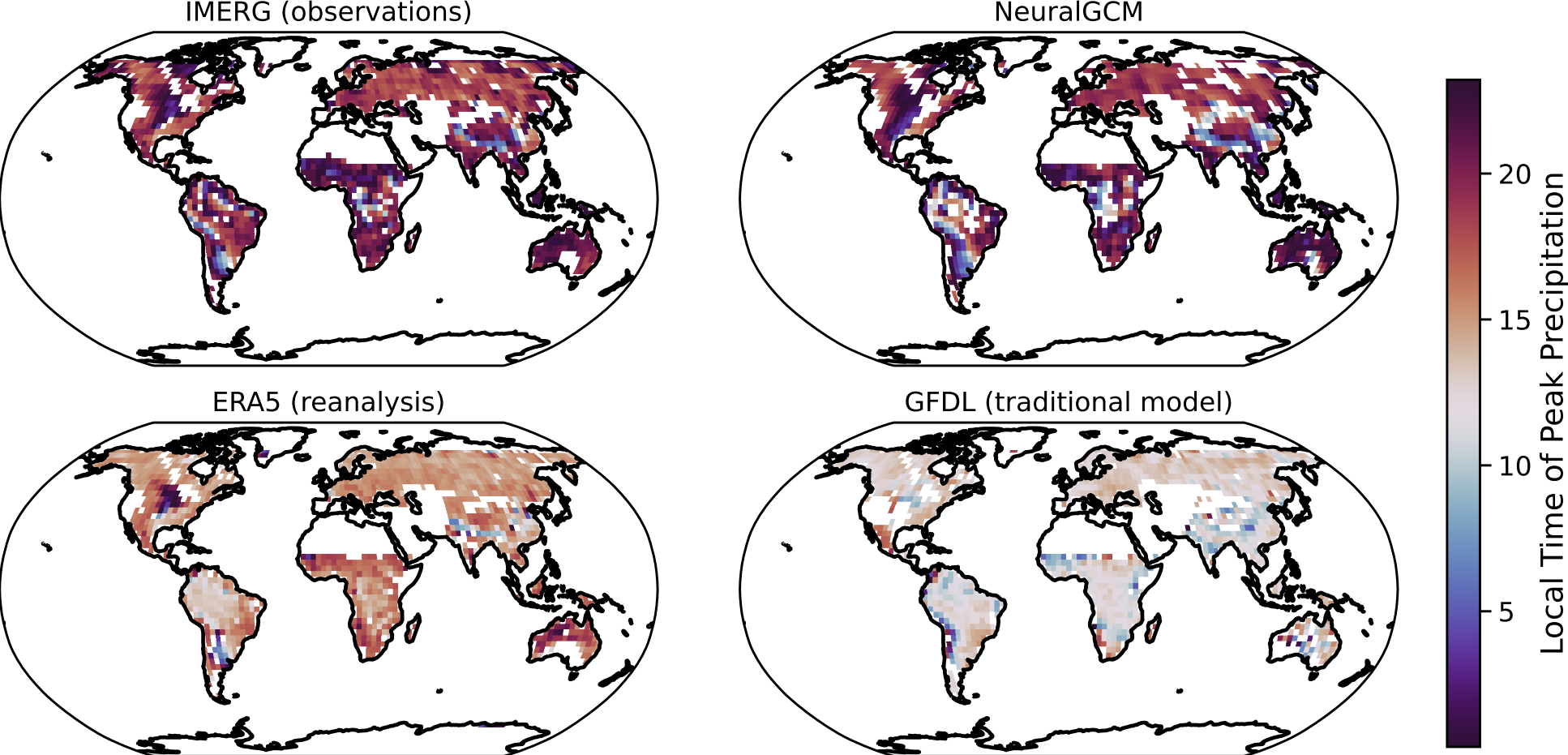

日变化规律:例如,它能更准确地再现亚马逊雨林夏季下午的降水高峰,而传统模型往往预报得过早,这对生态系统和水文研究意义重大。

该图表显示了2002年至2014年间热带地区的降水量,某些地区的日降水量甚至超过了160毫米。基于卫星降水观测数据训练而成的NeuralGCM模型(蓝色),其预测的降雨事件发生频率与IMERG数据中记录的降雨频率非常吻合(用虚线表示)。而ERA再分析模型(橙色)以及IPSL模型(绿色)则倾向于高估轻量级降水事件,同时低估强降水事件。图表展示了每年降雨量最大的那天的降水数据偏差情况:从颜色上看,与IPSL模型相比,NeuralGCM模型不太可能低估强降水事件(粉色),也不太可能高估强降水事件(绿色)。

NeuralGCM在再现降水高峰出现的时间方面表现优于其他工具,这一时间信息通过地图上的颜色来表示。IMERG卫星观测数据与NeuralGCM得出的结果在降水高峰出现的时间上较为一致,通常都出现在一天中的晚些时候。ERA5再分析数据以及NOAA的地球物理流体动力学实验室开发的模型显示的颜色则较浅,这意味着在这些模型中,降水高峰出现的时间更早,大约在中午或下午早些时候。

从论文走向田野 赋能真实世界

技术的价值在于应用,NeuralGCM已迈出从实验室走向现实决策的关键一步。

芝加哥大学与印度农业和农民福利部合作开展了一项试点项目,采用NeuralGCM模型来预测印度至关重要的季风季节开始时间。经过严格测试与筛选,相关团队最终集成了NeuralGCM来开发预报工具,该工具已于今年夏天首次投入实际应用,为印度的农业规划和防灾提供了新的科学支持。

精准预报每一场雨 是对未来的承诺

从理解一朵云的形成,到预测全球季风的变迁;从规避一场城市内涝,到保障一整年的粮食丰收——降水的奥秘,关乎人类文明的可持续发展。

当卫星的“天眼”与算法的“慧脑”相连,精准预报全球每一场重要的雨,不再是一个遥不可及的梦想。NeuralGCM的“物理+AI”融合范式,正为我们打开一扇更清晰地洞察天气与气候系统的窗户。