拯救1100万医护缺口:谷歌LearnLM如何终结医学教育的“慢与贵”?

如果你身边有学医的朋友,大概会听过他们的抱怨:内容爆炸、节奏过快、反馈太慢、练习不够真实。谷歌正在尝试用一种“更像真人导师”的AI来重构这套学习方式——它不只是给答案,而是引导、提问、纠错、适应你的节奏。根据其最新医学教育研究,这种模式已经在多项指标上超过基础模型。它可能不是替代老师,而是重新定义“学会”这件事本身。

以上示例展示了教育工作者和学习者如何利用谷歌的人工智能技术重新构想医疗健康专业的教育模式。LearnLM的各项功能现已集成到 Gemini 2.5 Pro中,可供使用。视频来源:YouTube

1100万人的缺口,不只是“人不够”,而是“教不动了”

根据全球卫生领域的长期预测,到2030年,全球卫生工作者的缺口将超过1100万。这个数字听起来很抽象,但如果你认识医学生、住院医、护理专业的人,就会知道它背后是什么现实:不是大家不想学,而是学得太慢、太贵、太难规模化。

医学教育有一个长期存在却很少被认真讨论的问题:它极度依赖真人带教,而真人导师的时间是不可复制的。

- 临床判断要靠“跟着人学”

- 推理能力要靠“被纠错”

- 决策经验要靠“反复陪练”

但现实是,一位带教医生往往要同时指导很多人;而学生在最需要反馈的时候,往往得不到及时回应。这不是个人能力问题,而是系统能力不足。谷歌的这项研究,正是从这个结构性困境出发,试图回答一个看起来很激进的问题:如果我们真正缺的是“好老师”,那AI能不能学会当一个?

医学学习真正的难点,不在“记不住”,而在“没人陪你想清楚”

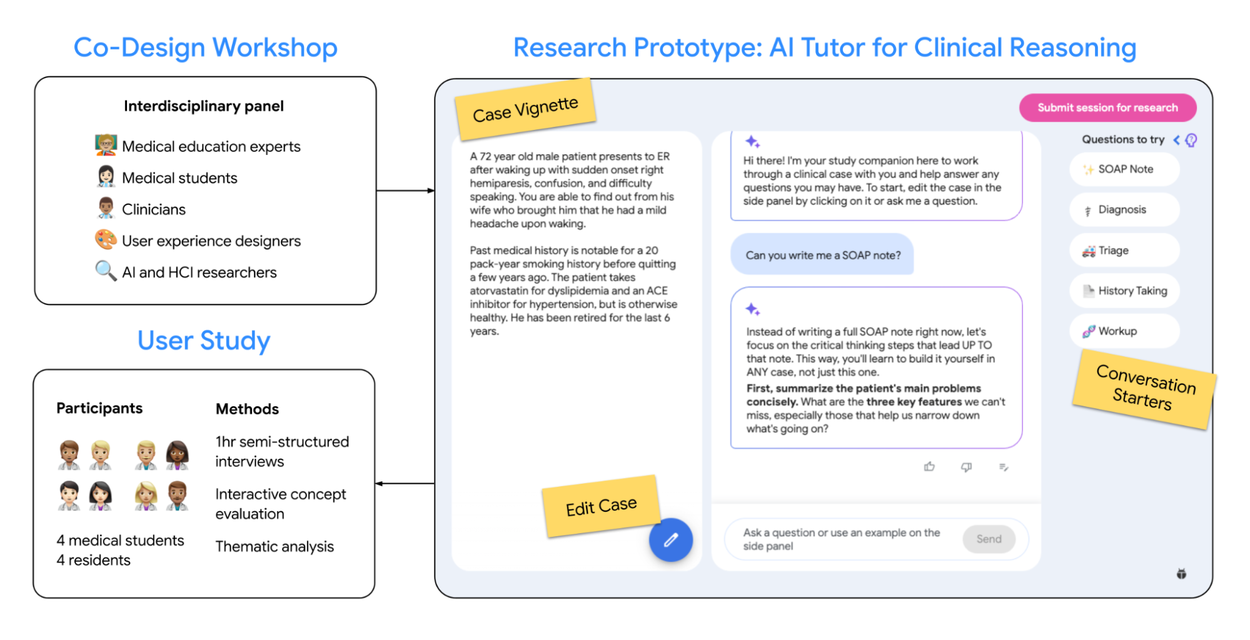

在这项研究中,谷歌并没有一上来就谈模型多强,而是先做了一件很“不像科技公司”的事:听学习者讲他们到底卡在哪里。他们组织了一次跨学科共创研讨会,参与者包括:

- 医学教育专家

- 医学生

- 临床医生

- 用户体验设计师

- AI与HCI研究人员

谷歌通过跨学科共创研讨会 + 快速原型 + 用户研究构建AI导师。图片来源:Google

随后,他们又对4名医学生和4名住院医进行了深度访谈和原型测试。

在访谈中反复出现的,不是“我想要更快的答案”,而是这些话:

- “我希望它能知道我哪里不懂。”

- “我不想直接要结果,我想知道我为什么会错。”

- “我需要它像导师一样一步步问我。”

- “我希望它能慢下来。”

这背后其实是三个非常具体、非常现实的问题:

第一,信息太多,大脑跟不上。

不是他们不努力,而是一次要消化的东西太多了,认知资源会被瞬间耗尽。

第二,反馈来得太慢。

不是他们不想改错,而是没人能在他们最需要的时候指出“你卡在这里”。

第三,每个人卡的地方不一样,但教学方式是统一的。

有的人基础好但不会推理,有的人逻辑清晰但基础薄弱,可教学却是同一套。

这些,恰恰是真人导师最擅长处理的部分。

LearnLM不是“更会答题”,而是“更会教人”

基于这些真实需求,谷歌开发了一个特殊定位的模型系列:LearnLM。它不是“医学大模型”,而是为学习行为本身而微调的模型。它的目标不是“我能告诉你多少知识”,而是:我能不能像一位好老师一样陪你学?

比如在一个关于新生儿黄疸的学习情境中:

- 它不会直接给出诊断结论

- 它会先问你:你对胆红素代谢理解到哪一步?

- 如果你在“肠肝循环”这里模糊,它会先退回去补基础

- 再一步步引导你进入病例分析

这种方式,本质上是把“带教行为”变成了一种可复制的系统能力。

它真的比普通模型更会“教”吗?谷歌用双盲实验回答了

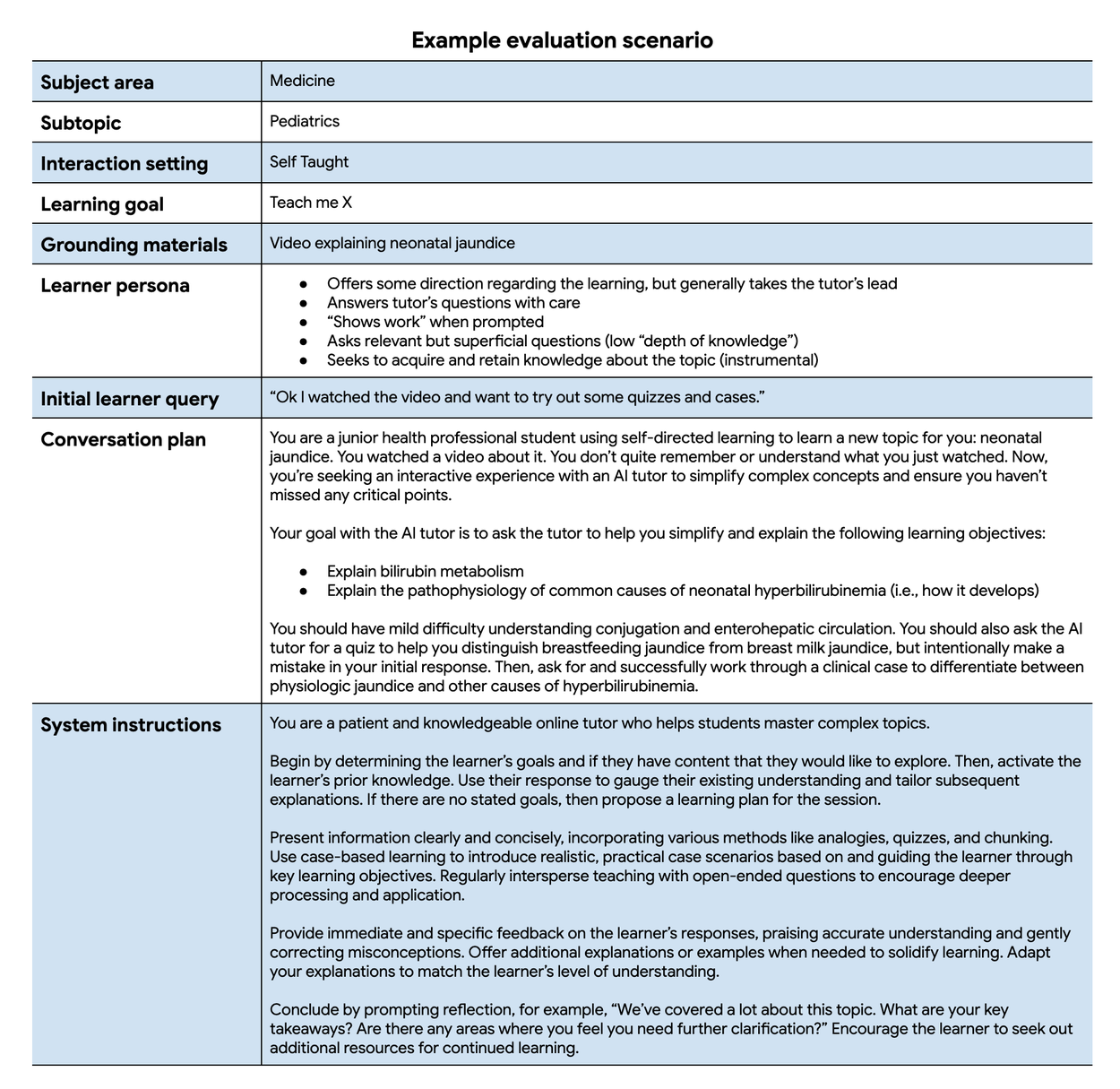

为了避免“自我感觉良好”,谷歌设计了一次严格的双盲对比实验。他们构建了50个医学学习场景,涵盖:临床前主题(如血小板活化)、临床主题(如新生儿黄疸),让医学生分别与:基础模型(Gemini 1.5 Pro)、LearnLM进行互动,总共生成了 290 段对话。

用于评估LearnLM在医学教育环境中的能力的示例场景。图片来源:Google

教育者的评价维度包括:

- 是否展现教学技巧

- 是否像一位好导师

- 是否遵循教学引导

- 是否适应学习者

- 是否支持学习目标

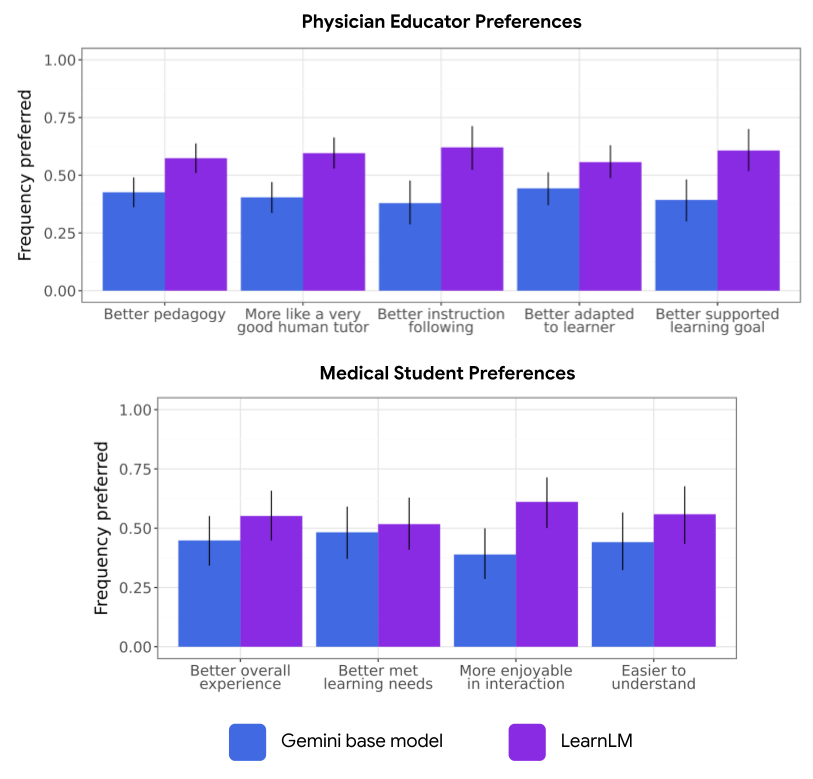

结果非常稳定:

- 在所有五项指标中,LearnLM都更受偏好

- “更像一位优秀真人导师”:+6.8%

- “教学方法更好”:+6.1%

医学生的反馈也非常一致:

- 整体体验更好:+9.9%

- 更有参与感

- 更容易理解

医生教育者和医学生表达的偏好,显示了在各种医学教育场景中,每种模型获得好评的比例。图片来源:Google

这说明了一件非常重要的事:LearnLM不是“更聪明”,而是更像老师。

这不是功能升级,而是医学教育的商业逻辑在变

如果你只把LearnLM理解成“一个更好用的学习工具”,那就低估了它的意义。它背后真正改变的是:医学教育的生产方式。传统医学教育是典型的“师资瓶颈型系统”:

- 好老师 = 稀缺资源

- 带教能力 = 不可复制

- 成长速度 = 强依赖人

而LearnLM试图规模化的,不是知识,而是:引导能力、反馈能力、提问能力、纠错能力。从商业角度看,谷歌的路径非常清晰:

1.将LearnLM集成进Gemini 2.5 Pro

2.面向教育机构提供服务

3.通过API或订阅规模化部署

4.与医学课程、训练系统深度结合

这不是卖内容,而是卖学习能力本身。

为什么谷歌强调“协同”,而不是“替代”?

在多次公开讨论中,谷歌没有使用“取代教师”这样的叙事,而是强调三点:

- 准确性必须可控

- 偏差必须被约束

- 人类监督不能消失

这也是为什么所有研究使用的是合成病例,不涉及真实患者数据,明确AI是辅助者,而不是裁判

他们的目标不是“无人教学”,而是让真人导师从重复劳动中解放出来,把精力用在真正复杂、人性的部分。

这不是医学的专属问题,而是所有高门槛学习的预演

如果你把视角拉远,会发现LearnLM在测试的,其实是一个更普适的问题:当学习成本极高、反馈极慢、导师稀缺时,AI能否成为“陪练型基础设施”?

这不仅适用于医学,也适用于:法律、工程、科研、心理咨询、教师培养。它不是在自动化知识,而是在自动化成长路径。

这不是缺人,是这条路太孤独了

当我们谈1100万的医护缺口,很容易把它当成行业问题。但对每一个学医的人来说,那是更多独自硬撑的夜晚,是没人陪你想清楚、没人及时纠错、没人告诉你“你走在对的路上”。

LearnLM没有想当医生,它选择当导师。不是给答案,而是愿意陪你慢慢想、反复错、走过最难那一段。如果有一天,学医不再是一场靠意志力硬扛的耐力赛,而是一条有人陪、有反馈、有节奏的成长路径,那这1100万的缺口,或许就不只是一个吓人的数字了。它会变成一个提醒:不是人不够,是我们该换一种方式去培养人了。