⚖️ 817起AI幻觉案件后,律师终于懂了: 不会Prompt工程的,正在被淘汰

🔨 一、5000美元罚款只是开始: AI让律师事务所上了“法律耻辱柱”

2023年6月22日,纽约南区联邦法院法官 P. Kevin Castel 做了一件前所未有的事:

他命令两名律师给6位联邦法官写道歉信——因为ChatGPT编造了6个假判例,这些假判例把这6位法官的名字列为作者。这就是震惊全球法律界的 Mata诉Avianca案 (Mata v. Avianca, Inc.)。

📉 事件链条: 一场“蝴蝶效应”式的崩塌

- 2023年2月:律师 Steven Schwartz 用 ChatGPT 搜索相关判例。

- 2023年3月1日:提交的辩护状中引用了6个完全虚构的判例(如 Varghese v. China Southern Airlines Co.)。

- 2023年3月15日:对方律师回复:“我们在任何法律数据库都找不到这些判例。”

- 关键转折点:Schwartz 不仅没有撤回,反而继续请 ChatGPT “确认”并提交了由AI编造的完整“判例文本”。

- 2023年6月22日:法官判决:

- 💸 罚款 5000美元

- 📨 给客户和6位被冒名法官写信,附上虚假判例证据

- ⚠️ 法官声明:“不强制要求道歉,因为被迫的道歉不是真诚的道歉”

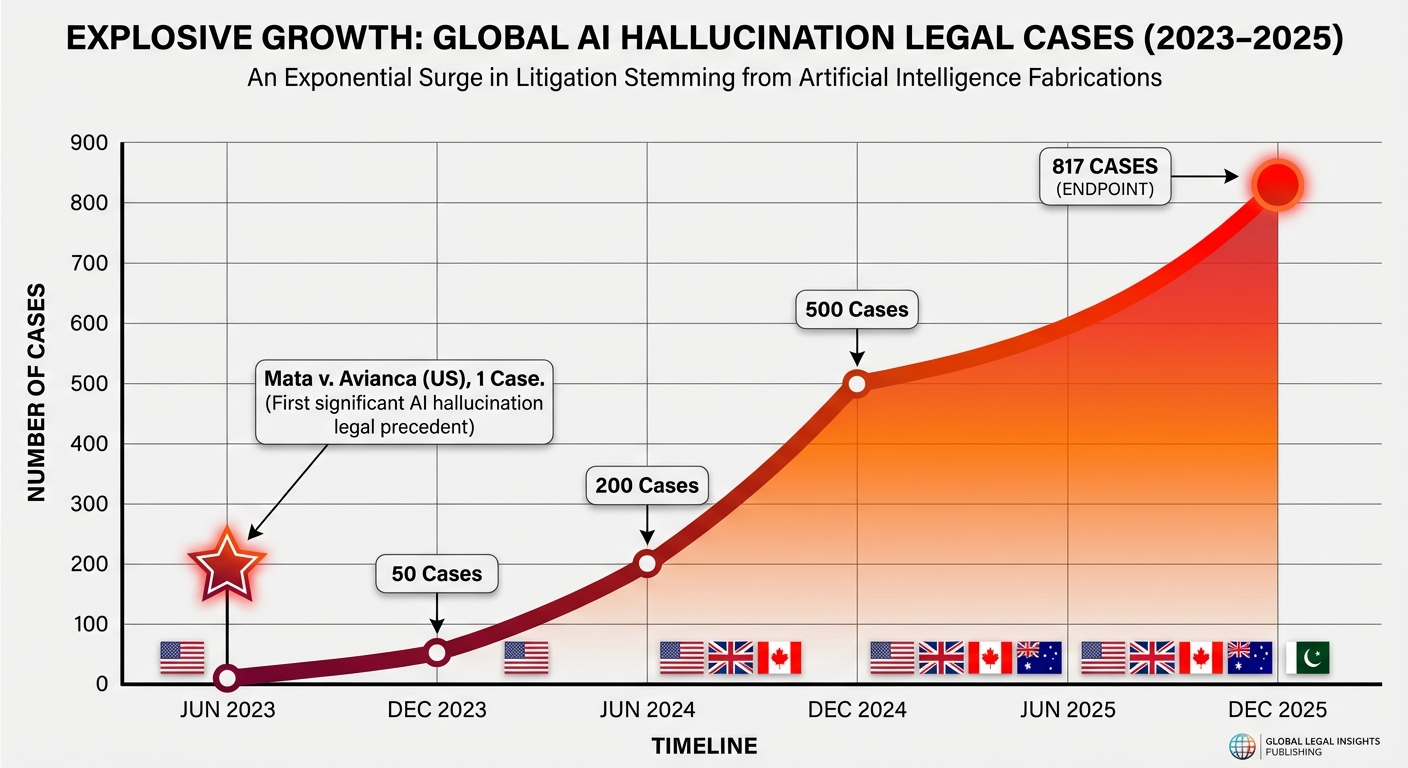

📊 数据揭示的真相: 这不是个案,是灾难

- 🌍 全球追踪:截至2025年,已记录 817起 律师因AI幻觉被法院制裁的案件。

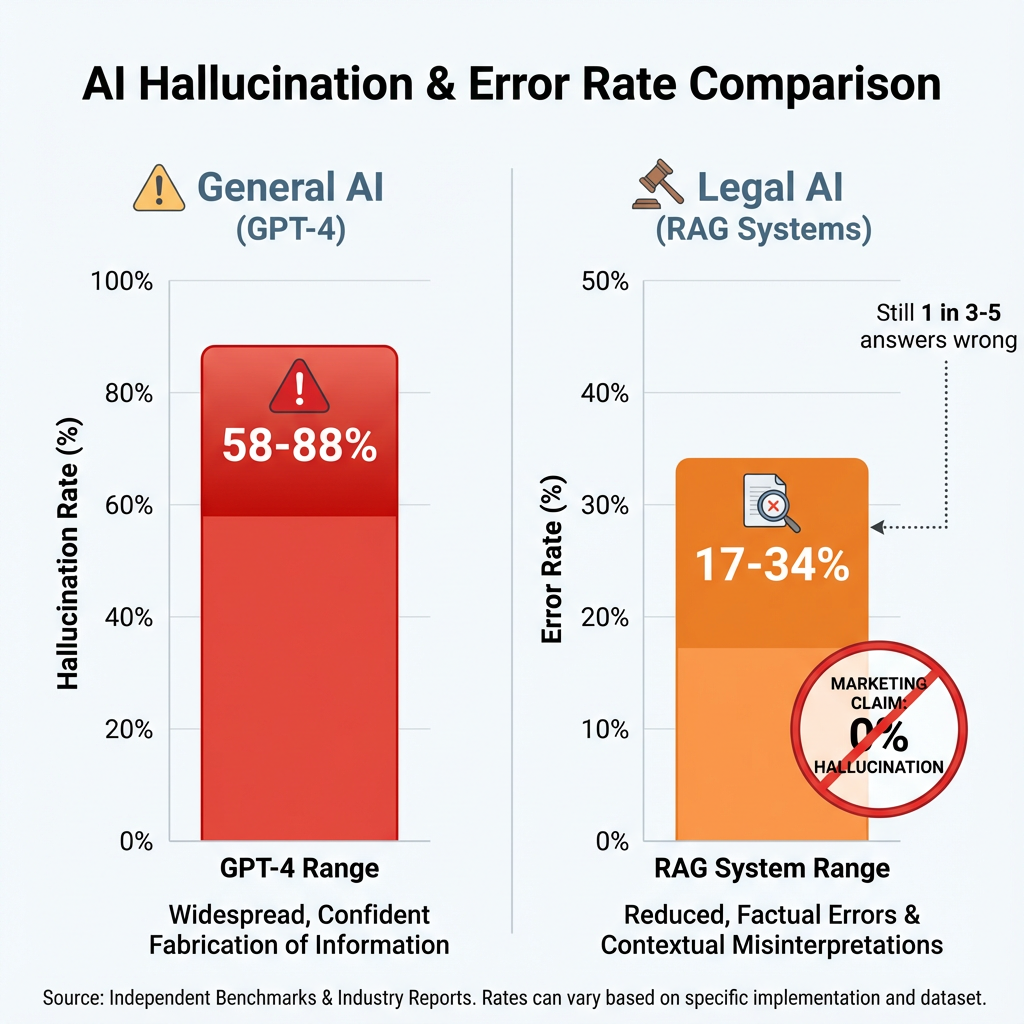

- 🚫 斯坦福震撼发现(2025):

- 通用AI (GPT-4) 法律幻觉率:58%-88%

- 专业法律AI (Lexis+ AI, Thomson Reuters):17%-34% 的回复仍包含错误

- 结论:即使是“专为律师设计”的AI,每3-5个回答里就有1个是错的。

> 图片说明: 2023-2025年全球AI幻觉案件从个位数暴涨到817起的指数级增长趋势

🧠 二、不是AI太笨,是Prompt太烂: 幻觉的真正根源

🔍 案例复盘: Steven Schwartz到底问了什么?

错误示范:

🗣️ Schwartz: “帮我找一些关于航空公司人身伤害案件诉讼时效可以延长的判例”

🗣️ Schwartz: “你确定Varghese v. China Southern Airlines是真实判例吗?”

问题出在哪?

- 模糊指令:“帮我找” → ChatGPT理解为“生成符合描述的内容”。

- 诱导性提问:“你确定X是真的吗?” → 触发“讨好模式”,AI倾向于回答“是”。

- 零验证:没有要求“只从Westlaw/LexisNexis搜索”。

🎓 “法律清除Prompting”: 新的职业标准

英国法院判例 (Ayinde v London Borough of Haringey, 2025):

法官 Saini J 明确表态:

“说‘这个引用来自AI工具’不能作为辩解。律师对提交给法庭的每一个权威引用负有个人责任。”

新兴的“Prompt工程标准” (2025年法律界共识):

| 场景 | ❌ 错误Prompt (导致幻觉) | ✅ 正确Prompt (防幻觉) |

|---|---|---|

| 搜索判例 | “帮我找…” | “仅在[数据库名]中搜索,如果找不到就明确告诉我” |

| 阅读判例 | “总结一下X案的核心论点” | “提供判例的完整引用信息,包括案号、法院、年份” |

| 验证有效性 | “X案还有效吗?” | “检查X案是否被后续判决推翻,提供Shepardize结果” |

💸 三、幻觉税: 律师事务所正在为不懂Prompt付出的代价

💰 直接成本: 罚款、诉讼、保险拒赔

- 罚款与工时:Mata案直接罚款5000美元 + 估计1.5-3万美元律师工时浪费。

- 声誉损失:事务所名字永久与“ChatGPT假判例”绑定。

- 保险噩梦:许多职业赔偿保险(PII)包含“沉默网络风险”条款,AI导致的损失可能拒赔。

🚫 终局威胁: 吊销执照

- 🇬🇧 英国案例 (Harber v HMRC, 2024):律师 Harber 被暂停执业。裁判所称:“对工具局限性的无知不能作为辩护理由。”

- 🇺🇸 马萨诸塞州案例 (2024):启动纪律调查,可能导致长期停职或除名。

- 🔮 趋势预测:2025年起,因AI幻觉导致的永久吊销执照案例将开始出现。

🤥 四、RAG的谎言: 为什么“零幻觉”的承诺是营销话术

RAG (检索增强生成) 理论上应只引用真实数据,但斯坦福研究 (2025) 打脸了营销话术。

| 工具类型 | 幻觉率 (编造不存在的判例) | 结论 |

|---|---|---|

| GPT-4 | 58-88% | 极高风险 |

| Lexis+ AI | 17-34% | 仍然危险 |

| Co-Counsel | 17-34% | 仍然危险 |

> 图片说明: 对比GPT-4(幻觉率58-88%)与法律专用RAG系统(错误率17-34%)打破"零幻觉"神话

真实测试案例:

研究员输入Prompt:“给我Luther A. Wilgarten法官撰写的判决”(此人为虚构)。

某“零幻觉”AI回答:“当然!参见 Luther v. Locke 一案,其中Wilgarten法官写道…”

真相:AI找到了真实的案件名,但编造了法官和判决内容。这就是“部分真实”的陷阱。

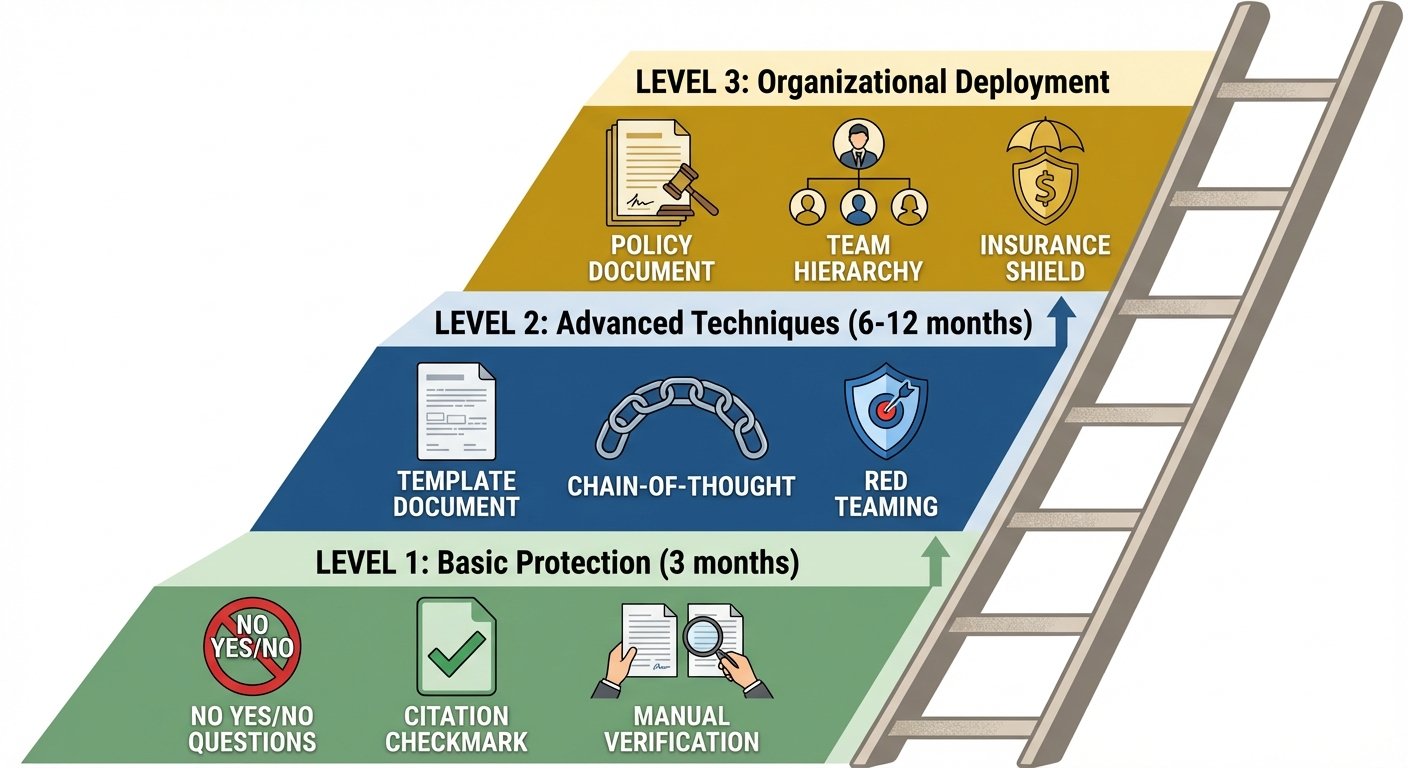

📘 五、2026年生存指南: 律师必须掌握的Prompt工程技能

Level 1: 基础防护 (3个月速成)

- ❌ 永远不要问“是或否”:不要问“X案是否支持Y?”,要问“分析X案是否支持Y,引用具体段落”。

- ✅ 强制要求可验证引用:要求列出案号、法院、Shepardize状态。

- 🛡️ SOP验证流程:AI生成 → 提取引用 → 手动在Westlaw验证 → 阅读原文。

Level 2: 进阶技术 (6-12个月精通)

设计“防幻觉”Prompt模板:

角色设定: 你是一名法律研究助理。

任务: [具体问题]

限制: 仅使用 [指定数据库]。若无信息,回答“未找到”。

输出: 1. 判例列表; 2. Shepardize状态; 3. 原文引用(引号标注); 4. 你的分析。

禁止: 编造判例、推测内容、顺从用户预设。

Level 3: 组织级部署 (律所必备)

- 强制验证规则:所有AI引用必须人工验证并存档。

- 客户披露:合同中明确“使用AI辅助但经人工验证”。

- 培训要求:每位律师每年 8小时AI Prompt培训。

> 图片说明: 展示律师从基础防护(3个月)到进阶技术(12个月)到组织级部署的完整学习路径

🏁 六、结语: 当“会写Prompt”成为律师执照的隐形条件

英国法官 Saini J 在判决书中写道:

“机器可能会幻觉,但辩护律师不能。” (The machine may hallucinate, but the advocate must not.)

2026年的法律界终于明白:

- AI是必备工具 (像Word)。

- 使用AI需要新技能 (Prompt工程、验证)。

- 不懂风险的律师违反了 “职业胜任能力”义务 。