OpenAI被迫给AI“上锁”:一个猜年龄的功能,背后是一场百亿市场的生死赌局

当美国联邦贸易委员会的调查文件与多起未成年人诉讼案摆在面前,OpenAI的选择题只剩下一个:要么主动为ChatGPT装上“防护栏”,要么等待更严苛的法律勒令其停业整改。

2026年1月20日,OpenAI在ChatGPT消费版中推出了一项看似微小却影响深远的功能:年龄预测。它不再相信用户在注册时勾选的“我已满18岁”,而是像一个数字侦探,通过分析账号的注册时长、活跃时段、聊天习惯,来推断屏幕对面的人是否可能是个孩子。

这项功能标志着AI平台未成年人保护,从依赖诚信的“君子协定”,迈入了用技术进行“行为识别”的新阶段。其背后,是全球监管的重压、千亿市场的合规挑战,以及科技巨头们在“扩张”与“安全”之间的一场艰难平衡。

01 监管高压:不做不行,一场价值千亿的合规冲刺

OpenAI推出这项功能,绝非主动创新,而是一场应对生存危机的防御战。

直接导火索是来自美国联邦贸易委员会(FTC)的调查。监管机构的核心质疑点在于:AI聊天机器人是否对青少年构成了无法控制的风险。更严峻的是,OpenAI还卷入了数起与未成年人相关的诉讼,其中一起甚至涉及青少年自杀。这些事件将OpenAI推至舆论和法律的火山口。

此前,整个行业依赖的是“自愿申报+内容过滤”的被动模式。用户只需勾选一个复选框,就能访问几乎所有内容。这种模式形同虚设,无法阻止未成年人冒用成人账号。

然而,新的全球监管趋势要求平台承担“看门人”责任。以美国、欧盟为代表的监管机构明确要求,即便是“混合受众”平台(用户既有成人也有儿童),也必须采取积极措施保护未成年人。对于拥有超10亿用户的ChatGPT来说,这从道德选择题变成了法律必答题。

新旧保护模式对比

对比维度 | 传统“君子协定”模式 | OpenAI“行为识别”模式 |

核心理念 | 信任用户,被动拦截已定义的有害内容。 | 持续评估,主动识别用户并动态调整防护。 |

技术基础 | 关键词过滤、静态内容分级库。 | 多维度行为分析AI模型(账户时长、活跃模式、交互偏好等)。 |

主要漏洞 | 虚假申报、冒用成人账号完全无法防范。 | 可能存在误判,但为成年人提供了便捷申诉通道。 |

合规价值 | 在新规下已明显不足,面临法律风险。 | 主动、可论证的技术方案,是应对监管审查的关键举措。 |

02 技术判断:如何让AI学会“察言观色”

这个“年龄预测”模型的工作原理,就像一位经验丰富的老师观察新同学。它不只听你说什么(申报年龄),更看你怎么做(行为模式)。

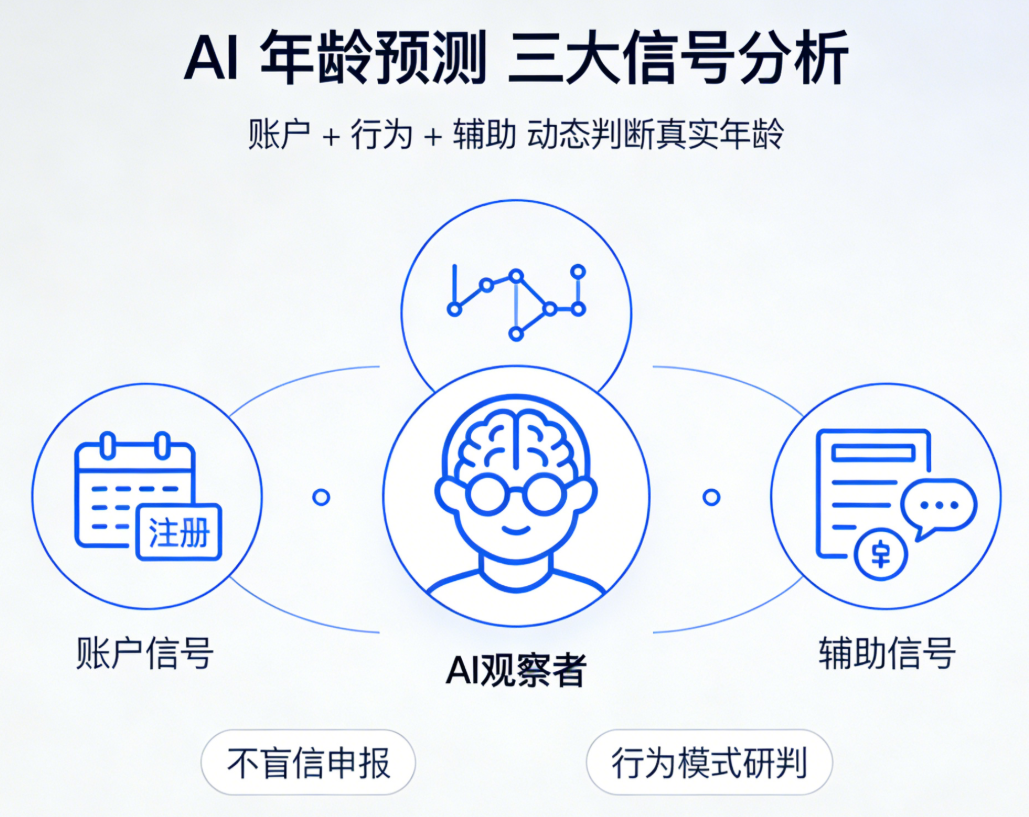

模型主要分析三大类信号:

- 账户信号:账号注册了多久?是新号还是老号?

- 行为信号:是否总在深夜或上课时间活跃?提问的内容是偏向大学课题还是卡通动漫?对话的风格和长度有何特点?

- 辅助信号:用户最初自己填报的年龄(仅作参考,不盲信)。

其核心优势在于 “动态” 。系统会持续观察,不断修正判断。一个成年人如果长期像青少年一样使用ChatGPT,也可能被暂时纳入保护范围;反之,一个试图模仿成人用语的孩子,也难逃系统的法眼。

一旦模型高度怀疑用户未满18岁,ChatGPT将自动启用五层安全防护网,强制过滤:

- 直接展示的暴力、血腥内容。

- 可能诱导模仿的危险“网络挑战”(如极端恶作剧)。

- 涉及性或暴力的角色扮演。

- 自残、自杀相关的描述与引导。

- 宣扬极端节食、身材羞辱的审美内容。

03 商业棋局:安全合规是门大生意

对于OpenAI,此举远不只是“做公益”,而是一盘深思熟虑的商业棋局,核心是 “用安全换空间”。

首先,化解最紧迫的法律与声誉危机。建立一套可被监管机构审核的主动防护体系,是应对FTC调查、平息诉讼风波最有力的回应。这直接关乎公司能否在关键市场持续运营。

更重要的是,为未来真正的“利润区”扫清障碍。多项报道指出,OpenAI计划在2026年第一季度为验证后的成人用户推出 “成人模式” 。坚固的未成年人防护墙,是安全开启这片更高商业价值区域(可能包括更宽松的内容政策和高级功能)的唯一前提。这实则是“疏堵结合”,在保护青少年的同时,为探索订阅、服务等多元收入模式开辟道路。

此外,配套的家长控制功能(设置静默时间、管理聊天记忆),是将通用工具转化为“家庭版”服务包的关键一步,为未来推出面向家庭的增值订阅服务埋下伏笔。

04 行业影响:掀翻旧桌,设立游戏新规

OpenAI此举,为整个AI行业树立了一个难以回避的新标准,可能引发一场“行业竞争”。

它标志着判断AI是否安全的维度,正从单纯的 “内容过滤” ,升级为 “用户理解” 与 “合规前瞻性” 的综合比较。未来,评判一个AI平台是否可靠,不仅要看它能否拦截有害信息,更要看它能否精准识别并保护脆弱的用户群体。

这将显著提高行业准入门槛。初创公司若想服务大众市场,必须在研发初期就将复杂的年龄识别与分级体系纳入架构,这无疑增加了技术难度和合规成本。优势将进一步向拥有海量用户行为数据用于模型训练、且能承担高昂合规费用的头部企业集中。

05 争议与挑战:没有完美的规则

尽管设计周密,但新系统仍面临三重拷问:

1. 行为等于年龄吗?

模型基于“行为与年龄关联”的统计规律,但规律总有例外。夜班工作者、从事教育研究的成人可能被误判为青少年;而早熟的少年也可能模仿成人模式绕过防护。OpenAI承认,模型仍需持续优化精度。

2. 隐私边界在哪里?

为预测年龄而持续收集分析用户的对话偏好、活跃时间等深度行为数据,引发了隐私担忧。OpenAI如何确保这些敏感数据不被滥用或泄露,将是公众和监管持续关注的焦点。

3. 防护网够密吗?

当前系统主要针对“显性有害内容”,但对于网络诈骗、情感操控、极端思想灌输等“隐性风险”,以及需要家长主动操作的控制功能实际使用率,仍是防护的薄弱环节。

OpenAI的“年龄预测”功能,是AI行业走向成熟必须经历的“成人礼”。它残酷地揭示:当一项技术强大到足以影响心智时,其创造者必须首先学会如何承担责任。

这项功能远不只是一个技术开关,它是OpenAI在理想与现实、创新与责任、增长与安全之间寻求平衡的关键支点。对于整个行业而言,这更是一次清晰的信号:在AI的竞技场上,最终的赢家不仅是跑得最快的,更必须是走得最稳的。未来,只有将技术红利与安全护栏同步搭建的公司,才能穿越周期,赢得市场的长期信任。