别被最强大脑拖垮了:当万亿模型沦为拨号上网,IBM正用效率拆掉英伟达的利润墙

在硅谷的宏大叙事里,过去两年的主旋律是大。OpenAI、谷歌、Meta陷入了一场近乎偏执的军备竞赛:模型参数从千亿跃升至万亿,每一分每一秒都在刷新跑分纪录。然而,当这些庞然大物进入银行、保险和医疗机构的生产线时,企业主们发现了一个冰冷的现实:AI的智商很高,但周转率极低。

高昂的硬件费、动辄数秒的延迟、以及英伟达GPU在处理实时业务时的笨重,正在榨干企业的利润。一直被认为在AI赛道反应迟钝的IBM,突然联手加速芯片新贵Groq,在AI应用最核心的推理环节发起了一场革命。这不仅是一次技术合作,更是一场关于AI算力成本、企业自主权与工业效率的“拨乱反正”。

效率的死穴:为什么你的AI还停留在拨号上网时代?

要理解这场突袭的深远意义,必须先拆解目前AI行业最大的谎言:算力的通用性。在底层逻辑中,AI的生命周期被划分为“训练”与“推理”。训练是让AI在实验室里闭关修炼、吞噬海量数据;推理则是它学成下山、在毫秒之间对真实世界给出反馈。

目前,全球算力的支撑是英伟达的GPU。这款原本为游戏渲染而生的芯片,本质上是一个擅长大力出奇迹的并联机器。它像是一个拥有几万名搬运工的物流公司,在搬运整座大山(训练模型)时表现卓越。但在面对需要精密逻辑推导、多步骤连续响应的代理式AI(Agentic AI)时,它却显得极其笨重。

这种错位导致了一个尴尬的商业现状:Groq创始人Jonathan Ross指出,AI目前正处于拨号上网时代。模型虽然聪明,但由于GPU在处理逻辑推演时,数据需要频繁在计算单元和存储之间往返,“交通拥堵”严重,用户往往需要等待数秒甚至数分钟才能得到结果。

在瞬息万变的金融交易或紧急医疗决策面前,这种延迟不仅仅是体验问题,更是生产力的自杀。当CFO们开始审计那张天文数字般的算力账单,却发现换回的是“转圈等待”的加载图标时,AI的商业幻梦便开始破裂。

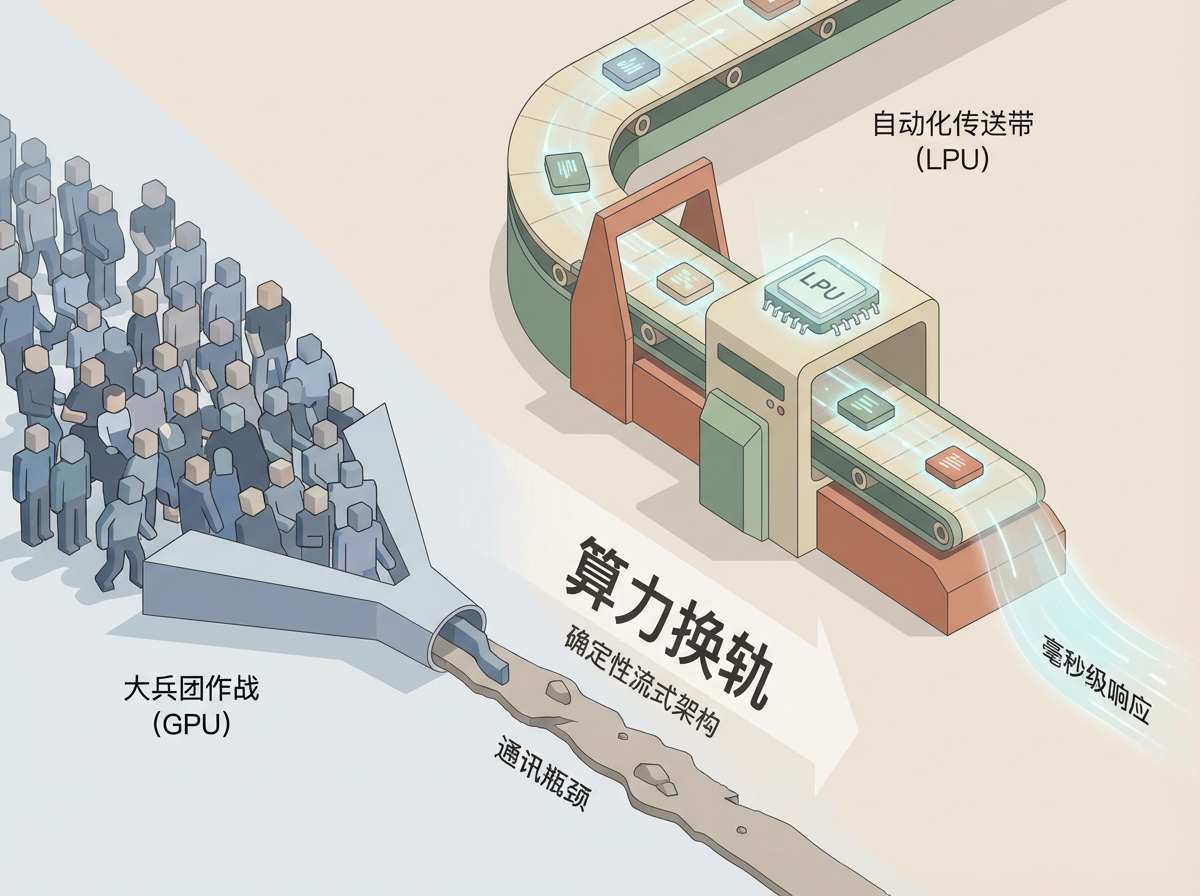

算力换轨:从大兵团作战到自动化传送带

市场急需一种全新的架构,能够像工业流水线一样,不仅能处理数据,更要能以确定性的速度输出智能。IBM切入战场的战略支点,正是引入了专门为语言推理而生的LPU(语言处理单元)。

与GPU那种“大家一起上”的并联模式不同,LPU采用的是一种确定性流式架构。为了直观理解,我们可以将其想象成工厂里的自动化传送带:数据进入芯片后,走哪条路、每一微秒到达哪个位置,都是在软件层面提前排好的精准计划。它彻底取消了GPU内部复杂的排队和调度逻辑,消除了数据往返产生的通讯瓶颈。

这种从底层硬件进行的换轨,直接将AI的响应速度拉升了5倍。它不再是像拨号上网那样断断续续地吐字,而是实现了毫秒级的瞬间响应。这种效率的飞跃,意味着AI真正具备了进入实时业务场景的门票——只有当算力变得像光纤一样顺滑且廉价时,AI才能从实验室的奢侈品变成企业的必需品。

消灭“转圈圈”:一家医保巨头如何靠毫秒级响应跑通ROI?

商业世界最昂贵的成本往往隐藏在“等待”中。IBM通过其AI编排平台 watsonx Orchestrate,将这套高速硬件转化成了企业能直接调用的工业化工具,并在医疗理赔领域完成了一次精准的爆破。

一家每天处理数万笔业务的大型医疗保险服务商,曾长期被高智商、低效率困扰。其AI代理在核对理赔条款时,需要调取成千上万页的复杂合同。在旧的GPU架构下,由于硬件推理效率低下,AI每推演一步逻辑,系统都会产生明显的卡顿。医生或患者在查询时,不得不面对长时间的“加载中”,这直接导致呼叫中心积压,理赔审批周期拉长。

接入IBM watsonx系统并配合LPU硬件后,核心指标发生了质变:AI代理的处理速度提升了5倍,原本需要数十秒的逻辑核验被压缩到了毫秒级。这种极致的速度不仅消灭了排队现象,更重塑了财务报表。由于处理单次查询的算力能耗和设备摊销成本显著下降,AI理赔的投资回报率(ROI)首次跑赢了传统人工审核。

这个案例向全行业证明:AI的生产力不看它能写多优美的散文,而看它在处理业务逻辑时,能否彻底消灭那个代表低效的旋转图标。

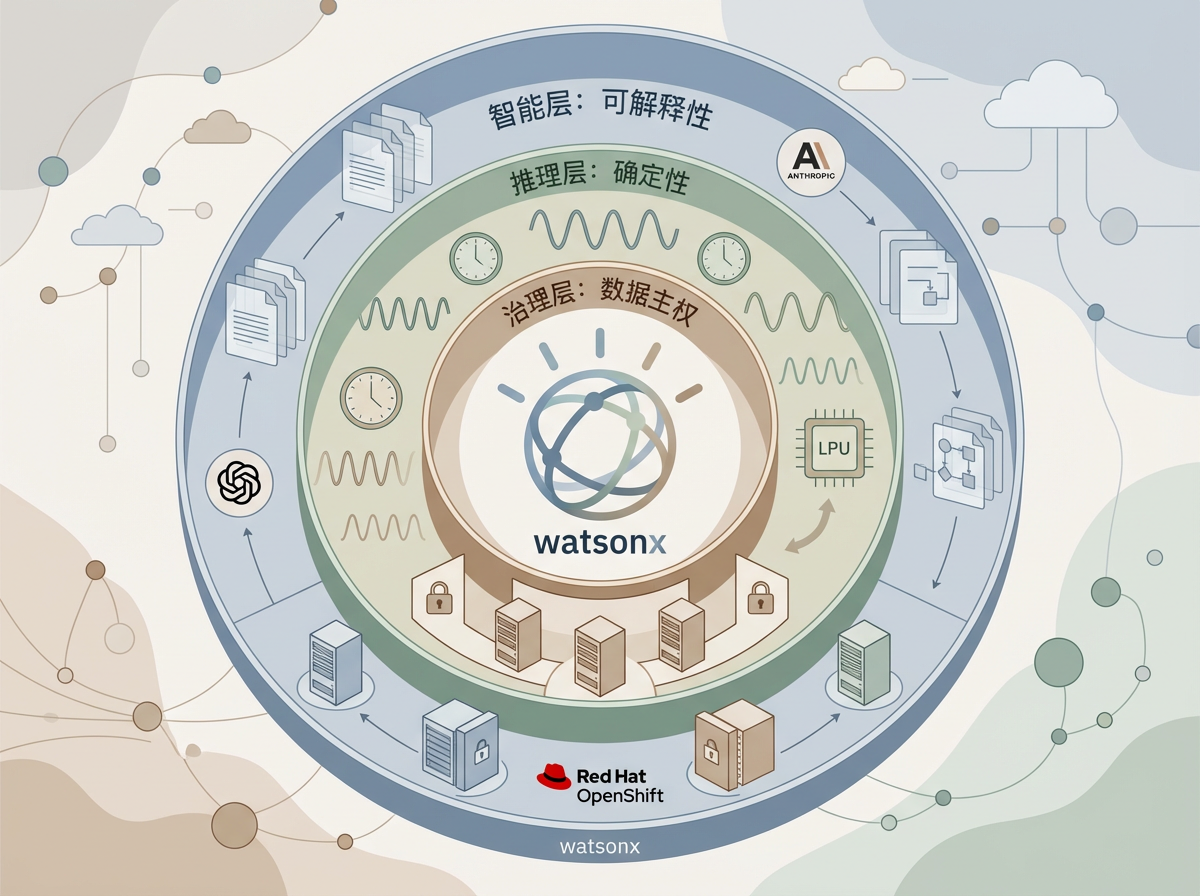

透视 watsonx:大机构买单背后的三重安全阀

然而,对于金融、医疗等高度受监管的巨头而言,仅仅有速度是不够的。如果AI是一个无法控制、不可审计的快嘴黑盒,企业依然不敢大规模部署。IBM之所以能吸引这些金主,是因为其watsonx平台在提速的同时,设置了三重严密的安全阀:

其一是智能层的“可解释性”。

IBM引入Anthropic的Claude模型,看中的是其逻辑的严密性与透明度。在银行审核贷款等敏感场景,AI必须清晰地告知:我是基于哪条法律条文或信用记录给出的结论。IBM确保了每一笔决策的可审计性,解决了合规部门的最大担忧。

其二是推理层的“确定性”。

通过专用的LPU架构,IBM提供的不仅是快,而是“稳定的快”。在复杂的企业工作负载下,AI的响应时间变得高度可预测,不会因为访问量突增而出现性能抖动。对于需要保障服务水平协议(SLA)的企业来说,这种确定性就是核心竞争力。

其三是治理层的“数据主权”。

依托红帽(Red Hat)OpenShift的底层支持,IBM确保AI可以运行在任何地方。它允许大银行在自家的物理隔离机房里运行AI,而不必担心敏感数据流向公有云。这种运行环境的自由,是大型机构最深的护城河。

供应链博弈:模块化自主权 vs. 跨国巨头的生态锁死

在AI的下半场竞赛中,企业面临两种截然不同的商业路径,这直接决定了未来十年企业技术资产的安全与独立性。

微软与谷歌采取的是垂直一体化路径。微软深度绑定OpenAI,并将模型垂直嵌入Azure云平台。这种模式的本质是生态系统锁定:一旦企业进入,其数据、算力和模型选型将被完全锁死在围墙内。如果供应商涨价,企业几乎没有迁移的能力。根据2025年Q3财报,微软1230亿美元的年化云收入中,很大一部分来自于这种高粘性的强制绑定。

相比之下,IBM选择做独立整合者。它的watsonx平台不卖“围墙”,而卖“管理标准”。这种模块化策略给予了企业供应链自由:今天Groq的芯片快,就接Groq;明天出现了更高效的模型,企业可以随时无缝切换。这种灵活性对于跨国公司和对主权安全敏感的机构至关重要。IBM赌的是:随着AI成为像电力一样的核心基础设施,成熟的企业最终会要求具备随时切换、不被任何一家巨头绑架的能力。

业化转场:AI竞争的终局是利润率

经过了两年的激进扩张,全球AI产业正迎来一个分水岭:从实验室奇迹转向确定性的工业”。在真实的场景里,首席执行官们关心的不再是跑分记录,而是三个硬指标:速度、成本、可靠性。

IBM通过布局推理层,实际上是在抢占AI时代的“应用出入口”。在未来的AI版图中,推理算力的消耗量将是训练算力的100倍以上。这意味着,谁能掌握更高效、更廉价的推理路径,谁就拥有了AI普及时代的定价权。

当微软和谷歌还在为了抢夺高性能GPU(训练工具)而向英伟达支付巨额溢价时,IBM已经开始利用LPU(应用工具)优化企业的利润表。

这种避实就虚的策略,反映了老牌巨头对商业常识的回归:一项技术如果不能让企业变省钱、变快,那它就只是一个昂贵的、终将破裂的科技泡沫。 IBM正在通过掌握使AI实用化的基础设施,重新定义自己的领导地位,在这场关于“效率”的战争中,AI的真金白银时代才刚刚开始。