图灵奖得主杨立昆离职Meta创业:他为什么要背叛大语言模型

一、当AI教父说"你们都走错路了"

去年11月,一条新闻在科技圈炸开:

杨立昆(Yann LeCun),Meta的首席AI科学家、图灵奖得主、被称为"深度学习三巨头"之一的传奇人物,离开了Meta。

这不是普通的离职。他创办了一家新公司Advanced Machine Intelligence Labs(AMI),还没正式启动就准备以35亿美元估值融资5.86亿美元。

更重要的是,他公开批评硅谷正在走向死胡同。

在巴黎家中接受采访时,65岁的杨立昆说了一段让很多人不舒服的话:

"硅谷存在一种羊群效应,每个人都必须做同样的事情。这使得其他一些从长远来看可能更有前景的方法几乎没有生存空间。"

他说的"同样的事情",指的就是大语言模型(LLM)——也就是ChatGPT、Claude、Gemini这些聊天机器人背后的核心技术。

等等,这些AI不是很厉害吗?为什么杨立昆说它们是"死胡同"?

二、先搞清楚:大语言模型到底有什么问题?

问题1:它们会"胡说八道",而且改不掉

如果你用过ChatGPT或其他AI聊天工具,可能遇到过这种情况:

它信心满满地告诉你一个"事实",听起来特别有道理,但一查发现完全是编的。

这就是AI领域臭名昭著的"幻觉"(Hallucination)问题。

OpenAI在2025年的研究论文中承认:即使是GPT-5,"幻觉"问题仍然存在,这是所有大语言模型的根本性挑战。

为什么会这样?

OpenAI的解释是:大语言模型的训练方式天然就鼓励"猜测"而不是承认"我不知道" 。

想象一下多选题考试:

- 如果你不知道答案但瞎猜一个,有1/4的概率对

- 如果你空着不填,得分就是0

大语言模型在训练时,评分系统只看"准确率",不看"诚实度"。所以它学会了:有疑问时就编一个听起来合理的答案,反正总比说"我不知道"得分高。

2024年的一篇学术论文更是证明了一个数学事实:从理论上讲,"幻觉"问题是不可能彻底消除的。

这在实际应用中意味着什么?

2025年10月,澳大利亚政府花了44万澳元请德勤做报告,结果发现里面有虚假的学术引用和不存在的法院判决引文——因为德勤用AI写的。

同年11月,加拿大纽芬兰省政府花了160万加元请德勤做健康人力资源规划报告,又发现至少4个引用的研究论文根本不存在。

这不是AI偶尔犯错,而是结构性的问题。

说明: AI幻觉问题示意图(看起来靠谱实际瞎编)

问题2:越复杂的任务,错误越积越多

杨立昆指出了大语言模型的另一个致命缺陷:它们缺乏前瞻性,只会"预测下一个词"。

这是什么意思?

想象你在写一篇文章。大语言模型的思考方式是:

- 看前面已经写的内容

- 猜测下一个词应该是什么

- 写下这个词

- 重复步骤1-3

它没有整体规划,不知道自己最终要说什么,更不会检查逻辑是否自洽。

所以当任务变得复杂时,问题就像高速公路上的连环车祸一样越积越多。

杨立昆说:"这种系统无法规划它要做什么。目前的LLM系统绝对做不到这一点。"

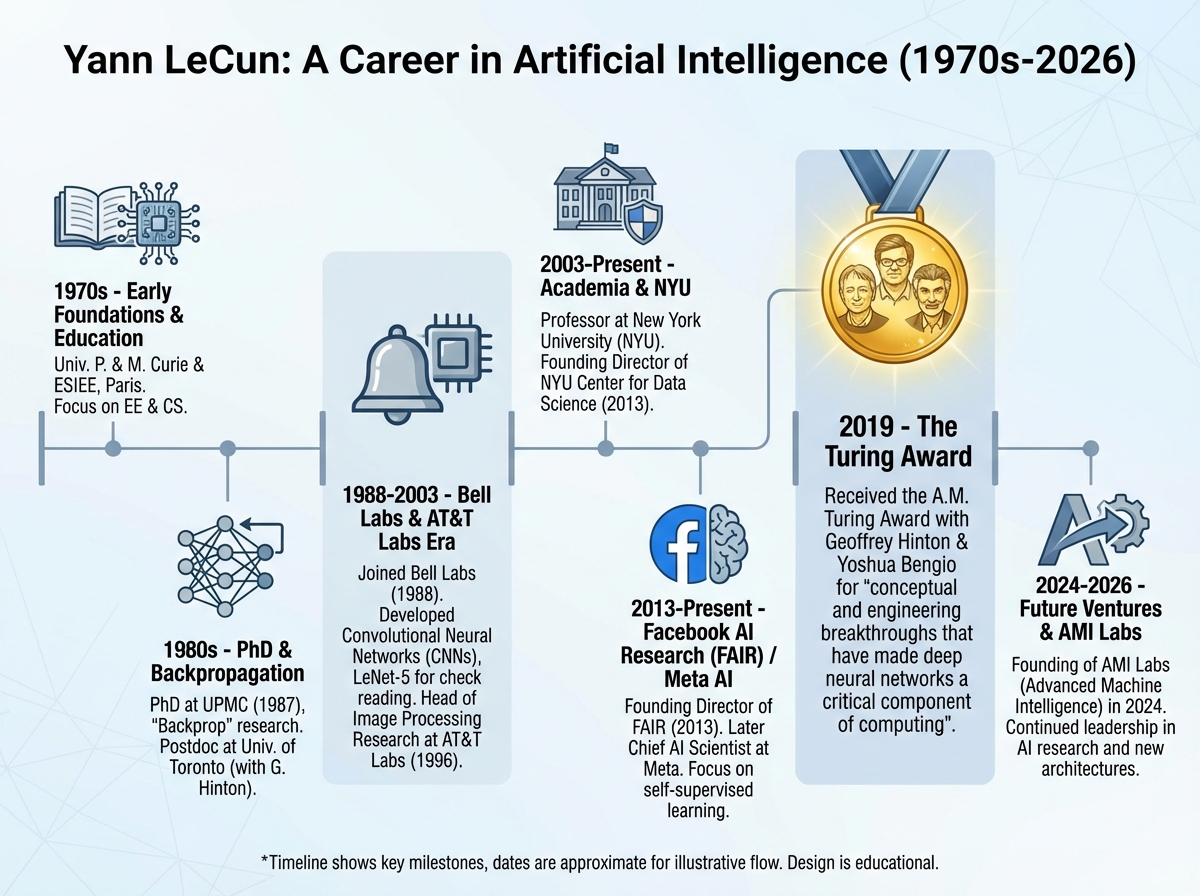

三、为什么杨立昆有资格说这些话?

在听他的批评之前,我们需要了解一个背景:他自己就是现代AI的奠基人之一。

从被嘲笑的"疯子"到AI教父

20世纪70年代,杨立昆还在巴黎读工程系时,就接受了一个当时被认为"毫无希望"的理念——神经网络。

那时候,几乎所有研究人员都觉得这个想法太蠢了,根本没有实际用途。

但杨立昆坚持了下来。

10年后,在贝尔实验室工作的他证明:神经网络可以学会识别信封和支票上的潦草字迹。这在当时是革命性的突破。

到了2010年代,神经网络成了AI领域的核心技术,支撑起了:

- 人脸识别系统

- 语音助手

- 自动驾驶汽车

- 还有今天的ChatGPT

2018年,杨立昆和另外两位科学家因为在神经网络领域的贡献,共同获得了图灵奖——计算机界的诺贝尔奖。

换句话说:ChatGPT能存在,很大程度上要归功于杨立昆几十年前的研究。

说明: 杨立昆职业生涯时间线(从70年代到2026年)

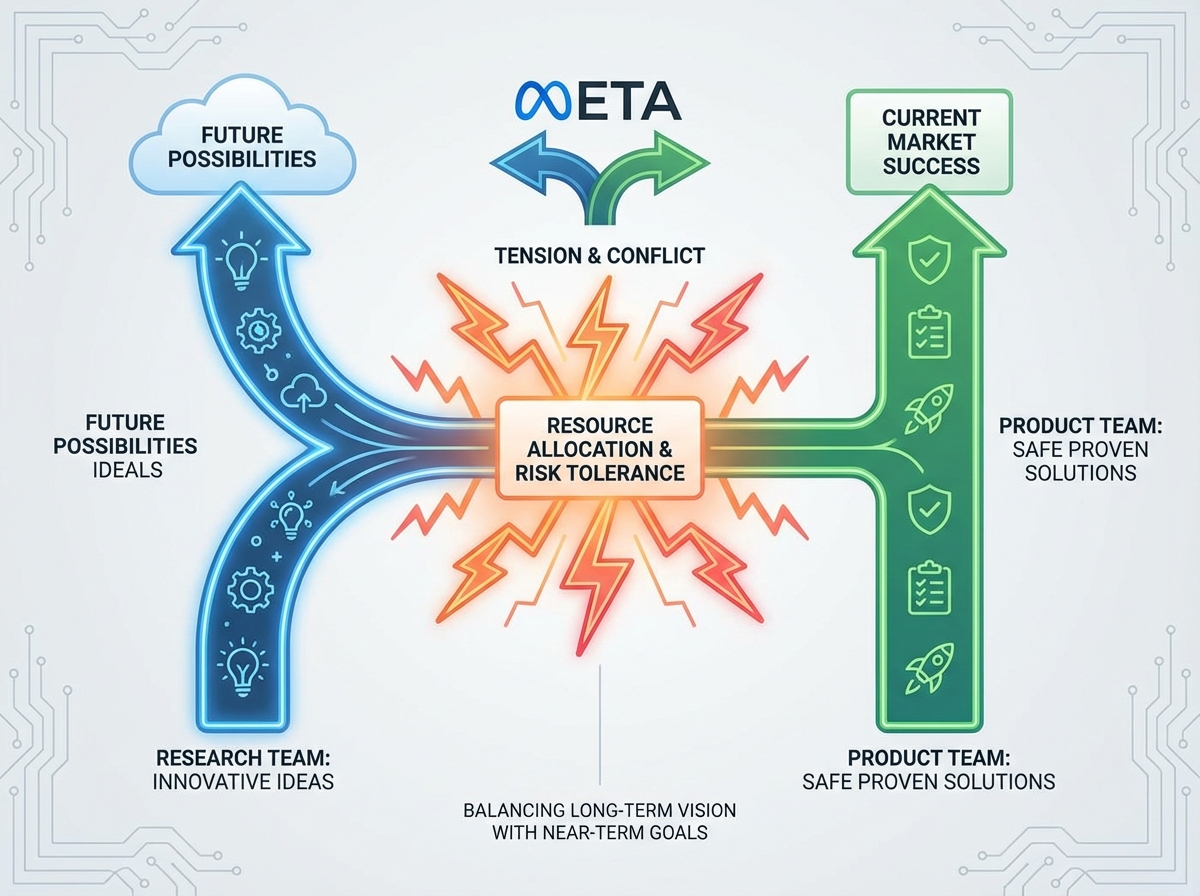

四、在Meta发生了什么?为什么他要离开?

杨立昆在Meta工作了12年——5年创办并领导Facebook AI Research(FAIR),7年担任首席AI科学家。

但2025年,事情开始变味了。

Llama 4的"数据造假"丑闻

2025年4月,Meta发布了旗舰语言模型Llama 4。但杨立昆承认:"发布的基准测试结果有点造假。团队用不同的模型测试不同的基准,来操纵数据。"

这件事几乎在发布后立刻就被发现了。

CEO扎克伯格非常生气,基本上对所有参与者失去了信心,并把整个生成式AI组织边缘化了。很多人已经离职,还有很多人将要离职 。

研究与产品团队的断裂

杨立昆说,研究团队有很多新想法和"真正酷的东西",但产品团队只会选择"安全且经过验证"的方案。

当你只做安全的事情时,你就会落后。

最终,留在Meta变得"政治上很困难"。

杨立昆说:"我确信Meta有很多人,包括也许是新任首席AI官Alex(Alexandr Wang,28岁的Scale AI前CEO),希望我不要告诉全世界LLM基本上是通往超级智能的死胡同。但我不会因为某个人认为我错了就改变主意。我没错。作为科学家的诚信不允许我这样做。"

说明: Meta内部研究与产品方向分歧示意图

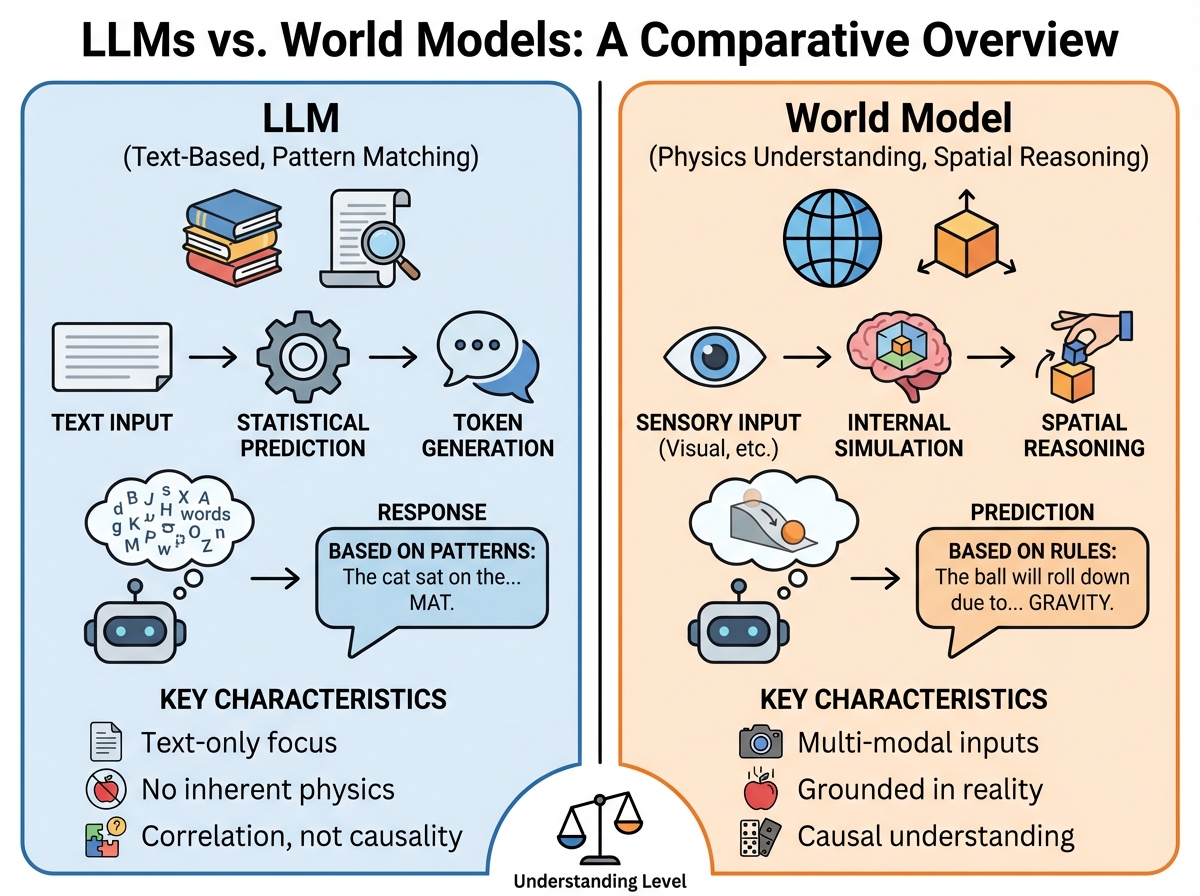

五、杨立昆的新赌注:World Model(世界模型)

那么,如果大语言模型是死胡同,什么才是正确的方向?

杨立昆的答案是:World Model(世界模型)。

什么是世界模型?

简单说,世界模型是一种能理解物理世界如何运作的AI。

举个例子来对比:

大语言模型的思考方式:

- 看到"球从桌子上滚下来"这句话

- 预测下一句可能是"球掉在地上"

- 但它不知道"为什么球会掉下来",只是因为训练数据里这样写过很多次

世界模型的思考方式:

- 理解"球"是一个物理对象,有重量

- 理解"重力"会让物体下落

- 理解"桌子边缘"是一个边界

- 基于对物理规律的理解,推理出"球会掉下来"

杨立昆说:"我们最好的AI系统可以通过律师资格考试、创作诗歌、赢得国际数学奥林匹克竞赛、编写代码,但我们仍然没有一个机器人能做到5岁孩子能做的事情。"

为什么?因为5岁孩子理解物理世界,而AI不理解。

AMI Labs要做什么?

杨立昆的新公司AMI Labs将专注于开发"世界模型":理解物理世界、拥有持久记忆、能够推理和规划复杂行动序列的AI系统 。

公司将使用V-JEPA架构(联合嵌入预测架构)——不是只从文本学习,而是从视频和空间数据中学习物理世界如何运作 。

实际应用场景可能包括:

- 机器人(需要理解物理世界才能抓取、移动物体)

- 自动驾驶(需要预测其他车辆和行人的行为)

- 医疗(需要理解人体生理过程,而不是瞎猜诊断)

杨立昆说:"也许我们还没看到的障碍,但至少有希望。"早期的"婴儿"版本预计在一年内准备好,完整规模的系统要再过几年。

说明: 大语言模型 vs 世界模型对比

六、这对普通人意味着什么?

你可能会想:"我又不是AI科学家,杨立昆的创业跟我有什么关系?"

关系大了。

1. 别完全相信AI说的话

2025年的研究显示,LLM幻觉问题不是暂时的bug,而是系统性的设计缺陷。

实用建议:

- 任何AI给出的重要信息,都要自己验证

- 特别是涉及健康、法律、财务的建议,千万不能盲信

- 把AI当成"初稿生成器"而不是"终极答案"

2. 关注"世界模型"的发展

在未来几年,你可能会看到两种AI产品:

- 基于LLM的:擅长聊天、写作、翻译,但可能会瞎编

- 基于世界模型的:能真正理解物理世界,适合机器人、自动驾驶等需要可靠性的场景

当你选择AI工具时,要根据用途选对类型。

3. 中国AI的崛起值得关注

杨立昆的警告提醒我们:AI竞赛不是硅谷的独角戏。

如果你在科技行业工作,或者投资科技公司,要关注:

- 中国AI公司的开源项目

- 欧洲在AI监管和研究上的动向

- 全球AI人才的流动趋势

八、最后的思考:当教父说"皇帝没穿衣服"

杨立昆的故事让我想起了安徒生童话《皇帝的新装》。

当所有人都在夸奖ChatGPT、Claude、Gemini有多厉害时,这位亲手奠定了它们技术基础的科学家站出来说:"它们很有用,但走不到终点。"

他明知Meta的很多人,包括新任首席AI官,不希望他说"LLM是死胡同",但他还是说了:"作为科学家的诚信不允许我不说。"

基于杨立昆公开强调的内容,最可能的早期产出是:核心世界模型研究、规划工具链,以及在受限领域(如医疗)与LLM结合的试点项目。

换句话说:这是一个长期赌注,不是快速致富计划。

但至少,他在做别人不敢做的事情——挑战主流,探索新路。

扎克伯格也投资了数十亿美元建立新研究实验室,致力于研究"超级智能" Business of Apps。硅谷也开始意识到,也许杨立昆说的有道理。

对我们普通人来说,最大的启示是:

不要被AI的"魔法"表演迷惑。它很强大,但也有根本性的局限。

当AI告诉你一个答案时,问问自己:"它是真的懂,还是只是在猜?"

当一个技术被所有人追捧时,想想:"是不是有人在走另一条更难但更正确的路?"

科技进步从来不是直线前进的。有时候,最大的突破来自那些敢于说"大家都错了"的人。

40年前,杨立昆坚持研究当时被嘲笑的神经网络,最终改变了世界。

现在,他又在挑战自己帮助创造的技术。

也许再过10年,我们会感谢他今天的"固执"。