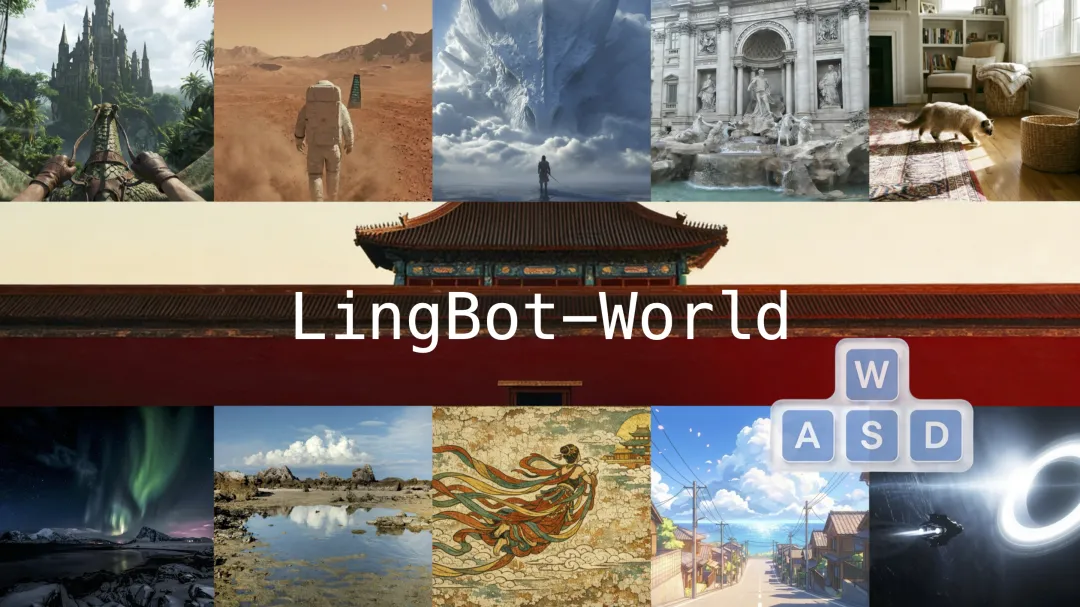

10 分钟 AI 长视频!蚂蚁开源世界模型,直接对标谷歌 Genie3

昨天,AI 圈又炸了一个大新闻。蚂蚁集团旗下的灵波科技放出了一个开源项目,名字叫 LingBot-World。这东西是干嘛的?简单说,就是能让 AI 生成超长视频,而且画面不会像其他模型那样越跑越歪。最夸张的是,它能稳定输出接近 10 分钟的连续视频内容,质量还能对标谷歌那个还没公开的 Genie3。关键是,这玩意儿完全开源,任何人都能免费用。

对于搞机器人、做游戏开发、或者研究 AI 的朋友来说,这绝对是个重磅消息。因为它不只是个视频生成工具,更像是一个可以让 AI 自由探索的虚拟训练场。

一、10 分钟连续生成,画质稳定不崩

它跟普通的视频生成模型完全不是一回事。

核心价值在于:还原真实的物理规律,支持实时互动。你可以把它想象成一个迷你数字宇宙,AI 或者人类都能在里面感知环境、做出动作,然后得到真实的反馈。这也是连接 AI 生成技术和机器人智能的核心桥梁。

它的核心组件叫 LingBot-World-Base,就是奔着这个目标去的:提供高清、可控、逻辑连贯的模拟环境。背后有个可扩展的数据引擎撑腰,从海量游戏环境中学习物理规律和因果关系,所以能跟生成的虚拟世界无缝实时互动。在视频质量、动态效果、长时间一致性、交互能力这四个核心指标上,都能看齐谷歌 Genie3 这个行业标杆。

长视频生成有个行业老大难问题:长时漂移。说白了就是视频生成久了,画面里的东西会变形、细节会糊掉,甚至主体消失、场景乱套。就像玩传话游戏,信息传得越久越走样,小误差越积越大。

但 LingBot-World 搞定了这个难题。通过多阶段训练和并行加速技术,它能连续生成将近 10 分钟、画质完全不打折的视频。而且还通过了一个严苛的一致性测试:就算镜头离开目标物体 60 秒,再切回来看,不管是车、房子还是小物件,样子和结构都能保持一致,不会记混。

交互流不流畅,更能看出它的真实水平。这个模型能做到每秒生成 16 帧画面,端到端交互延迟不到 1 秒,完全达到实时可玩的级别。你既可以用键盘、鼠标,像玩 3A 大作一样实时控制角色移动、调整摄像机视角,画面会跟着你的操作立刻做出反应。也可以用文字指令下命令,比如切换天气、改变画面风格、生成烟花特效都没问题。而且这些变化都能保持场景的几何关系不乱,不会出现逻辑断层或者画面违和的情况。

镜头长时间移开后返回,房屋仍存在且结构一致

这么强的能力,离不开它独特的混合数据采集策略和三阶段训练体系。世界模型训练最缺的就是高质量交互数据,这是个大难题。LingBot-World 采用了双管齐下的办法:一边清洗海量网络视频,覆盖各种真实场景;一边通过游戏采集和虚幻引擎(UE)合成,从渲染层提取没有 UI 干扰的干净画面,同时记录操作指令和相机位置。这样就能给模型提供精准的训练信号,帮它搞懂动作如何改变环境。

另外,团队还做了分层标注,把视频描述拆成叙事、静态场景、密集时序三个层次,帮模型分清背景和运动,学习效率更高更准确。

三阶段训练,一步步解锁核心能力。第一阶段预训练,打好通用视频生成的基础,实现高清纹理和逼真光影。第二阶段中期训练,引入混合专家模型架构,让模型深度理解物理规律、记住空间信息,解决长视频生成记不住的问题。第三阶段后期训练,通过因果注意力机制和少步蒸馏技术,把推理改成自回归生成,既保持画质,又把交互延迟压到 1 秒内,实现真正的实时响应。

也正因如此,它的零样本泛化能力特别强。只要输入一张城市街景或者游戏截图,不用额外训练,就能生成对应的可交互视频流,大大降低了在不同场景部署和使用的成本。

二、机器人智能基础设施的关键拼图

这款开源模型,正好戳中了机器人智能规模化落地的痛点。现在,复杂长任务的真机训练,要么缺数据,要么成本高得吓人,还存在安全风险。而 LingBot-World 凭借长时间一致性、实时交互能力,以及对动作与环境变化因果关系的深度理解,能在数字世界里精准模拟物理世界。

这就给智能体提供了一个低成本、高逼真的试错空间,智能体可以在里面反复练习长任务、积累经验。同时,它还能生成各种不同场景,调整光照、物体摆放都可以,能帮机器人算法更好地适应真实环境。

从行业布局来看,LingBot-World 的开源不是孤立的一步,而是蚂蚁灵波完善机器人智能基础设施的关键操作。之前,蚂蚁已经开源了机器人的眼睛——LingBot-Depth(感知层面,补全深度图、精准识别环境)和机器人的大脑——LingBot-VLA(决策层面,提高任务成功率和适配能力)。

而 LingBot-World 就是机器人的训练场,三者组合在一起形成闭环:VLA 可以在虚拟环境里反复推演,Depth 可以利用它生成的连贯视频优化训练,真实世界的反馈又能帮助它提升模拟精度,实现 1+1+1>3 的效果。蚂蚁从基础模型到通用应用再到实体交互的全栈 AGI 技术路线,也越来越清晰了。

结语

AI 视频生成技术发展到现在,已经不只是让机器画画那么简单了。LingBot-World 代表的方向,是让 AI 真正理解物理世界的运作规律,并在虚拟环境中模拟它、掌握它。

这才是通向通用 AI 的关键一步。当 AI 能在虚拟世界里自由探索、学习、进化,然后把这些能力迁移到真实世界,那时候我们才算真正接近了科幻电影里的那个未来。

而蚂蚁选择把这项技术开源,让全世界的开发者都能参与进来,这本身就值得点赞。技术的进步从来不是一家公司的独角戏,开放和共享才能走得更远。

主页:

https://technology.robbyant.com/lingbot-worldModel

开源地址:

Hugging Face:

https://huggingface.co/collections/robbyant/lingbot-world

魔搭社区:

https://www.modelscope.cn/collections/Robbyant/LingBot-world

Github:

https://github.com/Robbyant/lingbot-worldTech

技术报告:

https://github.com/robbyant/lingbot-world/blob/main/LingBot_World_paper.pdf