现实世界正被蚂蚁收归:灵波开源的野心,是把整个地球装进私有操作系统

AI不再做梦,而是开始理解现实了。

如果你置身于AI投资人的私人酒会,或者是硅谷、北京中关村的创业咖啡馆,你会发现这三年的年度词汇像走马灯一样更迭:2023年是大模型(LLM)的狂欢,人们惊叹于文字的对话能力;2024年是具身智能(Embodied AI)的元年,机器人开始试图走出实验室;2025年,Agent(智能体)成为了几乎所有软件服务的标配。那么,2026年的关键词是什么?

答案正在变得具象且清晰:世界模型。2025年1月29日,蚂蚁集团旗下的具身智能公司——灵波科技(RobbyAnt),正式发布了世界模型 LingBot-World,并宣布全面开源。这不仅仅是一行代码或一个参数包的释放,它更像是在AI进化史的关键节点上,为机器安装了一个可以长期运转、能被人实时操控、且具备物理直觉的数字宇宙引擎。

当大多数人还在纠结视频生成的画面是否华丽时,灵波已经开始思考,AI如何在一个持续存在、符合因果逻辑的世界里长期演化,标志着AI从“生成内容”向“模拟现实”的范式转移。

LingBot-World生成效果

为什么华丽的Sora无法支撑AI的未来?

如果你问一个AI投资人,过去两年最让他抓狂的是什么?答案大概率是:AI那令人崩溃的“物理常识”。

看着Sora生成的视频,虽然画面唯美,但下一秒猫可能会穿过玻璃,或者吃掉的汉堡转瞬间完好如初。这种“抽卡式”的视觉拼接,让AI在面对机器人、自动驾驶等需要严密逻辑的产业时,始终像个活在梦里的艺术家。

在技术圈,大家曾调侃Sora让“物理学不存在了”。大家都在问:AI什么时候才能真正走进物理世界?但这句玩笑背后隐藏着AI商业化的巨大痛点:AI不懂因果关系。

AI第一个痛点是健忘。 过去大模型生成的视频只要超过10秒,场景就会逐渐崩塌。镜头移走再回来,刚才的房子可能变成了树,或者门的位置变了。这种“健忘症”让AI无法执行任何复杂的工业任务。如果你想训练一个机器人在家里打扫卫生,它必须记得扫帚刚才放在哪,而不是转个身扫帚就消失了。

第二个痛点是反应慢。 顶尖的世界模型大多深藏在实验室里,生成一段视频要等很久。对于需要实时反应的机器人或自动驾驶系统来说,这种延迟是致命的。

第三个痛点是数据贵。 互联网上的视频大多是给人类看的,缺乏“动作”与“结果”的对应。AI能画出漂亮的足球场,但它不知道“用力踢球,球会飞向哪”。缺乏这种“动作-反馈”的逻辑,AI就永远无法指挥机器人在现实中干活。

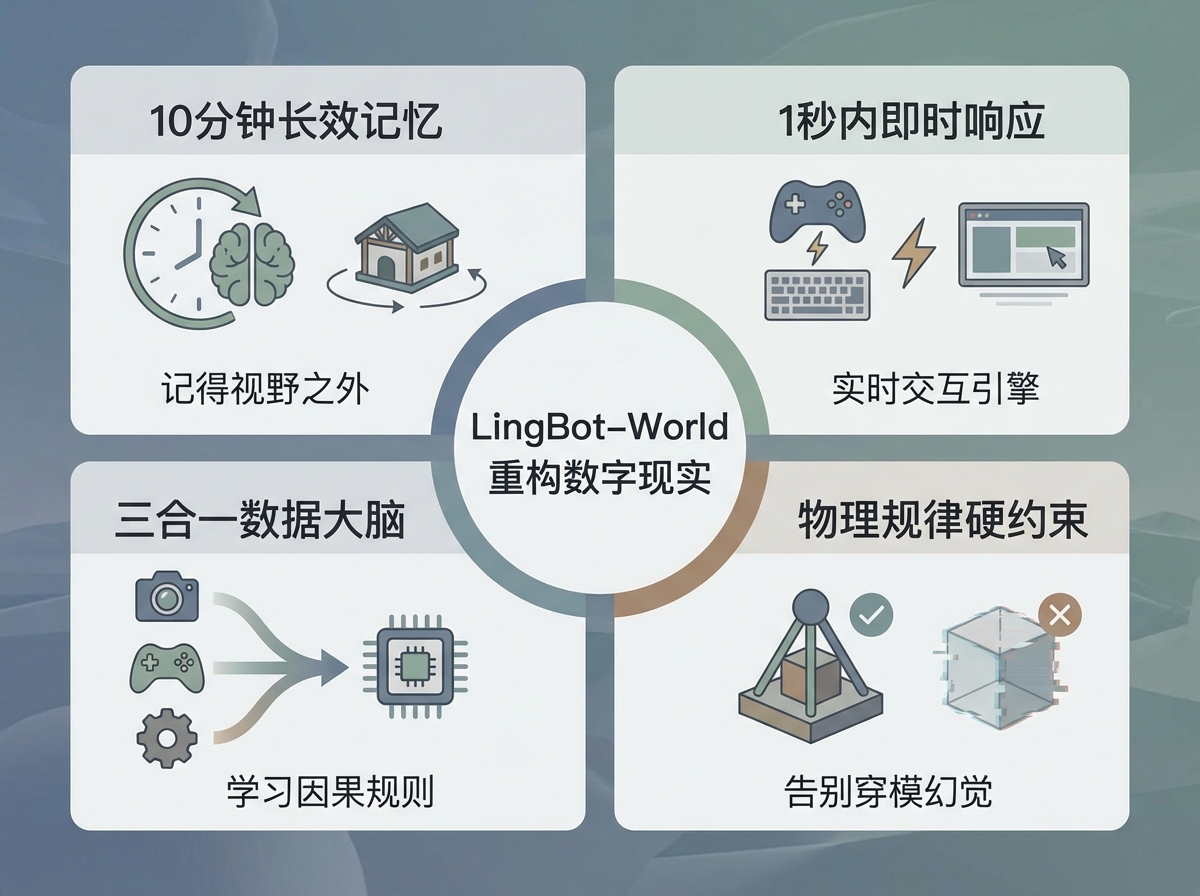

产品拆解:LingBot-World 是如何重构数字现实的?

我们将灵波科技的这款产品拆解为四个核心技术维度。

• 10分钟的长效记忆:它记得视野之外的世界

长视频的稳定性是世界模型的生死线。LingBot-World 通过多阶段训练和并行化推理,将连续稳定生成的时间推进到了接近 10 分钟这一量级。其最震撼的能力在于,当镜头移开某个物体(例如故宫的一角)60 秒后再转回来,该物体的结构、位置和光影细节依然保持高度的一致性。

这意味着模型内部已经形成了一种隐式的空间记忆机制,它记得“世界本来的样子”,而不仅仅是当前画面的局部预测。

• 1秒内的即时响应:让AI世界变得“可操控”

灵波团队将端到端的交互延迟压低到了 1 秒以内的响应级别,吞吐量达到约 16 FPS 左右。技术上,他们将双向扩散模型蒸馏为因果自回归结构,这种少步推理让 AI 从一个迟钝的画师变成了灵敏的互动引擎。

用户按下键盘或输入指令,画面几乎立刻做出反馈。这意味着它不再是一个只能看的播放器,而是一个可以实时玩的模拟器。你按下键盘,AI实时计算出物理反馈并画面呈现,这种速度已经达到了可交互的商用门槛。

• 三合一的数据大脑:不仅看视频,更学习规则

世界模型最难的不是结构,而是数据。普通网络视频缺乏动作—环境的对齐。LingBot-World 构建了一套三栖数据引擎:清洗后的真实视频提供多样性;游戏录制提供精确的操作对齐;Unreal Engine(虚幻引擎)合成管线则导出无干扰的纯净画面和相机参数。

这种标注方式本质上是在教 AI 区分“世界状态”和“观察视角”,从而建立起真正的因果感。这种训练方式教给AI的是:世界本身是什么,以及我的每一个动作会改变什么。

• 物理规律的“硬约束”:告别穿模和幻觉

LingBot-World 采用了 MoE(Mixture of Experts)结构,将生成过程拆解。高噪声专家负责世界的整体布局和空间框架,低噪声专家则负责材质和细节的打磨。配合具身物理约束算法,模型能够更好地遵循物理一致性,防止物体穿模或忽略物理屏障。

这让它生成的画面不仅符合视觉美感,也更接近人类对物理世界的直觉认知。

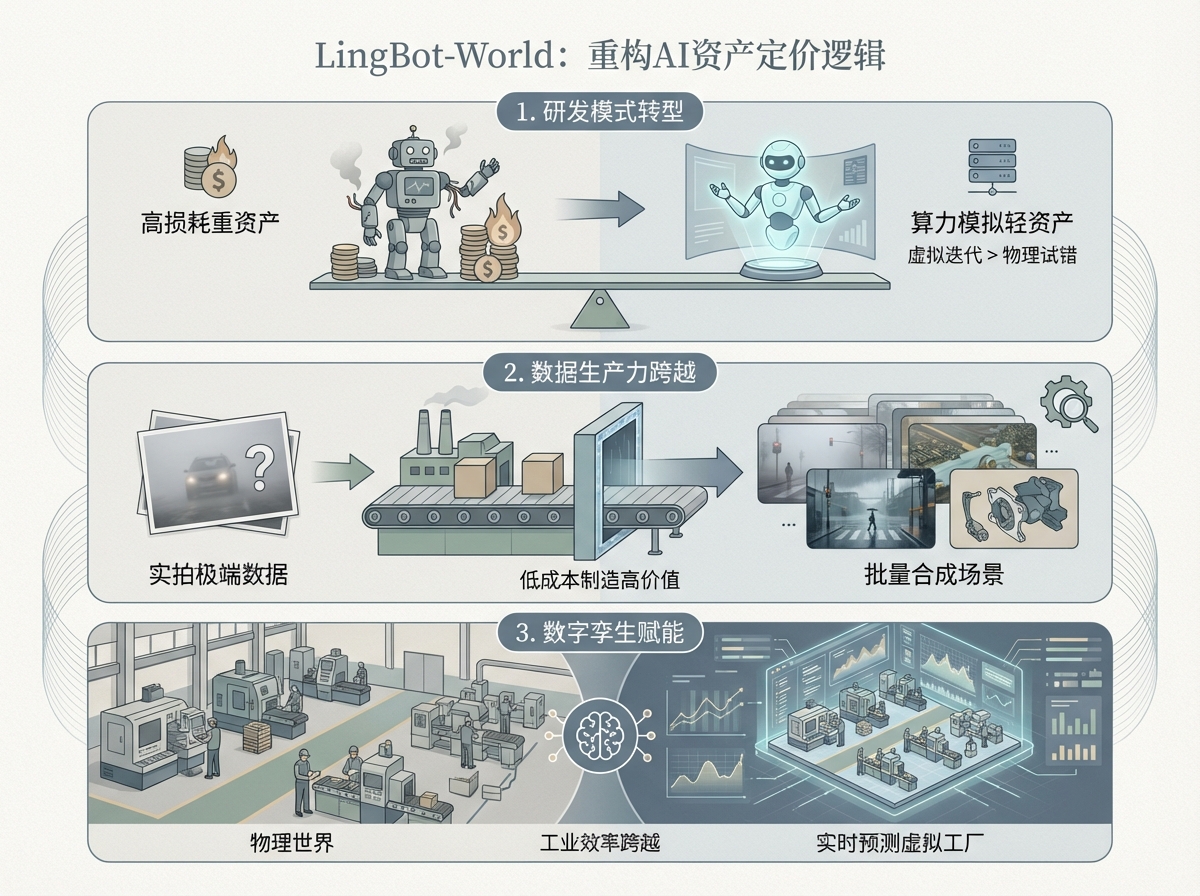

商业实战:如何帮企业省掉天文数字般的成本?

很多人会问:这种模型除了画画好,到底能给企业带来什么实惠?简单来说,它把AI进入物理世界的门槛费和学费直接砍掉了一大截。站在商业视角,LingBot-World 的价值远不止于生成视频,它本质上是在重构 AI 进入物理世界的资产定价逻辑。

1. 研发模式转型:从硬件损耗驱动转向算力模拟迭代

以前训练一个搬运机器人,开发者得买真机器人,租大场地。机器人每做错一个动作,可能就会摔坏昂贵的传感器,甚至撞坏实验室。这种训练方式既慢又贵,每一步都在烧钱。

现在,LingBot-World 提供了一个完美的数字练兵场。你可以让机器人在虚拟世界里练习几百万次抓取、走路。即便摔倒一万次,损耗的也只是一点电费,而不是几万块的硬件。这种从重资产到轻资产的转变,让很多中小创业公司也能玩得起机器人研发了。

2.数据生产力的跨越:低成本制造高价值极端场景

自动驾驶和工业机器人最怕的是“万一”。比如暴雨天突然冲出的行人,或者零件摆放极其刁钻的角度。在现实中,为了采集到这种极端数据,车企可能要让测试车跑几千万公里才能碰到一次。

LingBot-World 是一个场景工厂。你输入文字“大雾天、路口有人冲出”,它就能瞬间生成上千个这种场景供AI学习。你不再需要去大街上碰运气,而是在实验室里批量生产安全经验。这种人工合成数据的成本不到实拍数据的百分之一,却能精准解决AI落地的最后 1% 难题。这种效率提升,就是企业的核心竞争力。

3. 自动化的工厂导游:数字孪生不再是花架子

过去,大型工厂想做一个虚拟管理系统,需要招几百个美工去手动建模。现在,有了世界模型,场景可以由AI实时生成和补全。这意味着,企业可以用极低的成本,拥有一个不仅能看、而且能实时预测生产走势的虚拟工厂。这种对物理世界的数字化还原,将让工业生产的效率迎来一次巨大的跨越。

行业观察:开源的真正重量,是抢占底层操作系统

为什么蚂蚁灵波选择在这个时点全面开源?这不仅是技术自信的表现,更是一次高明的生态策略。在AI领域,最顶尖的世界模型如Google Genie 3长期处于闭源状态,这让全球开发者只能在巨头的阴影下摸索。

蚂蚁灵波这次选择全面开源,其背后的商业野心非常清晰:它要做AI时代的“安卓”。

在商业史上,谁制定了底层的标准,谁就拥有最高的话语权。目前,OpenAI和Google等巨头都在做世界模型,但他们是闭源的。这意味着你想用他们的能力,就得把数据传给他们,还得按次付费。

灵波的开源是在“拆巨头的墙”。它让全球的开发者、车企、机器人公司都能免费用上这套引擎。当大家都习惯了基于灵波的标准去开发软件、训练机器人时,灵波就成为了具身智能领域的底层操作系统。

此外,作为一家金融科技起家的巨头,蚂蚁入局世界模型并非跨界玩票。未来的经济主体将包含大量的服务机器人、无人快递车。掌握了世界模型,就掌握了这些智能体的认知中枢。这实际上是在为未来十年的数字化产业链提前铺路。

结语:当AI开始拥有常识

LingBot-World 给我的震撼,不仅在于它能生成长达10分钟的视频,也不在于它那精美的故宫雪景画面,而在于它让AI第一次展现出了常识。当镜头离开后再转回来,那栋房子还在原地,那种长久的一致性,是机器理解现实的开始。

我们正在进入一个AI构建环境的新时代。在这个时代,AI不再仅仅是帮我们写诗、作画的工具,它正在成为一个可以被持续体验、被人类实时介入、被智能体用来模拟进化的平行宇宙。灵波科技的这一步,让世界模型从冷冰冰的论文概念,变成了工程可复现、产业可落地的现实。

2026年,当第一批真正能在复杂环境中自由行走的具身机器人落地时,我们或许会回想起2025年1月的这个冬日。那一刻,蚂蚁灵波打响了关键的一枪,让AI正式告别了幻觉,开始认真地审视并理解我们这个真实的物理世界。