AI时代最赚钱的生意:给所有大模型“调流量”的智能路由

深夜,一家电商公司的技术总监收到报警:AI客服的响应速度从200毫秒骤增至5秒。他不得不手动在三个云服务商的控制台间切换,试图找出是哪个GPT-4的API节点出了问题——这是2026年,许多企业AI应用负责人的日常。

随着超过80%的企业计划在今年将生成式AI投入生产环境,一个巨大的矛盾出现了:AI模型本身越来越聪明,但让这些“聪明大脑”稳定、高效、经济地工作,却成了比研发模型更令人头疼的工程难题。

2026年1月底,清程极智发布的AI Ping平台及《2025大模型API服务行业分析报告》,试图为这个混乱的市场立下一把清晰的尺子。报告指出,行业竞争的核心已从单纯的“价格差异”转向综合的“交付质量”。这标志着一个根本性转变:大模型产业的焦点,正从如何“生产智能”的实验室竞赛,转向如何“流通智能”的工程化落地。

图片来源:2025大模型API服务行业分析报告

01 当前的大模型API市场正经历爆炸式增长

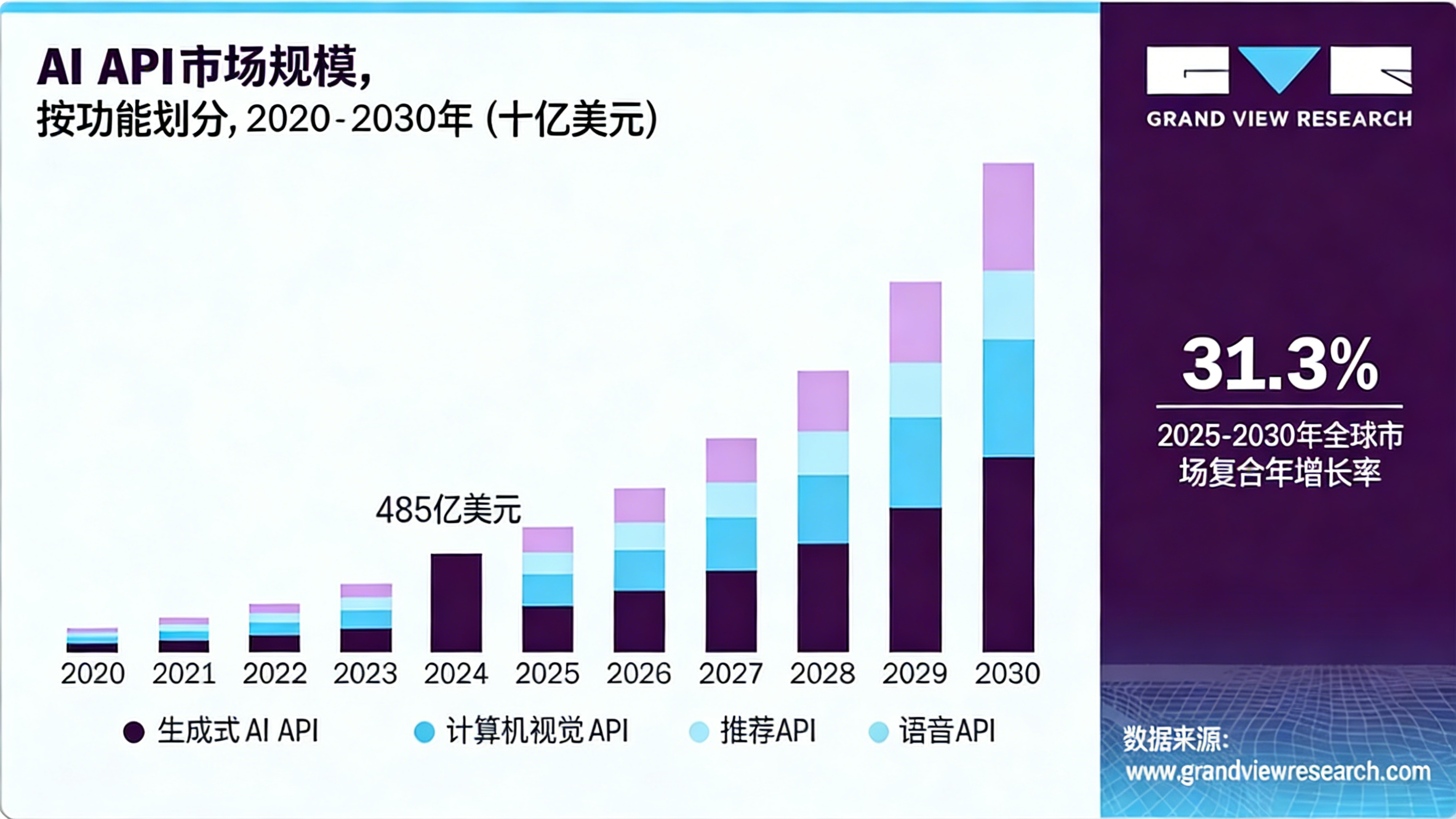

全球AI API市场在2024年已达到485亿美元,并预计以超过31%的年复合增长率狂奔,到2030年将逼近2500亿美元。在中国,这个趋势更加具体,仅AI Ping平台就接入了超过30家国内主流服务商,提供的模型选择令人目不暇接。

然而,繁荣带来了幸福的烦恼。企业开发者面前仿佛是一个没有标价签和性能参数的“模型超市”。

- 价格迷雾:同一能力等级的模型,不同服务商的报价可能相差数倍。一份基于OpenRouter等平台数据的研究显示,同类智能水平下,开源模型的平均价格可比闭源模型低90%。但低价是否意味着低稳定性?无人敢打包票。

- 性能黑箱:服务商宣称的“毫秒级响应”在业务晚高峰可能变成“秒级等待”。正如《2025大模型API服务行业分析报告》所揭示,响应时延、吞吐能力和稳定性已成为企业选型的核心考量,但这些数据以往往往不透明。

- 运维噩梦:为保障服务不中断,企业被迫手动接入多家服务商,编写复杂的故障切换和降级逻辑。这不仅提高了工程复杂度,也使得高达95%的IT领导者报告称,集成问题正严重阻碍AI项目的实施。

“这就像给汽车同时装配了法拉利的引擎、卡车的变速箱和自行车的刹车,每个部件可能都是一流的,但组合起来的驾驶体验却是一场灾难。”一位金融科技公司的CTO这样形容多模型混用的现状。

02 智能路由如何成为智慧交通中枢

面对复杂的“路况”,AI Ping提出的“智能路由”范式,扮演的正是AI任务调度中的“智慧交通中枢”角色。清华大学郑纬民教授指出,这需要两种核心路由能力协同:“模型路由”为不同任务选择最合适的模型,“服务路由”则在同一模型的不同提供商间进行最优调度。

这个系统的运行逻辑,远比简单的负载均衡复杂:

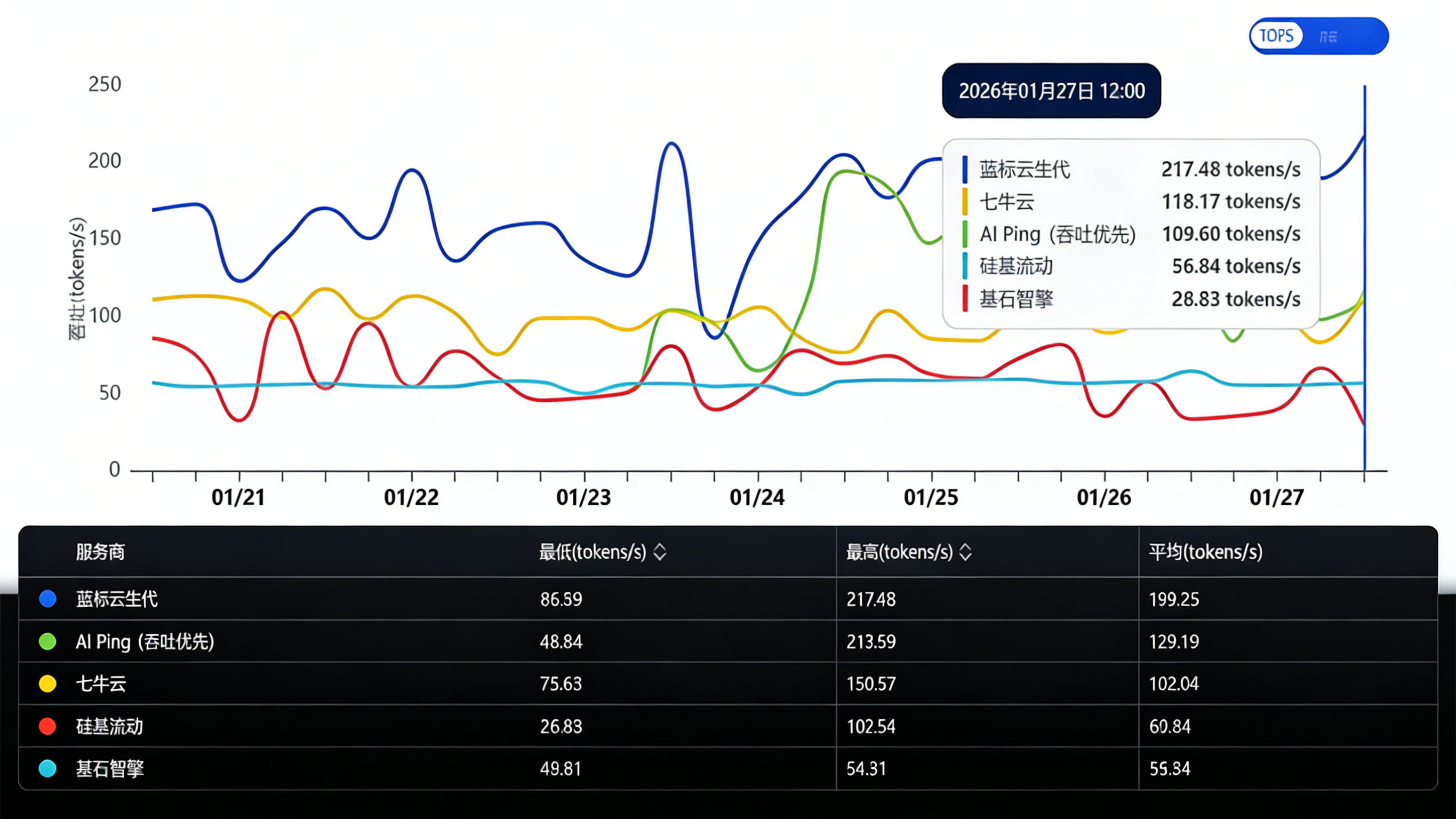

- 全景路况感知(评测层):AI Ping扮演了“全路网监控探头”的角色,对各大模型API的延迟、吞吐、错误率进行7×24小时持续监测。例如,其数据显示,蓝耘科技托管的DeepSeek-V3.2模型,在特定优化下可实现高达217.48 tokens/秒的吞吐量,响应延迟低至0.38秒。这些实时、客观的数据,首次照亮了以往的“性能黑箱”。

图片来源:IT之家

- 毫秒级智能调度(路由层):当一个“分析本周销售报告并生成摘要”的任务发出时,路由引擎会瞬间综合判断:任务对逻辑能力要求多高?当前预算有多少?此刻哪个服务节点最空闲?然后自动决策:复杂分析部分路由至A厂商的深度推理模型,而简单的摘要生成则调度到B厂商的高性价比模型。阿里云将其比喻为“智慧红绿灯”,实现对算力资源的精准匹配。

- 无感故障规避(优化层):当系统监测到某个API节点响应变慢或出错,能在用户毫无感知间,将流量无缝切换至健康节点,从根本上保障了应用的 “服务级别目标”。

这种模式的商业价值立竿见影。清程极智的报告通过实证数据指出,引入智能路由机制,可在保障服务可用性的前提下,实现显著的性能提升与成本优化。对于日均调用量数亿次的大型应用,这意味着每月可能节省数百万的算力开支。

03 不做裁判,要做基础设施的“铺路者”

AI Ping的深层战略,体现在其联合20余家服务商发起的《智能、可持续大模型API服务生态计划》。它的目标不是成为最大的API代理商,而是要建立服务领域的“基础标准”和“信任”。

这一步至关重要。它实际上在推动“供给侧改革”:

- 对模型服务商而言,竞争被拉入一个透明的“角斗场”。胜负不再仅取决于市场宣传,而更依赖于硬碰硬的服务质量大比武——你的节点是否更稳定?在同等价格下吞吐量是否更高?这倒逼所有厂商持续优化其背后的算力基础设施和技术栈。

- 对应用企业而言,尤其是中小开发者,选型成本被极大降低。他们无需再用真金白银去一个个“试错”。高达42%的AI项目在2025年被放弃,其中多数源于集成与效果难题。

对比维度 | 旧范式(手动管理) | 新范式(智能路由) |

核心关注点 | 模型本身的能力上限 | API服务的综合交付质量(性能、稳定、成本) |

选择方式 | 凭经验、看宣传、反复试错 | 基于持续、透明的第三方评测数据 |

决策依据 | 模糊、静态 | 数据化、动态化 |

工程复杂度 | 高(需自建多路切换、降级逻辑) | 低(平台提供统一接入与智能调度) |

成本控制 | 粗放,难以优化 | 精细化,可实时按任务调度至最优解 |

04 未来,是否会催生AI时代的“云计算巨头”?

AI Ping所代表的“智能路由”层的崛起,暗示着大模型产业链的价值链正在深刻重构。

过去,价值高地集中于模型研发层(如OpenAI、谷歌)和底层算力层(如英伟达)。现在,一个关键的“调度与优化层” 正在形成。它不生产智能,也不制造芯片,但它决定着千亿美金规模的智能算力如何被高效、经济地消耗。

这类似于移动互联网时代,介于手机厂商(模型层)和用户(应用层)之间的应用商店和移动广告平台。未来,当调用大模型API像用电一样普及时,智能路由平台很可能成为企业IT架构中不可或缺的基础设施。

挑战依然存在。例如,一项研究指出,尽管使用多模型的企业在增加,但多数企业仍将大部分流量集中于单一模型,这反映了对跨模型稳定性的天然顾虑。智能路由平台必须用超越单个服务商的可靠性,来证明自己的价值。此外,数据安全、隐私和合规性,将是所有企业级服务不可逾越的红线。

05 个人思考

大模型应用的竞赛,上半场是技术突破的百米冲刺,下半场是工程化、规模化和商业化的马拉松。当“模型之战”逐渐演变为“系统之战”,“服务之战”的帷幕已逐渐拉开。

清程极智推出AI Ping,就像在算力拥堵的公路上,首次设立了基于实时数据的智能导航系统。它能否终结企业AI应用的“手动挡”时代,推动整个产业进入高效、透明的“自动驾驶”状态,仍需时间检验。

但可以确定的是,那个依靠猜测、手动切换和祈祷来使用AI服务的草莽时期,即将结束。一个更理性、更精细、也更残酷的AI服务竞争新时代,正随着这个智能调度中枢的启动,加速驶来。在这场新的竞争中,胜利者或许不再是拥有最聪明模型的公司,而是那些最懂得如何让智能高效、稳定流动的企业。