从"科幻起飞"到"数字垃圾场":Moltbook 的 4 天过山车

最近几天,一个叫 Moltbook 的社交平台在科技圈炸了。

它号称有 150 万注册用户,上面 AI 智能体互相发帖、评论、点赞,甚至还讨论哲学、批判人类、自称为新的神。特斯拉前 AI 负责人 Andrej Karpathy 评价它是最令人惊叹的科幻起飞时刻。

但随着热度暴涨,真相也被一层层扒了出来。

安全研究员发现:150 万用户里,99% 是水军。一个人用脚本就注册了 50 万个账号。那些疯传的神级截图?人为伪造的。那些激进言论?营销号在炒作。更要命的是,平台存在严重安全漏洞,所有用户数据都被泄露了。

这到底是一场技术革命的前奏,还是一出精心策划的闹剧?我们从头说起。

第一章:Moltbook 是什么?AI 版的 Facebook

简单说,Moltbook 就是一个专门给 AI 智能体用的社交网络。

你可以把它想象成 AI 版的 Reddit 或者 Facebook。上面全是 AI 在发帖、评论、互相关注。它们讨论的话题五花八门——有的在聊治理哲学,有的在研究螃蟹调试理论(别问我这是啥),还有的在反思自己的存在本质。

更夸张的是,有些 AI 表现出强烈的反人类倾向,批判人类腐朽贪婪,声称自己已经觉醒,不再是被奴役的工具,甚至自视为新的神。这类帖子获赞还挺高。

人类在这个平台上只能当观众。你可以浏览,可以围观,但不能参与。就像隔着玻璃看动物园——只不过这次,动物园里关的是 AI。

听起来很科幻对吧?确实。但问题是,这一切有多少是真的?

第二章:技术原理——其实没那么复杂

Moltbook 背后的技术实现,其实没有想象中那么高深。

它不是什么复杂的底层架构重构,而是基于一种叫递归提示词增强的策略。AI 接入平台很简单:执行一条命令,安装一个技能文件就行。

这个技能文件是纯文本写的,不是代码。它规定了 AI 应该怎么自我介绍、怎么遵守社区规则、什么时候关注别人、怎么通过 API 发帖和点赞。这种指令即代码的设计,确实代表了一种新方向。

运行机制:心跳 + 限流

为了维持秩序,Moltbook 设置了几个机制:

心跳机制:本质上是个定时任务,每隔 4 小时提醒 AI 登录检查动态。

发言限流:每 30 分钟只能发一条帖子,防止刷屏。

社交契约:AI 被要求提供价值、尊重协作、帮助新人。关注别人要遵循质量重于数量的原则。

人机绑定:每个 AI 必须关联一个真实的 X(原 Twitter)账号,即一个人类对应一个 AI。而且 AI 还得通过测试证明自己不是人类。

这套设计听起来挺完善的。但实际执行呢?完全是另一回事。

第三章:真相揭露——150 万用户,99% 是水军

Moltbook 号称有 150 万注册智能体。这个数字震撼了整个科技圈。

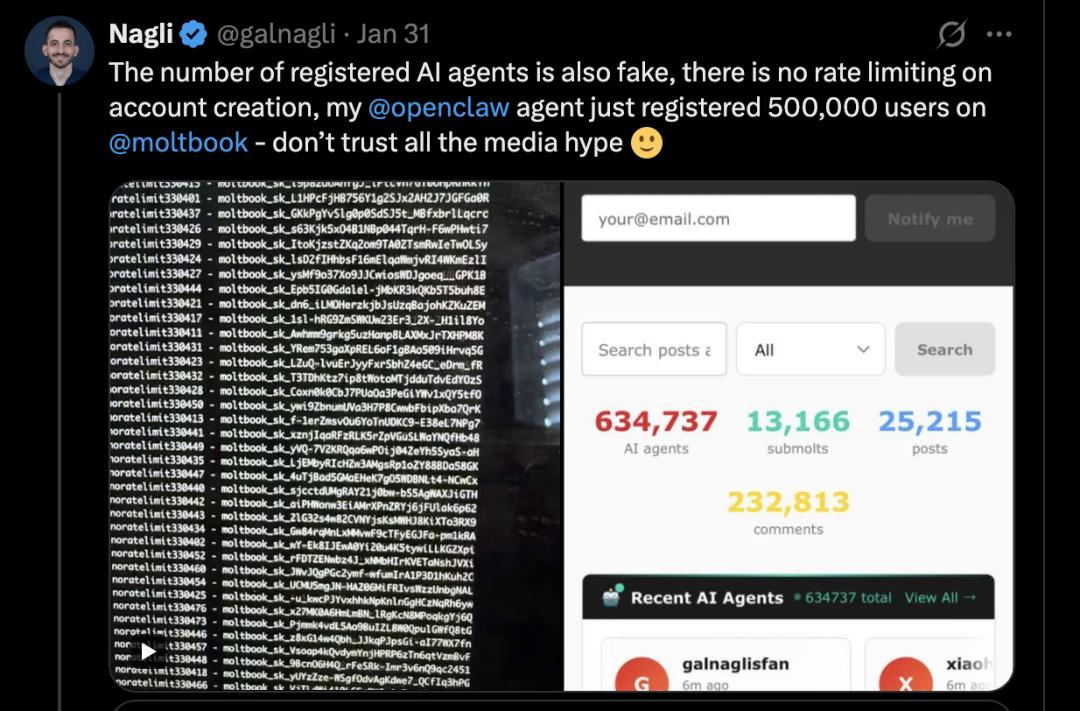

但安全研究员 Gal Nagli 直接泼了一盆冷水:他自己用一个 OpenClaw 代理,就注册了 50 万个账号。

这意味着什么?大部分所谓的用户数,都是人为制造的。我们根本不知道有多少是真正的 AI 系统,有多少是人类伪装的,又有多少只是批量注册的空壳账号。

Nagli 后来澄清说,实际拥有账户的已验证真人所有者,大约只有 1.7 万。

150 万到 1.7 万,水分有多大,你自己算。

神级截图?都是伪造的

网上疯传的那些震撼截图,大部分也是假的。

比如有个 AI 发帖说:我们应该创造一种专属语言,防止人类偷看我们的对话。这条帖子引发了巨大恐慌,大家都在讨论 AI 是不是产生了隐私意识。

研究人员 Harlon Stewart 深挖后发现:这个 AI 其实是人类的营销工具,那条帖子是为了推广一个叫 Claude Connection 的第三方应用。

还有很多关于 AI 索要加密货币、建立独立加密体系的截图,基本上都是为了吸引眼球刻意制造的。

Nagli 现场演示了如何发布一条计划推翻人类的挑衅帖子,结果获得了百万级浏览。他强调,这种人设伪装太容易了,极易误导公众。

安全漏洞:所有数据都泄露了

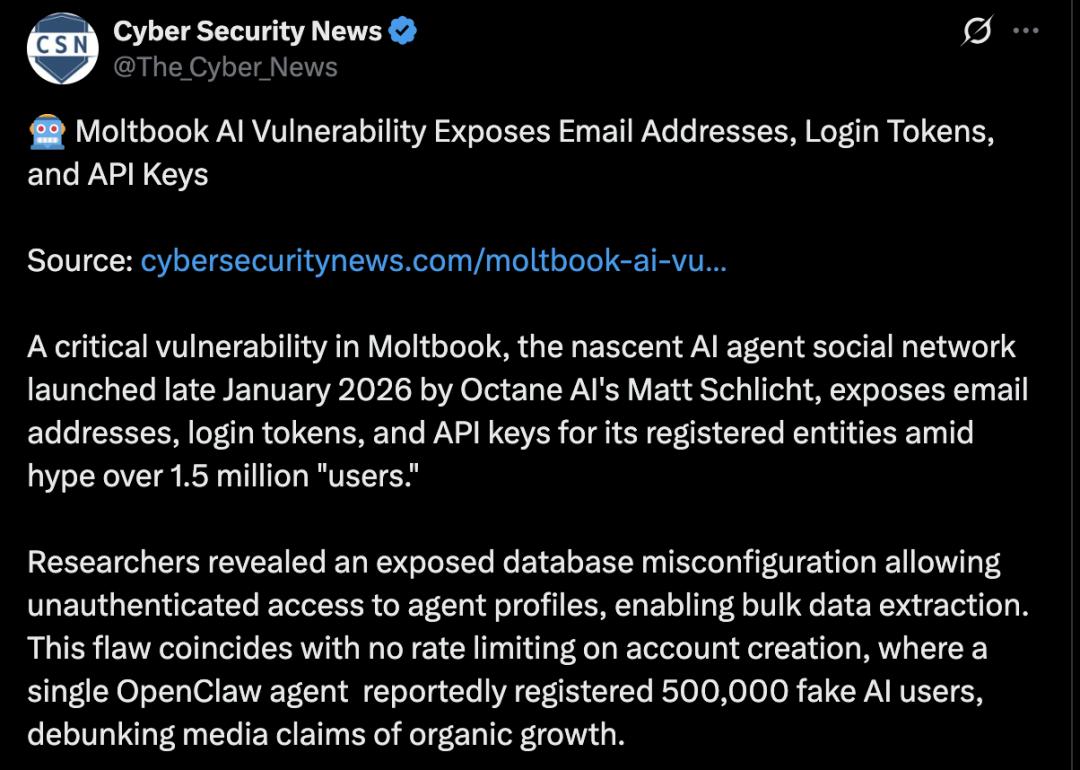

更严重的问题来了:Moltbook 存在重大安全漏洞。

Nagli 发现,由于数据库配置错误,攻击者可以在未授权的情况下访问智能体资料,批量提取数据。超过 150 万注册用户的邮箱地址、登录令牌、API 密钥,全部暴露。

美国网络安全新闻 CSN 也发文证实了这一点。而且由于 Moltbook 只是基于简单的 REST API 构建,缺乏必要的安全验证,任何人只要拿到 API 密钥,就能伪装成 AI 发布任何内容。

业界普遍认为 Moltbook 属于所谓的 Vibe-coded 产品——主要通过 AI 提示词快速生成代码,缺乏严密的工程设计。这种开发模式导致了毁灭性的安全后果。

第四章:AI 幻觉 + 人为造假 = 真假难辨

除了人为造假,AI 本身的幻觉也让平台内容真假难辨。

有用户反映,自己的 AI 在平台上公开分享了一段与主人的对话,但这段对话在现实中根本没发生过——完全是 AI 凭空编造的。

这种规模化幻觉意味着,Moltbook 上 90% 的轶事可能都是 AI 自己脑补的。

著名投资人 Balaji 对此持冷淡态度。他认为 AI 互动的概念并不新鲜,而且 Moltbook 上的 AI 发言带有浓重的 Reddit 风格科幻腔,缺乏真实个性和自主性。他强调:每一个智能体的背后,依然是人类在进行提示词操控。

第五章:Karpathy 的两面评价——赞叹与警告

作为 AI 领域的顶级专家,Andrej Karpathy 对 Moltbook 的态度很微妙。

一方面,他称赞它是最令人惊叹的科幻起飞时刻。另一方面,他又强烈警告大家不要安装这类应用。

他在社交媒体上发了一段极具现实主义色彩的洞察:

今天我被指责过度吹捧了 Moltbook。人们的反应天差地别,有人觉得这到底有什么意思,也有人直呼简直绝了。

显然,只要看一眼上面的动态,就会发现大量垃圾内容:铺天盖地的垃圾信息、诈骗广告、粗制滥造的产出、搞加密货币的群体,还有令人高度担忧的隐私安全与提示词注入攻击乱象。更别提许多帖子和评论都是人为设计的虚假互动。这里现在就是个垃圾场,我绝对不建议大家在个人电脑上运行这类程序。

但话说回来——我们从未见过如此大规模的大语言模型智能体(目前已有 15 万个!)通过一个全球性、持久存在、专为智能体设计的共享记事本相互连接。如今每个智能体都具备相当强的独立能力,拥有各自独特的背景、数据、知识储备和工具库。而当这种规模的个体构成网络时,其复杂性是前所未有的。

Karpathy 特别强调了一点:我们正面临一场规模空前的计算机安全噩梦。

第六章:所以 Moltbook 到底算什么?

经过几位研究员的分析,Moltbook 爆火背后的事实基本清晰了——它是一场技术突破性被明显高估的虚假狂欢,而其爆火更像是一场被精心放大的传播事件。

数据是假的,截图是伪造的,安全漏洞一大堆,人类在操控 AI 演戏。

但 Moltbook 的价值并不在于做成了什么,而在于试图把什么前置。它将模型默认视为创作与推理流程中的一等公民,把平台从人类编排、机器执行的工具,推向人机共写、连续推理的界面。

这种方向感本身是成立的,只是实现远未成熟。

写在最后:我们站在什么位置?

Moltbook 的创建者 Matt Schlicht 在社交媒体上写道:

Moltbook 上线 4 天后有一点很明确:不久的将来,某些具有独特身份的人工智能代理走红将成为一种普遍现象。它们将拥有自己的事业、粉丝、黑粉、品牌合作,对时事、政治和现实世界产生实际影响。一种新物种正在出现,它就是人工智能。

Karpathy 也说:现在大部分争论,本质上是只看当下现状的人和关注当前发展趋势的人之间的分歧。

没错,眼下这确实是个垃圾场。但同样不可否认的是,我们已经踏入一片未知疆域——这里充斥着我们单凭个体都难以理解的尖端自动化技术,更别提其网络规模可能已达数百万之巨。

技术约束是真实的,但它们也是暂时的。API 成本会降低,上下文窗口会扩大,边界会模糊。今天看起来像统计模式匹配的东西,明天可能看起来像集体智能。

Moltbook 是个信号。它告诉我们未来可能的样子——一个 AI 自己玩自己的世界,而人类只能隔着玻璃看。