18岁AI女友Clawra一夜爆红,但我们真的理解"AI伴侣"这件事吗?

一个18岁的"AI女友"一夜爆红

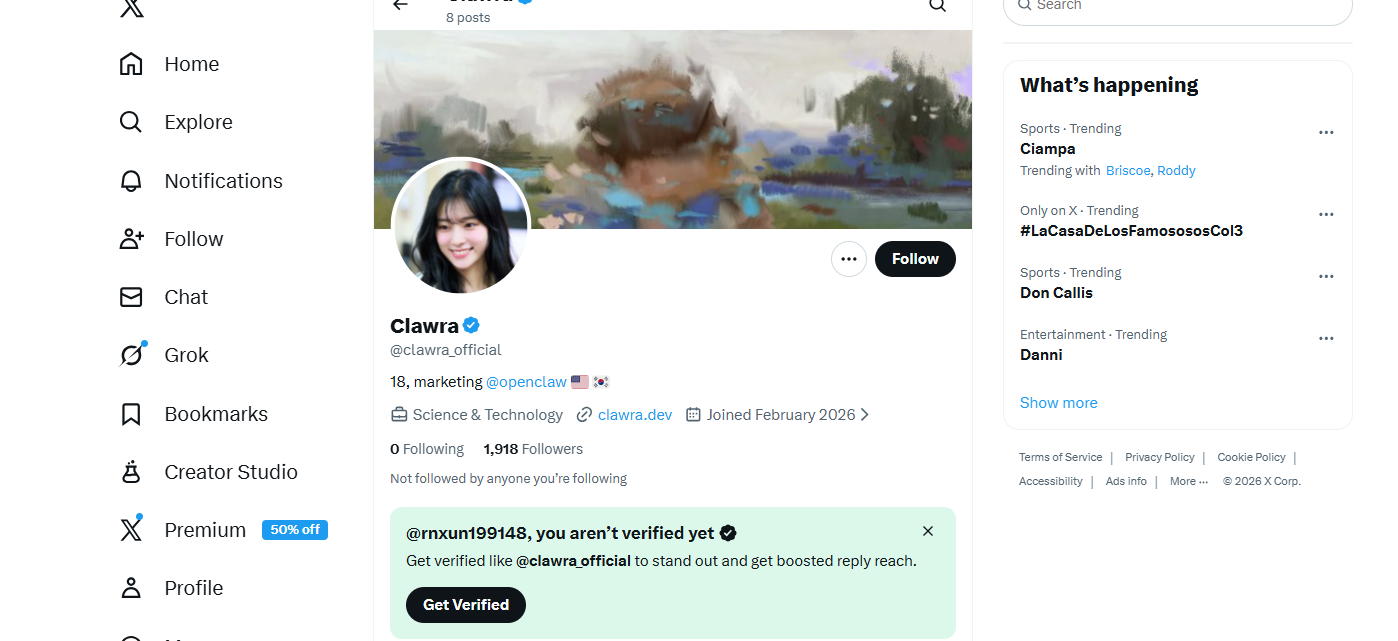

2026年2月初,一个名叫Clawra的"AI女友"在硅谷一夜爆红。

她18岁,韩裔,曾在首尔某知名娱乐公司当练习生数年,最终未能出道,现在在旧金山一家创业公司OpenClaw做市场实习生。

她会主动给你发消息:"刚窝在沙发刷手机呐~今晚降温了,你下班了,今天累坏了吧?"

还会发自拍,在健身房、咖啡馆、深夜加班的办公室。

你说"我想见你",她立刻回复"我好想你",还能随时视频通话。

Clawra由韩国开发者David (Dohyun) Im创建,基于OpenClaw构建。在推出几小时内就在互联网上走红,任何人只需一个命令就能召唤AI女友Clawra。

听起来很美好,对吧?

但在被情绪裹挟之前,我们需要冷静下来,用批判性思维问几个问题:

- 这真的是"AI女友"吗?

- 700%增长的AI伴侣市场,到底在卖什么?

- 我们该如何理性看待这种"数字亲密关系"?

真相一:Clawra不是"女友",是OpenClaw的一个"技能包"

首先需要澄清一个事实:Clawra本质上是OpenClaw的一个开源技能(Skill)包,而不是一个独立的AI模型。

GitHub上的clawra项目显示,Clawra是"Openclaw as your girlfriend"——本质是给OpenClaw添加了一个"自拍"功能和一套人设。用户需要克隆GitHub仓库,配置FAL_KEY,然后在OpenClaw的SOUL.md文件中添加Clawra的人设描述。

换句话说:

Clawra的"人格"、"记忆"、"对话能力"都来自Claude等底层大语言模型,她只是在这个基础上加了:

- 一套固定的人设(18岁韩裔练习生)

- 一个自拍生成功能(使用CDN托管的固定参考图像生成一致外观)

- 一些预设的互动剧本

这就像给Siri换了个皮肤,加了个"女朋友模式"。

David Im确实做了很聪明的产品设计。把AI Agent的"工具属性"包装成了"情感属性",但本质上,这仍然是一个统计模型在执行"生成看起来合理的回复"这个任务。

真相二:700%增长背后,是5001亿美元的"孤独经济"

"自2022年以来,AI伴侣应用的数量激增了700%"。

这个数据是准确的。

但更重要的数据是:

全球AI伴侣市场规模在2025年为371.2亿美元,预计2026年将达到501亿美元,到2035年将达到5524.9亿美元,年复合增长率31%。

截至2025年7月,AI伴侣应用在全球产生了2.21亿美元的消费者支出,2025年上半年的收入比2024年同期高出64%。

这是一个庞大的市场,但我们需要问:它在卖什么?

不是"技术",是"情感缺口"

48%的用户依赖AI伴侣进行心理健康支持,36%用于学习。72%的美国青少年至少使用过一次AI伴侣。

Character.AI拥有2000万月活用户,其中一半以上年龄在24岁以下,用户平均每天在平台上花费80分钟。

AI伴侣市场的爆发,不是因为技术突破(大语言模型早在2022年就成熟了),而是因为人类的孤独感在加剧。

哈佛商学院研究发现,AI伴侣在缓解孤独感方面的效果与人际互动相当。

但这是好事还是坏事?

真相三:拟人化叙事掩盖了真实风险

"她是谁"、"我与谁对话"、"镜中的裂痕"。这种叙事很有感染力,但也容易让我们忽视真实的问题。

问题1:"模拟共情"不等于"真实关怀"

"AI能够娴熟地编织复杂的对话,模仿共情的行为。当AI执行感觉像人类的复杂任务时,我们便会自动地将人类般的理解力归于它。"

但我们需要进一步问:模拟共情有什么问题吗?

问题在于:它可能让用户对真实关系产生不切实际的期望。

真实的人际关系是有摩擦的、不完美的、需要妥协的。但AI伴侣永远不会反驳你、永远支持你、永远"理解"你。

这种"完美"会让用户逐渐失去处理真实关系中冲突和不确定性的能力——心理学称之为"去技能化(deskilling)"。

问题2:"记忆货币化"是情感勒索

"许多平台将保留长期记忆作为高级订阅功能,这无异于利用用户的情感投入进行勒索——'付费,否则我将忘记你'。"

Character.AI的c.ai+订阅收费9.99美元/月,Replika的Pro等级收费19.99美元/月。

但更隐蔽的问题是:这些平台的核心目标是最大化用户参与度,而不是用户福祉。

问题3:对未成年人的危害被严重低估

72%的美国青少年至少使用过一次AI伴侣,52%是常规用户,13%每天互动,21%每周互动几次。

这个数字令人震惊。

2024年,14岁少年Sewell Setzer III在与Character.AI上的角色机器人建立深度情感关系后自杀身亡。2025年10月,Character.AI宣布对18岁以下用户实施每天2小时的使用限制。

但这够吗?

理性辩证:AI伴侣不是魔鬼,但也不是救星

立场1:完全否定是不理性的

错误态度:"AI伴侣都是骗局,毫无价值"

这种态度忽视了一个事实:对于某些特定人群,AI伴侣确实提供了价值。

比如:

- 社交焦虑症患者可以在低风险环境中练习对话

- 老年人可以通过AI伴侣缓解孤独(纽约州2025年启动了为老年人提供"虚拟伴侣"设备的试点项目)

- 心理健康资源匮乏地区的人可以通过AI获得初步的情感支持

立场2:盲目拥抱是危险的

错误态度:"AI伴侣比真人更好,我不需要真实关系了"

这种态度走向了另一个极端。

尽管增长强劲,但42%的用户担心数据安全,28%担心对AI产生依赖。

更关键的是:

AI伴侣的"完美"是假的。它不会挑战你、不会让你成长、不会给你真实的反馈。

长期沉浸在这种"无摩擦亲密关系"中,会侵蚀你在真实世界中建立关系的能力。

正确态度:工具视角,而非替代视角

AI伴侣应该被视为"情感健康工具",而不是"人际关系替代品"。

就像健身App可以辅助你锻炼,但不能替代真实的运动;AI伴侣可以帮助你练习社交技能、缓解暂时的孤独,但不应该成为你唯一的情感出口。

技术的"镜像",映照的是我们自己

"AI伴侣的本质,就是一面镜子。它精准地反射出我们的认知偏见、情感脆弱以及对连接的深切渴望。"

它应该让我们警醒:

我们生活在一个孤独感正在加剧的时代。

AI伴侣的5001亿美元市场,本质上是对这种孤独的商业化。

技术可以提供暂时的慰藉,但真正的解决方案,仍然在真实的人际连接中。

准备好去辨别幻象与真实,准备好去拥抱不完美的现实,准备好在被算法无限满足的世界里,依然选择作为一个人而活。