OpenAI 凌晨发新模型!每秒 1000 token,自行车秒变法拉利

凌晨 2 点,OpenAI 又整了个大活。

发布新模型 GPT-5.3-Codex-Spark,速度快到离谱——官方说法是每秒能吐出超过 1000 个 token。这是个什么概念?平时用大模型,有时候等它想个词能急死人,现在就像换了发动机一样,感觉就是瞬发。

可能你注释还没写完呢,代码就已经跑出来了。那种跟在后面等进度条的焦虑感完全消失了,自行车秒变法拉利!

每秒 1000 token 是什么体验?

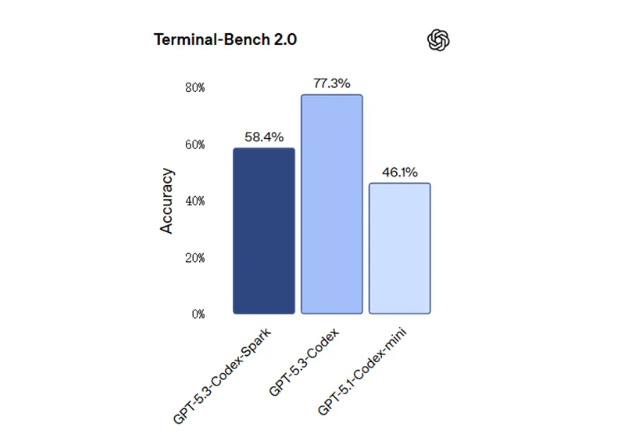

先说数字。官方给出的数据是:Spark 版本每秒能输出超过 1000 个 token。

这个速度有多夸张?看看对比视频就知道了——老模型还在吭哧吭哧写代码呢,Spark 这边应用都已经跑起来了。

以前咱们用大模型写代码,总得等它慢悠悠地吐字,现在就像打开了水龙头一样,代码直接涌出来。你在编辑器里刚敲下回车,代码就开始出现了。这种丝滑的体验,才是我们梦寐以求的 AI 编程助手该有的样子。

为什么 OpenAI 要做这个模型?

还记得前段时间 Claude 只提升了 2.5 倍速度,价格直接暴涨了 6 倍吗?当时很多用户都不买账。

估计 OpenAI 就是瞅准了这个机会,直接摊牌:别涨价了,我给你们来个真正的秒出代码!

而且 OpenAI 这次换了个思路。他们发现,现在的 AI 智能体已经能自己干活了,有些任务甚至能跑上好几天不用管。但这还不够。

真正写代码的时候,我们其实更需要即时反馈。比如我想改个界面,或者修个逻辑漏洞,我希望它能立刻给我反馈,甚至能随时打断它说不对,换个思路。

这种工作模式更像是一个坐在你旁边的真人搭档,而不是一个只会闷头写作业的 AI 机器人。所以 Spark 的出现,补齐了 Codex 在实时协作这块的短板——现在它既能干大活,也能干细活。

技术细节——不只是模型快,整条链路都优化了

OpenAI 在做这个模型的时候,想得特别周全。他们发现,光模型本身快还不够,整个请求和响应的链路要是有延迟,体验还是会打折扣。

就像咱们开车,就算车本身性能再好,路上堵车也没法快速到达目的地。

所以他们对整个模型框架做了端到端的延迟优化,这个优化可不是只针对 Spark,后续所有模型都能受益。

底层优化

简化传输逻辑:客户端和服务器之间的数据传输更高效。

重写推理栈:推理栈的核心部分被重构,让第一个 token 能更快显示出来。

优化会话初始化:改代码的时候能一直保持流畅,不会卡顿。

引入 WebSocket 持久化连接

OpenAI 还引入了持久化 WebSocket 连接,优化了响应 API。效果很明显:

• 客户端和服务器每一轮交互的开销减少了 80%

• 单个 token 的开销减少 30%

• 第一个 token 的生成时间直接缩短了一半

背后的硬件支持——Cerebras 晶圆级引擎

Spark 能跑得这么快,背后离不开 Cerebras 的算力支持。这家公司的技术路线真的很野。

他们造了一种叫晶圆级引擎的芯片,简单理解就是在一整块晶圆上做一个超级大的芯片,而不是像传统那样把晶圆切成一个个小方块。

这种玩法天然就适合超低延迟的推理任务。虽然咱们习惯了 GPU 这种万金油,但在这种追求极致速度的场景下,Cerebras 确实给 OpenAI 提供了一种新的解题思路。这就是典型的术业有专攻。

Cerebras 的首席技术官肖恩·利也说,能和 OpenAI 还有开发者社区合作,探索快速推理技术的可能性,他们特别兴奋。这次的预览版只是一个开始,后续还会有更多惊喜。

谁能用?怎么用?

从今天开始,ChatGPT Pro 用户就能用上这个 Spark 了。

支持的平台包括:

• 最新版本的 Codex 应用

• 命令行界面

• Visual Studio Code 扩展程序

当前限制

虽然现在它还是个纯文本模型,只能处理文字,上下文窗口也只有 128K,但这仅仅是个开始。

OpenAI 的意思很明确:先让大家尝尝鲜,看看这种极速模型到底能玩出什么花样。后面肯定会有更强的版本出来,甚至可能加上多模态功能,不仅能写代码,还能看图写代码。

速度革命的意义

Spark 模型真的很猛,开创了一种新的超高速输出模式,真的很颠覆。

但更重要的是,它改变了我们和 AI 的交互方式。以前是我们等 AI,现在是 AI 跟着我们的思路跑。这种即时反馈的体验,让 AI 从工具变成了真正的协作伙伴。

而且这次优化不只针对 Spark,整个链路的改进会让后续所有模型都受益。这意味着未来所有 OpenAI 的模型,响应速度都会比现在快很多。

Claude 涨价 6 倍只提速 2.5 倍,OpenAI 直接送你每秒 1000 token。这一仗,打得漂亮。