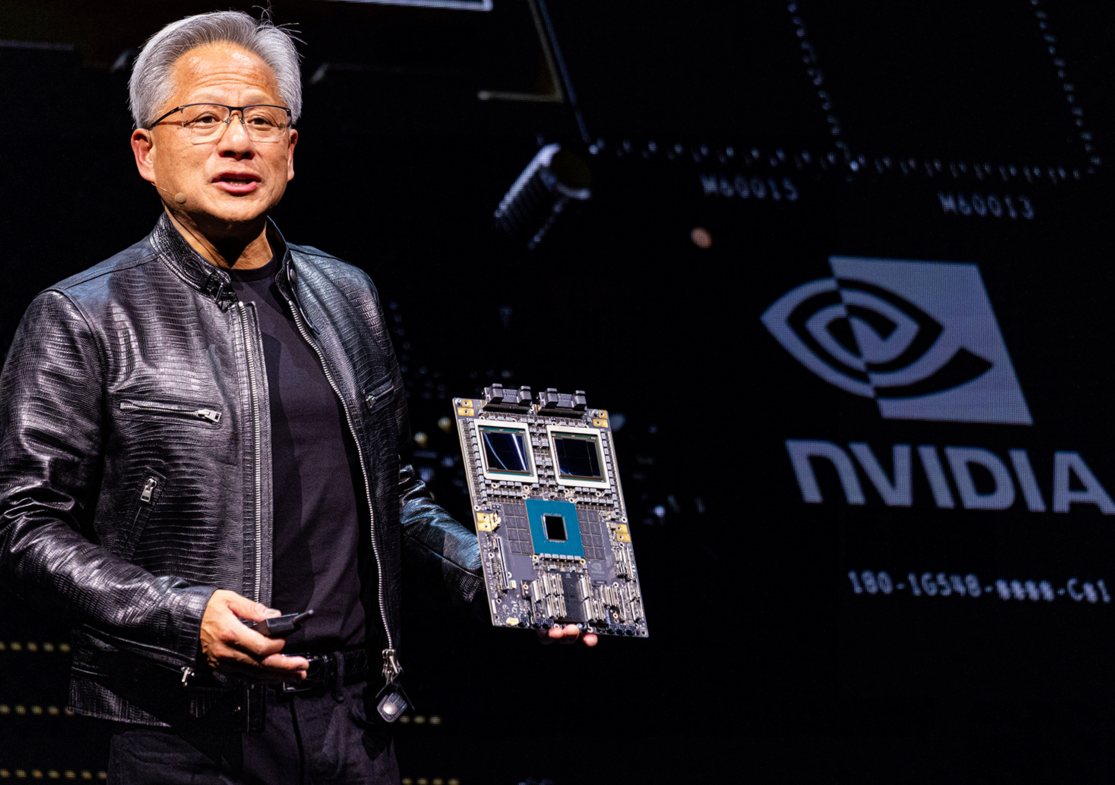

黄仁勋再甩“王炸”:1.6纳米AI芯片问世,国产替代能否接招?

“这并非易事,因为所有技术都已逼近物理极限。”在谈及即将发布的下一代芯片时,连“皮衣刀客”黄仁勋都罕见地流露出对技术边界的敬畏 。就在业界普遍认为2纳米已是“纳米游戏”终点的2026年,一场关于未来的对话被提前引爆。

黄仁勋给出的答案,代号“Feynman”。这款预计2028年问世的全球首款1.6纳米AI芯片,不仅是一记投向市场的“核弹”,更是一份针对行业顽疾的“诊断书”与“解决方案”。

当“翻译”比“思考”还慢,GPU的“偏科”危机

在传统认知中,GPU是AI时代的“万能钥匙”。然而,随着AI应用从“实验室训练”转向“大规模落地”,一个尴尬的短板暴露无遗——推理延迟。

1. 从“训练”到“推理”的重心转移

过去几年,业界比拼的是谁能在更短时间内训练出万亿参数的大模型。但在未来,当每个人都习惯用语音对话AI助手、实时翻译、自动驾驶决策时,响应速度就成了用户体验的生命线。传统的GPU虽然在并行计算上无敌,但在处理这类需要“即时反应”的推理任务时,存在天然的“偏科”。

2. SRAM的“缩放困境”与功耗墙

造成延迟的元凶之一是内存瓶颈。随着制程向1.6纳米逼近,逻辑晶体管越变越小,但负责数据暂存的SRAM却几乎“缩不动”了。这就好比CPU(中央处理器)这个“大脑”转得飞快,但用来记事的“便利贴”(SRAM)却太小且离得太远,导致大脑不得不频繁去远处的“文件柜”(HBM显存)翻找资料,产生了巨大的延迟和功耗浪费。

3. “物理极限”下的产能焦虑

除了技术痛点,还有地缘政治带来的供应链痛点。全球超过90%的最先进AI芯片依赖台积电,这种“单点故障”风险让英伟达如坐针毡。随着美国“芯片主权”概念的强化,如何确保供应链安全,成为英伟达必须解决的商业难题。

不只是“1.6纳米”,这是芯片界的“立体战”

Feynman不仅仅是制程上的跃进,它更像一次针对上述痛点的“外科手术式”打击,引入了全新的三维架构。

台积电A16制程:引入“超级电轨”

Feynman是全球首款采用台积电A16(1.6纳米)制程的AI芯片。这一制程的关键在于引入了“超级电轨”(SPR)背面供电技术。SPR技术将供电线路搬到晶圆背面,相当于在芯片背面建了座“地下变电站”。这不仅释放了正面空间用于信号传输,还降低了15%的功耗,并提升了10%的逻辑密度。

X3D堆叠:给GPU“加盖一层楼”

为了根治SRAM瓶颈,Feynman借鉴了类似AMD 3D V-Cache的思路,但玩得更极致。它计划利用台积电的SoIC混合键合技术,将Groq公司的LPU(语言处理单元)直接堆叠在GPU计算核心之上。由于采用了背面供电,腾出的正面空间正好用来做高速垂直连接,让上下两层芯片之间的数据交换延迟极低。

LPU赋能:让AI响应从“秒级”迈向“毫秒级”

为什么非要堆叠LPU?因为Groq的LPU核心优势在于“确定性执行”。传统GPU处理任务像多线程的“流水线”,可能因排队产生延迟;而LPU采用编译驱动的数据流设计,任务执行顺序和内存配置在开始前就已确定,极大减少了“等待时间” 。这对于语音对话、实时翻译这种低批处理、高即时性的任务来说,堪称“性能外挂”。

打破“单吊”台积电,开启“双代工”时代

Feynman不仅是技术上的革命,更是英伟达在地缘政治风险下的商业豪赌——告别独家代工,拥抱“双轨制”。

算力核心留台积电,I/O交给英特尔

根据最新供应链信息,英伟达采取了前所未有的分拆策略:Feynman最核心的计算晶圆(Compute Die)继续由台积电采用A16制程独家生产;而负责数据输入输出的I/O晶圆(I/O Die)则外包给英特尔,采用其更先进的14A(1.4nm级)制程和EMIB先进封装技术。

50亿美元的“投名状”与战略对冲

英伟达已在2024年底完成了对英特尔50亿美元的股权投资。此举一方面缓解了台积电产能单一的压力,为英伟达每年节省了因台积电涨价可能带来的巨额成本;另一方面,顺应了美国政府对“先进制造业回归”的诉求,让Feynman部分芯片打上“美国制造”的标签,有效对冲了地缘政治带来的断供风险。

初期独家垄断,后期“价高者得”

在台积电A16初期,英伟达是首个且几乎是唯一的客户。这种“包圆”策略虽然成本高昂,但能确保在最前沿的制程上拥有排他性优势,让竞争对手AMD等无法在同等节点上获得产能。

冰冷的数字,滚烫的性能

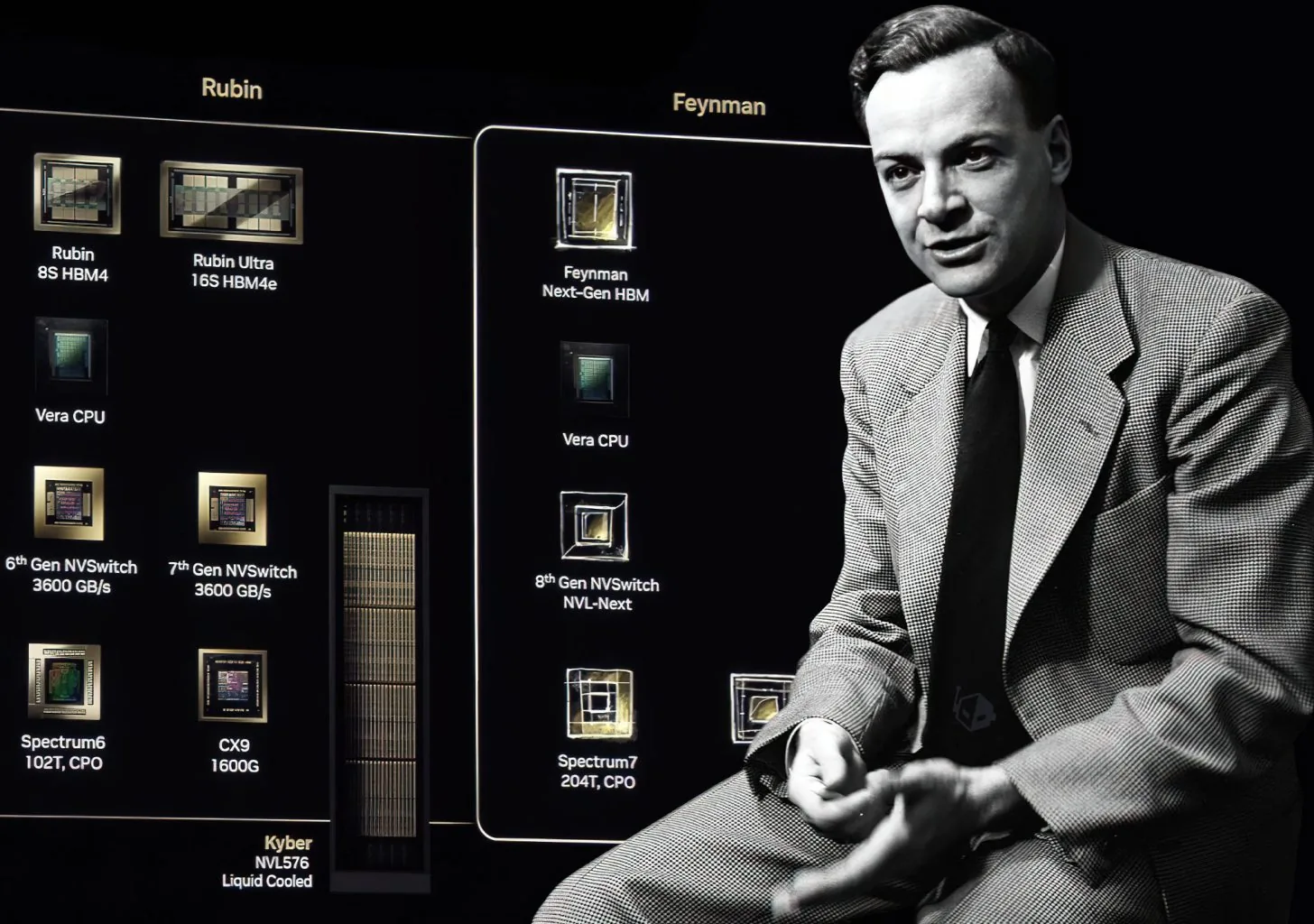

为了让性能提升可视化,以下是基于现有资料整理的Feynman关键数据指标(注:部分数据为行业预测,最终以官方发布为准):

指标维度 | 具体参数/效果 | 对比基准(前代产品) |

制程工艺 | 全球首发台积电A16(1.6纳米) | 相比3nm级制程,晶体管密度大幅提升 |

逻辑密度 | 提升约10% | 相比N2P制程(2nm级) |

功耗表现 | 同性能下功耗降低15%-20% | 相比N2P制程 |

供电技术 | 超级电轨(SPR)背面供电 | 有效降低压降(IR Drop),供电效率提升 |

内存技术 | 集成HBM4/HBM4e,未来支持HBM5 | Rubin Ultra已支持288GB容量、13TB/s带宽 |

架构设计 | GPU + LPU(语言处理单元) 3D堆叠 | 引入SoIC混合键合技术,类似X3D但功能更专 |

量产时间 | 2026年下半年投产,2028年出货 | 客户实际交付可能延后至2029-2030年 |

推理性能 | 语言类任务响应时间缩短至0.1秒以内 | 相比现有GPU推理速度可能提升数倍 |

AI基础设施的“分水岭”与大陆产业的“压力测试”

Feynman的提前到来,将对全球及中国大陆的AI产业产生深远影响。

对大陆芯片制造业——

- 严峻考验:当中芯国际还在巩固7纳米、攻坚5纳米时,英伟达已经迈入1.6纳米时代。受EUV光刻机禁运影响,差距非但没缩小,反而在制程数字上被拉大。加上台积电A16初期产能被英伟达独占,大陆厂商获取全球最顶尖AI芯片的窗口期被大幅压缩。

- 倒逼创新:这迫使国产芯片必须换道竞争。既然在传统硅基制程上追赶无望,就必须在3D堆叠、 Chiplet互联、先进封装、以及光子芯片等新架构上加大投入。Feynman采用的SoIC和背面供电技术,恰恰指明了未来5-10年的技术方向,这给国产供应链提供了“绕过光刻机”的另一种解题思路。

对大陆AI行业——

短期内,大陆AI企业仍将依赖英伟达的存量芯片(如H20等特供版)。但Feynman的量产会让“买不到最强芯片”的痛点更加突出:当海外同行用Feynman将大模型推理成本降低20%-30%时,国内企业的运营成本劣势将直接转化为市场竞争力的差距。这无疑会倒逼国内AI芯片生态(如华为昇腾、寒武纪等)加速成熟。

理查德·费曼曾说:“没有人真正理解量子力学。”同样,面对2028年的AI世界,我们也未必能完全预见Feynman芯片带来的全部变革。

从制程突破到战略博弈,这颗芯片不仅是英伟达对物理极限的突围,更是地缘政治变局下的供应链重构。对于中国大陆而言,它是警钟,更是教科书——它证明,即使在“逼近极限”的时代,创新依然没有天花板。