AI提升了10倍产能,为什么你却更累了?拆解大厂员工的"AI疲劳"账本

2026年初,硅谷的裁员新闻已经快让人麻木了。亚马逊、Block、Meta,一轮接一轮。官方理由换着说,但有一条潜台词始终没变:AI要替掉你了,早做准备。

然后,一篇博文出现了,把这个叙事捅了个窟窿。

科技公司Ona的软件工程师Siddhant Khare写了一篇《AI疲劳真实存在,却无人谈及》。他描述的不是"被AI替代的恐惧",而是完全相反的东西:他在用AI,但他比以前更累了,更焦虑了,产出质量反而在下滑。

这不是一个人的感受。DX平台追踪了12万名开发者,得出的结论是:93%的人在用AI工具,实际工作效率提升只有10%。METR机构做了更严格的双盲对照实验,结论更刺眼——在那些"给你配了AI就期待你产出翻倍"的企业里,使用AI编程工具的开发者,交付效率不升反降,下滑了19%。

这不是"AI还不够强"的问题。这是一个工作流被悄悄改造之后,代价全部转嫁给末端执行者的问题。

扒掉公关稿,看看到底发生了什么

要弄清楚这件事,先得搞明白一个被刻意模糊的技术本质。

传统的自动化工具,比如流水线上的冲压机、工厂里的分拣机器人,是"确定性机器"。给它输入A,它一定输出B,不会多,不会少。出错了,机器直接亮红灯停下来,逻辑清晰,责任明确,人在旁边盯着就够了。

生成式AI不是这种东西。它的底层是概率预测,本质是在每一步"猜"最合理的下一个词、下一行代码。它生成的内容没有确定性,每次都是一次带权重的赌博。这本身没问题,但有一个致命细节被厂商们省略了:它的错误不像机器报警那样明显。

一段由Claude或Copilot生成的代码,可以完美通过编译,格式整洁,命名规范,注释清晰,然后在某个边缘条件下触发一个藏得很深的逻辑漏洞。一份AI生成的财报摘要,段落结构完美,数字引用了一个根本不存在的来源。这种错误,不像机器报警那样让你一眼看到,它要求你带着怀疑和专业知识,逐字审查。

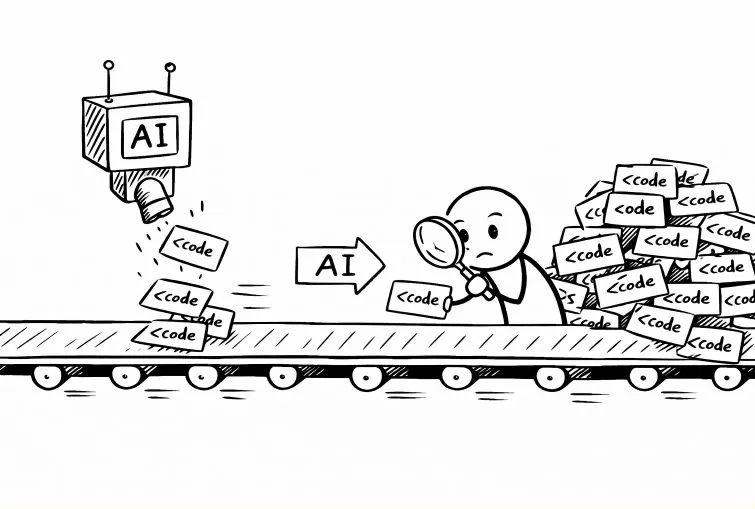

这就是"生成-审核"循环的灾难所在。

以前你写一篇技术方案,是从零开始的创造,思维流动,判断自然嵌在过程里。现在流程变了:AI30秒生成了一版,你开始审查,发现逻辑有问题,让AI改,它改了,引入了新的问题,你继续审。来回三轮,你花了1.5小时,还不如自己动手写的1小时。但KPI上写的是"当日提交了3个方案"。

人类从"创造者"变成了"质检员"。问题是,质检的认知成本并不低于创造。扫雷比埋雷难,没有例外。

横向看看:被AI困住的不只是你一个人

这件事在整个行业的副作用,比单个员工的抱怨要系统得多。

GitHub Copilot是目前市场上最成功的AI编程工具,微软一直拿"开发者用它写了50%的代码"来做亮点。这个数字是真的。但它后面跟着的那行字,从来不出现在发布会上:企业里高级工程师花在Code Review上的时间,正在成倍增加。

以前初级程序员写代码,慢,但量小,而且写出来的东西有明显的个人风格和思路,老手看一眼就知道问题在哪。现在,有了Copilot,初级程序员的代码提交量涨了,代码外表光鲜,格式完美,但底层逻辑是拼凑出来的,依赖关系没有梳理过,架构感是零。这些代码在大量涌入代码库,技术债的累积速度远超从前,而负责把关的高级工程师,成了整个流水线上最拥堵的那道关口。

Upwork的数据从另一个角度印证了同一件事。自由职业平台调研显示,77%的员工表示AI增加了他们的工作量。47%的人正在考虑离职,原因不是被AI取代,而是"不知道怎么达到雇主由于AI而提高的产出期望"。

这句话值得细读一下。雇主看到了"生成端"的数据,AI能生成的东西多了,他们就把及格线抬高了。但他们没看到的是"验证端"的成本。每多生成一个单元的内容,就需要多投入相应的人工审核成本。这个成本不会消失,它只是从"显性时间"变成了"隐性压力",最终压到了那几个在最终节点负责把关的人身上。

管理层完成了一次完美的成本转移,账面上产能翻倍,代价由人来扛。

这笔账往下游算,谁在真正收租

往整个产业链上看一眼,会更清醒。

OpenAI、Anthropic、Google DeepMind,这几家公司每年烧掉的算力成本是天文数字,盈利模型至今不清晰。但在它们上游,有一批人已经稳稳坐在收租位置上。英伟达2024财年的数据中心收入同比增长了两倍多,毛利率维持在70%上下。训练一个主流大模型,算力成本本身就在数亿美元量级。AI能力每提升一档,英伟达的账单就多一张,这条逻辑目前没有任何打破的迹象。

云服务商是另一层收租方。AWS、Azure、Google Cloud,它们既卖算力给AI公司,又把AI工具打包卖给企业客户,两头都赚。企业买了AI订阅,AI订阅跑在云上,云费用跟着水涨船高。微软把Copilot嵌进Office 365,每个席位多收30美元/月,这部分增量收入直接体现在财报里,而那些因为审核AI输出而多工作了两小时的员工,工资单上什么都没变。

最底端的打工人,在这条产业链里的位置非常清楚:他们是AI输出的最终质检节点,也是成本压缩的最终承压方。产能数字涨了,是AI的功劳;质量出了问题,是人工审核不到位。这套叙事框架,对资方来说相当顺手。

终局怎么算

"AI疲劳"作为一个词,在职场上正在从个人感受变成可量化的组织问题。它指向的不是AI工具本身有多烂,而是"把AI当无限外包脑"这个阶段已经走到头了。

Siddhant Khare在文章里提出了一个叫"反压机制"的概念,大意是:不要让AI的输出无限涌入人工审核队列,要先建一道自动化的过滤网,用测试框架、静态分析工具、结构化验证拦下那些可以被机器识别的低级错误,再让人类介入。换句话说,用机器的局部去挡住机器的局部,把人从密集的低价值纠错中解放出来,才有精力处理那些真正需要判断力的地方。

这套逻辑在技术上不新鲜,但作为一种管理哲学,大多数公司还没想明白。他们目前的状态更接近于:买了AI工具,然后在所有人的绩效目标里加了一行"充分利用AI提效",然后坐等结果。

AI写得快这件事,在同等工具条件下,会很快趋同。而谁能在AI生成物里,以最短的时间、最低的认知消耗,准确找到逻辑漏洞才是最关键的。这是一种依赖深厚领域知识和全局架构感的判断力,暂时没有工具能替代。