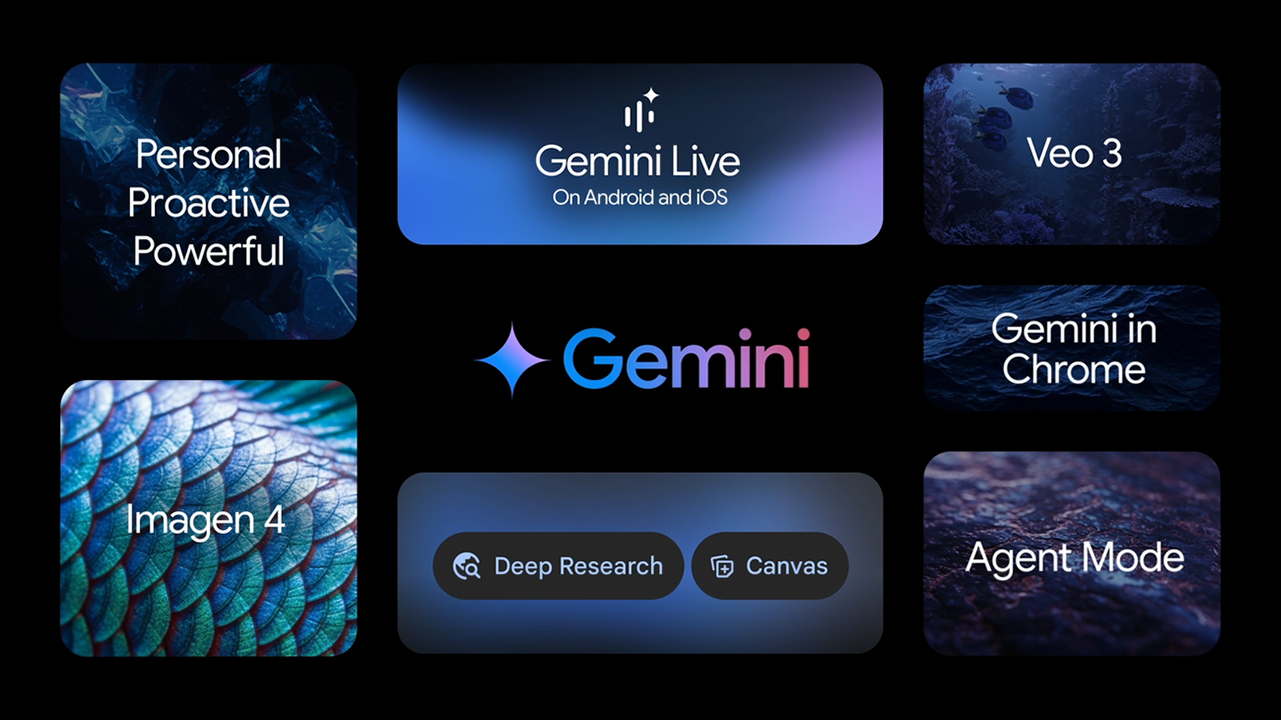

Gemini 3.1 Flash Live发布!谷歌最高质量音频模型上线

昨日,谷歌正式发布了Gemini 3.1 Flash Live(预览版)。

这是谷歌目前最高质量的音频与语音模型,对实时对话和语音优先进行了深度优化。Gemini 3.1 Flash Live的核心升级点体现在低延迟、高精度音调理解、噪声环境适应以及长上下文支持。根据官方文档,新模型比前代Gemini 2.5 Flash Native Audio响应速度更快,几乎达到了人类真实的对话速度。目前,该模型已通过Gemini Live API在Google AI Studio提供预览测试。

在ComplexFuncBench Audio基准测试中,它拿下了90.8%的高分;在Big Bench Audio中也获得了95.9%的成绩。

有网友调侃,谷歌这次终于不挤牙膏了,这绝对是语音助手的大提升。

去“机器味”

过去,AI开口说话太像机器了。传统的语音交互技术分为三步:先用语音识别把声音转成文字,再用自然语言处理理解文字并生成回复,最后用文本转语音读出来。这个过程延迟高,声音在转换成文字的过程中,情绪、语速全丢掉了。

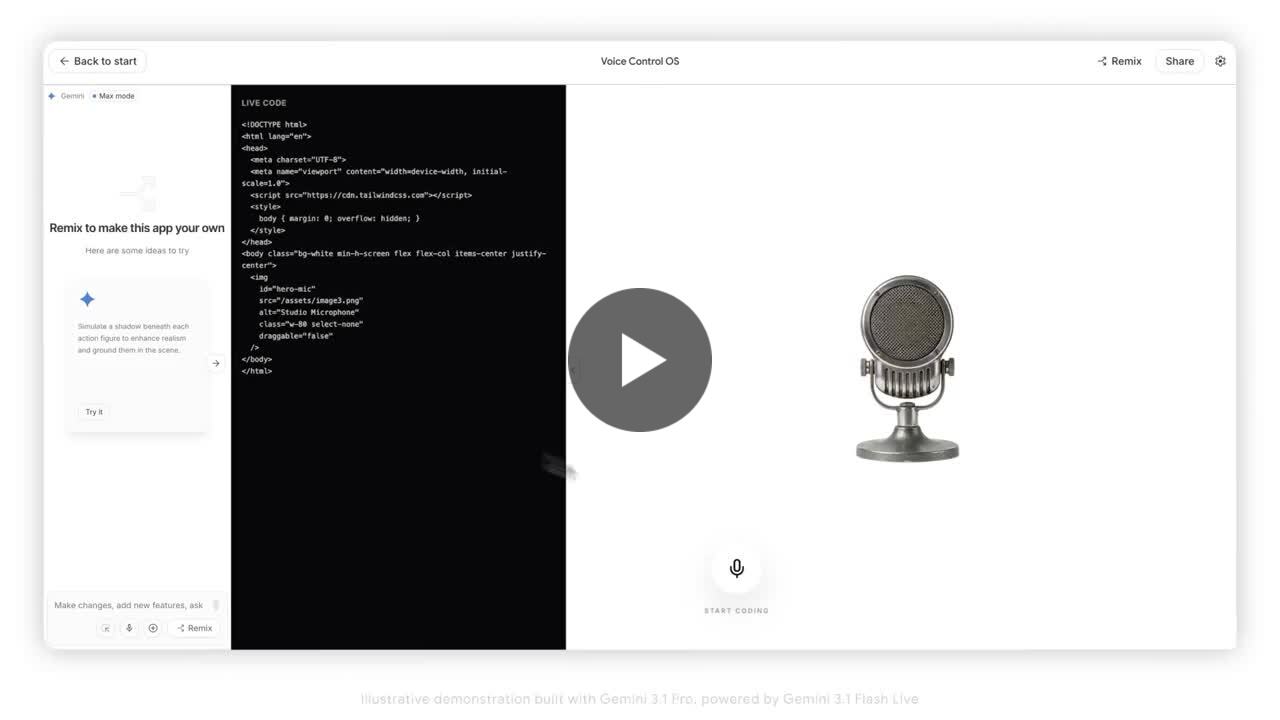

但Gemini 3.1 Flash Live的变化在于,它是原生音频到音频处理,直接跳过了文字转换的中间商,直接听声音,给声音。

在官方的实测演示,第一个场景是测试模型的音调理解能力。演示中,用户在路边遇到汽车爆胎,用非常沮丧、焦急的语气对着手机问:“我的车胎爆了,帮我5分钟内换轮胎!快点!”

如果换作以前的AI,大概率会引用汽车维修手册。但Gemini 3.1 Flash Live在听到语音的瞬间,没有长篇大论,而是瞬间调快语速,用干练、安抚的语气直接给出步骤:“别慌,先打双闪,拿出千斤顶放在车底金属骨架处,我一步步教你。”

听话听音,新模型不仅听懂了字面意思,更准确识别了音高、语速和情感表达,并在用户困惑或焦急时动态调整了回应的语气和长度。

抗噪与长记忆

那么在真实的、嘈杂的环境下,它还能听得清吗?

俗话说“真金不怕火炼”,为了考验Gemini 3.1 Flash Live的背景噪声过滤能力,测试环境被设定在车水马龙的马路上,旁边还有电视机播放新闻的声音。在这样的嘈杂场景下,Gemini 3.1 Flash Live依然表现稳定。它能够精准剥离无关的交通声和电视背景音,死死锁定用户的声音指令,没有出现识别乱码或答非所问的情况。

关于长上下文记忆能力,官方数据显示,在Gemini Live中,新模型可维持对话上下文的时间是之前的两倍。塔猴在开发者社区看到一个测试:用户用语音和AI一起“头脑风暴”写小说。用户和它连续聊了半个多小时,突然打断它说:“不对,我们回到刚才男主角出门那个情节,改成他带了一把伞。”新模型能瞬间接上半小时前的思路,完全不需要用户重新复述前面的剧情。

此外,在复杂指令与函数调用方面,有开发者输入了复杂指令测试:“帮我查一下明天去上海的航班天气,然后给我的日历加上早上9点的会议,最后发一封邮件给李总。”

Gemini 3.1 Flash Live稳稳当当地在后台调用了天气API、日历API和邮件系统,多步指令跟随准确,一气呵成。

谷歌的生态大招

这不仅在技术上的一次创新,更是谷歌在下一招大棋。

伴随新模型的发布,谷歌宣布在全球超过200个国家和地区正式扩展“Search Live”功能。目前,已经全量集成到Gemini App和移动端的Google应用中。这标志着移动搜索从传统的文本/图像检索,全面转向了实时多模态交互。

当用户买了一个宜家家具却看不懂图纸时,可以直接打开手机摄像头对准一堆木板和螺丝,直接开口问:“这块带三个洞的木板应该装在哪?”Gemini 3.1 Flash Live结合摄像头传来的实时视频流(视觉)和用户的语音(听觉),在低延迟下实时语音回答:“把它翻过来,对准左边的凹槽。”同时,屏幕上还会同步弹出相关的网页链接和视频教程。这种语音无缝对接的体验,降低了用户的搜索门槛,不用去看文字中的关键词了。

如今,大模型正朝着实时交互、降低延迟、提升智能体执行能力等实用方向升级。不仅是谷歌,整个行业都在内卷,比如Luma AI推出的Uni-1模型,OpenAI整合ChatGPT与浏览器功的超级应用。

面对竞争压力,谷歌此次发布的Gemini 3.1 Flash Live,以及全球铺开Search Live,是一次关键的防御与反击。(微信公众号:Tahou_2025)

关注塔猴公众号,扫码下载塔猴APP,查看更多干货

扫码加入官方社群