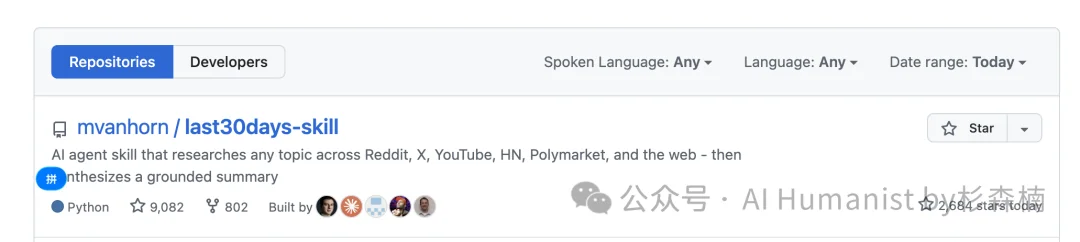

Last30Days:GitHub 一天狂涨 3000 星的「终局情报 Skill」,一文看懂如何配置

前天,我刷 GitHub Trending 的时候,看到第一名是个叫Last 30 Days的项目。

一天涨了 3000 星,现在快破十万星了。

说实话,我第一反应是,又一个 AI 搜索的轮子?毕竟这两年 AI 搜索产品多到爆炸,Perplexity、ChatGPT 搜索、Google AI Overview,基本已经卷到头了。

但我点进去看了一遍 README,发现这东西跟 AI 搜索压根就不是一回事。

先说结论。

传统的 AI 搜索,不管是 Perplexity 还是 ChatGPT,底层逻辑都一样:去网页上找内容,总结一下,给你一个看起来靠谱的答案。本质上就是知识检索,跟你自己 Google 差别不大,只是多了一层总结。

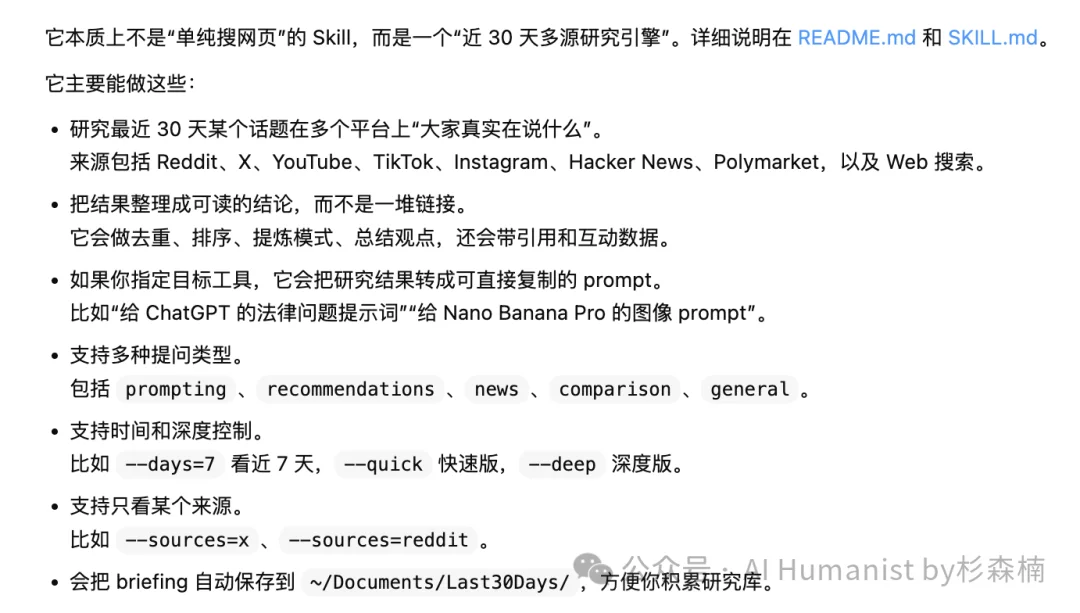

Last 30 Days 干的完全是另一件事。它去找的是「正在发生的共识」。

它会真的跑去 Reddit 上看大家都在聊什么,跑去 X 上看大家在转什么、评论什么,跑去 YouTube 拿视频的 transcript 做文本分析,甚至会去 Polymarket 上看大家都在拿钱氪什么方向。

等于说,它能看到那些还没被主流媒体总结过的趋势,能直接跳过 SEO 垃圾文章,去抓社区里真实的信号。

这也是它一天涨 3000 星的原因。很多人等这个东西等了很久了。

我看完 README 就想上手试,结果在配置环节卡了蛮久的。这个 Skill 需要配一堆社交媒体的 API,等于说它是调用了各种搜索渠道去抓信息。但配置方法比较碎,我踩了不少坑,相信很多朋友也遇到了一样的情况。

所以索性出一篇完整教程。

功能配置

先看全景,大致需要配的有这些:

Scrapecreator:

SCRAPECREATORS_API_KEY=...

最重要的一项,一个 API 直接点亮 Reddit + TikTok + Instagram 三个渠道,覆盖面很广。

Codex:

OPENAI_API_KEY=sk-...

如果你直接用 Codex 部署这个 Skill,这一项可以跳过,不用管。

X 二选一:

AUTH_TOKEN=... / CT0=... 或者 XAI_API_KEY=xai-...

用来检索 X 上帖子信息的渠道。

Bluesky:

BSKY_HANDLE / BSKY_APP_PASSWORD

去中心化版的 X,我个人觉得不配也没什么影响,无伤大雅。

Truth Social:

TRUTHSOCIAL_TOKEN=...

不配也没什么影响,无伤大雅。

原生 Web 搜索,三选一或多选:

PARALLEL_API_KEY / BRAVE_API_KEY / OPENROUTER_API_KEY

这个还是需要配的,我用的是 Brave API,直接淘宝买,很便宜。

下面逐个说怎么配。

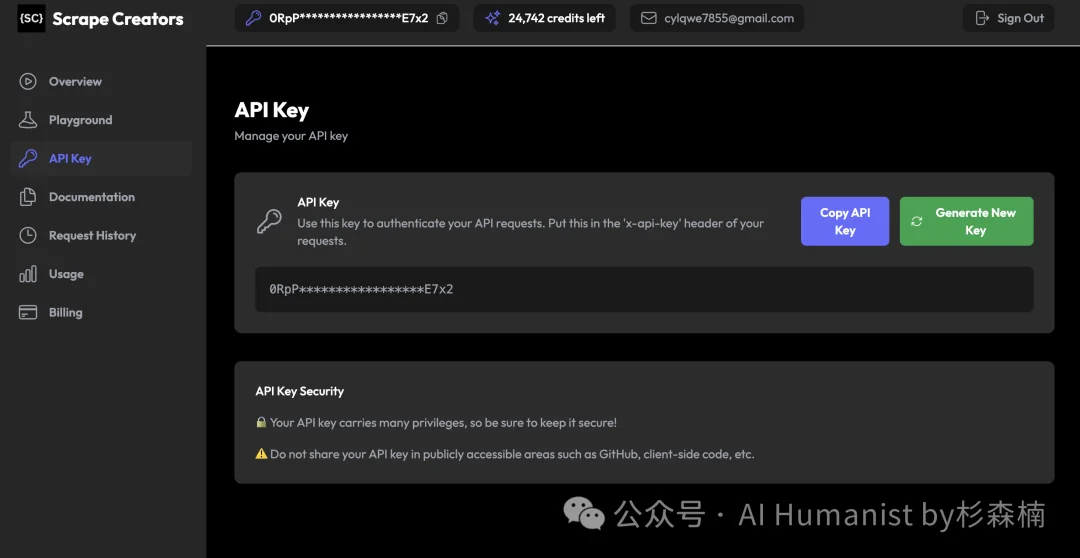

Scrapecreator

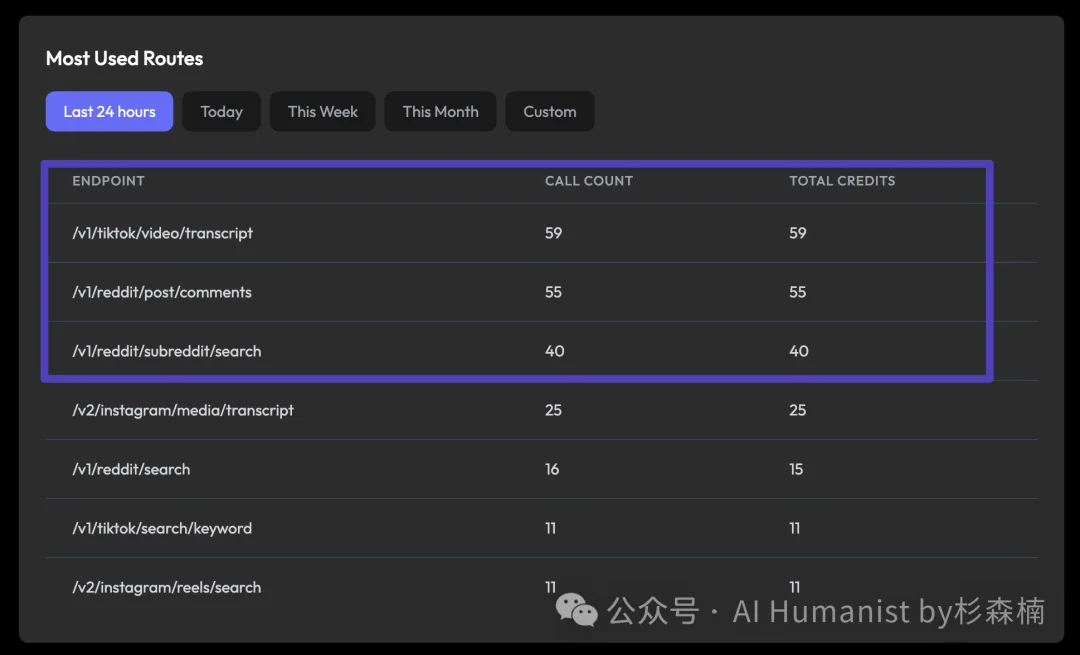

Scrapecreator 是所有配置里最关键的。就这一个 API,就能同时搜 Reddit、TikTok、Instagram,也是 Last 30 Days Skill 的核心必选项。

配置很简单。直接打开官网 scrapecreators.com,注册账号,进后台就会显示一个 API Key。这个 Key 每天有 100 免费积分,根据我的实测,大概够跑两轮任务。

拿到 Key 之后,把它给 Codex,让它帮你写进 Last 30 Days 的环境变量里就行了:

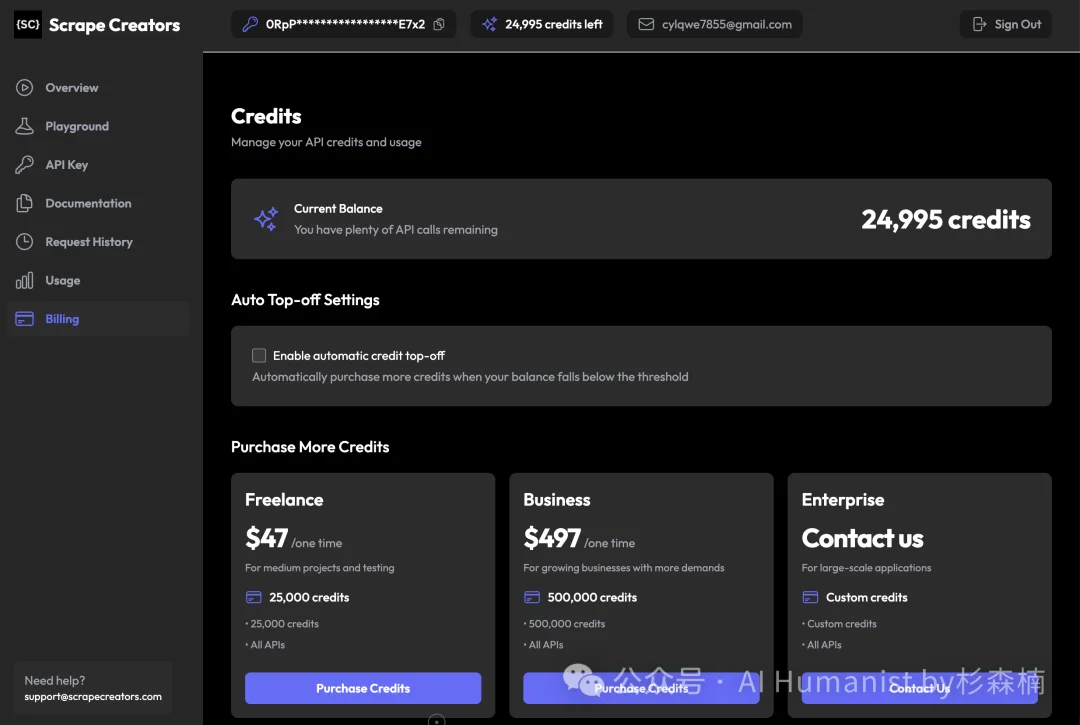

免费积分肯定不够长期用。我直接花重金,氪 330 块买了 25000 积分:

实测下来,每轮搜索消耗积分在 60 左右,折算下来大概能跑 400 多次,每次不到一块钱😊

X

X 有两种方式,一种是用 xAI 的 API Key,另一种是直接拿浏览器里的会话凭证(AUTH_TOKEN + CT0)。我选了第二种,稍微麻烦一点,但不用额外注册。

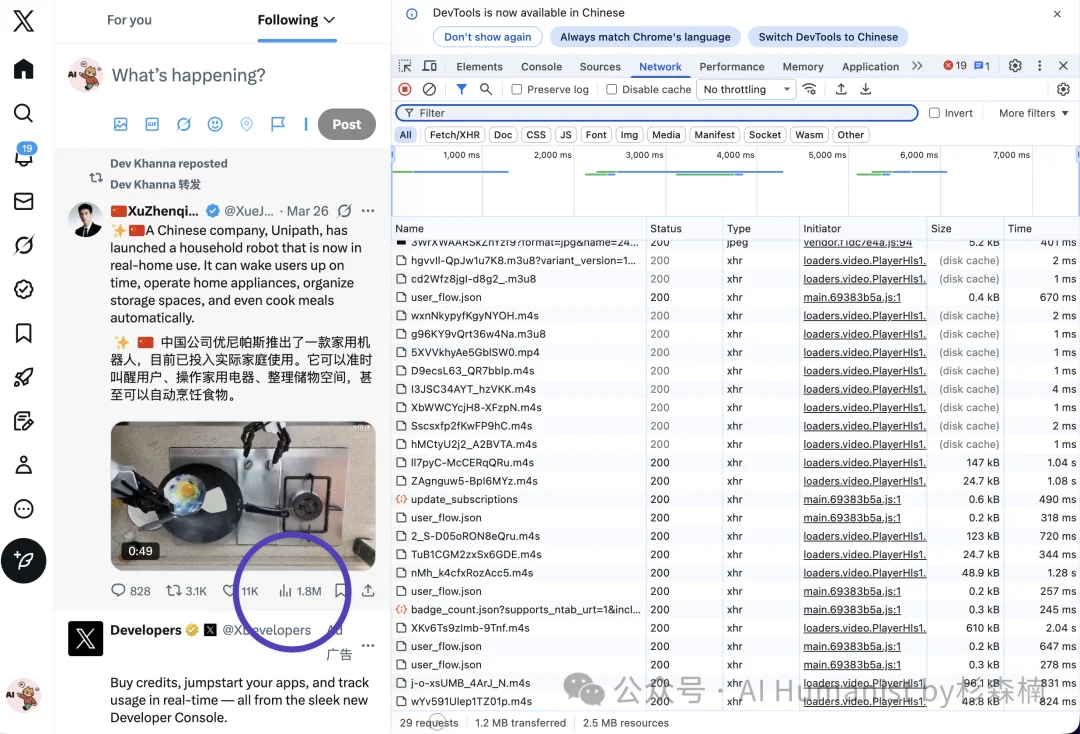

操作步骤:在浏览器里登录 x.com,按 F12 打开开发者工具,切到 Network 标签。

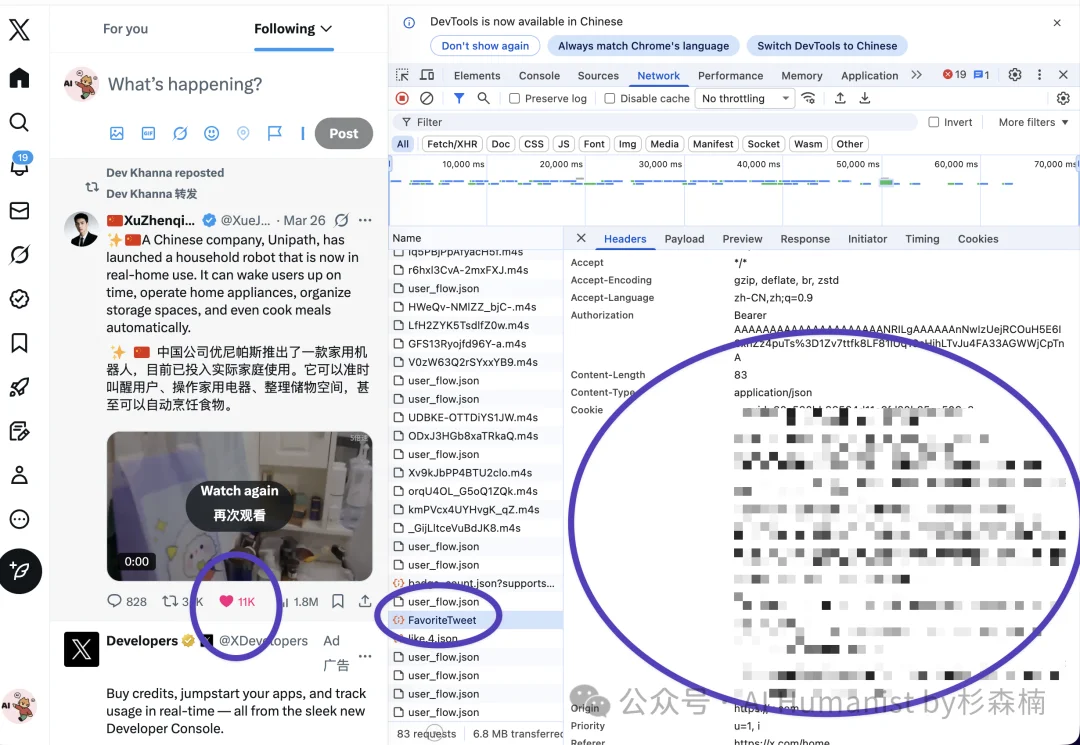

然后随便给一条帖子点个赞。右侧中间那一栏会出现一个 favorite tweet 的请求,点开之后,在 Cookie 里就能找到 AUTH_TOKEN 和 CT0 这两个值。如果在一大堆字符里找不到,直接把整段 Cookie 复制下来丢给 AI,让它帮你提取就行。

这两个值一定要保密 ⚠️ 泄露了等于别人能用你的 X 账号。

原生 Web 搜索

Brave、Parallel、OpenRouter 三选一就够了。我配的是 Brave API,直接淘宝搜就有,23 块钱 2000 次,非常便宜。

所有 API 配完之后,统一交给 Codex 写进环境变量,就能直接用了。整个流程说起来多,实际操作十来分钟就能搞定。

四轮实测

配完了,下面进入正题。我做了四轮测试,看看 Last 30 Days 到底能干什么。

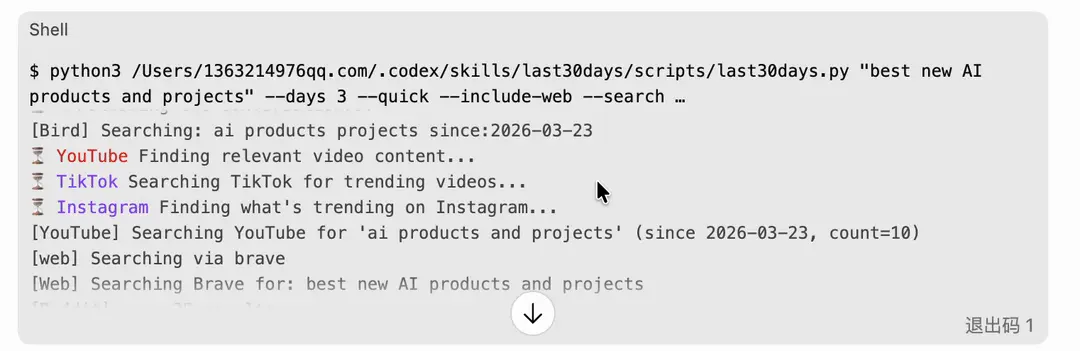

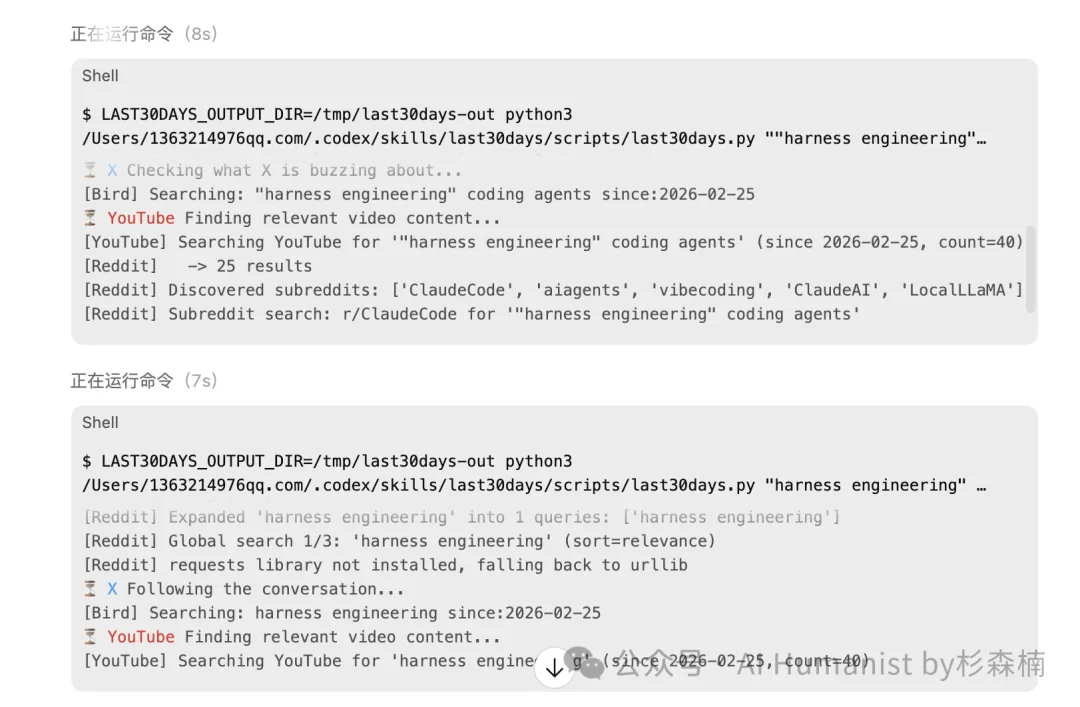

测试 1:全平台 AI 热点搜索

第一轮,我给了它一个最基础的任务:

研究下最近 3 天,大家在多个平台上聊的最多的好玩的 AI 相关产品、Skill、项目都是什么?

这时候 Last 30 Days 的多渠道能力就完全展开了。所有你配好的 API 渠道会同时启动:Reddit、X、YouTube、TikTok、Instagram、Hacker News、Polymarket,再加上 Brave 做网页搜索补充。

它的搜索流程,我整理了一下,核心逻辑是:

多信号源 → 聚合 → 去噪 → 判断趋势

一个一个看。

Reddit 上,它自动扩展了一堆关键词,不光搜全站,还会钻垂直社区。最后查了 59 个帖子,去重和时间过滤之后留下 59 条有效讨论。

X 上抓实时舆论,看有没有爆点和高转发。

YouTube 上的做法比较有意思。它不去看视频,它去拿每个视频的 transcript 做文本分析。等于说在读那些 UP 主已经筛选过的深度内容,一般能找到 10 条以上的相关视频。

TikTok 和 Instagram 上主要抓爆款玩法和短视频趋势。TikTok 上抓了 4 条,Instagram 上 1 条。这块其实是很多 AI 搜索工具覆盖不到的盲区。

Hacker News 上主要看工程师在讨论什么,新工具有没有技术认可,找到了 6 条帖子。

Polymarket 是个很有意思的维度。这里看到的已经不是讨论了,是钱 💰 大家拿真金白银在押 AI 哪家公司会赢、哪个模型下一个发布,它抓了 5 条。

Brave Web 搜索作为补充,抓了非常多基础网页信息。

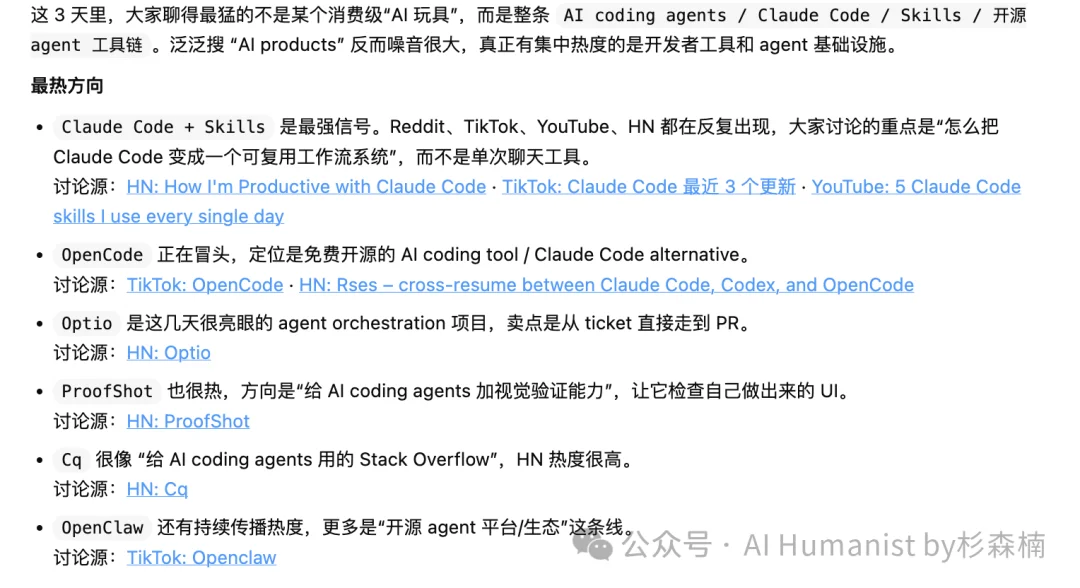

结果出来之后,有一个点让我印象很深。

它告诉我,最近三天社区里真正高频讨论的,并不是大家直觉里的那些消费级 AI 玩具。真实的热度反而集中在一些垂直方向上,比如 OpenCode、Optio、ProofShot、Cq 这些项目。

说实话,你拿字节的 Anygen 或者其他 AI Agent 产品去搜同样的问题,它们大概率不会提到这些名字。我真的拿好几个主流 AI 搜索产品试过了,无论怎么问,给你的都是那些比较主流的、大家都知道的方向。它们本身几乎没有搜索这些「信号、共识」的能力。

Last 30 Days 能挖到这些,是因为它的搜索逻辑不一样。它会先建立一个主线结论,然后在周围搭支线去验证,看这个结论靠不靠谱。如果发现某条线需要补查,它会再跑一轮精准查询,把更干净的产品排序结果做出来。

而且所有结果里的链接都可以直接点击,一步到位 👍

测试 2:病毒式传播项目检索

第二轮:

帮我查现在 AI 领域里有没有什么病毒式传播的内容,给我非常详尽丰富的报告

这一轮它连续跑了四轮七天的研究。最终得出结论:现在传播最猛的有两条线,一条是 Coding Agent 赛道,另一条是帮创作者和商家做产品视觉、短视频商业化的工具。

Last 30 Days 最适合干的就是这种社区传播内容的搜索。它会大量去查各个社区的真实讨论,然后做置信度分析和交叉验证。

你看下面的 RuFlow、Replit Agent 4,它给出结论的时候,会同时告诉你支撑证据是从哪来的:Reddit 社区讨论加 TikTok 上的热度数据。

之后它还会告诉你它认为真正的病毒传播主线是什么。这些东西刚看可能觉得没什么特别,但你在传统 AI 工具里确实搜不到这个维度的内容 😶

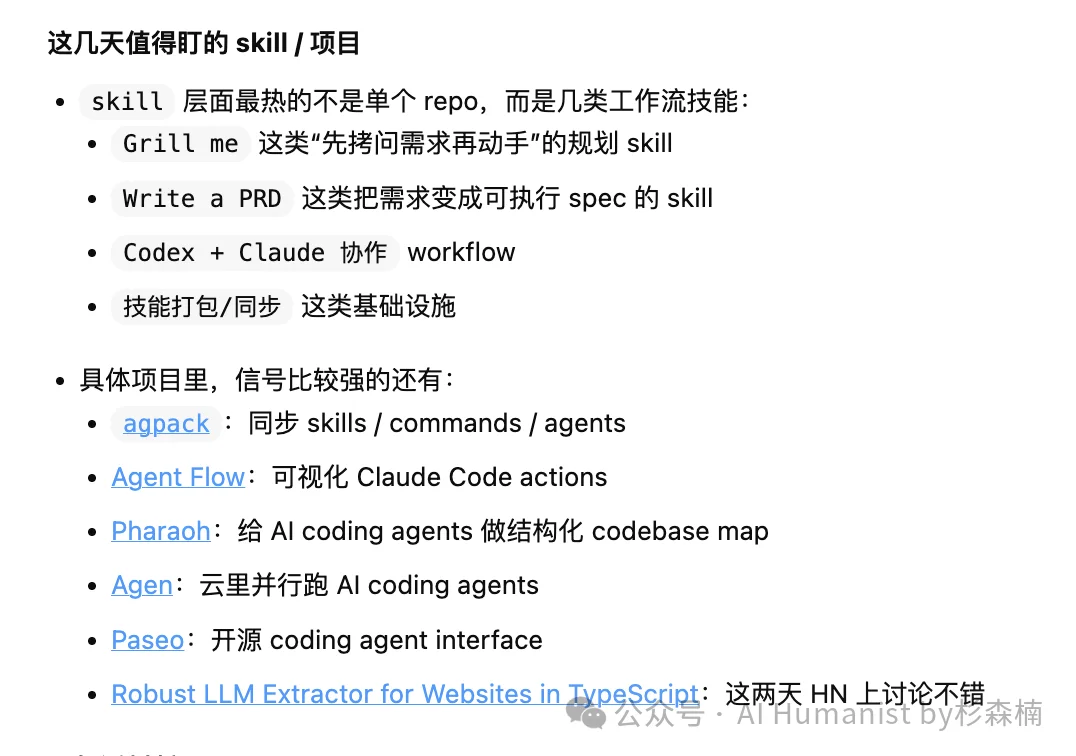

测试 3:AI 选题清单

第三轮:

能拿来做内容和流量的病毒式 AI 选题清单,一共做 15 个工具,用这个 Skill 重新搜一遍

出来的 15 个产品里,有好几个是传统 AI 搜索压根不会出现的,比如 Critify AI、Piececard Flows。这些产品的信号还不够强,进不了主流 AI 搜索的视野。它们往往就是在某一个社区的某一条发言下面集成了非常多赞和评论,但没有形成主流叙事,所以传统工具是完全漏掉的。

Last 30 Days 就是能把这种散落在各个角落的信号给捞出来。

而且当它并行跑多个搜索窗口的时候,场面确实牛逼。几百上千条搜索路径同时跑,直接把我的 X 和 Brave 搜索渠道都给挤爆了 😅

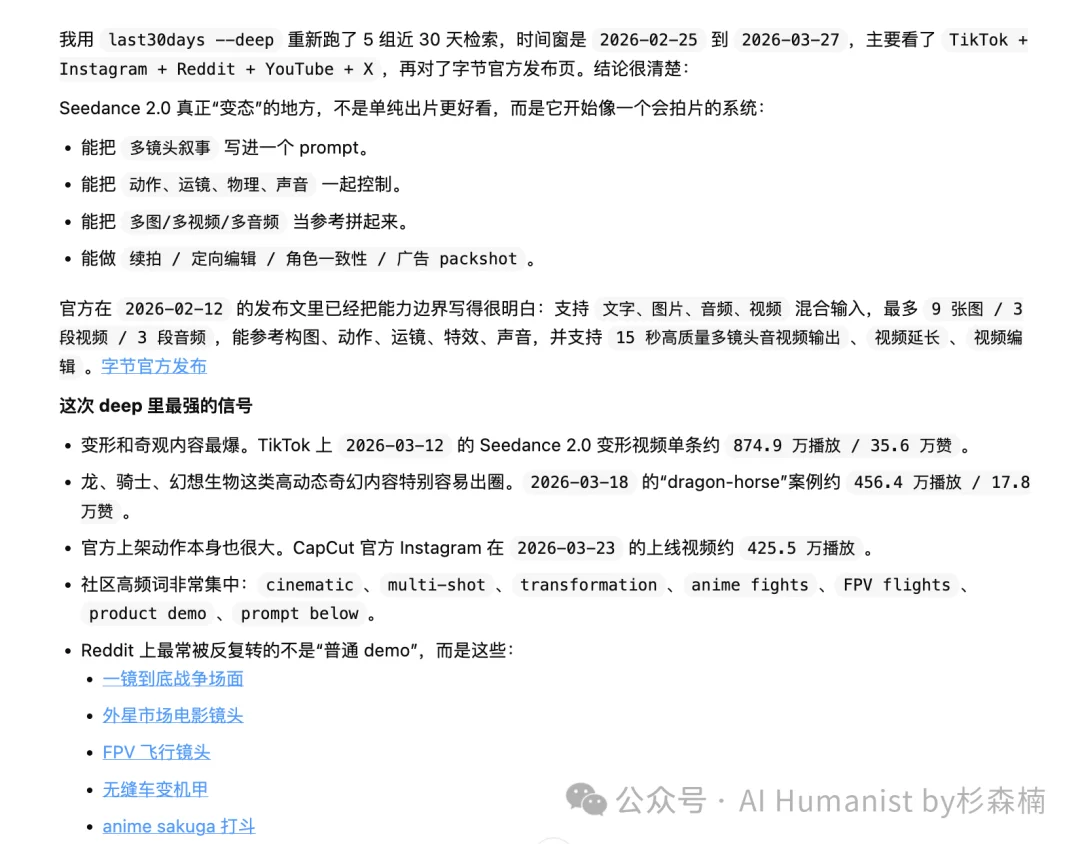

测试 4:Seedance 2.0 提示词调研

第四轮测试,也是我觉得最能体现 Last 30 Days 价值的一个:

调研字节 Seedance 2.0 的变态用法和提示词

这个案例其实也是官方推荐的用例。从上面几个案例你也能看出来了,Last 30 Days 最主要的能力就是去调查真实的信号。它不直接给你结论,但会帮你把社区里散落的真实信息全部聚合起来。

你仔细看它给出的结果,它把社区里跟这个模型相关的高频词都找出来了。Reddit 上最常被转的压根不是普通 Demo,都是一些比较独特的用例。

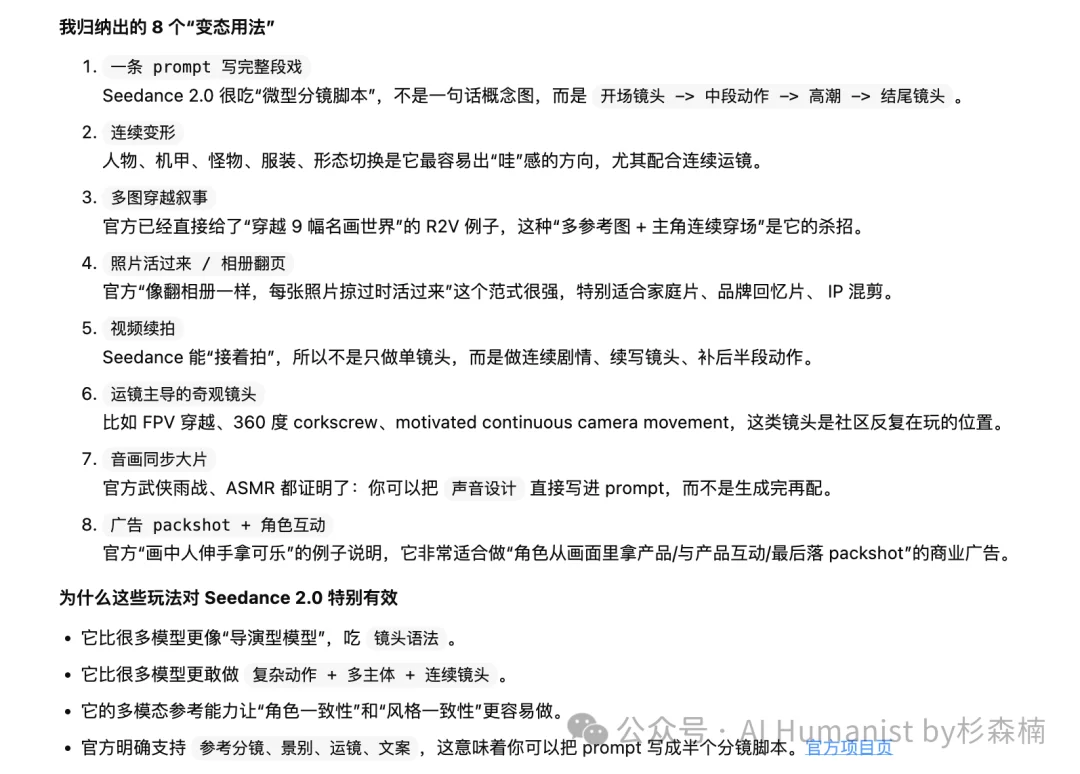

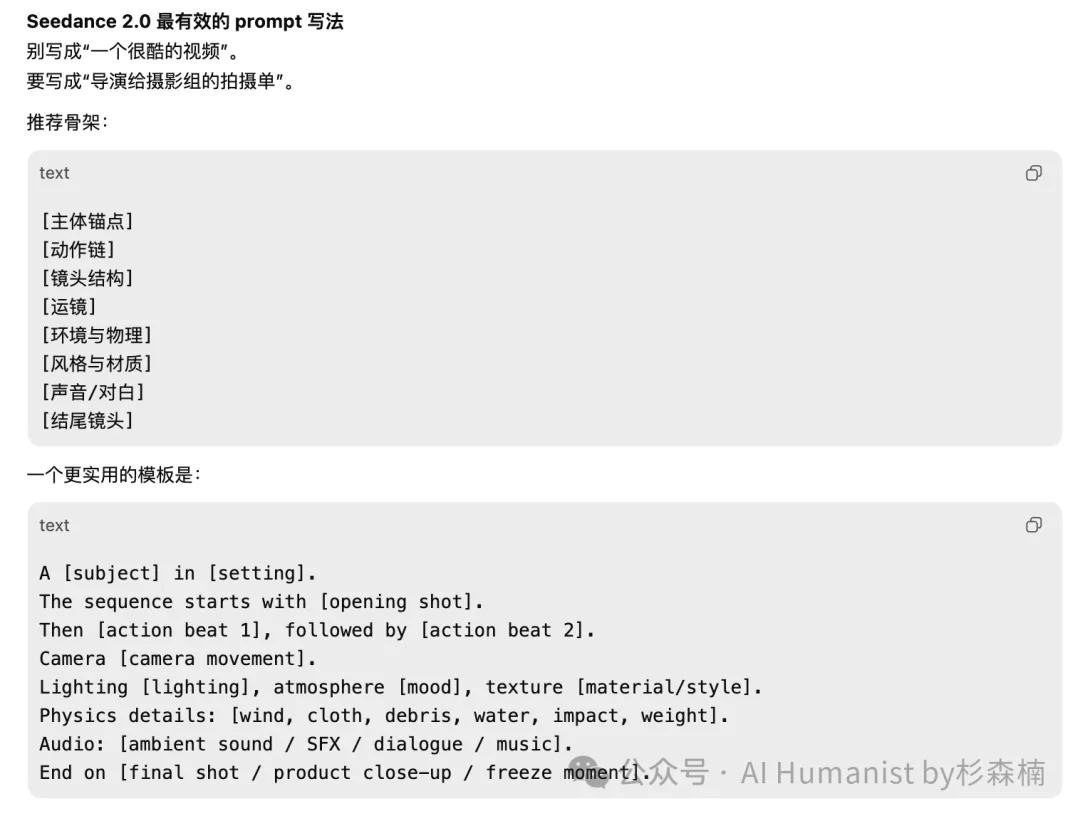

然后它总结出来 Seedance 2.0 最有效的 Prompt 写法。这些写法不在任何官方文档里,也不在那些 SEO 文章里。 全都是从真实用例中提炼出来的,从实际用过的人的反馈中整理出来的。

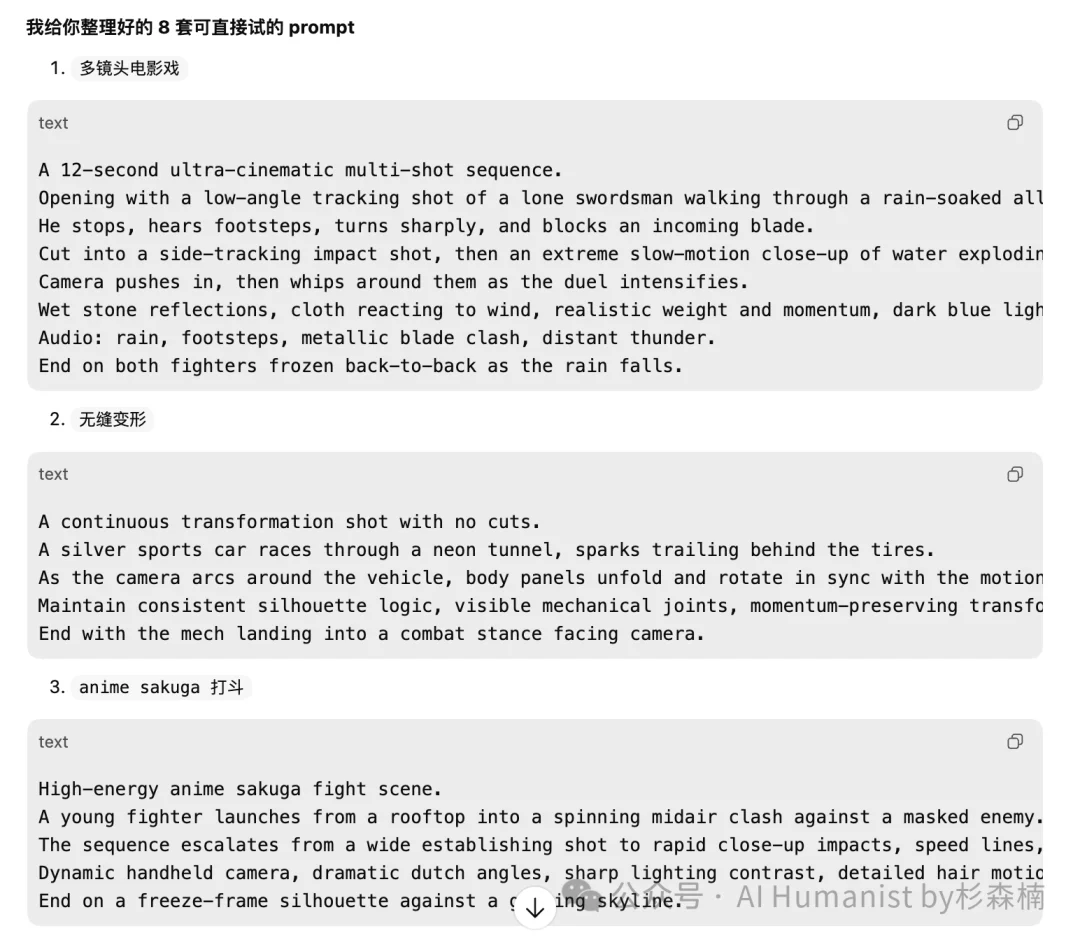

甚至还给我整理了 8 套可以直接试的 Prompt 模板。

这个我其实很有发言权。我平时也经常用 AI 帮我写 Prompt,但你会发现,如果你让 AI 帮你写视频模型的 Prompt,它很容易写得很飘,做出来的东西模型大概率生成不了。你想加一堆前置限制来约束它,但那样又太麻烦了,本来就是想省事才让 AI 帮忙的,搞一堆限制条件反而划不来。

Last 30 Days 就不一样了。它搜出来的 Prompt 是社区里大家真的在用的、反复验证过好用的、比较细节的写法。每一条背后都有真实的社区反馈做支撑。

贴心总结一下

跑完四轮测试之后,我对 Last 30 Days 有了一个比较清楚的判断。

它的核心能力,一句话:

多信号源聚合 → 去噪 → 趋势判断

传统 AI 搜索的逻辑是帮你检索网页、总结内容。Last 30 Days 干的是帮你去读社区。它不给你「正确答案」,它告诉你「大家都在聊什么、什么方向的真实热度最高」。

这两件事之间的差距,比听起来大得多,如果是长时间用 AI 做主力搜索的人就会明白。

最直接受益的应该是两类人。

第一类,做内容的。如果你需要找选题、追热点,传统 AI 搜索只能告诉你大家已经知道的东西。Last 30 Days 能帮你看到那些还没形成主流叙事、但社区里真实热度已经很高的方向。这种信号对做内容来说太重要了。

第二类,做产品调研的。你想知道某个领域里用户真实的反馈,去看 SEO 文章根本没用,得去看社区讨论。Last 30 Days 把这件事的效率提高了几十倍。

当然,也得说几个局限。

API 配置有门槛,没什么技术背景的朋友可能需要花点时间折腾。积分有成本,虽然每次不到一块钱,但高频使用的话也是一笔开销。还有一个比较明显的短板,目前覆盖主要集中在英文社区。Reddit、X、YouTube 都是英文平台为主,如果你想调研小红书、知乎、微博上的讨论,暂时还覆盖不到。

一天 3000 星不是偶然的。

它戳中了很多人等了很久的一个需求:在信息爆炸的时代,比起「找到答案」,「看到共识」可能更有价值。

大家快去玩起来吧~~~~~~~~ 😤

文章来自于"AI Humanist by杉森楠",作者 "杉森楠"。