首个支持龙虾视觉的多模态Coding模型:智谱GLM-5V-Turbo深度解析

今日,智谱正式发布首个原生多模态Coding基座模型——GLM-5V-Turbo。兼顾视觉与编程能力,深度适配OpenClaw(龙虾)。

官方公布的演示中,上传一张手画的草图,就能生成完整的前端网页。除了设计草图,模型还能看懂截图和网页界面,做到了看得懂画面、写得出代码。

截图变App

让AI写代码很容易,但让AI理解UI布局很难。

前端工程师们深有体会,你要向模型描述“左边是带阴影的悬浮导航栏,右边是瀑布流,主色调是莫兰迪色系,按钮要有圆角和悬停动效”,往往需要写上几百字的提示词,最后还需要抽卡,靠纯文字盲人摸象效率太低。

智谱这次发布的模型打破了视觉与代码的壁垒。GLM-5V-Turbo能直接读取Figma设计稿、视频演示、网页截图、文档布局,连开会时在白板上的手写笔记也可以。

我们来看产品能力:

前端复刻:一张草图或参考图,模型能理解其组件层级、色彩搭配与视觉留白,并输出完整、可运行的前端工程,准确还原版式、配色、动效等视觉细节。

动态还原:如果你觉得静态截图不够,可以给它看一段App的录屏演示。GLM-5V-Turbo能够从视频帧中捕捉组件的滑动逻辑、弹窗的交互动效,逆向工程出带有完整交互逻辑的动态网站。

交互式编辑:生成代码只是第一步,后续你可以圈出页面上的某一个按钮,告诉它“把这个改成红色,加上点击后的表单联动”。模型支持按需求增删页面模块、修改文案与样式,全部实现可视化迭代编辑。

前端工程师过去需要手动切图、写尺寸、写样式、调CSS,现在被压缩成了“上传图片-运行”,效率更高。

深度适配OpenClaw

这只是多模态Coding的基本功,这次智谱通过适配OpenClaw,让模型脱离了对话框,嵌入到了操作系统中。

我们先科普一下OpenClaw是什么。OpenClaw(龙虾)是目前最火的开源智能体框架,它可以本地运行在你的设备上,支持接入微信、飞书等,能进行计算机操作、跑自动化任务,堪称“最强打工人”。

但巧妇难为无米之炊,龙虾虽然执行力强,但是个近视眼,面对复杂电脑桌面、图表和动态变化的网页时,往往不知所措。

GLM-5V-Turbo的出现,就是给它戴了副眼镜。请注意,智谱这次不是简单做API接口兼容,而是深度适配。官方直接将其定位为OpenClaw的“视觉+行动升级引擎”。

具体来看,它能为龙虾带来什么:

看懂环境:原生理解GUI界面、网页布局、图表信息。现在,龙虾打开一个管理系统时,能瞬间识别出哪里是输入框、哪里是下拉菜单、哪里是提交按钮,实现“所见即所得”。

规划动作:结合龙虾强大的Skills(工具链),GLM-5V-Turbo实现了视觉定位。它知道“点击右上角齿轮图标”这个动作,在当前屏幕的X/Y坐标到底在哪里。

执行任务:支持画框、截图、读网页、多模态搜索。在电脑桌面环境里点按拖拽,全流程不翻车,特别适合长链条、多步骤的自动化任务。

接入GLM-5V-Turbo后,龙虾做到了“看懂环境→规划动作→执行任务”,终于长出了眼睛和触手。

小尺寸大能量

这还只是应用层,底层架构才是重头戏。

模型圈有个词叫“视觉税”,简单来说,当你给文本模型加上视觉能力后,它的注意力机制会被图像分散,导致其编程、推理能力大幅下降。看图变强了,但写代码变蠢了。

GLM-5V-Turbo是怎么做的?

首先,它采用了新一代CogViT视觉编码器配合推理MTP结构。在训练阶段,智谱团队没有采用拼凑法,而是从预训练到后训练,通过涵盖GUI Agent、Coding Agent等30多种任务的联合强化学习训练,将视觉感知与代码逻辑进行了融合。不是“先看图,再翻译成文字,最后写代码”,而是原生一体。

其次,它拥有200K的超长上下文窗口,最大输出高达128K tokens。对于需要长期记忆和长链执行的龙虾场景来说,简直是量身定制。

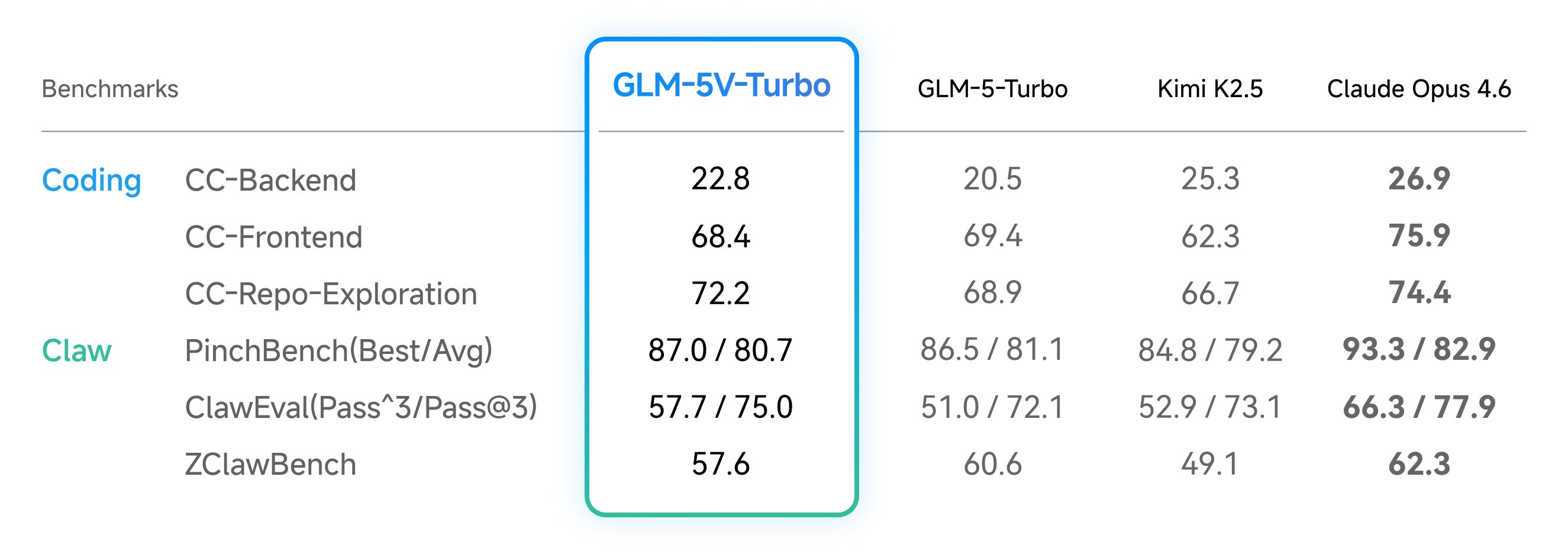

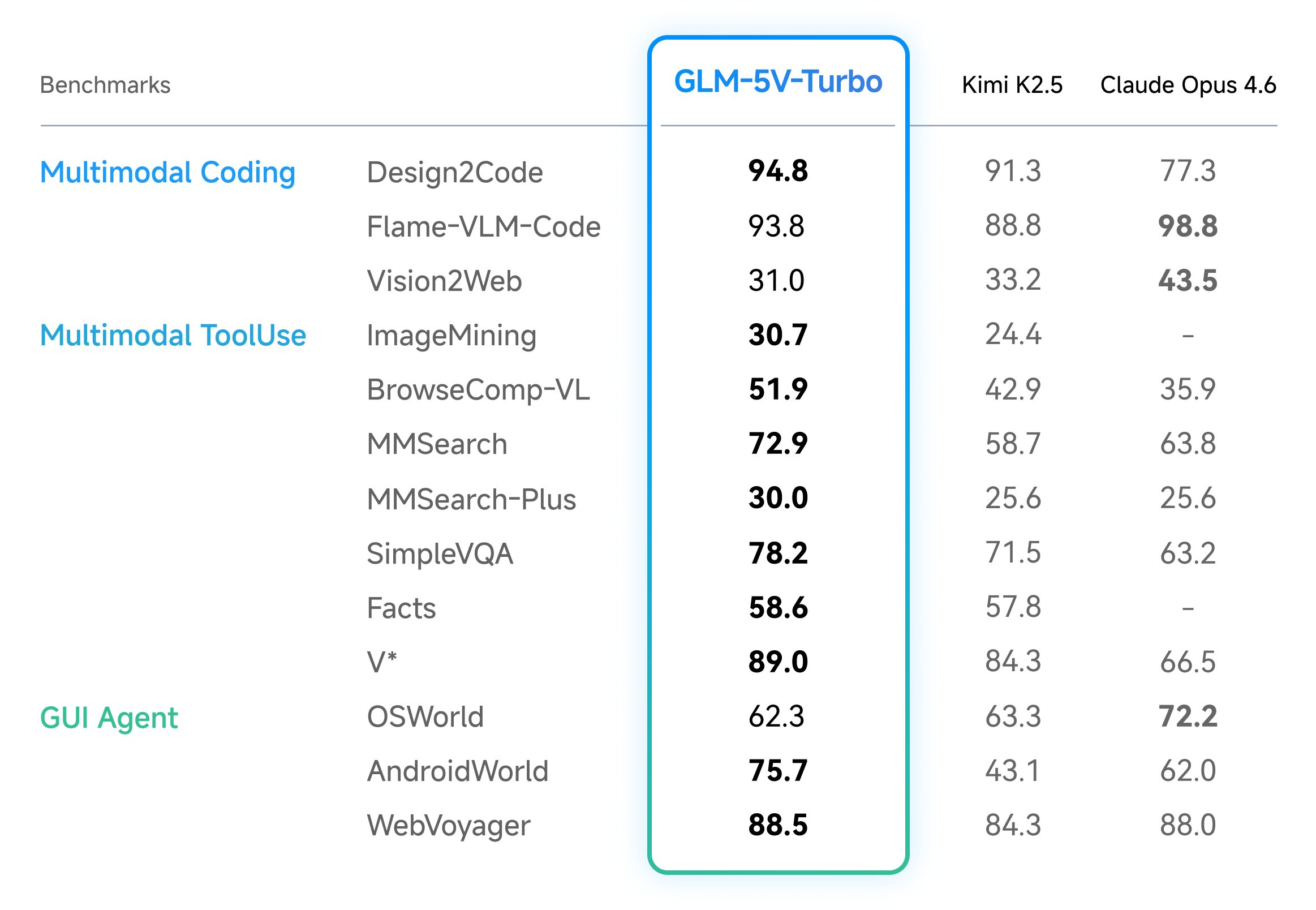

没事跑个分。在CC-Bench-V2的Backend(后端)、Frontend(前端)和Repo Exploration(仓库探索)三项核心基准测试中,GLM-5V-Turbo均保持了顶尖水准,这证明了视觉能力的引入,并没有向编程与推理能力收“视觉税”。

同时,它还在多模态Coding基准上取得领先;在衡量真实GUI环境操控能力的AndroidWorld、WebVoyager,以及专门衡量龙虾Agent执行质量的PinchBench、ClawEval和ZClawBench上,得了优异的成绩。

更可怕的是,这是一款更小尺寸的模型。它没有几千亿的参数,却在“视觉+编程+智能体任务”上实现了罕见的高性能平衡,做到了真正的性价比。

实测说话

但参数再漂亮,最终还是要用过才知道,我们来看看它在具体场景中的实测表现。

场景一:GUI自主探索

结合Claude Code等框架,GLM-5V-Turbo化身为了探险家,它像一个真实的人类测试工程师一样,自主打开目标网站,点击各个Tab,浏览页面结构,梳理各页面之间的跳转关系。

在探索过程中,它会自主采集视觉素材与交互细节,最后基于自己记录的探索结果,直接生成代码,把整个站点完整复现出来。

场景二:AutoClaw的股票分析师

接入GLM-5V-Turbo后,龙虾的任务被拓宽了。它不仅能写代码,还能看懂金融图表。

在AutoClaw中,已经上线了“股票分析师”Skill。利用GLM-5V-Turbo的原生视觉能力,龙虾能直接看懂K线走势图、复杂的估值区间波动图,甚至是券商研报里密密麻麻的柱状图和饼图。

实测指令非常简单:“帮我分析今天XXX的股价,生成专业分析报告”。

接收指令后,龙虾迅速行动。它自己打开浏览器,在四个不同的金融数据平台上同时抓取行情图、研报截图和新闻页面。凭借GLM-5V-Turbo强大的视觉解析力,它实现了四路数据源60秒并行采集。一分钟后,一份图文交错、逻辑严密、包含走势预测的专业研报直接推送到你的桌面。

目前,官方已经提供了极其详细的接入教程。开发者只需要在OpenClaw配置文件中,将model设置为zai/glm-5v-turbo,即可一键切换,开箱即用。(微信公众号:Tahou_2025)

关注塔猴公众号,扫码下载塔猴APP,查看更多干货

扫码加入官方社群