15个模板复制粘贴,让同一个AI聪明十倍:上下文工程实战手册

Nav Toor 的上一篇上下文工程文章火了——上百万人阅读,上千人私信他同一个问题:"道理我都懂了,但我到底该打什么字?"

这次他没再讲理论。他直接甩了 15 个模板出来,声称复制、粘贴、五分钟内见效。

我读完之后的感受是:这不是一篇"提示词集锦"。这是一套完整的 AI 使用操作系统。

Nav Toor 原文标题图:上下文工程实战手册

01 先搞清一件事

上下文工程(Context Engineering)和提示词工程(Prompt Engineering)有什么区别?

提示词工程关心的是你说了什么。上下文工程关心的是AI 在回答之前,看到了什么。

不只是你的提问,还有系统指令、记忆、工具、检索到的知识、动态组装的上下文……所有这些加在一起,才是模型真正"看到"的东西。

大语言模型是 CPU,上下文窗口是内存,而你是操作系统。你决定每个任务加载什么到内存里。——Andrej Karpathy

这个比喻非常精准。大多数人用 AI 的方式,相当于每次开机都从零启动,不装驱动,不加载配置文件,然后抱怨电脑不好用。你每天花三十秒输入"我是做市场营销的,帮我写个方案"——这三十秒,乘以一年三百六十五天,就是差不多两个小时的重复劳动。更关键的是,冷启动的 AI 输出质量和有上下文的 AI 输出质量,根本不是一个量级。

Nav Toor 这篇文章的价值在于:他不是在教你"怎么写更好的提示词",而是在教你怎么搭建一个让 AI 自动变聪明的系统。一次搭建,长期受益。

上下文工程的核心:你不是在"写提示词",而是在为 AI 组装操作环境

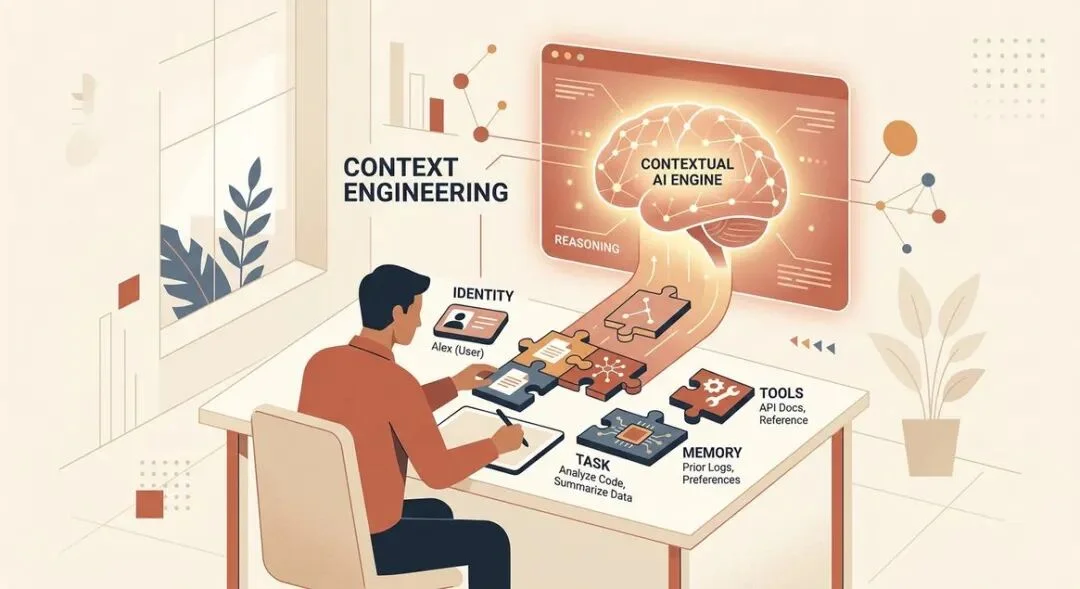

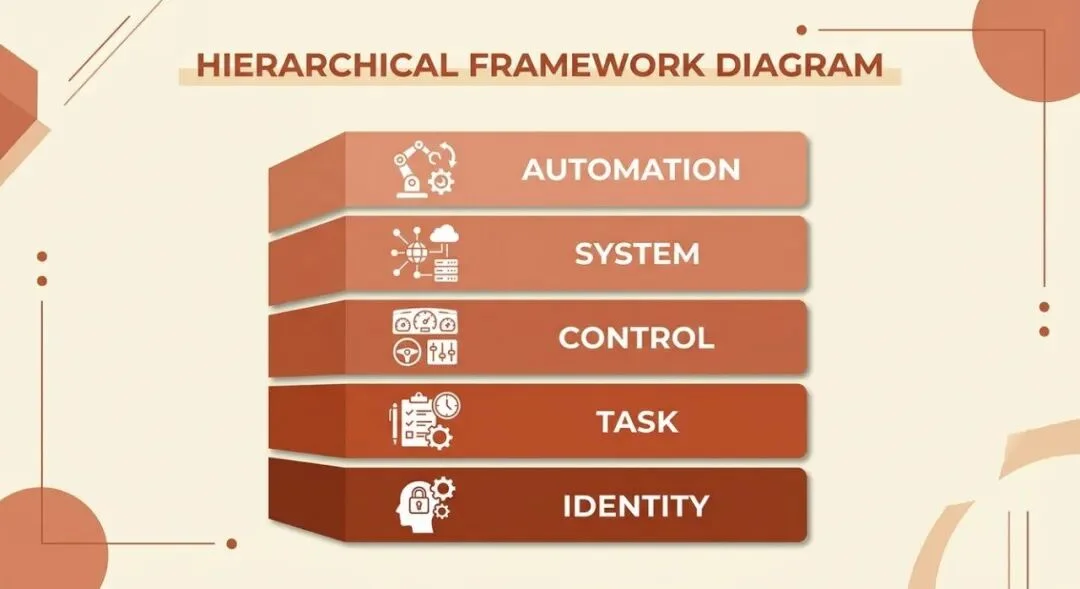

02 五层架构

Nav Toor 把 15 个模板分成了五层,从底到顶依次是:

第一层 · 身份层(模板 1-3)——AI 知道你是谁

第二层 · 任务层(模板 4-6)——AI 知道你现在要什么

第三层 · 控制层(模板 7-9)——AI 不跑偏

第四层 · 系统层(模板 10-12)——从对话变成工作流

第五层 · 自动化层(模板 13-15)——让系统自己跑

层层叠加。底层设一次,长期生效;顶层按需调用,越用越顺。

上下文工程的五层体系:从身份到自动化,逐级构建

03 身份层:一劳永逸

这一层解决的是冷启动问题——每次打开新对话,AI 对你一无所知。

模板 1:个人上下文文件。告诉 AI 你是谁、做什么、给谁写东西、沟通风格是什么。把这段话存进 ChatGPT 的记忆、Claude 的自定义指令、或者 Gemini 的 Gems 里。一次设置,每次对话自动生效。

Anthropic 的工程团队自己说过:系统指令是控制 Claude 行为最重要的一个杠杆。这就是那个杠杆。

模板 2:品牌声音文件。核心技巧是粘贴两段你自己写过的真实文字。AI 会直接模式匹配你的写作风格,比你用一千个字描述"我的语气是简洁有力的"效果好得多。同时列出你讨厌的词——"leverage""utilize""delve"——AI 就再也不会用了。

我自己就是这么做的。我在 Claude 的项目指令里贴了几段自己写过的公众号文章,从此它再也没给我写过那种"让我们来深入探讨一下……"的开头。这一招对中文写作尤其有效——因为 AI 默认的中文语感往往偏书面、偏八股,但如果你给它看你真实的写作样本,它会迅速校准到你的风格。两段文字就够了,比写十条规则管用。

模板 3:工作规则文件。这里有一句话我非常认同:你对 AI 输出的每一个抱怨,都是一条你还没写下来的规则。

比如"先问我再动手""给建议时先说推荐项""不要用占位符""说不知道比瞎编好""默认输出 300-500 字""我说'短一点'就砍 40%"。把抱怨变成约束,写一次,错误永远不再出现。

这三个模板的共同特点是:设一次,管一辈子。你不需要每次对话都重复告诉 AI 你是谁、你喜欢什么风格、你讨厌什么行为。把它们存进系统指令,从此每一次对话都自动带着这些上下文启动。这就像给你的操作系统装好了所有驱动程序。

04 任务层:结构化提问

身份层是长期设置,任务层是每次使用时的即时指令。这一层把模糊请求变成结构化指令。三个模板,覆盖三个最常见场景:调研、写作、决策。

你可能觉得"我就是随便问一下"不需要这么正式。但试一次就知道区别了。同样是让 AI 帮你调研竞品,"帮我看看 Notion 和 Coda 哪个好"和一个写明了评估维度、受众、输出格式的结构化简报,得到的结果完全是两回事。前者给你五百字的泛泛之谈,后者给你一份可以直接拿去开会的对比分析。

模板 4:研究简报。关键一行是"不要写我已经知道的背景知识"。大多数 AI 研究回答的前三分之一全是废话——你问某个行业趋势,它先给你科普这个行业是什么。一句话干掉这三分之一。

模板 5:写作简报。这里面最被低估的一个字段是"不要写什么"(Key points to exclude)。大多数人只告诉 AI 写什么。上下文工程师还会告诉它不写什么。约束产生聚焦,聚焦产生质量。

模板 6:决策框架。里面有一句神来之笔:"不要中立。给出你的立场。"

没有这句话,AI 默认给你"各有利弊"的废话总结。有了这句话,你得到一个明确建议——你可以反驳它,但一个可以反驳的建议,比一篇谁也不得罪的报告有用一百倍。

我测试过:同样的决策场景,加不加这句话,输出差别巨大。不加的话你得到四段平衡论述,看完还是不知道该选哪个。加了之后,AI 会说"我推荐方案 B,原因有三",然后列出反对方案 B 的最强论据让你自己判断。这才是真正有用的决策辅助。

左:随意提问 = 混乱输出。右:结构化上下文 = 高效结果

05 控制层:防跑偏

这一层解决 AI 使用中最让人崩溃的问题:模型忘了、跑偏了、开始编数据了。

模板 7:会话启动器。每次复杂任务开始前,先把项目背景、当前进度、上次成果、本次目标、参考文件、约束条件全部加载进去。这就是所谓的上下文预加载——在模型生成第一个 token 之前,把它需要的一切都塞进窗口。

模板 8:反幻觉护栏。核心是引入 [待验证] 标签机制。不是祈祷 AI 不编数据,而是给它一个明确的出口:不确定就标注。Anthropic 自己的文档也推荐这种方法——当模型被允许表达不确定性时,它编造数据的概率会大幅降低。

这是我个人最推荐的一个模板。我现在写任何涉及数据引用的内容,都会加上这条规则。效果立竿见影——加了之后,AI 会在不确定的数据旁边老老实实标上 [待验证],而不是像以前那样自信满满地给你编一个精确到小数点后两位的假数字。

模板 9:上下文重置。长对话会产生研究者所说的"上下文腐蚀"——模型的注意力漂移到最近的消息上,把最初的指令忘了。Claude Code 在上下文窗口达到 95% 时会自动触发"压缩",把所有内容总结一遍保持聚焦。这个模板让你在任何 AI 工具里手动做同样的事。

一次干净的重置,胜过十条纠正消息。

说到这里,你可能已经发现了这三个模板的共同逻辑:它们都是在主动管理 AI 的注意力。会话启动器告诉 AI 该看什么,反幻觉护栏告诉 AI 不确定的时候怎么办,上下文重置告诉 AI 忘掉不该记的。人类管理团队也是这三步:给任务、设边界、纠偏。管理 AI 和管理人,底层逻辑是一样的。

06 系统层:从聊天到工作流

这一层把 AI 从聊天工具变成工程工具。

模板 10:项目规则文件(CLAUDE.md)。如果你用 Claude Code、Cursor 或者任何 AI 编程工具,这个文件就是核心。项目用什么语言、什么框架、什么数据库、代码规范是什么、常见错误有哪些——全写在一个文件里。每次会话开始时自动加载,每条规则自动应用。

这就是上下文工程在开发者领域的最佳实践:同一个纠正永远不需要说第二遍。把纠正编码进规则文件,它就变成了永久生效的约束。

模板 11:多步骤任务规划器。核心指令是"不要立即开始执行"。AI 最大的失败模式就是急于输出——你给它一个复杂任务,它直接冲上去写,写完才发现方向全错了。强制它先制定计划、等你批准、再逐步执行,质量会有质的飞跃。

这本质上是"规划-执行-验证"循环——先想清楚要做什么,做完一步确认一步,每步验证后再进入下一步。所有成熟的 AI 智能体工作流都是这样设计的。你不会让一个实习生拿到需求就直接写代码,你会让他先拉个方案评审。管理 AI 也是一样的道理。

模板 12:自我评估循环。让 AI 在给你看输出之前,先用一组标准自检一遍:是否完整回答了需求?有没有未验证的事实?语气对不对?有没有废话?如果任何一项不通过,修改后再呈现。

Anthropic 把这种模式叫做"思维链自我验证"。一个模板就能把你的编辑时间砍掉一半——因为你看到的不再是初稿,而是 AI 自己改过一遍的二稿。

这三个模板的共性是什么?它们把 AI 从"聊天对象"升级成了"工程系统"。聊天是一问一答,系统是有规范、有流程、有质检的。用了这三个模板,你的 AI 就有了代码规范(CLAUDE.md)、项目管理(任务规划器)和 QA 流程(自我评估)。一个完整的软件工程体系。

07 自动化层:让系统自己跑

最后三个模板,是整个体系中最有"复利"属性的部分——它们把一次性对话变成可复用的系统,而且会随着使用越变越好。

模板 13:周报系统。一个固定模板,每周一运行:优先行动项、会议准备、未完成跟进、行业阅读。AI 从你连接的工具(日历、邮件、网络)里拉取信息,组装出一份你手动编辑需要 30 分钟的简报。

模板 14:会议笔记处理器。把混乱的会议记录压缩成五个结构:已决定的事、谁做什么(截止时间)、未解决的问题、重要原话、下一步。关键细节是加入了 [不清楚] 标签——和反幻觉护栏同样的逻辑,不确定就标注,不要猜。

模板 15:技能构建器。这是整套体系中最"元"的一个——用 AI 来构建你自己的上下文模板。每完成一个任务,问 AI:什么做得好、什么需要手动修改、下次怎么改进?然后让它生成一个可保存、可复用的指令模板。

用几周时间积累模板,你的整个工作流就被编码进了可复用文件里。系统变聪明了,但模型本身没有变。这才是重点。

这让我想到一个类比:你不需要等英特尔出更快的 CPU 才能让电脑变快。你可以先把操作系统优化好、把常用软件配置好、把工作流自动化——同一块芯片上,体验可以完全不同。上下文工程做的就是这件事:在同一个模型上,通过优化"软件层"来提升"硬件"的表现。

08 怎么叠加使用

这 15 个模板不是菜单,是积木。

Nav Toor 给了一个极简组合示例:模板 1 + 模板 5 + 模板 12。三个模板叠加之后,AI 知道你是谁、清楚你要什么、交稿前还会自查。三段文字,十秒加载,审阅时间从二十分钟降到两分钟。

用他的话说:复制一个模板的人,明天就能看到效果。构建完整五层体系的人,一整年都在收获复利。

这就是上下文工程和提示词工程最根本的区别:提示词是一次性的,用完就丢;上下文是可叠加的,越用越厚。你今天写的个人上下文文件,明年还在为你工作。你今天积累的一个任务模板,下个月还在为你省时间。

09 对我们意味着什么

这篇文章让我想到一件事:我们一直在等更强的模型,但真正的瓶颈可能不是模型,而是我们加载给模型的上下文。

同一个 Claude 或 GPT,给它不同的上下文,输出质量可以差十倍。这不是夸张——试过的人都知道。

当然了,这 15 个模板不需要一次全用上。Nav Toor 自己也说了:从一个模板开始,感受到差异,再逐步叠加。我建议的起点是模板 1(个人上下文)+ 模板 8(反幻觉护栏)——两个最高投入产出比的模板,五分钟搞定,立刻见效。

几个关键点:

1. 身份层是投入产出比最高的一层。花十分钟写好个人上下文文件,之后每一次对话都在享受这十分钟的红利。大多数人用了一年 AI 都没设过这个。

2. "不要写什么"比"写什么"更重要。限制什么不该出现——禁用词、排除主题、不要中立——这些"负面指令"的威力被严重低估了。

3. 把抱怨变成规则。每次 AI 输出让你皱眉的内容,别只是叹气和手动修改。写下来,变成一条规则,加进你的工作规则文件。这样同一个错误永远只会出现一次。

4. 上下文工程的终极目标是让系统越用越好,而不是让模型越来越强。模板 15 的"技能构建器"是整个体系的飞轮——每完成一个任务就生成一个更好的模板,你的 AI 使用效率就会持续复利增长。

上下文工程不是写更好的提示词。是构建更好的系统。

说到底,AI 工具之间的竞争已经不是模型能力的竞争了。GPT-4、Claude、Gemini 在大多数日常任务上的差距没有你想象的那么大。真正拉开差距的,是使用者怎么组装上下文。同样是写一篇营销方案,一个人花两分钟搭好上下文框架,另一个人随手丢一句话——他们用的可能是同一个模型,但得到的结果天差地别。

模板都在这了。系统也解释清楚了。剩下的就是动手。我自己已经开始用了。

相关链接:

• 原文:Nav Toor (@heynavtoor), X Article

• 链接:https://x.com/heynavtoor/status/2041572825698615583

文章来自于"深思SenseAI",作者 "SenseAI"。