【Linux】深入理解 Linux 内核:进程调度与并发控制底层原理

引言

在操作系统的核心功能中,进程调度与并发控制如同“内核的大脑与神经”——前者决定了系统资源如何在多任务间高效分配,后者则保障了多核环境下数据访问的一致性与安全性。Linux 作为开源操作系统的典范,其内核在进程调度与并发控制的设计上,既兼顾了理论严谨性,又融入了工程实践中的权衡取舍。本文将从技术演进背景出发,结合内核源码片段与数据结构,系统性解析这两大核心机制的底层原理,并对比其他操作系统的设计思路,帮助读者建立完整的技术认知。

目录

一、进程调度:从“公平”到“智能”的演进与核心机制

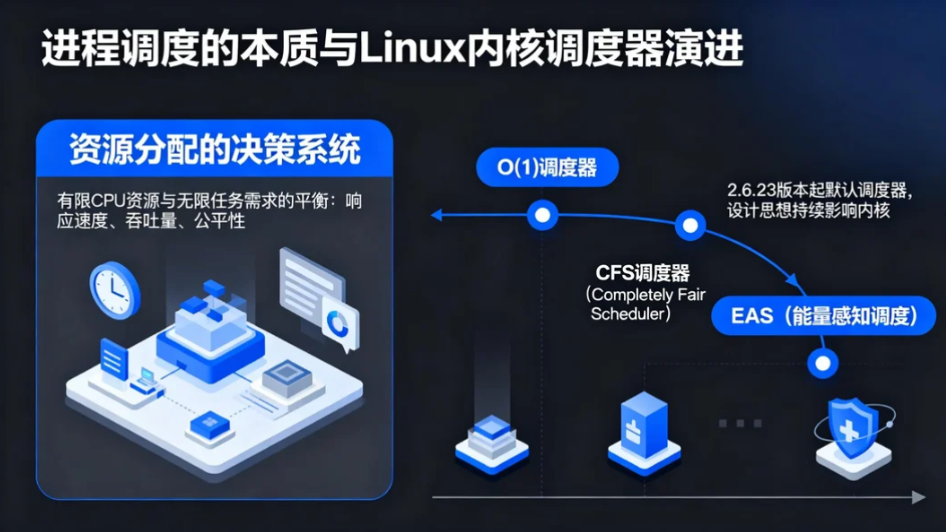

进程调度的本质是“资源分配的决策系统”——在有限的 CPU 资源与无限的任务需求之间,找到兼顾响应速度、吞吐量、公平性的平衡点。Linux 内核的调度器历经了 O(1) 调度器、CFS 调度器、EAS(能量感知调度)等多代演进,其中 CFS 调度器(Completely Fair Scheduler) 自 2.6.23 版本起成为默认调度器,其设计思想至今仍影响着内核的调度逻辑。

1.1 调度器演进背景:为何 CFS 能取代 O(1) 调度器?

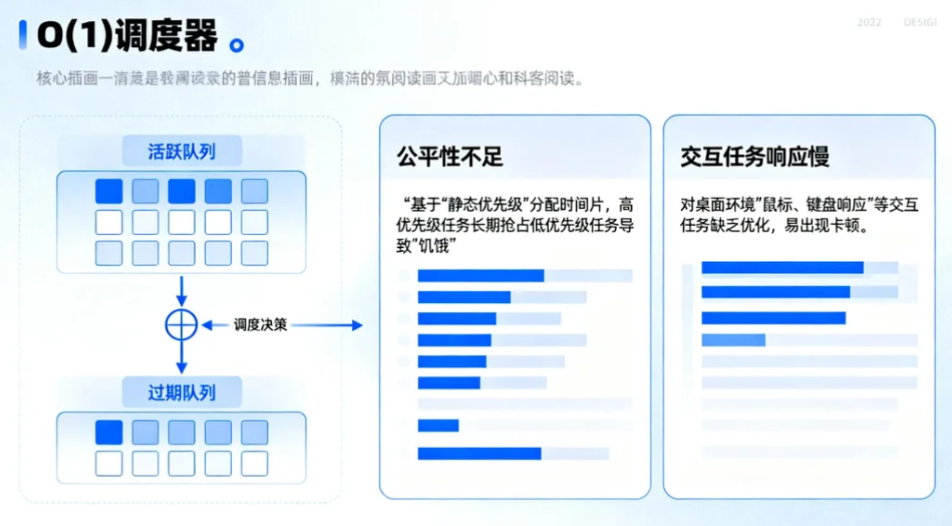

在 CFS 出现之前,Linux 采用的是 O(1) 调度器——通过“活跃队列”与“过期队列”的双队列设计,实现了调度决策的常数时间复杂度。但 O(1) 调度器存在两个核心缺陷:

- 公平性不足:基于“静态优先级”分配时间片,高优先级任务可能长期抢占低优先级任务,导致低优先级任务“饥饿”;

- 交互任务响应慢:对桌面环境中的交互任务(如鼠标、键盘响应)缺乏针对性优化,容易出现卡顿。

为解决这些问题,CFS 调度器提出了 “公平调度” 的核心理念:让每个进程“获得 CPU 资源的时间与权重成正比”,即权重越高的进程,获得的 CPU 时间越多,同时通过“虚拟运行时间”避免任务饥饿。

1.2 CFS 调度器的核心设计:数据结构与调度逻辑

CFS 调度器的实现依赖两个关键数据结构:task_struct(进程描述符) 与 rq(运行队列),以及“虚拟运行时间”的计算模型。

(1)核心数据结构:task_struct 与 rq 的关联

每个进程在 Linux 内核中都对应一个 task_struct 结构体,其中与调度相关的字段直接决定了进程的调度行为:

struct task_struct {

// 进程优先级:static_prio(静态优先级)、prio(动态优先级)

int static_prio;

int prio;

// 调度类:决定进程使用的调度器(如 CFS、实时调度器)

const struct sched_class *sched_class;

// CFS 专属数据:记录虚拟运行时间、权重等

struct sched_entity se;

// 进程状态:TASK_RUNNING、TASK_SLEEPING 等

volatile long state;

// ... 其他字段(内存、文件、信号等)

};

而 rq(运行队列,runqueue) 则是每个 CPU 核心独有的“任务队列”,负责管理该 CPU 上待运行的进程。rq 中与 CFS 相关的核心字段如下:

struct rq {

// CFS 运行队列:存储待调度的 sched_entity(进程的调度实体)

struct cfs_rq cfs;

// 实时进程运行队列:优先级高于 CFS

struct rt_rq rt;

// 当前运行的进程

struct task_struct *curr;

// CPU 编号

int cpu;

// ... 其他字段

};

关键逻辑:每个 CPU 核心对应一个 rq,rq 内部又分为 CFS 队列(普通进程)与实时队列(RT 进程)。调度器首先检查实时队列,若有实时进程则优先调度;若无,则调度 CFS 队列中的进程——这体现了 Linux“实时任务优先”的调度策略。

(2)公平性的实现:虚拟运行时间与红黑树

CFS 调度器通过 “虚拟运行时间(virtual runtime, vruntime)” 衡量进程的“CPU 使用量”,其核心公式为:

vruntime = 实际运行时间 × (NICE_0_LOAD / 进程权重)

NICE_0_LOAD是默认权重(通常为 1024),对应 nice 值为 0 的进程;- 进程权重与 nice 值负相关:nice 值越小(优先级越高),权重越大,vruntime 增长越慢——意味着该进程能获得更多 CPU 时间。

为快速找到“vruntime 最小”的进程(即最需要 CPU 的进程),CFS 采用 红黑树(red-black tree) 存储 sched_entity(进程的调度实体),树的键值即为 vruntime。调度时,内核只需取出红黑树的最左节点(vruntime 最小),即可完成调度决策,时间复杂度为 O(log n)。

伪代码逻辑:

// CFS 调度器的核心调度函数

function __schedule():

// 1. 获取当前 CPU 的运行队列 rq

rq = this_cpu_ptr(&runqueues);

// 2. 从 CFS 红黑树中找到 vruntime 最小的进程

next_se = cfs_rq_select_next(rq->cfs);

next_task = container_of(next_se, task_struct, se);

// 3. 切换进程上下文

context_switch(rq, rq->curr, next_task);

// 4. 更新当前运行进程

rq->curr = next_task;

(3)调度类:Linux 调度器的“插件化”设计

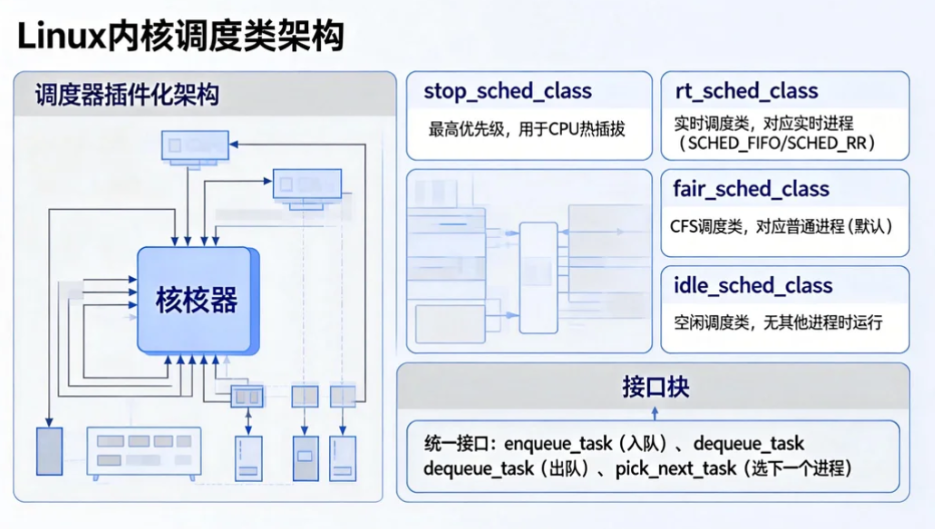

Linux 内核通过 调度类(sched_class) 实现了“插件化”的调度器架构,不同类型的进程(普通进程、实时进程、空闲进程)可对应不同的调度类。每个调度类需实现一组统一的接口(如 enqueue_task 入队、dequeue_task 出队、pick_next_task 选下一个进程),内核通过调用这些接口完成调度。

常见的调度类优先级从高到低为:

stop_sched_class:最高优先级,用于停止 CPU 运行(如 CPU 热插拔);rt_sched_class:实时调度类,用于实时进程(采用 SCHED_FIFO/SCHED_RR 策略);fair_sched_class:CFS 调度类,用于普通进程(默认调度类);idle_sched_class:空闲调度类,仅当无其他进程时运行。

源码片段:调度类的接口定义

struct sched_class {

// 选下一个要调度的进程

struct task_struct *(*pick_next_task)(struct rq *rq, struct task_struct *prev);

// 将进程加入运行队列

void (*enqueue_task)(struct rq *rq, struct task_struct *p, int flags);

// 将进程移出运行队列

void (*dequeue_task)(struct rq *rq, struct task_struct *p, int flags);

// ... 其他接口(如任务唤醒、时间片更新)

};

// CFS 调度类的实例

const struct sched_class fair_sched_class = {

.pick_next_task = fair_sched_class_pick_next,

.enqueue_task = enqueue_task_fair,

.dequeue_task = dequeue_task_fair,

// …

};

1.3 多核环境的调度挑战:负载均衡与CPU亲和性

在多核 CPU 环境下,进程调度面临的核心挑战是 “如何让任务在多个 CPU 间均匀分配”——若某 CPU 负载过高(进程过多),而其他 CPU 空闲,会导致系统整体吞吐量下降。Linux 内核通过 负载均衡(load balancing) 机制解决这一问题。

(1)负载均衡的核心逻辑

负载均衡由内核的 周期性软中断(SCHED_SOFTIRQ) 触发,核心步骤为:

- 检测不均衡:计算每个 CPU 的“负载值”(基于进程权重总和),判断是否存在负载差异超过阈值的 CPU;

- 选择迁移任务:从负载高的 CPU 的 rq 中,选择“最适合迁移”的进程(如 nice 值较高、迁移成本低的进程);

- 迁移任务:将选中的进程从源 CPU 的 rq 移至目标 CPU 的 rq,并更新进程的 CPU 亲和性。

(2)CPU 亲和性:限制进程的 CPU 运行范围

为减少进程在 CPU 间迁移带来的“缓存失效”开销(进程迁移后,原 CPU 缓存中的数据无法复用),Linux 支持 CPU 亲和性(CPU affinity)——通过 sched_setaffinity 系统调用,限制进程只能在指定的 CPU 核心上运行。

例如,数据库进程可绑定到某几个 CPU 核心,避免频繁迁移导致的缓存命中率下降,从而提升性能。

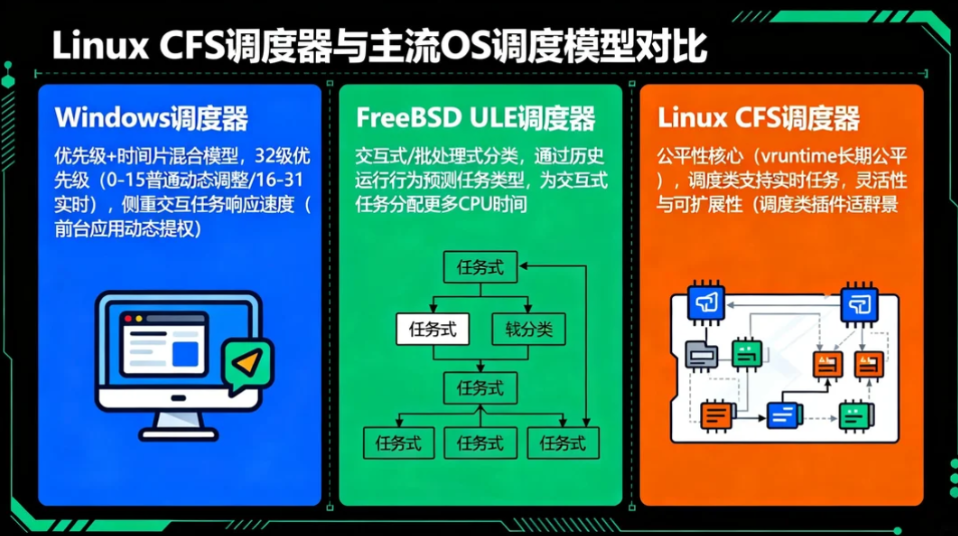

1.4 与其他操作系统的调度模型对比

Linux 的 CFS 调度器与其他主流操作系统(如 Windows、FreeBSD)的调度模型相比,存在明显的设计差异:

- Windows 调度器:基于“优先级+时间片”的混合模型,优先级分为 32 级(0-31),其中 0-15 为普通优先级(动态调整),16-31 为实时优先级。Windows 更侧重“交互任务响应速度”,会为前台应用(如浏览器、编辑器)动态提升优先级;

- FreeBSD 调度器:采用“ULE 调度器”,分为“交互式”与“批处理式”两类任务,通过“历史运行行为”预测任务类型,为交互式任务分配更多 CPU 时间;

- Linux CFS 调度器:以“公平性”为核心,通过 vruntime 确保长期公平,同时通过“调度类”支持实时任务。其优势在于“灵活性与可扩展性”——可通过调度类插件适配不同场景(如服务器、嵌入式、桌面),而无需修改核心逻辑。

设计取舍:Linux 选择“公平性优先”而非“绝对响应速度”,是因为其目标场景覆盖服务器(多任务长期运行,需避免饥饿)、嵌入式(资源有限,需公平分配)、桌面(兼顾交互与后台任务),而“公平性”是所有场景的共同需求。

二、并发控制:多核环境下的数据一致性保障

随着 CPU 核心数的增加,“并发访问共享数据”成为内核开发的核心挑战——若多个 CPU 同时修改同一数据(如 rq 中的进程队列、内存管理中的页表),会导致“数据竞争”,引发系统崩溃或数据损坏。Linux 内核提供了多种并发控制技术,每种技术都对应不同的应用场景,核心是在“性能”与“安全性”之间找到平衡。

2.1 并发控制的核心需求:临界区与原子操作

在解析具体技术前,需明确两个基础概念:

- 临界区(Critical Section):访问共享数据的代码片段,同一时间只能有一个执行流进入;

- 原子操作(Atomic Operation):不可中断的操作(如“读取-修改-写入”三步合一),确保在多核环境下不会被其他 CPU 打断。

Linux 内核提供了 atomic_t 类型(32 位整数)及相关接口(如 atomic_inc 自增、atomic_dec_and_test 自减并判断是否为 0),用于实现简单的共享变量并发控制。例如,进程计数器的更新必须通过原子操作:

// 原子操作示例:进程计数器自增

atomic_t process_count = ATOMIC_INIT(0);

void create_process() {

// 原子自增:确保多核环境下计数准确

atomic_inc(&process_count);

// … 创建进程的其他逻辑

}

2.2 自旋锁(Spinlock):短临界区的高效同步

(1)设计思想:“忙等”而非“睡眠”

自旋锁是 Linux 内核中最常用的并发控制手段,其核心逻辑是:若锁已被占用,当前 CPU 会“循环等待(忙等)”,直到锁被释放。这种设计的优势是 “无上下文切换开销”——适合临界区代码极短(如几行代码)的场景,若临界区过长,“忙等”会浪费 CPU 资源。

(2)源码与使用场景

自旋锁的核心数据结构是 spinlock_t,常用接口包括 spin_lock(加锁)、spin_unlock(解锁):

// 定义并初始化自旋锁

spinlock_t rq_lock = __SPIN_LOCK_UNLOCKED(rq_lock);

void modify_rq(struct rq *rq) {

// 加锁:若锁已被占用,当前 CPU 忙等

spin_lock(&rq_lock);

// 临界区:修改 rq 中的共享数据(如进程队列)

rq->nr_running++;

// 解锁

spin_unlock(&rq_lock);

}

使用场景:多核环境下的短临界区,如调度器中的 rq 操作、内存管理中的页表更新。注意:自旋锁不能在中断上下文使用(会导致死锁——若中断服务程序也申请同一把锁,当前 CPU 忙等时无法响应中断,锁永远无法释放),此时需使用 spin_lock_irqsave(加锁前禁用中断)。

2.3 信号量(Semaphore):长临界区的睡眠同步

(1)设计思想:“睡眠”而非“忙等”

与自旋锁的“忙等”不同,信号量采用“睡眠等待”策略:若信号量的可用资源数为 0,当前进程会被放入等待队列,进入睡眠状态(释放 CPU),直到其他进程释放信号量并唤醒它。这种设计适合 临界区较长(如文件读写、设备驱动中的 I/O 操作)的场景,避免“忙等”浪费 CPU 资源。

(2)类型与使用示例

Linux 内核中的信号量分为两类:

- 计数信号量(struct semaphore):允许多个进程同时进入临界区(资源数 > 1);

- 互斥信号量(struct mutex):仅允许一个进程进入临界区(资源数 = 1),是信号量的特殊情况,也是最常用的类型。

互斥信号量使用示例:

// 定义并初始化互斥信号量

struct mutex file_mutex;

mutex_init(&file_mutex);

void write_file(const char *data) {

// 加锁:若已被占用,当前进程睡眠

mutex_lock(&file_mutex);

// 临界区:长耗时的文件写入操作

file_write(data);

// 解锁:唤醒等待队列中的进程

mutex_unlock(&file_mutex);

}

与自旋锁的对比:

| 特性 | 自旋锁(Spinlock) | 互斥信号量(Mutex) |

|---|---|---|

| 等待策略 | 忙等 | 睡眠 |

| 上下文切换开销 | 无 | 有(睡眠/唤醒) |

| 临界区长度 | 短( 行代码) | 长(> 100 行代码) |

| 适用场景 | 多核、无睡眠操作 | 多核/单核、有睡眠操作 |

2.4 读写锁(Read-Write Lock):读写分离的优化

(1)设计背景:“读多写少”场景的性能瓶颈

在“读多写少”的场景(如内核中的配置数据、文件系统的inode缓存),若使用互斥信号量,会导致多个读进程排队等待——即使读操作不会修改数据,也无法并发执行。读写锁通过“读写分离”解决这一问题:

- 读锁(共享锁):多个进程可同时持有,仅禁止写操作;

- 写锁(排他锁):仅允许一个进程持有,禁止其他读锁和写锁。

(2)使用示例与性能优势

Linux 内核中的读写锁分为 rwlock_t(通用)和 seqlock_t(更轻量,适合频繁读、极少写的场景),以下是 rwlock_t 的使用示例:

// 定义并初始化读写锁

rwlock_t config_rwlock = __RW_LOCK_UNLOCKED(config_rwlock);

struct config_data g_config; // 共享配置数据

// 读操作:获取读锁,允许多进程并发读

void read_config(struct config_data *out) {

read_lock(&config_rwlock);

*out = g_config; // 读操作,无数据修改

read_unlock(&config_rwlock);

}

// 写操作:获取写锁,独占访问

void write_config(const struct config_data *in) {

write_lock(&config_rwlock);

g_config = *in; // 写操作,修改数据

write_unlock(&config_rwlock);

}

性能优势:在 100 个读进程、1 个写进程的场景下,读写锁的吞吐量是互斥信号量的 50-100 倍——因为读进程无需排队,可并发执行。

2.5 RCU 机制:极致读性能的“无锁”同步

(1)设计突破:“读无锁,写等待”

RCU(Read-Copy-Update,读-复制-更新)是 Linux 内核中最具创新性的并发控制技术,其核心思想是:

- 读操作:无需加锁,直接访问共享数据,完全无阻塞;

- 写操作:先复制一份共享数据的副本,在副本上修改,然后原子替换原数据,最后等待所有读进程“离开旧数据”后,释放旧数据的内存。

RCU 专为“读操作极致频繁、写操作极少”的场景设计(如内核中的路由表、进程链表),其读性能远超读写锁——因为读操作无需任何同步开销。

(2)核心步骤与源码示例

RCU 的使用需遵循“读端”与“写端”的规范:

- 读端:通过

rcu_read_lock()和rcu_read_unlock()标记读临界区,确保读期间旧数据不被释放; - 写端:通过

rcu_assign_pointer()原子替换数据,通过synchronize_rcu()等待旧数据的读进程完成。

源码示例:RCU 保护进程链表

// 共享链表:存储进程 ID(读多写少)

struct task_node {

pid_t pid;

struct list_head list;

};

struct list_head task_list;

DEFINE_SPINLOCK(task_list_lock); // 写操作加自旋锁

// 读端:无锁访问链表

void print_all_pids() {

struct task_node *node;

// 标记 RCU 读临界区

rcu_read_lock();

// 遍历链表:使用 rcu_dereference 确保数据可见性

list_for_each_entry_rcu(node, &task_list, list) {

printk("PID: %d\n", node->pid);

}

// 结束读临界区

rcu_read_unlock();

}

// 写端:添加节点(复制-更新-释放)

void add_task(pid_t pid) {

struct task_node *new_node = kmalloc(sizeof(*new_node), GFP_KERNEL);

new_node->pid = pid;

// 1. 加自旋锁:确保写操作互斥

spin_lock(&task_list_lock);

// 2. 复制并修改:将新节点加入链表副本(此处简化为直接加入原链表)

list_add_tail_rcu(&new_node->list, &task_list);

// 3. 原子替换:此处链表是整体,无需显式替换(若为指针则用 rcu_assign_pointer)

spin_unlock(&task_list_lock);

}

// 写端:删除节点

void del_task(pid_t pid) {

struct task_node *node;

spin_lock(&task_list_lock);

// 1. 找到要删除的节点

list_for_each_entry_rcu(node, &task_list, list) {

if (node->pid == pid) {

// 2. 原子移除:从链表中移除节点(不立即释放内存)

list_del_rcu(&node->list);

spin_unlock(&task_list_lock);

// 3. 等待旧数据的读进程完成:synchronize_rcu 会阻塞直到所有读临界区结束

synchronize_rcu();

// 4. 释放旧数据内存

kfree(node);

return;

}

}

spin_unlock(&task_list_lock);

}

关键机制:synchronize_rcu() 的实现依赖内核的“ grace period(宽限期)”——内核会等待所有 CPU 都完成一次“上下文切换”(如进程调度、中断处理),确保没有 CPU 仍在访问旧数据,此时释放旧数据才安全。

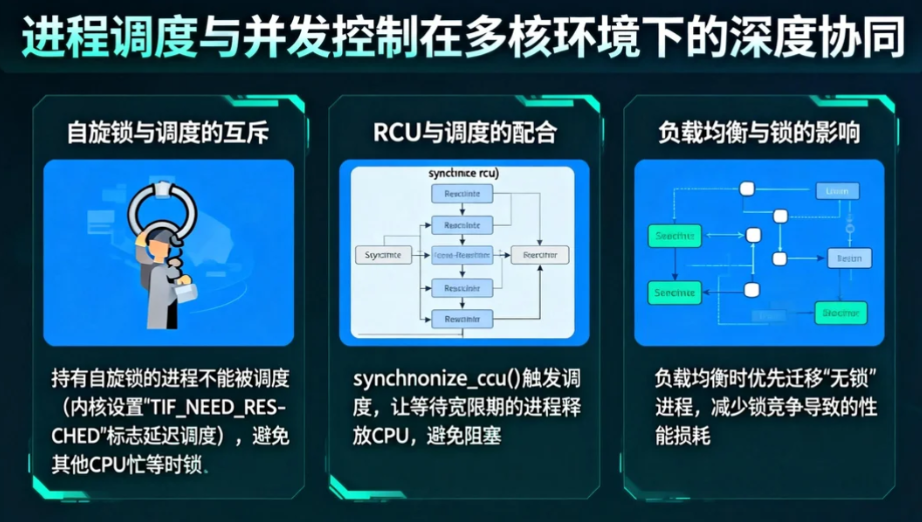

2.6 多核环境下的协同设计:调度与同步的联动

进程调度与并发控制并非孤立存在,而是在多核环境下深度协同:

- 自旋锁与调度的互斥:持有自旋锁的进程不能被调度(内核会设置

TIF_NEED_RESCHED标志,延迟调度),否则会导致其他 CPU 忙等时无法获取锁; - RCU 与调度的配合:

synchronize_rcu()会触发调度,让等待宽限期的进程释放 CPU,避免阻塞; - 负载均衡与锁的影响:负载均衡时,若进程持有锁,会优先选择“无锁”的进程迁移,减少锁竞争导致的性能损耗。

三、总结:Linux 内核设计的核心思想

通过对进程调度与并发控制的深入解析,我们可以提炼出 Linux 内核设计的三大核心思想:

- 权衡取舍(Trade-off):在公平性与响应速度、性能与安全性之间找到平衡点(如 CFS 选择公平性,信号量选择睡眠而非忙等);

- 插件化与可扩展:通过调度类、锁的抽象接口,让内核适配不同场景(如实时任务、嵌入式设备、服务器),无需修改核心逻辑;

- 场景驱动优化:针对“读多写少”“短临界区”“多核负载不均”等具体场景,设计专用技术(如 RCU、自旋锁、负载均衡),而非追求“一刀切”的解决方案。

对于内核开发者而言,理解这些底层原理不仅能帮助解决实际问题(如性能调优、死锁排查),更能培养“从系统全局思考问题”的思维——这正是 Linux 内核设计的精髓所在。