用 ClipSketch 让 AI 像画师一样“一笔一划”创作矢量图

前言:在像素的海洋里,找回矢量的骨架

兄弟们,咱们现在的 AI 绘画圈子有点“营养过剩”了。你打开 Midjourney v7 或者 Flux,随便输个词,出来就是一张光影完美、细节爆炸的 8K 甚至 16K 图像。这很爽,但也很“油腻”。作为一个设计师或者开发者,有时候我们不需要那些乱七八糟的像素堆叠,我们需要的是结构,是线条,是矢量(Vector)。为什么?因为 SVG 矢量图可以无限放大不失真,可以直接拿去激光切割,可以做 Logo,甚至可以导入 CAD。虽然市面上已经有收费的矢量 AI 生成器,但作为一个硬核玩家,把核心技术掌握在自己手里才是正经事。今天我要带大家扒一扒 ClipSketch 这个开源项目。它不是像 Diffusion 那样“去噪点”,而是像一个刚学画画的孩子,在一张白纸上,用 CLIP 老师的指导,一笔一笔地把线条“摆”对位置。这篇教程,我就手把手教大家如何在本地部署这个项目,把你的显卡变成一个“极简主义画师”。

一、 核心逻辑:它凭什么能“画”出线条?

在开始敲代码之前,你得明白它在干什么,否则参数你都不知道怎么调。

传统的 AI(GAN 或 Diffusion)生成的是像素网格。

ClipSketch 生成的是贝塞尔曲线(Bézier Curves)。

它的工作流程是这样的:

- 随机乱画:先在画布上随便扔几条曲线。

- 渲染:把这些曲线渲染成图像。

- CLIP 审视:利用 OpenAI 的 CLIP 模型(那个能看懂图文匹配度的模型)来看这张图,对比你的提示词(比如“一只猫”)。

- 梯度回传:CLIP 告诉曲线,“你画得不像猫,往左边挪挪,弯度大一点”。

- 迭代:重复几百次,直到线条变成猫的样子。

这不仅仅是生成图片,这是在模拟“绘画”这个动作本身。

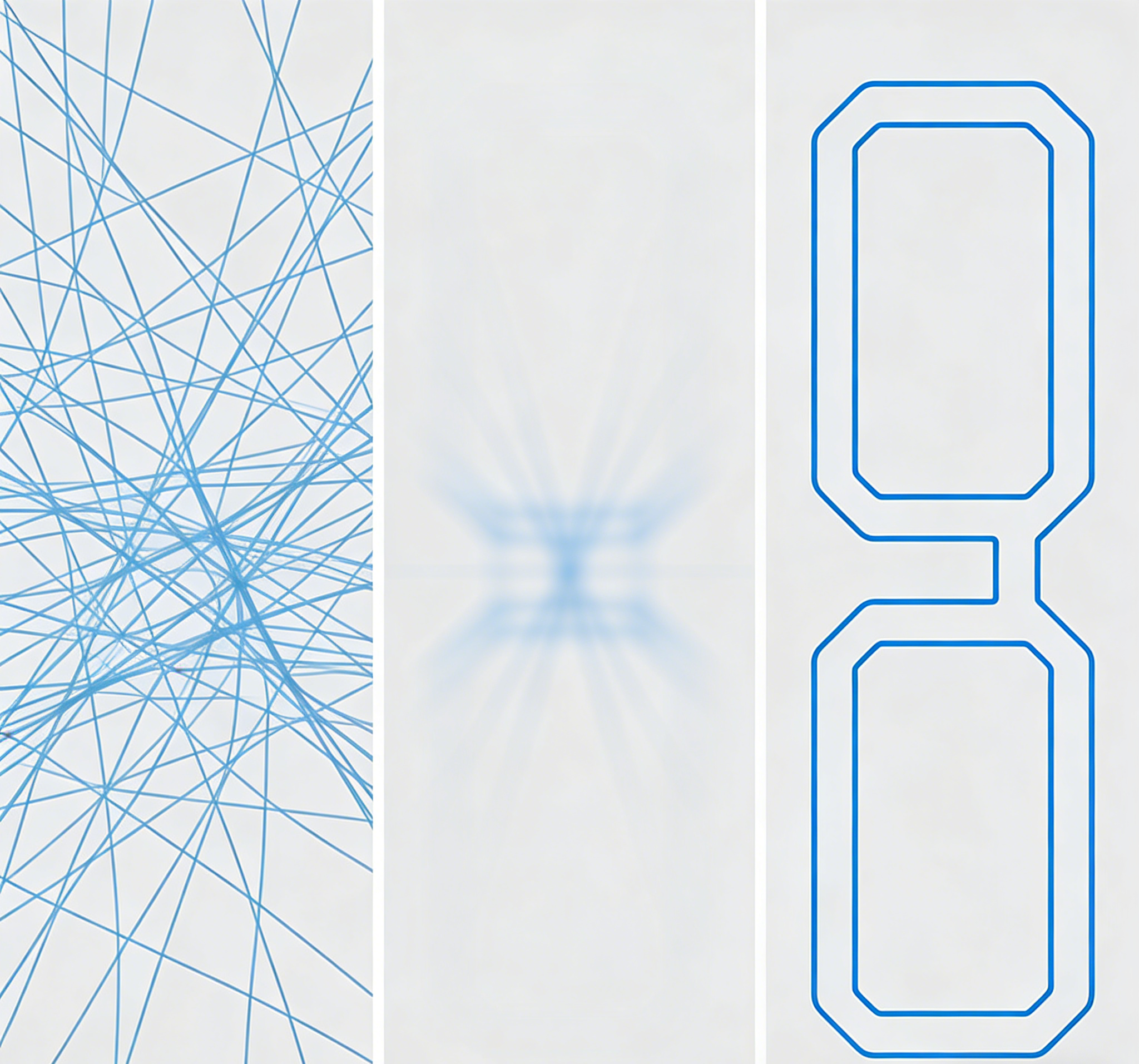

- 图注: “ClipSketch 迭代过程动图”。左边是第 0 帧的乱七八糟的线条,中间是第 50 帧的雏形,右边是第 200 帧成型的简笔画。

- 目的: 直观展示“优化”的过程,让读者理解这不是一步到位的魔法,而是数学的演变。

二、 准备工作:硬核环境搭建

ClipSketch 依赖于可微渲染器,这东西对环境要求比较刁钻。别指望一键安装包,咱们得手动来。

1. 硬件与系统要求

- 系统:强烈推荐 Linux (Ubuntu 20.04/22.04) 或 WSL2 (Windows Subsystem for Linux)。Windows 原生环境配置

pydiffvg会让你怀疑人生。 - 显卡:NVIDIA 显卡,显存 4GB 以上即可(它不吃显存,吃计算速度)。

- 环境:Anaconda / Miniconda。

2. 核心依赖库 (The Tricky Part)

这个项目的核心依赖是 pydiffvg,这是一个可微矢量图形光栅化器。

操作步骤:

-

克隆仓库:

打开终端,找个舒服的目录:git clone https://github.com/RanFeng/clipsketch-ai.git cd clipsketch-ai -

创建虚拟环境:

为了不炸掉你其他的 AI 环境,务必新建一个:conda create -n clipsketch python=3.8 conda activate clipsketch(注:Python 3.8 是最稳的,太高版本可能会有兼容性问题)

-

安装 PyTorch:

去 PyTorch 官网找对应你 CUDA 版本的安装命令。比如 CUDA 11.8:pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu118 -

安装 pydiffvg (最关键的一步):

不要直接 pip install,建议源码编译安装,因为这涉及到 C++ 扩展。git clone https://github.com/BachiLi/diffvg cd diffvg git submodule update --init --recursive python setup.py install cd ..(如果在这一步报错,通常是因为 GCC 版本或者 CMake 没装好,这是劝退 90% 小白的地方,坚持住)

-

安装其他依赖:

pip install clip ftfy regex tqdm scikit-fmm

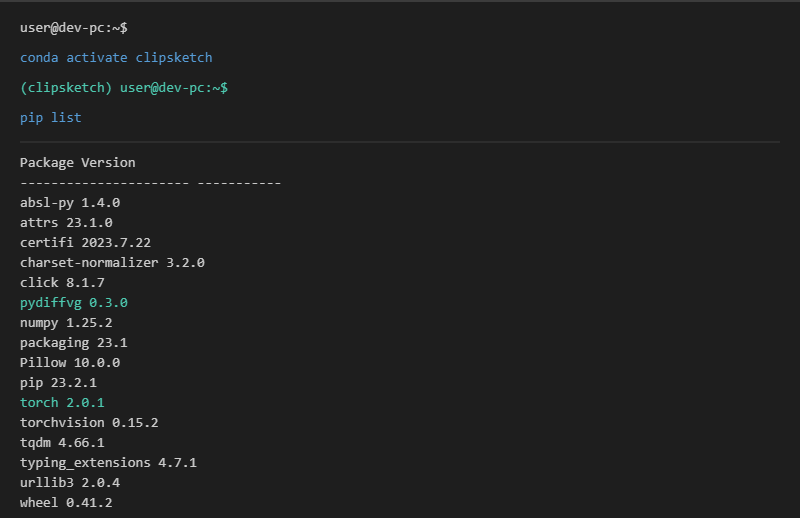

- 图注: 终端命令行界面的截图。展示

conda activate clipsketch激活成功,并且pip list显示pydiffvg和torch都在列表中。- 目的: 确认环境配置成功的标志,给读者安全感。

三、 实操模式 A:Text-to-Sketch (文字生草图)

环境搭好了,现在我们来当“神笔马良”。

1. 基础命令

我们要让 AI 画一朵玫瑰花。

在终端输入:

python main.py --prompt "a sketch of a red rose" --num_paths 32 --num_iter 500 --save_path results/rose.svg

参数详解(敲黑板,重点!):

--prompt:你的咒语。越具体越好,比如加上 “minimalist” (极简) 或 “detailed” (细节)。--num_paths:线条数量。- 设为 16-32:得到的是毕加索风格的抽象画。

- 设为 128-256:得到的是细节丰富的素描。

- 建议新手从 64 开始尝试。

--num_iter:迭代次数。通常 500-1000 次足够收敛。次数太多线条会开始“抖动”。

2. 观察生成过程

程序运行后,你会看到终端里打印出 Loss(损失值)在不断下降。这说明 AI 正在绞尽脑汁地把线条往“玫瑰花”的样子上凑。

最终,在 results 文件夹里,你会得到一个 .svg 文件。

- 图注: “不同线条数量的对比图”。左边是

num_paths=32的玫瑰花(寥寥几笔,意境到位),右边是num_paths=128的玫瑰花(结构复杂,更像插画)。- 目的: 教导读者如何通过参数控制艺术风格。

四、 实操模式 B:Image-to-Sketch (照片转素描)

这是设计师最喜欢的功能。把一张照片扔进去,让 AI 提取出它的“灵魂线条”。

相比于 Photoshop 的边缘检测,ClipSketch 的优势在于它懂**“语义”**。它不会把噪点当成线条,它只会画它认为重要的东西。

1. 准备底图

找一张构图清晰的照片,比如 cat.jpg,放在项目根目录下。

2. 运行命令

python main.py --target_image "cat.jpg" --num_paths 128 --fix_scale 0 --use_lpips 1

关键技术点:

这里我们通常会开启 LPIPS Loss (--use_lpips 1)。

简单说,CLIP 负责看“这是不是猫”,LPIPS 负责看“这线条是不是跟原图像素对齐”。两者结合,才能画出既像猫又跟原图一样的素描。

- 图注: “原图 vs Canny边缘检测 vs ClipSketch生成”的三联对比。Canny 检测图充满了杂乱的噪点;ClipSketch 的图线条流畅,不仅还原了猫的姿态,还带有艺术家的笔触感。

- 目的: 展示 AI 相比传统算法的降维打击优势。

五、 进阶玩法:微调你的“画笔”

如果你觉得生成的图太乱,或者线条太细,可以修改代码里的默认参数(在 main.py 或配置文件中):

- 控制线条粗细 (Stroke Width):

默认可能是随机粗细。你可以强制将线条宽度固定,比如stroke_width = 2.0,这样画出来的图更像简笔 icon。 - 控制透明度 (Opacity):

ClipSketch 默认会生成半透明线条来模拟水彩重叠感。如果你要用来做激光切割或刻字机(Plotter),必须将透明度设为 100%(不透明),否则机器切不出来。 - 负面提示词 (Negative Prompt):

虽然原始代码可能没有显式接口,但你可以在 Prompt 里加上--prompt "a sketch of a cat, no messy lines, clean, vector style"来引导 AI 画得更干净。

六、 总结:矢量的尽头是自由

做完这一切,你得到不是一张死板的 JPG,而是一个数学公式描述的 SVG。

你可以把它:

- 拖进 Illustrator 随意修改锚点。

- 导入 Blender 挤出成 3D 模型。

- 发送给绘图仪(Pen Plotter),用真实的钢笔把它画在纸上。

ClipSketch 这个项目,虽然没有 Midjourney 那么华丽,但它给了我们一种**“掌控感”。在 AI 生成泛滥的今天,这种“少即是多”**的矢量美学,反而成了一股清流。

参考资料与项目链接

- ClipSketch GitHub 原项目: https://github.com/RanFeng/clipsketch-ai

- 注:请务必关注 Issue 区,那里有关于高版本 PyTorch 适配的最新讨论。

- DiffVG (可微渲染器): https://github.com/BachiLi/diffvg

- 这是 ClipSketch 的引擎核心。

- CLIP (OpenAI): https://github.com/openai/CLIP

- 理解图文关系的基石模型。

Tags: #ClipSketch #AI绘画 #矢量艺术 #SVG生成 #GitHub开源 #Python教程 #生成式艺术#