这才是AI圈不敢说的秘密:巨头疯狂烧钱500亿,最后谁来买单?

本文深度剖析这 500 亿背后的战略逻辑,揭示算力军备竞赛的残酷真相,以及制约 AI 发展的物理边界——当电力和芯片成为硬通货,谁能笑到最后?

一、 别再租房了!巨头们为什么要砸钱“买地”盖数据中心?

Anthropic 此次 500 亿美元的投资计划(代号“Project Tiberius”),与其说是扩张,不如说是为了生存。此前,这家公司主要依赖亚马逊 AWS 和谷歌 Cloud 的算力支持。但在 AI 大模型进入万亿参数时代后,“租算力”的模式面临两个致命问题:成本不可控和调度优先级受制于人。

与 Fluidstack 在得克萨斯州和纽约州合作开发定制数据中心,标志着 Anthropic 开始寻求“算力主权”。这不仅仅是买 GPU,而是包括液冷散热系统、专用光纤网络以及核能电力供应的全栈式基建。这与微软/OpenAI 的“星际之门(Stargate)”计划遥相呼应,本质上是科技巨头们在为 AGI(通用人工智能)的诞生修建“产房”。

全球 AI 基础设施军备竞赛概览(2025-2028)

| 核心玩家 | 投资代号/项目 | 预估投资规模 | 核心战略目标 | 关键合作伙伴 |

|---|---|---|---|---|

| Microsoft / OpenAI | Stargate (星际之门) | $1,000 亿 | 打造数百万颗 GPU 互联的超级计算机 | NVIDIA, Azure |

| Meta | Project AGI | $350 亿/年 | 囤积 H100/B200,开源模型 Llama 生态 | Pure Storage, Arista |

| TPU Pods v5/v6 | $480 亿 | 软硬一体化,摆脱对 NVIDIA 依赖 | Broadcom (ASIC设计) | |

| Anthropic | Infrastructure Alpha | $500 亿 | 确保训练 Claude 5/6 所需的独立算力 | Fluidstack, AWS (部分) |

| Amazon AWS | AI Data Centers | $1,500 亿 (15年) | 维持云服务霸主地位,支持自家 Olympus 模型 | Anthropic, NVIDIA |

二、 烧钱容易赚钱难:每年亏几百亿,这生意能做多久?

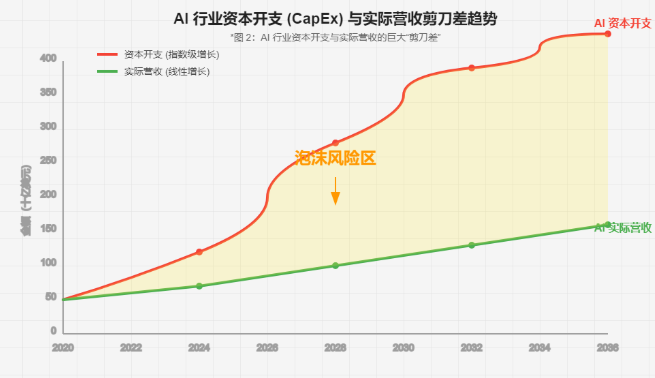

泡沫的本质是资产价格脱离基本面。目前的 AI 行业,正面临严重的投入产出倒挂。

根据红杉资本 David Cahn 的“6000 亿美元问题”分析:为了覆盖当前 AI 基础设施的巨额折旧(GPU 寿命仅 3-4 年)和运营成本,AI 行业每年需要产生 6,000 亿美元 的营收。然而,目前生成式 AI 的实际年收入(Run Rate)即使算上 OpenAI、Midjourney 和 GitHub Copilot,总和甚至不到 1,000 亿美元。

“大空头”Michael Burry 的警告: 科技巨头正在通过延长服务器折旧年限(从 3 年改为 5-6 年)来粉饰财报。这种财务会计游戏掩盖了真实的资本开支压力。一旦 2026 年后算力需求不及预期,或是 Scaling Law 失效,这些数千亿美元的固定资产将瞬间变成“电子垃圾”。

AI 数据中心投入产出(ROI)压力测试

| 财务指标 | 乐观情景 (AGI 突破) | 中性情景 (Copilot 普及) | 悲观情景 (泡沫破裂) |

|---|---|---|---|

| 年折旧费用 | $400 亿 | $400 亿 | $400 亿 |

| 预计年收入 | $1,200 亿 | $600 亿 | $150 亿 |

| 毛利率 | 60% | 40% | -20% |

| 回本周期 | 3 年 | 5-7 年 | 遥遥无期 |

| 行业结果 | 巨头垄断 | 并购整合 | 资产减值潮 |

三、 有钱也买不到:电力、芯片和散热的三道“紧箍咒”

即使有钱,AI 的发展也被物理世界的三道锁锁死:电力、芯片、散热。

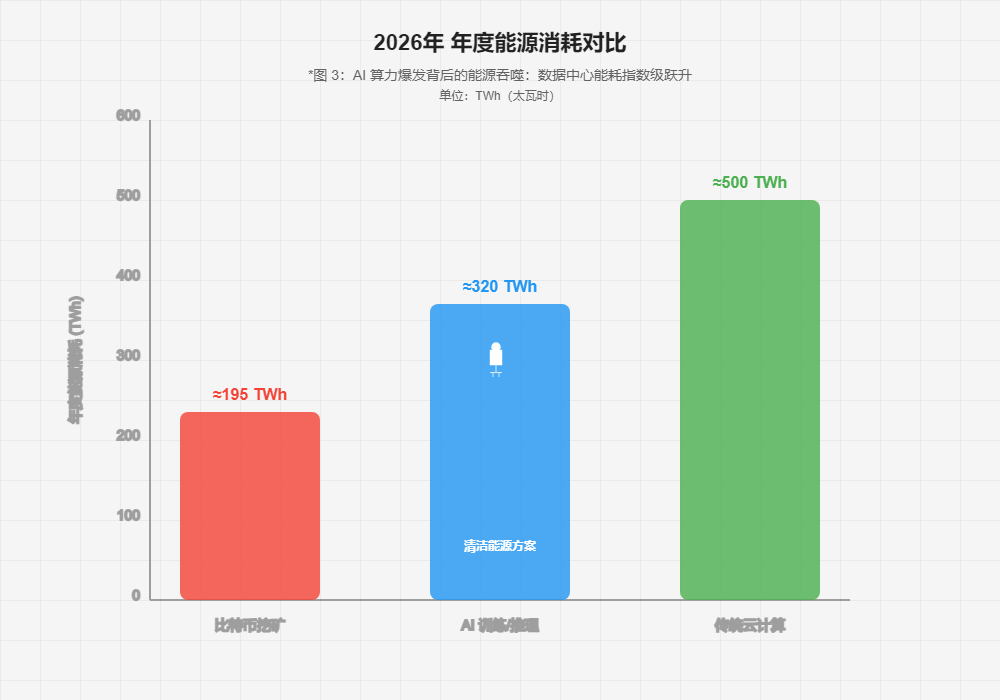

- 电力危机:

一个 10 万卡集群的数据中心,功耗高达 100-150 MW,相当于 10 万个美国家庭的用电量。在得克萨斯州,电网排队并网的时间已经长达 3-5 年。这也解释了为什么亚马逊刚刚花费 6.5 亿美元买下了一个直接连接核电站的数据中心园区。 - 芯片产能:

台积电的 CoWoS 封装产能虽然在扩产,但仍赶不上需求。HBM(高带宽内存)的良率也是制约 GPU 出货的关键。 - 散热极限:

随着 Blackwell 芯片功耗突破 1000W,传统的风冷已失效。数据中心必须全面转向液冷,这需要对建筑结构进行彻底改造。

AI 数据中心能耗与资源消耗对比

| 设施类型 | 单机柜功率密度 (kW) | 冷却方式 | 年耗电量 (GWh) | 对应家庭用电量 |

|---|---|---|---|---|

| 传统云数据中心 | 8 - 10 kW | 风冷 | ~30 | ~3,000 户 |

| AI 训练集群 (H100) | 40 - 50 kW | 风冷/液冷辅助 | ~150 | ~15,000 户 |

| 下一代超算 (Blackwell) | 100 - 120 kW | 全浸没式液冷 | > 500 | > 50,000 户 |

四、 历史总是惊人的相似:是郁金香泡沫,还是铁路大基建?

历史总是惊人的相似。1840 年代的铁路热和 2000 年的光纤泡沫,虽然导致了无数投资者破产,但它们留下的基础设施(铁路网和海底光纤)成为了后来工业革命和互联网繁荣的基石。

AI 的泡沫或许也是如此。Anthropic、OpenAI 们砸下的这 500 亿,即使通过不了财务审计,也会转化为算力基础设施留存在物理世界。

- 如果泡沫破裂: GPU 价格暴跌,算力变得像水电一样极其廉价,这将极大地降低 AI 应用开发的门槛,反而可能催生出真正的“AI 版 Uber”或“AI 版 Instagram”。

- 如果泡沫不破: 拥有算力的巨头将成为新时代的“东印度公司”,垄断数字世界的生产资料。

五、 总结

Anthropic 的 500 亿豪赌,是一场在此刻不得不下的注。在 AI 这个“赢家通吃”的牌桌上,更要比谁的“发电机”更耐用。对于投资者而言,警惕估值泡沫是必要的;但对于人类科技进程而言,这种非理性的繁荣或许正是通往未来的必经之路。正如 General Catalyst CEO 赫曼特·塔内贾所言:“泡沫不仅是金融现象,它是社会资本对技术变革投下的信任票。”