云厂商的噩梦!FLUX.2-Klein 发布:手机能跑“Midjourney”,免费、断网、还快 10 倍!

导语: 当所有人都在盯着 OpenAI 的万亿参数大模型时,德国的 Black Forest Labs 却悄悄干了一件“反向操作”的大事:他们把顶级图像生成模型 FLUX.1 “蒸馏”成了只有 25 亿参数的 FLUX.2-Klein。随着 Apple Intelligence 和高通骁龙 8 Elite NPU 的就位,手机端运行高质量 AI 不再是 PPT 里的饼。FLUX.2-Klein 的出现,意味着以后你生成一张 4K 壁纸,既不需要联网,也不需要付钱给云厂商,你的手机显卡自己就能搞定。

一、 为什么现在的 AI 绘图又贵又慢?因为你在“租”算力

目前的 AI 生成(如 Midjourney)虽然效果炸裂,但商业化落地面临“三高”:

- 高延迟 : 生成一张图要等 10-30 秒,没法用在实时游戏里。

- 高成本: 每次点击都在烧 GPU 的钱,免费模式不可持续。

- 高隐私风险: 企业不敢把机密设计图传到云端。

端侧 AI 是唯一的解药,但以前的模型太笨重,塞进手机就卡死。

二、 黑科技来了:把“大象”装进手机,FLUX.2-Klein 凭什么这么狂?

Black Forest Labs 并没有简单地“砍功能”,而是使用了“流匹配”和“知识蒸馏”技术。

简单来说,他们让一个巨大的老师模型把毕生功力传授给一个小巧的学生模型,让学生学会“走捷径”。结果就是:体积缩小 80%,速度提升 400%,画质却几乎没缩水。

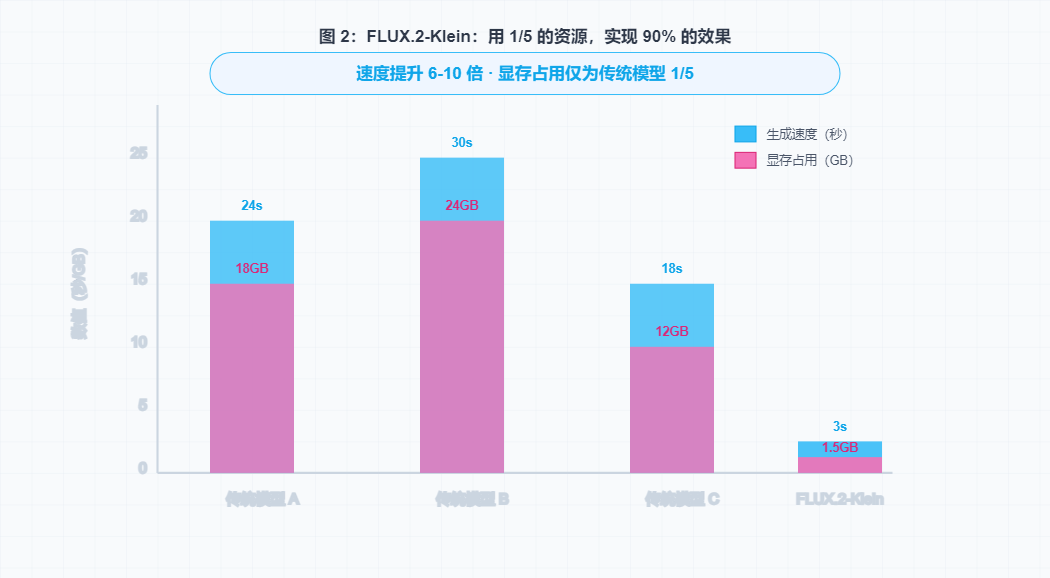

三、 不服跑个分:吊打竞品,这才是真正的“小钢炮”

为了直观展示 FLUX.2-Klein 的统治力,我们将它与目前主流的轻量级模型进行了对比。

端侧图像生成模型性能天梯榜

| 核心指标 | FLUX.2-Klein | SDXL Turbo (竞品) | FLUX.1 Pro (云端版) |

|---|---|---|---|

| 参数量 | 2.5B (极致轻量) | 3.5B | 12B |

| 显存占用 | < 4GB (手机可跑) | ~8GB | > 24GB |

| 生成速度 (RTX 4090) | 0.08秒 / 图 | 0.2秒 / 图 | 2.5秒 / 图 |

| 生成质量 (Elo 评分) | 1150 (逼真) | 1080 | 1250 (极致) |

| 部署环境 | 手机/笔记本 | 游戏本/工作站 | 云服务器集群 |

FLUX.2-Klein 成功卡位在 2.5B 参数 这个黄金分割点。这意味着它刚好能跑进 iPhone 16 Pro (8GB RAM) 的内存里,同时给微信和系统留出余地。

四、 苹果和高通笑醒了:这才是他们最想要的“杀手锏”

Apple Intelligence 虽然发布了,但目前的本地生图功能还是像简笔画。

FLUX.2-Klein 的出现,给了苹果和高通一个完美的“杀手级应用 ”。

- 高通的野心: 骁龙 8 Elite 芯片号称 NPU 算力提升 45%,正愁没东西跑。现在,手机厂商可以直接内置 FLUX.2,宣传“买手机送无限 AI 绘画”。

- 隐私护城河: 所有的生成都在本地 NPU 完成,数据不出手机。这对注重隐私的欧美用户是巨大的卖点。

商业模式预测:

Black Forest Labs 可能会向手机厂商(小米、三星、OPPO)收取 授权费,让 FLUX 成为安卓旗舰机的标配底层模型。

五、 以后不用下 App 了?你的手机相册自带“精修大师”

当端侧模型足够强大时,应用生态将发生剧变。

- App 消失: 你不再需要下载美图秀秀,系统自带的相册集成了 FLUX,修图、扩图、换装一键搞定。

- Model Store(模型商店): 用户会像下载 App 一样下载各种微调模型。比如下载一个“皮克斯风格包”,你的手机就能生成皮克斯动画。

六、 总结

FLUX.2-Klein 的发布,标志着 AI 正在经历从“集中式供能(发电厂)”到“分布式供能(电池)”的转型。对于普通用户来说,这意味着AI 自由——随时随地、断网可用、免费无限。对于行业来说,这意味着云厂商躺着收过路费的日子结束了,芯片厂商和终端厂商的肉搏战,才刚刚开始。