100根内存条换一套房?AI 吸干了全球产能,你的电脑快买不起了!

导语: 2025 年下半年,当所有人都在讨论 GPT-5 何时发布时,科技圈却在悄悄囤积一种不起眼的硬件——内存条。TrendForce 数据显示,DDR5 现货价半年内暴涨 307%,单条高容量服务器内存价格突破 4 万元。100 根这样的内存条,总价 400 万,在一线城市近郊足以换一套房。这疯狂一幕的背后,是 AI 行业撞上的一堵看不见的墙——“内存墙”。

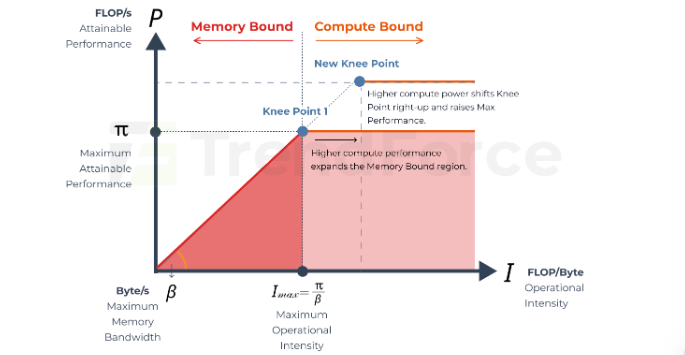

图注:算力与带宽的剪刀差,正在扼杀 AI 的上限

一、 为什么你的显卡在“磨洋工”?算力涨了6万倍,路却被堵死了!

AI 模型的每一次推理,本质上都是一次海量数据的搬运。加州大学伯克利分校的研究指出,目前大模型的算力需求每两年增长 750 倍,而内存带宽每两年仅增长 1.6 倍。

- 算力空转: 过去 20 年,芯片算力提升了 60,000 倍,但内存带宽仅提升了 100 倍。这意味着,价值 3 万美元的 NVIDIA H100 显卡,有 50% 以上的时间在“发呆”,等待数据从内存搬运过来。

- 能耗黑洞: 在冯·诺依曼架构下,计算和存储是分离的。数据在内存和处理器之间来回奔波,消耗了惊人的能量。研究表明,数据搬运的能耗是计算本身能耗的 100 倍。也就是说,数据中心那巨额的电费,大部分不是用来“思考”,而是用来“搬砖”。

如果不打破内存墙,即使我们造出了更强的 GPU,也只是造了一辆跑得更快的法拉利,却只能在乡村土路上怠速行驶。

二、 全球疯抢“芯片摩天大楼”:这三家公司,垄断了 AI 的命门

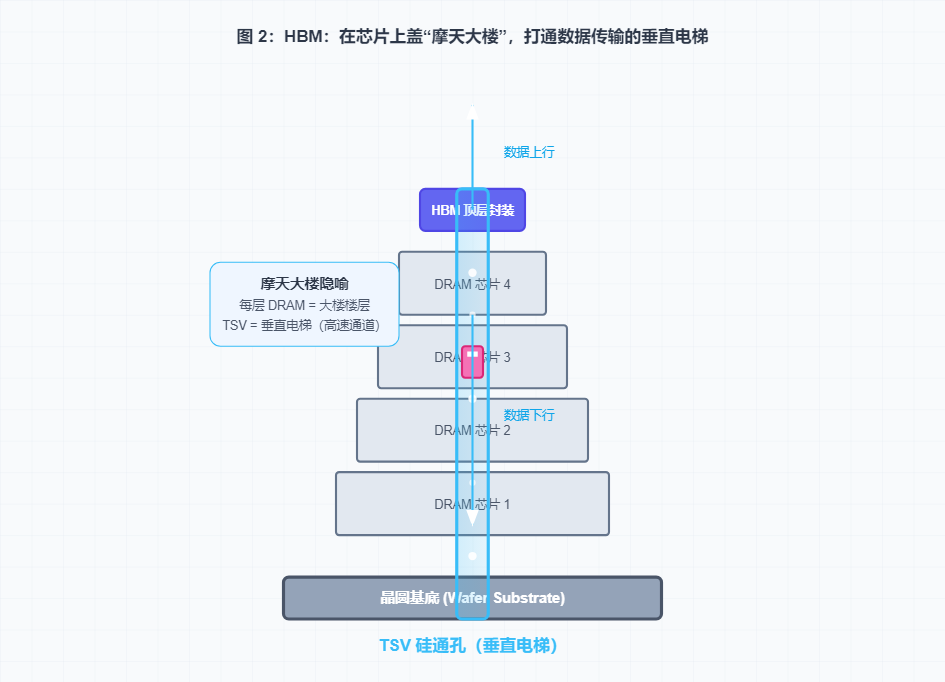

为了解决“搬运太慢”的问题,行业给出的暴力解法是 HBM,高带宽内存。

如果你把传统内存比作“平房”,那 HBM 就是在 GPU 旁边盖起的“摩天大楼”。它利用 硅通孔 技术,将 DRAM 芯片垂直堆叠 8 层、12 层甚至 16 层,并修通了成千上万部“垂直电梯”直达处理器。但这门技术极难,良率极低,全球只有三家公司能做。相当于它们掌握了 AI 算力的命门。

2026 全球 HBM 市场竞争格局透视

| 核心玩家 | HBM 市占率 (预估) | 核心技术/产品 | 产能扩充计划 (2026) | 战略地位 |

|---|---|---|---|---|

| SK Hynix | ~53% (霸主) | HBM3E / HBM4 | 产能翻倍,独家供应 NVIDIA H200/B200 | 英伟达御用。其 MR-MUF 封装技术良率最高,几乎垄断了高端市场利润。 |

| Samsung | ~38% (追赶者) | HBM3E (12层堆叠) | 投入 $150 亿 用于先进封装产线 | 全产业链巨头。试图利用“存储+代工”的一站式服务(Turnkey Solution)抢夺 AMD 和 Google 的订单。 |

| Micron | ~9% (搅局者) | HBM3E (低功耗版) | 专注于高端定制化市场,产能爬坡较慢 | 技术黑马。虽然份额小,但在能效比(Power Efficiency)上有 30% 的优势,受到数据中心青睐。 |

SK 海力士凭借先发优势拿走了 HBM 市场最丰厚的利润。三星虽然在传统存储上是老大,但在 HBM 上却成了追赶者,正在疯狂扩产试图通过“价格战”翻盘。

三、 电脑涨价的元凶找到了!巨头吃肉,普通人连汤都喝不起

AI 巨头的神仙打架,最后买单的是普通消费者。这不仅仅是通货膨胀,这是一场资源的零和博弈。

- 产能挤兑效应: 晶圆厂的产能是有限的。制造一颗 HBM 颗粒所消耗的晶圆面积和时间,是普通 DDR5 内存的数倍。当三星和海力士把 80% 的先进产能都拿去生产利润极高的 HBM 时,留给普通 PC 和手机内存(DDR5/LPDDR5)的产能自然就枯竭了。

- 价格传导机制: TechRadar 报道称,PC 端供应商正在优先保障大型 OEM(如 Dell, HP),压缩给第三方模组厂商的供货。花旗银行预测,2026 年 DRAM 平均售价将上涨 88%。这意味着,你想买一台 32GB 内存的笔记本,可能要比两年前多付 1000-2000 元。

- 手机也遭殃: 随着端侧 AI(如 Apple Intelligence)的普及,手机内存起步价将从 8GB 提升至 12GB 甚至 16GB。需求暴增叠加供给收缩,手机价格必然上涨。TrendForce 副总裁 Avril Wu 甚至建议分析师“囤一台 iPhone 17 以避险”。

四、 别只盯着 HBM!这几个“平替”技术,正在孕育下一个百亿巨头

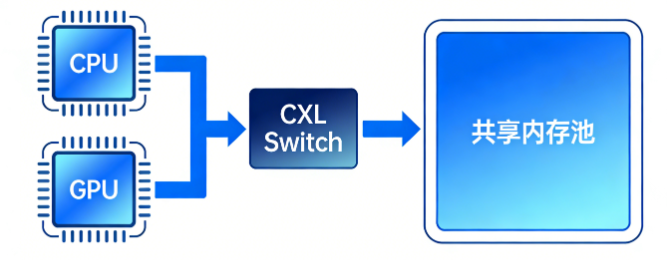

既然 HBM 这么贵且难产,有没有别的路?资本市场正在疯狂押注 CXL(计算互连) 和 PIM(存内计算) 赛道,试图寻找性价比更高的解药。

下一代内存架构潜力公司一览

| 赛道 | 核心逻辑 | 代表公司 (独角兽潜力股) | 融资/估值状态 | 解决什么问题? |

|---|---|---|---|---|

| CXL (互连协议) | “内存共享单车” 建立内存池,CPU/GPU 共享使用,打破单机容量限制。 |

Astera Labs 澜起科技 Panmnesia |

Astera 已上市 (市值$10B+) Panmnesia 获千万级融资 |

解决 “容量不够”。让服务器能像挂载硬盘一样挂载 TB 级的廉价内存池,大幅降低 AI 推理成本。 |

| PIM (存内计算) | “不再搬运数据” 让内存自己具备计算能力,数据在哪里,就在哪里算。 |

Samsung (HBM-PIM) NeuroBlade Syntiant |

NeuroBlade 融资 $83M Syntiant 融资 $65M |

解决 “能耗太高”。彻底消灭数据搬运,能效比提升 10 倍以上,特别适合端侧设备。 |

如果说 HBM 是“富人的玩具”,那么 CXL 就是“平民的救星”。它允许企业用更便宜的内存条组建巨大的内存池,是未来数据中心降本的关键。而 PIM 技术则可能彻底颠覆冯·诺依曼架构,虽然目前还在早期,但潜力巨大。

图注:CXL 架构:打破物理边界,实现内存资源的“云化”共享

五、 终局推演:以后拼的不是显卡,而是谁的“管子”更粗

2026 年的 AI 竞赛,本质上是一场“带宽竞赛”。

- 对于英伟达: GPU 只是外壳,HBM 才是灵魂。谁能拿到最多的 HBM 产能,谁就能出货最多的算力卡。英伟达甚至可能通过预付款“包圆”海力士两年的产能,来构建自己的护城河。

- 对于创业者: 谁能用 CXL 或 PIM 技术绕开 HBM 的昂贵壁垒,谁就有机会成为下一个百亿级芯片巨头。

- 对于地缘政治: 内存产能的高度集中(韩国占 90% HBM 份额),使其成为了继光刻机之后的又一个战略咽喉。

六、 总结

这堵“内存墙”,既是阻碍 AI 发展的最大障碍,也是半导体行业最大的金矿。它终结了过去十年电子产品“越用越便宜”的摩尔定律红利。对于普通人来说,在未来很长一段时间里,购买电子产品都将承受“AI 税”。那 100 根换一套房的内存条,不仅是炒作,更是这个算力时代最真实的注脚。囤一台 iPhone 17 或者几根内存条,或许不再是段子,而是 现在最朴素的理财建议。在这个算力即权力的时代,内存条就是新的黄金。