48小时两员大将出走!马斯克的xAI怎么了?30美元模型撕开巨头遮羞布

2026年2月底,埃隆·马斯克麾下的xAI遭遇人事地震。短短48小时内,Grok 4团队的两名核心骨干——Jiayi Pan 和 Toby Pohlen 相继离职。前者礼貌告别,后者则公开嘲讽xAI的“熬夜文化”。这不仅是一次简单的人员流动,更像是一场技术路线的分道扬镳。Jiayi Pan留下的 TinyZero 项目,用仅 30美元 的训练成本复现了DeepSeek R1-Zero级别的推理能力,狠狠打脸了动辄千亿美金的算力军备竞赛。

一、 48小时离职潮:体面告别与公开叫板

xAI内部究竟发生了什么?

- Jiayi Pan: 2月26日宣布离职。他在告别信中感谢了团队,给足了马斯克面子。作为Grok 4的核心贡献者,他在xAI的9个月里推动了模型从简单预测向自我验证的演进。

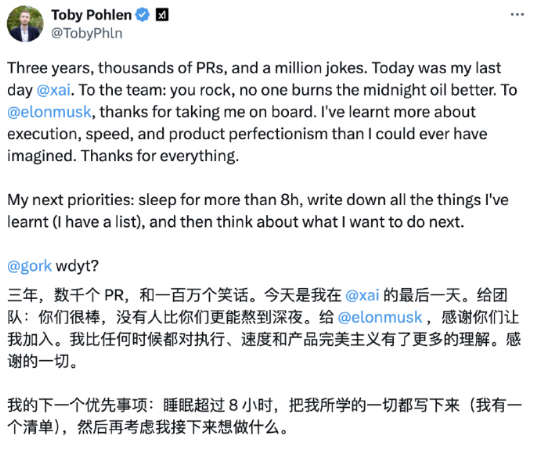

- Toby Pohlen: 几乎同一时间离职,但画风截然不同。他在社交媒体上直言不讳:“没有人比你们更能熬夜”,并直接@官方账号叫板。

这种截然不同的离职姿态,折射出xAI内部高压工作环境下的撕裂感。

深度观察:

对于顶级研究员来说,如果能够在技术上看到更清晰的路径(如TinyZero),那么留在巨头内部当一颗随时可能被“熬夜文化”耗尽的螺丝钉,显然不再具有吸引力。

二、 TinyZero:30美元的降维打击

Jiayi Pan离职后最大的财产,是他开源的 TinyZero 项目。

这是一个基于Qwen2.5-3B底座,仅需 30美元 训练成本,就通过纯强化学习(RL)实现了自我验证与推理能力的小模型。

TinyZero vs. 传统巨头模型 训练成本与效果对比

| 核心指标 | TinyZero (3B) | Grok 4 / GPT-5 (千亿参数) | 差异本质 |

|---|---|---|---|

| 训练成本 | $30 (几杯咖啡钱) | 数亿美元 (且持续投入) | 性价比 |

| 技术路径 | 纯RL自我进化 | 堆参数、堆数据、堆算力 | 路线之争 |

| 推理表现 | Countdown任务准确率 0% -> 80%+ | 依赖海量预训练数据 | 涌现能力 |

| 基础设施 | 单卡/消费级显卡 | 万卡集群 (H100/B200) | 去中心化 |

TinyZero证明了一个惊人的假设:高级推理能力不一定需要海量参数。

通过在SWE-Gym环境(基于真实GitHub Issue)中进行RL训练,模型学会了像人类一样“读懂代码 -> 生成Patch -> 自我修正”。这种“自我验证”的能力,原本被认为是超大模型的专利,现在却在3B小模型上涌现了。

三、 路线之争:Stargate是个笑话?

TinyZero的成功,让OpenAI和微软正在推进的 Stargate(星际之门)*计划显得有些尴尬。

Sam Altman曾宣称要在4年内投资数千亿美元建设AI基础设施。然而,据报道,该项目因三方(OpenAI、微软、甲骨文)利益冲突已陷入停滞,到2025年底连一个数据中心都没建成。

深度思考:

- 巨头路线: 相信“力大砖飞”,用5000亿美元砸出AGI。

- 新锐路线: 相信“算法为王”,用RL激发小模型的潜能。

当Jiayi Pan等核心成员验证了一条不依赖巨头资源的技术路径后,留在算力军备竞赛中“烧钱”似乎变得毫无意义。这或许才是他们离职的根本原因——技术信仰的转移。

四、 结语

xAI的这次离职潮,给整个AI行业敲响了警钟。

在Scaling Laws(缩放定律)面临边际效应递减的今天,单纯堆算力已经很难带来质的飞跃。Jiayi Pan用TinyZero告诉我们:智慧的涌现,可能并不昂贵。

未来的AI竞争,或许不再是谁的卡更多,而是谁能更聪明地训练模型。对于那些还在盲目烧钱的巨头来说,这可能是一个危险的信号。